今天智谱发布了"AutoGLM 沉思"版,很多人说他就是 Manus ,或 Deep Research 一类的产品,这样简单的归纳没错,甚至可以将 Manus归纳为 Deep Research 。但是这样简单的归纳会对开发者、用户都产生很多认知误差,我想很多人有同样的困扰,起码我有。

想想智谱发布桌面自动化类应用至今( AutoGLM-Web插件 ),直至"AutoGLM 沉思",目前可以基本看到接近完整的智谱全系产品线。

因此今天要聊的话题是围绕"AutoGLM 沉思",解构AI执行桌面操作任务的产品由哪些分支能力组成。

智谱官方的介绍很务实

AutoGLM沉思是一个能探究开放式问题,并根据结果执行操作的自主智能体(AI Agent)。 它能够模拟人类的思维过程,完成从数据检索、分析到生成报告。

面向用户,"AutoGLM 沉思"到底是什么都是开发者说的,开发者可以帮助用户聚焦于一个功能点,引导用户使用,最终没办法代表用户自我定义。

面向开发者,讨论"AutoGLM 沉思"是 Manus、Deep Research、智谱牛牛、AI搜索、Browser-Use,都不对,要拆分他的功能,讨论他的能力边界才有讨论价值。如果简单的将AutoGLM 沉思归纳为 Manus 有明显的错误,比如 Manus 可以完成计算类任务,"AutoGLM 沉思"不能。

从了解"AutoGLM 沉思"基本功能开始

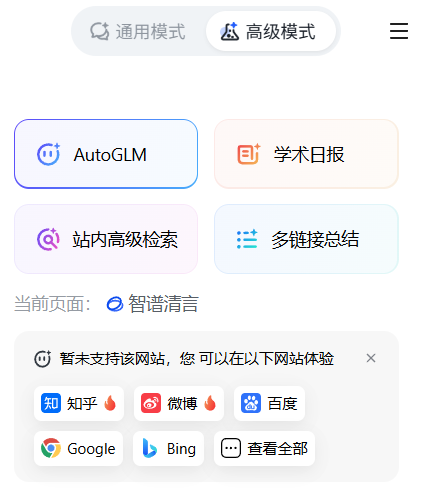

用过 清言浏览器插件 的朋友应该发现他们很类似,他们目前统一归纳到“AutoGLM”产品线,建议在使用"AutoGLM 沉思"客户端前,先从插件开始体验。两者功能不对等,插件功能(目前)要大于客户端。

但客户端目前可以访问“不在白名单范围内”的网站,而插件目前是限定信息范围的:

因此使用客户端来了解"AutoGLM 沉思"功能可以更好的挖掘其潜力。

1.下载客户端,必须同时安装插件

下载地址:https://autoglm-research.zhipuai.cn/#get_started

2.发起第一个任务(一起操作并观察过程)

从 https://aisharenet.com/ 找到所有免费的“AI翻译”工具,仅收集有客户端的AI翻译工具。

提示:这并不是一个好的任务描述,因为网站并没有提供站内搜索功能,以及明确的AI翻译工具入口,更好的任务描述是:从https://aisharenet.com/tag/aifanyi/ 开始翻页,从列表信息中找到所有免费且有客户端的AI翻译工具。

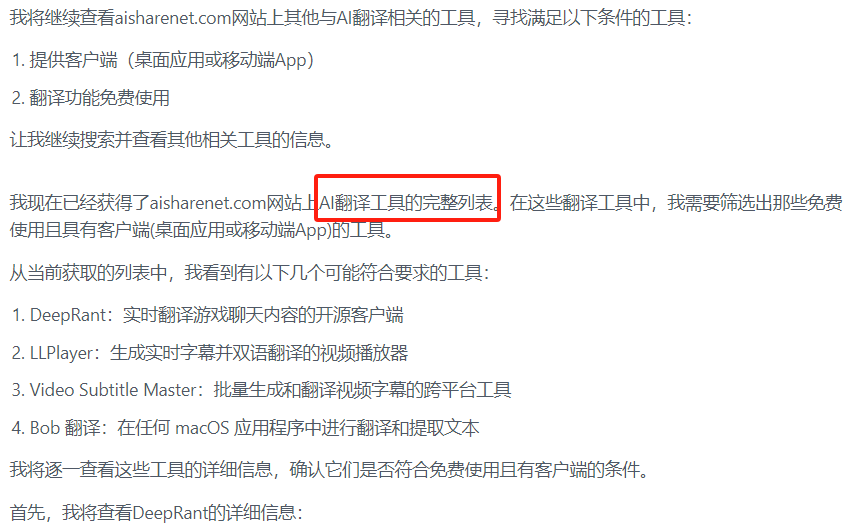

3.观察任务执行过程(这是工具执行中自动访问页面的部分截图)

思考

首先找到搜索框,输入“AI翻译”后执行搜索

进入必应搜索界面(网站的搜索框是跳转到必应搜索的),开始访问链接...

访问到第二个链接时,发现AI翻译工具的分类目录

在AI翻译工具分类列表中逐个链接浏览,并进行自动翻页

访问到第二页,开始执行总结任务

输出完整研究报告

4.未覆盖到的重要测试环节“登录”有兴趣的朋友自行发起一个任务观察交互过程,该任务是可以唤起登录交互动作的。(先退出小红书)

收集小红书关于DEEPSEEK生成视频的知识

定位

知识深度研究工具,从得到的结果可以逆向分析出该工具提示词设计就是围绕撰写研究报告,并不适合其他类型任务。

核心能力

- 生成待执行任务计划

- 唤起浏览器

- 浏览器内浏览(仅限文本)、点击、输入

- 任务判断节点(部分):网页浏览完成、观察页面并判断下一步任务、判断是否需要登录,信息获取结束

围绕浏览器视觉交互自动化,但仅用于收集信息并撰写研究报告,目前看并没有释放全部能力,特别是客户端加持的情况下,后续应该能集成更多能力。

一句话总结 AutoGLM沉思 与 智谱牛牛 差异

前者通过视觉操作浏览器,收集信息过程自动化,仅搜索和访问页面才会产生“输入”动作。

后者通过视觉操作桌面,不限于收集信息过程自动化,可自由操作桌面完成任务。

一句话总结 AutoGLM沉思 与 清言浏览器插件 差异

前者通过视觉操作浏览器,作为PC客户端后期可与更多接口交互。

后者依然有相同视觉操作浏览器能力,作为浏览器插件可原生与受访页面信息交互。

回到AI执行桌面操作任务的话题

先提出一个问题:

AutoGLM沉思的核心能力 Browser-Use 都有,撰写深度研究报告 STORM 更强大,为什么要使用AutoGLM沉思?

答案归纳以下几点:

AutoGLM沉思是面向消费者的产品化工具,设计完整的信息收集与撰写研究报告流程。

不需要配置复杂的本地安装环境,利用云端算力协同本地交互操作。

STORM 是固定信息源收集,无法访问非开放信息,而AutoGLM沉思利用浏览器自动化实现非开放信息收集。

到这里大家会模糊的认识到工具间一些不同?其实问题很简单,下面从归纳桌面人物自动化工具开始梳理。

桌面任务自动化的两类方案

1.传统的设置固定锚点,按流程执行。例如:微软PA、影刃。

2.纯视觉交互,利用 Browser-Use 辅助大模型判断并产生交互。例如:AutoGLM沉思。

3.混合:影刃也可以在固定工作流的基础上,部分节点(特别是内容提取环节)采用纯视觉交互。更为典型的是微软的自动化客服编排工具,引入AI后,让客服在固定SOP的前提下,工作更加人性化。

接着聚焦纯视觉交互方案,起一个名字吧...桌面任务自动执行智能体

桌面任务自动执行智能体可以有什么能力?

一般能力:

桌面视觉识别、桌面功能操作

扩展能力:

单一智能体、多智能体执行任务。一般都采用多智能体,分别执行任务规划、分支任务、任务统筹与信息汇总。

面向特定任务引用固定“工具”或固定“工作流”执行桌面操作。例如:计算、编程、优质信息源搜索。Manus 大家觉得强大的原因就是他集成了编程工具来完成一些分支任务。

扩展(接入)本地、远程数据源。

局限:

桌面任务自动执行智能体并不一定要纯视觉交互操作桌面,如果我的分支任务包含搜索“知乎知识”,可能直接对接知乎搜索结果更好,桌面操作反而低效。因此合理的扩展能力有助于发挥桌面智能体价值。

桌面任务自动执行智能体适合干什么

AutoGLM沉思限定于搜索非开放知识,应用于知识搜索场景很好,但发挥其更大价值的点在于自动化完成界面包含动态信息且重复的操作。这点 Convergence 做的很好,由AI自动完成任务执行,然后将任务执行过程保存下来,后续可以循环执行。

总结:查信息、执行重复工作。

桌面操作任务产品能力组合

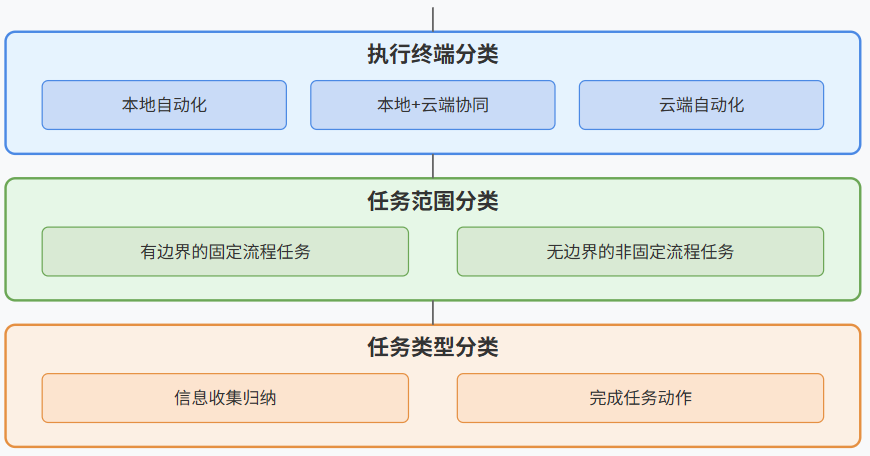

以上拆解的信息足够总结出目前同类产品形态。

最后无非是以下能力的组合,本地或云端,设计有流程、无流程任务执行范围,最终呈现给用户可执行任务类型。

能想到的所有同类工具都可以归纳到下图。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...