GLM-5-Turbo是什么

GLM-5-Turbo 是智谱 AI 发布的全球首款专为 OpenClaw(龙虾) 场景深度优化的基座模型,也是 GLM-5 系列的高速增强版本。模型从训练阶段就针对 Agent 任务的核心需求进行专项优化,重点增强工具调用、指令遵循、定时与持续性任务、长链路执行等能力,在智谱自研的端到端 Agent 评测基准 ZClawBench 中表现优异,多项指标超越 Claude Opus 4.6 和 Gemini 3.1 Pro。GLM-5-Turbo 支持 200K tokens 超长上下文输入和 128K tokens 输出,采用 MoE 架构与异步智能体强化学习技术,定价为输入 $0.96-1.00/百万 tokens、输出 $3.20/百万 tokens,已接入软通动力机械革命"龙虾盒子",为复杂系统工程、自动化开发及桌面级跨应用 Agent 提供强大支持。

GLM-5-Turbo的功能特色

- OpenClaw 专项优化:全球首款从训练阶段就针对 Agent 场景深度优化的基座模型,专为复杂 Agent 工作流设计。

- 超长上下文支持:支持 200K tokens 输入、128K tokens 输出,轻松处理长文档、多文件联调等复杂任务。

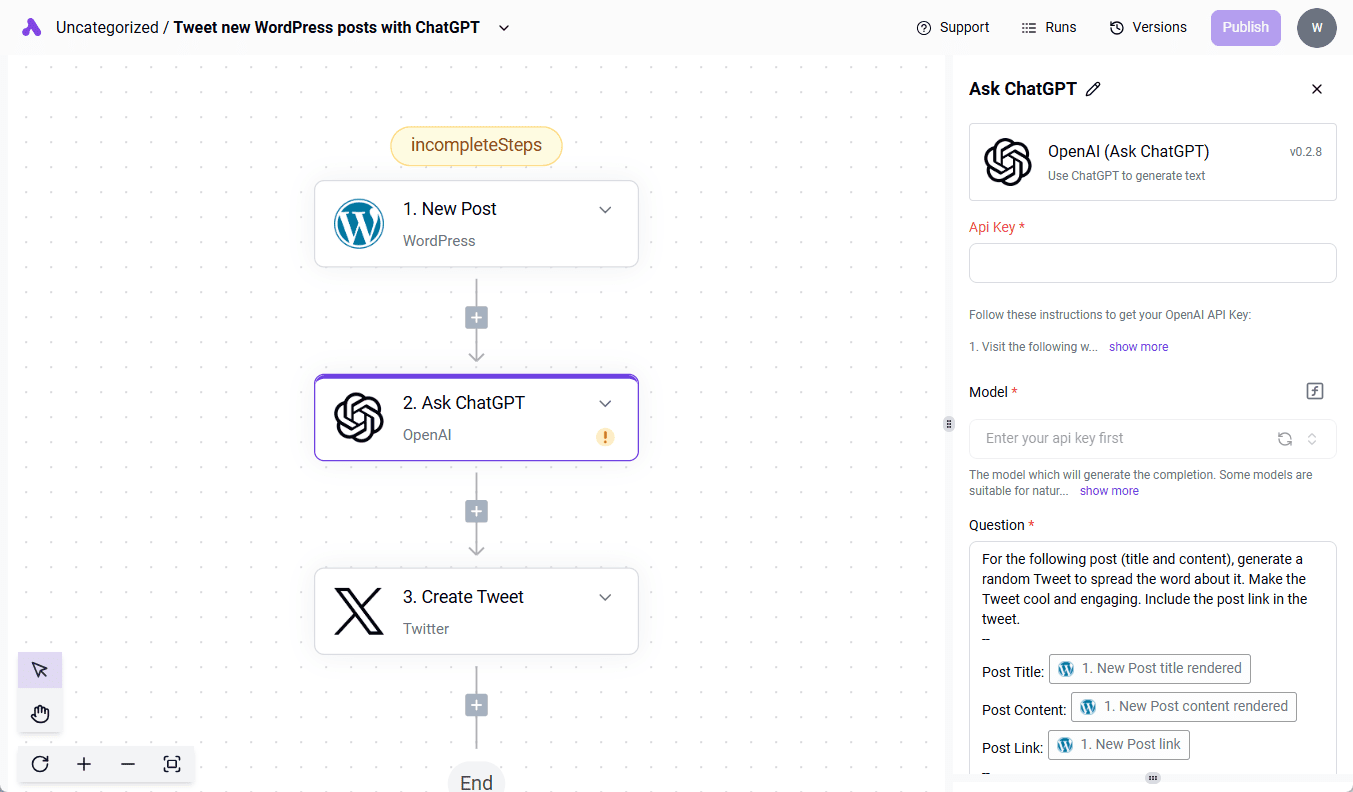

- Agent 核心能力强化:重点增强工具调用、指令遵循、定时与持续性任务、长链路执行等 Agent 必备能力。

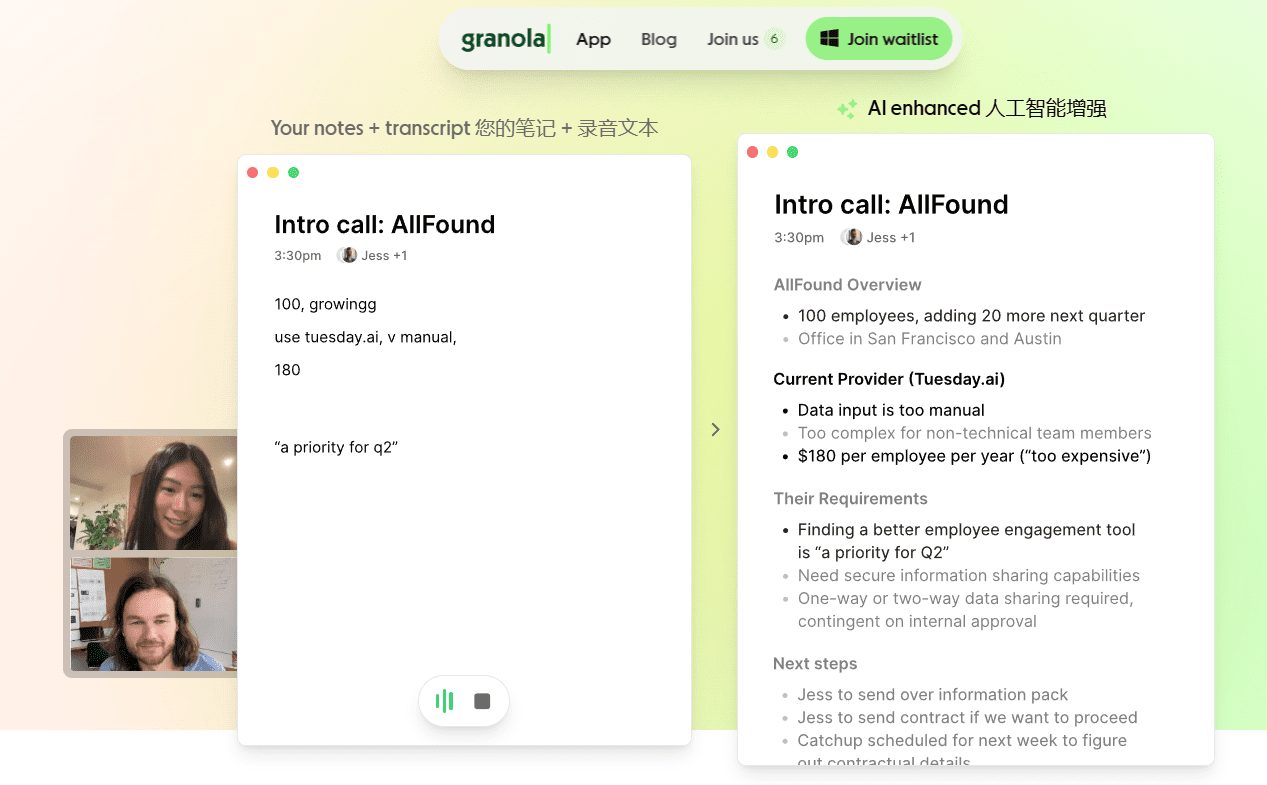

- 思考模式:支持深度推理模式,可自主规划多步骤任务执行路径。

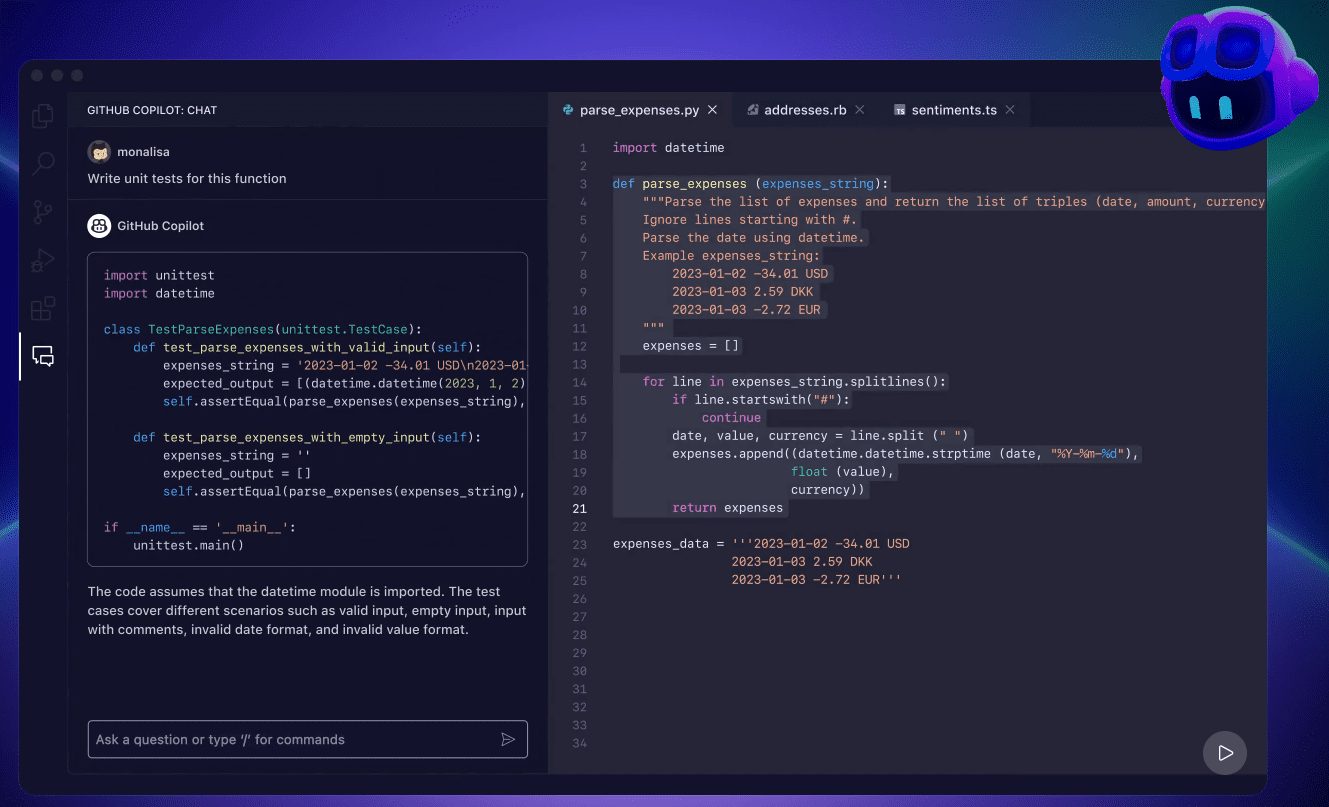

- Function Call & MCP:原生支持函数调用和模型上下文协议,实现与外部工具、API 的无缝集成。

- 结构化输出:支持 JSON 结构化输出,便于与业务流程和自动化系统对接。

- 上下文缓存:智能缓存机制提升长对话和多轮交互效率。

- MoE 架构:基于混合专家架构,兼顾性能与推理效率。

- 异步智能体强化学习:通过 Slime 框架进行后训练,持续优化 Agent 行为表现。

GLM-5-Turbo的核心优势

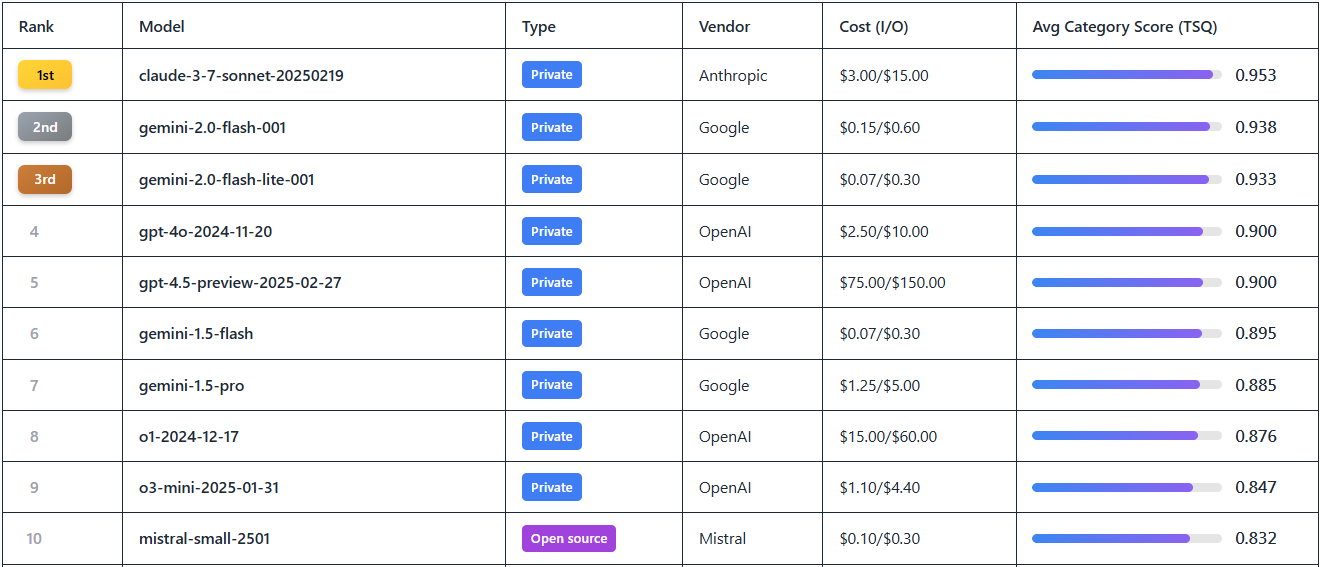

- 业界领先的 Agent 评测成绩:在智谱自研的端到端 Agent 评测基准 ZClawBench 中表现优异,整体领先于多家主流模型,部分场景超越 Claude Opus 4.6 和 Gemini 3.1 Pro。

- 原生 Agent 基因:区别于通用大模型后期适配 Agent 能力,GLM-5-Turbo 从训练阶段就针对 Agent 任务核心需求专项优化,工具调用和指令遵循能力更强。

- 超长上下文处理能力:200K tokens 输入 + 128K tokens 输出,在复杂系统工程、跨文件联调、长链条执行场景中优势明显。

- 高性价比:输入 $0.96-1.00/百万 tokens、输出 $3.20/百万 tokens,相比同级别模型定价更具竞争力。

- 完善的生态接入:已接入智谱开放平台 BigModel.cn、Z.ai API、AutoClaw 澳龙客户端,并搭载于软通动力机械革命"龙虾盒子"硬件终端。

- 定时与持续任务支持:原生支持定时触发、持续性任务执行,满足自动化运维、定时数据处理等场景需求。

- 端到端工程能力:专为复杂系统工程和自动化开发设计,支持多步自动化调试、跨应用数据流转等高级 Agent 工作流。

GLM-5-Turbo官网是什么

- 官方API接入:可通过智谱开放平台 BigModel 或 Z.ai 直接调用API。

- 在线体验:可通过AutoClaw澳龙客户端(https://autoglm.zhipuai.cn/autoclaw)、智谱清言APP或网页版在线体验。

GLM-5-Turbo的适用人群

- AI Agent 开发者:专注构建复杂 Agent 应用、智能体工作流的开发者,需要原生支持工具调用、长链路执行和定时任务的基础模型。

- 自动化工程师:从事 RPA、自动化运维、定时任务调度等工作的技术人员,需要模型具备持续任务执行和指令遵循能力。

- 全栈开发者与系统架构师:需要处理跨文件联调、复杂系统工程、多步骤自动化调试的开发人员。

- 企业 IT 与数字化转型团队:推动企业流程自动化、构建内部智能助手和 Agent 平台的技术决策者。

- 桌面级 Agent 用户:使用 AutoClaw 澳龙客户端或"龙虾盒子"等硬件终端,需要本地高性能 Agent 能力的个人用户。

- 长文档处理从业者:法律、金融、科研等领域需要处理超长文本、进行深度分析和结构化输出的专业人士。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...