综合介绍

Fish Speech是由Fish Audio开发的一款开源文本到语音(TTS)合成工具。该工具基于VQ-GAN、Llama和VITS等前沿AI技术,能够将文本转换成逼真的语音。Fish Speech不仅支持多种语言,还提供了高效的语音合成解决方案,适用于各种应用场景,如配音、语音助手和无障碍阅读等。

语音克隆项目FishSpeech1.5更新咯~类似之前我分享的例如 F5-TTS 、 MaskGCT 等声音克隆项目,FishSpeech 只需要5-10秒的语音样本,就能高度还原一个人的声音特征,而且支持中英日韩等多种语言互换。

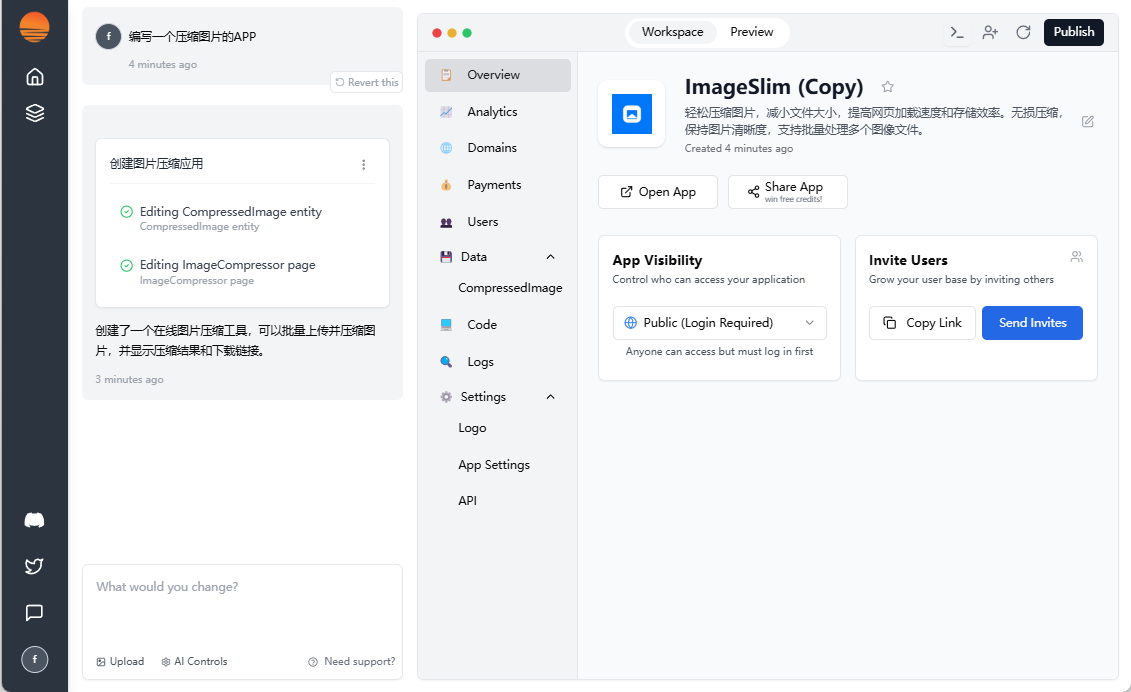

已提供开源 Fish Speech v1.5.0 优化版一件整合包。

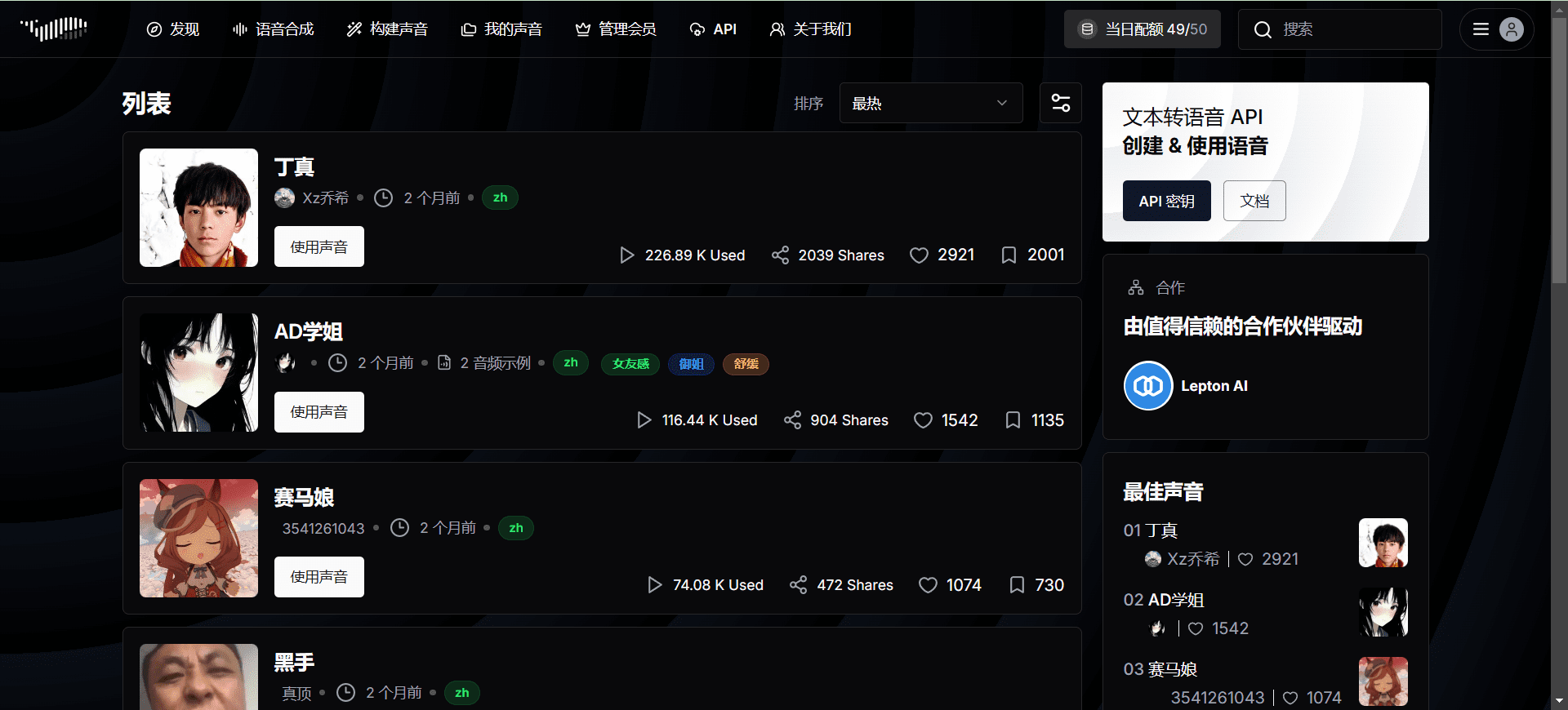

在线体验地址:https://fish.audio/zh-CN/

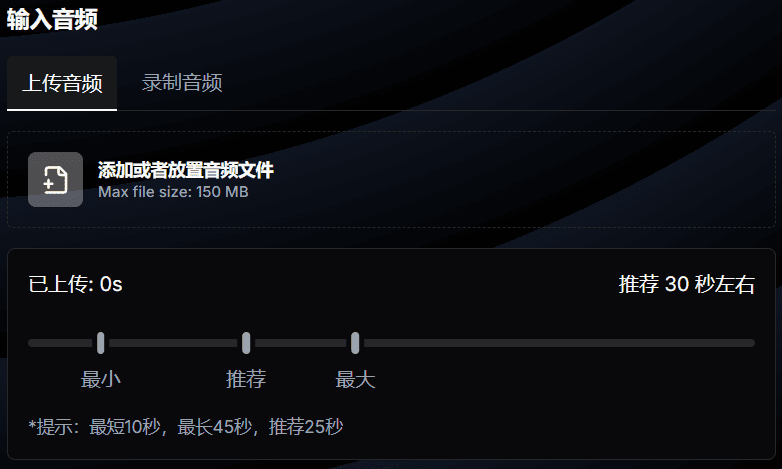

推荐30秒音频

功能列表

- 多语言支持:支持多种语言的文本到语音转换。

- 高效合成:基于VQ-GAN、Llama和VITS等技术,实现高效的语音合成。

- 开源项目:代码开源,用户可以自由下载和使用。

- 在线演示:提供在线演示功能,用户可以直接体验语音合成效果。

- 模型下载:支持在Hugging Face平台下载预训练模型。

使用帮助

安装流程

系统要求

- GPU 内存:4GB(用于推理),8GB(用于微调)

- 系统:Linux, Windows

Windows 配置

专业用户

- 考虑使用WSL2或Docker运行代码库。

非专业用户

- 解压项目压缩包。

- 点击 install_env.bat 安装环境。

- 可以通过编辑 install_env.bat 的 USE_MIRROR 项来决定是否使用镜像站下载。

USE_MIRROR=false使用原始站下载最新稳定版 torch 环境。USE_MIRROR=true使用镜像站下载最新 torch 环境(默认)。

- 可以通过编辑 install_env.bat 的 INSTALL_TYPE 项来决定是否启用可编译环境下载。

INSTALL_TYPE=preview下载开发版编译环境。INSTALL_TYPE=stable下载稳定版不带编译环境。

- 可以通过编辑 install_env.bat 的 USE_MIRROR 项来决定是否使用镜像站下载。

- 若第2步 INSTALL_TYPE=preview,则执行这一步(可跳过,此步为激活编译模型环境)。

- 下载 LLVM 编译器:

- LLVM-17.0.6(原站下载)

- LLVM-17.0.6(镜像站下载)

- 下载完 LLVM-17.0.6-win64.exe 后,双击进行安装,选择合适的安装位置,勾选 Add Path to Current User 添加环境变量。

- 下载 LLVM 编译器:

- 下载安装 Microsoft Visual C++ 可再发行程序包,解决潜在 .dll 丢失问题。

- 下载安装 Visual Studio 社区版以获取 MSVC++ 编译工具,解决 LLVM 的头文件依赖问题。

- Visual Studio 下载

- 安装好 Visual Studio Installer 之后,下载 Visual Studio Community 2022。

- 点击修改按钮,找到使用C++的桌面开发项,勾选下载。

- 下载安装 CUDA Toolkit 12。

- 双击 start.bat 打开训练推理 WebUI 管理界面。如有需要,可照下列提示修改API_FLAGS。

- 想启动推理 WebUI 界面?编辑项目根目录下的 API_FLAGS.txt,前三行修改成如下格式:

--infer # --api # --listen ... - 想启动 API 服务器?编辑项目根目录下的 API_FLAGS.txt,前三行修改成如下格式:

# --infer --api --listen ...

- 想启动推理 WebUI 界面?编辑项目根目录下的 API_FLAGS.txt,前三行修改成如下格式:

- 双击 run_cmd.bat 进入本项目的 conda/python 命令行环境。

Linux 配置

- 创建一个 python 3.10 虚拟环境,你也可以用 virtualenv:

conda create -n fish-speech python=3.10 conda activate fish-speech - 安装 pytorch:

pip3 install torch torchvision torchaudio - 安装 fish-speech:

pip3 install -e .[stable] - (Ubuntu / Debian 用户) 安装 sox:

apt install libsox-dev

Docker 配置

- 安装 NVIDIA Container Toolkit:

- 对于 Ubuntu 用户:

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \ && curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \ sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \ sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list sudo apt-get update sudo apt-get install -y nvidia-container-toolkit sudo systemctl restart docker - 对于使用其他 Linux 发行版的用户,安装指南请参考:NVIDIA Container Toolkit Install-guide。

- 对于 Ubuntu 用户:

- 拉取并运行 fish-speech 镜像:

docker pull lengyue233/fish-speech docker run -it \ --name fish-speech \ --gpus all \ -p 7860:7860 \ lengyue233/fish-speech \ zsh- 如果需要使用其他端口,请修改

-p参数为YourPort:7860。

- 如果需要使用其他端口,请修改

- 下载模型依赖:

- 确保您在 docker 容器内的终端,然后再从我们的 huggingface 仓库下载所需的 vqgan 和 llama 模型:

huggingface-cli download fishaudio/fish-speech-1.4 --local-dir checkpoints/fish-speech-1.4 - 对于中国大陆用户,可以通过镜像站下载:

HF_ENDPOINT=https://hf-mirror.com huggingface-cli download fishaudio/fish-speech-1.4 --local-dir checkpoints/fish-speech-1.4

- 确保您在 docker 容器内的终端,然后再从我们的 huggingface 仓库下载所需的 vqgan 和 llama 模型:

- 配置环境变量,访问 WebUI:

- 在 docker 容器内的终端,输入:

export GRADIO_SERVER_NAME="0.0.0.0" - 接着在 docker 容器内的终端,输入:

python tools/webui.py - 如果是 WSL 或者是 MacOS,访问

http://localhost:7860即可打开 WebUI 界面。 - 如果是部署在服务器上,更换

localhost为您的服务器 IP 即可。

- 在 docker 容器内的终端,输入:

Fish Audio一键安装包

推荐牛哥最新版本,解压密码:niugee.com

https://drive.google.com/drive/folders/1KeYuZ9fYplDEgA3jg2IUKtECpT0wsz6V?usp=drive_link

链接:https://pan.baidu.com/s/1pWaziAC7xMV908TuOkYdyw?pwd=niug 提取码:niug

剑27专版:https://pan.quark.cn/s/30608499dee1 压缩包解压密码是jian27或者jian27.com

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...