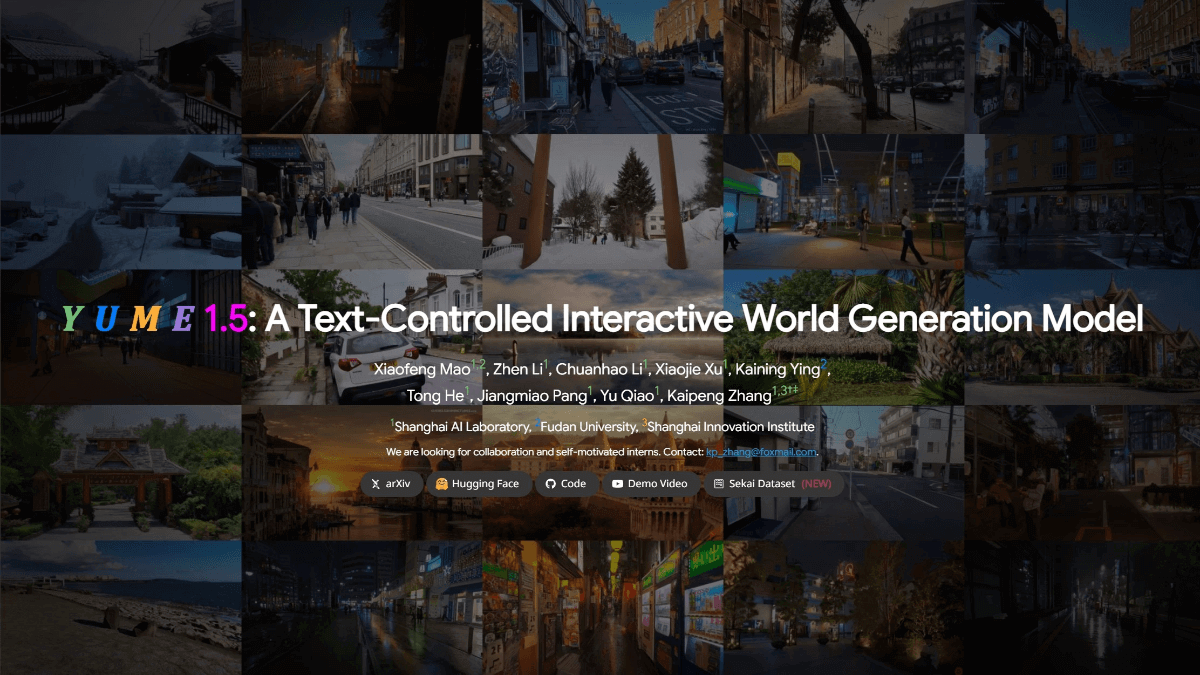

Yume1.5是什么

Yume1.5是开源的交互式世界生成模型,由上海人工智能实验室、复旦大学、上海创新研究院联合开发,能实现实时交互渲染(单卡12 FPS)。采用了联合时空通道建模(TSCM)技术,即使上下文长度增加也能保持稳定采样速度,集成Self-Forcing以加速推理并减少误差累积。模型在世界生成和编辑任务上表现优异,相关论文和开源代码可通过GitHub获取。

Yume1.5的功能特色

- 高效实时生成:Yume-1.5能实现每秒12帧(540p分辨率)的推理速度,将基准生成时间缩短至8秒,显著提升了实时性能,快速生成逼真的虚拟世界。

- 文本控制功能:模型支持通过自然语言提示生成动态事件,用户可以通过文本指令控制虚拟世界的生成和变化,实现对生成内容的语义引导。

- 键盘交互体验:支持基于键盘的生成世界探索,模拟第一人称导航,用户可以通过键盘控制人物和相机移动,增强了用户的交互体验。

- 技术创新突破:采用联合时间-空间-通道建模(TSCM)技术,解决了长视频生成中历史上下文快速增长的问题,通过分层压缩技术在多个维度高效压缩历史帧上下文。

- 双向注意力蒸馏:结合增强文本嵌入方案,加速采样过程,减少自回归生成中的误差累积,显著提高了推理效率。

- 混合数据集训练:通过混合数据集训练策略和事件与动作描述的架构分解,实现了对生成内容的语义引导,提升了模型的生成质量和多样性。

- 广泛的应用前景:Yume-1.5在沉浸式模拟、虚拟体现和互动娱乐等领域具有广泛的应用前景,能够为用户提供更加逼真和丰富的虚拟世界体验。

Yume1.5的核心优势

- 高效推理性能:Yume-1.5实现了每秒12帧(540p分辨率)的推理速度,将基准生成时间缩短至8秒,显著提升了实时生成的效率。

- 文本驱动的交互性:用户可以通过自然语言指令控制虚拟世界的生成和变化,实现动态事件的生成,增强了用户与虚拟世界的互动性。

- 第一人称导航体验:支持基于键盘的交互,模拟第一人称导航,用户可以自由控制人物和相机移动,提供沉浸式的探索体验。

- 创新的建模技术:采用联合时间-空间-通道建模(TSCM),有效解决了长视频生成中历史上下文快速增长的问题,提升了生成质量和效率。

- 双向注意力机制:通过双向注意力蒸馏和增强文本嵌入方案,加速采样过程,减少误差累积,进一步提高了推理速度。

- 混合数据集训练策略:结合多种数据集进行训练,提升了模型对不同场景和事件的适应能力,增强了生成内容的多样性和逼真度。

Yume1.5官网是什么

- 项目官网:https://stdstu12.github.io/YUME-Project/

- GitHub仓库:https://github.com/stdstu12/YUME

- HuggingFace模型库:https://huggingface.co/stdstu123/Yume-5B-720P

- arXiv技术论文:https://arxiv.org/pdf/2512.22096

Yume1.5的适用人群

- 游戏开发者:可以用Yume-1.5快速生成虚拟游戏世界,减少开发时间和成本,为玩家提供更具沉浸感的游戏体验。

- 虚拟现实(VR)和增强现实(AR)开发者:能通过该模型创建逼真的虚拟环境,提升VR/AR应用的真实感和交互性。

- 影视制作人员:可用于生成虚拟场景和特效,辅助电影、电视剧等影视作品的制作,节省搭建实景的成本和时间。

- 教育工作者:可以创建虚拟教学环境,用于历史重现、科学模拟等教育场景,增强学生的学习兴趣和理解能力。

- 建筑设计与规划人员:能快速生成建筑模型和城市规划的虚拟场景,用于方案展示和客户沟通,提升设计效率。

- 娱乐行业从业者:如主题公园、密室逃脱等场所的设计师,可以用Yume-1.5生成独特的虚拟场景,丰富娱乐体验。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...