综合介绍

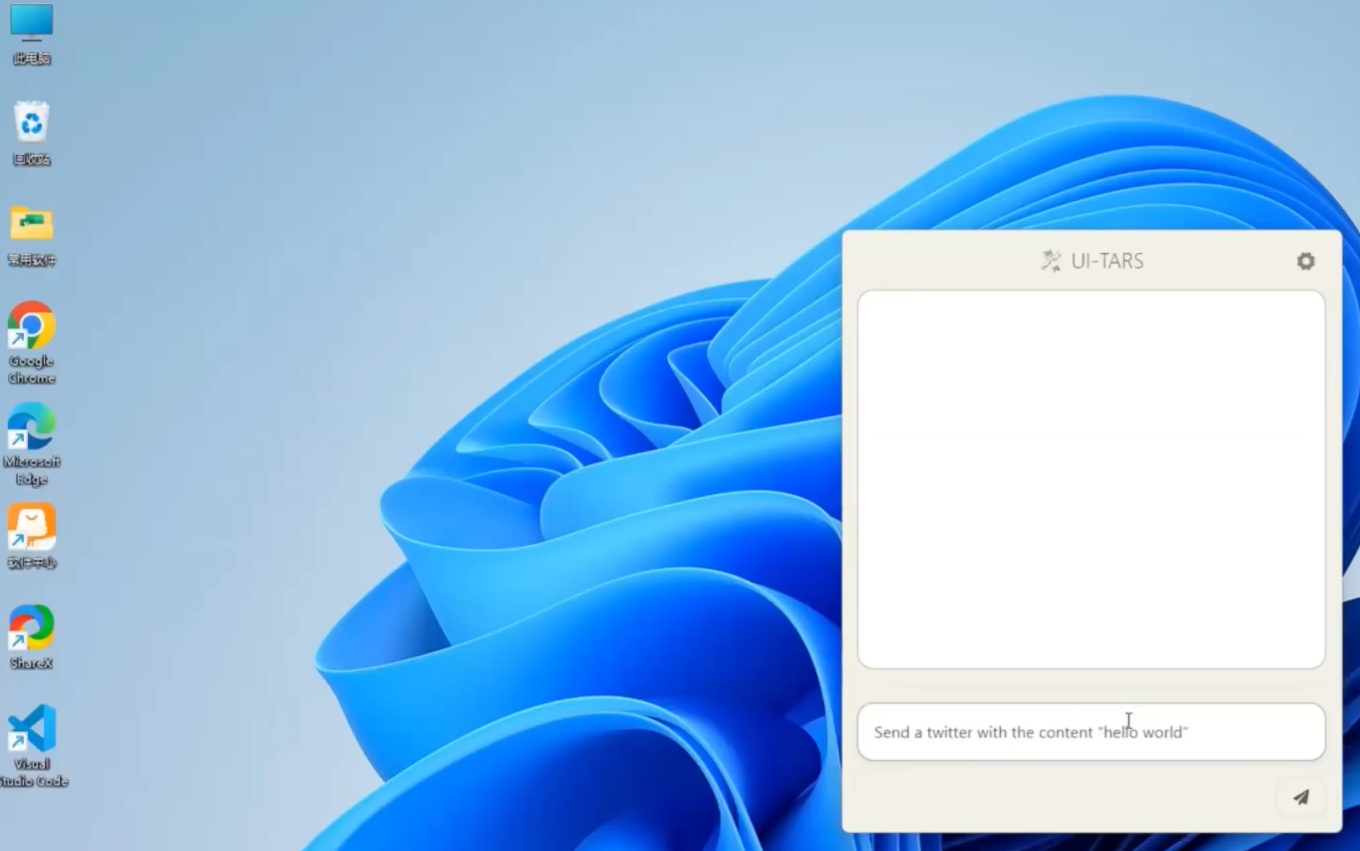

UI-TARS Desktop 是由字节跳动开发的一款基于 UI-TARS(视觉语言模型)的图形界面代理应用。该应用允许用户通过自然语言来控制计算机,实现更直观和高效的人机交互。UI-TARS Desktop 支持跨平台操作,兼容 Windows 和 macOS 系统,提供实时反馈和状态显示功能。用户可以通过简单的语音指令完成截图、视觉识别、精确的鼠标和键盘控制等操作,极大地提升了计算机操作的便捷性和智能化水平。

功能列表

- 自然语言控制:通过语音指令控制计算机操作

- 截图和视觉识别:支持屏幕截图和图像识别功能

- 精确鼠标和键盘控制:实现高精度的鼠标和键盘操作

- 跨平台支持:兼容 Windows 和 macOS 系统

- 实时反馈和状态显示:提供操作的实时反馈和状态更新

使用帮助

安装流程

MacOS

- 下载最新版本的 UI-TARS Desktop 应用。

- 将 UI-TARS 应用拖动到“应用程序”文件夹中。

- 在 macOS 系统设置中启用 UI-TARS 的权限:

- 系统设置 -> 隐私与安全 -> 辅助功能

- 系统设置 -> 隐私与安全 -> 屏幕录制

- 打开 UI-TARS 应用,若应用损坏,可在终端中使用

sudo xattr -dr com.apple.quarantine /Applications/UI\ TARS.app修复。

Windows

- 下载最新版本的 UI-TARS Desktop 应用。

- 运行应用程序,按照提示完成安装。

使用指南

- 打开 UI-TARS 应用后,用户可以看到主界面。

- 在主界面中,用户可以通过语音指令执行各种操作,例如获取天气信息、发送推特等。

- 应用支持 HuggingFace(云端)和 Ollama(本地)部署的视觉语言模型(VLM),推荐使用 HuggingFace 推理端点进行快速部署。

- 用户可以参考提供的 GUI 模型部署指南进行模型部署。

主要功能操作流程

自然语言控制

- 在主界面中,点击麦克风图标开始语音输入。

- 说出指令,例如“打开浏览器并搜索天气”。

- 应用将根据指令执行相应操作,并在界面上显示结果。

截图和视觉识别

- 在主界面中,选择“截图”功能。

- 使用鼠标选择需要截图的区域。

- 应用将自动识别截图内容,并显示识别结果。

精确鼠标和键盘控制

- 在主界面中,选择“鼠标控制”或“键盘控制”功能。

- 使用语音指令或手动输入指令,控制鼠标移动和键盘输入。

- 应用将根据指令执行相应操作,并提供实时反馈。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...