MiniCPM-o 4.5是什么

MiniCPM-o 4.5 是面壁智能开源的 9B 全模态旗舰模型,以“边看边听主动说”的端到端架构,在手机端即可跑出 GPT-4o 级体验:支持单图、多图、高帧率长视频、实时语音双工对话,首 token < 2 s,解码 17 tokens/s;INT4 量化后 5 GB 显存可跑,已适配昇腾等 6 款国产芯片,推理再提速 7-22%。3 秒语音克隆、1 Hz 主动交互、OCR 与文档理解全线 SOTA,OpenCompass 全模态榜 77.6 分超越 GPT-4o。Apache 2.0 协议,GitHub、Ollama 一键即用,端侧商用零门槛。

MiniCPM-o 4.5的功能特色

- 全模态交互能力:MiniCPM-o 4.5是行业首个实现“边看、边听、主动说”的全模态大模型,突破传统“一问一答”的交互模式,支持实时感知视觉、音频和文本信息,在输出过程中持续保持对环境的感知,实现类人自然的交互体验。

- 全双工架构:采用原生全双工多模态实时流机制,模型在生成语音或文本输出的同时,能同步接收和处理视觉、音频输入,避免了传统模型在输出时对外界感知的中断,确保信息感知不丢失。

- 高能效比与端侧部署:仅9B参数规模,在全模态理解、视觉理解、文档解析、语音生成等任务上达到SOTA水平,具备低显存占用、快速响应的特点,适合在端侧设备(如智能眼镜、机器人、车机等)部署,实现本地化推理。

- 语音生成与克隆:支持自然、情感饱满的语音生成,显著提升音色拟人度和长语音合成稳定性,提供声音克隆功能,可通过少量样本定制个性化音色,用于角色扮演等场景。

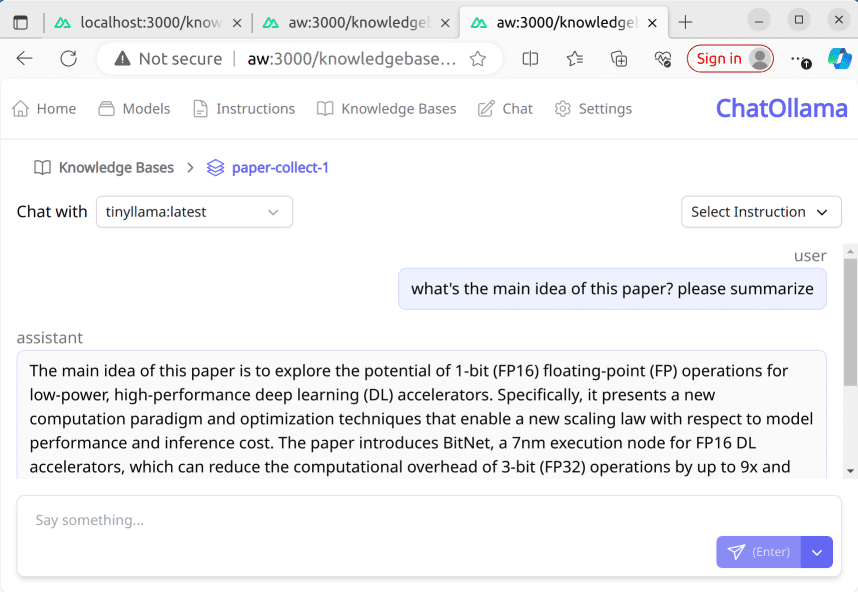

- 跨平台兼容性:已在GitHub、Hugging Face等平台开源,支持多种推理框架(如LLaMA.cpp、vLLM等),可在天数智芯、华为昇腾、平头哥等多款芯片上实现端到端推理,降低部署门槛。

MiniCPM-o 4.5的核心优势

- 原生全双工,对话“不卡顿”:业内首个端到端全双工架构,毫秒级时分复用,边说边听边看边回,彻底告别“对讲机”式回合制。

- 9B 参数密度拉满,性能越级:OpenCompass 全模态评测 77.6 分,直接超越 GPT-4o 与 Gemini 2.0 Pro;OCR、文档解析、视频理解全线 SOTA。

- 1 Hz 主动交互,AI 先开口:每秒 1 次环境扫描,看见/听见变化可主动提醒,实现“类人”式插话与实时评论。

- 超拟人语音,3 秒克隆:端到端 CosyVoice2 方案,长语音音色一致、情感自动匹配;几秒参考音频即可复刻任意角色,支持中英双语实时对讲。

- 端侧“小钢炮”,8 GB 可跑:INT4 量化后 < 5 GB 显存,iPhone 16 Pro Max 首 Token < 2 s,解码 17 tokens/s;提供 16 种 GGUF 与 Ollama/llama.cpp 一键包。

- 6 大国产芯片“发布即适配”:基于 FlagOS 统一栈,昇腾、天数、平头哥、海光、沐曦等端到端推理平均提速 7.8 %–22 %,业界首次实现跨芯规模化落地。

MiniCPM-o 4.5官网是什么

- GitHub仓库:https://github.com/OpenBMB/MiniCPM-o

- HuggingFace模型库:https://huggingface.co/openbmb/MiniCPM-o-4_5

- 在线体验Demo:https://huggingface.co/spaces/openbmb/minicpm-omni

MiniCPM-o 4.5的适用人群

- 端侧开发者 / 嵌入式工程师:9B 量化<5 GB,树莓派、RK3588、iPhone 16 Pro 立等可跑;llama.cpp-omni、Ollama 一键包,5 分钟把全模态能力塞进自家硬件。

- 视障与银发辅助 App 团队:1 Hz 主动扫描+环境声事件检测,可“看见台阶就提醒、听见公交报站即复读”,已落地盲人导航、跌倒报警场景。

- 教育 / 出版 SaaS:OCR+文档理解 SOTA,试卷、图表、多栏 PDF 秒级结构化;3 秒克隆教师音色,自动生成带情感讲解的微课音频。

- 短视频 & 直播运营:高帧率长视频端到端理解,2-3 min 素材一次喂入即可生成时间轴级摘要、金句切片和配音,剪辑效率翻倍。

- 客服与语音交互厂商:全双工毫秒级对讲,打断、插话、情绪识别原生支持;中英双语实时 TTS,直接替换闭源 GPT-4o 语音 API,成本降 90%。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...