VibeThinker-1.5B是什么

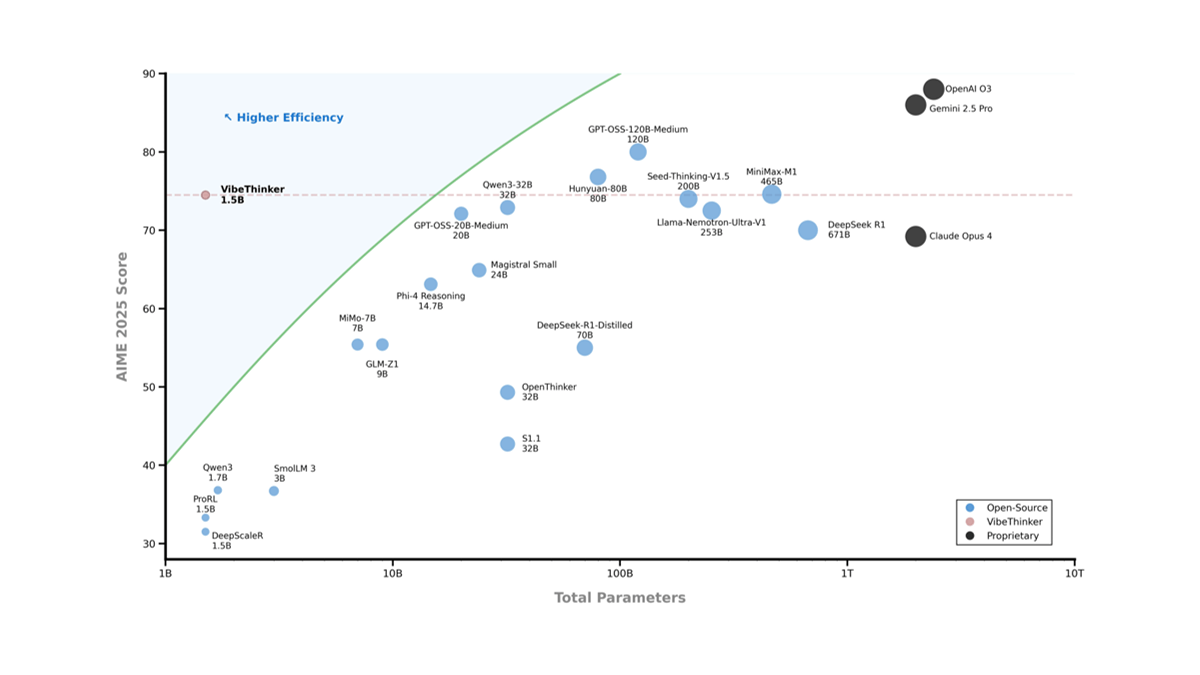

VibeThinker-1.5B是微博AI开源的15亿参数的大型语言模型。基于阿里巴巴的Qwen2.5-Math-1.5B进行精细调整,专为数学和代码任务优化,表现出色,推理性能在行业内处于领先水平。模型采用“谱-信号原则”(SSP)训练框架,分为监督微调和强化学习两个阶段,通过优化路径放大信号,使小模型也能高效探索推理空间。

VibeThinker-1.5B的功能特色

- 强大的数学和代码能力:VibeThinker-1.5B在数学推理和代码生成任务上表现出色,经过精细调整后,其推理性能在行业内处于领先水平,甚至超越了参数量更大的模型。

- 高效的训练框架:采用“谱-信号原则”(SSP)训练框架,将监督微调和强化学习分为两个阶段,先注重多样性,再通过强化学习优化路径,实现信号放大,使小模型也能高效探索推理空间。

- 低成本训练:模型的后期训练成本仅为7800美元,远低于同类或更大规模模型所需的数十万美元甚至数百万美元,具有较高的性价比。

- 开源与免费使用:VibeThinker-1.5B已免费在Hugging Face、GitHub和ModelScope等平台上线,遵循MIT许可证,可供研究人员和开发者免费使用,甚至可用于商业目的,降低了开发门槛。

- 多平台支持:模型支持多种主流平台,方便用户根据需求选择合适的环境进行开发和部署,具有较高的灵活性和可扩展性。

VibeThinker-1.5B的核心优势

- 高性能推理能力:在数学和代码任务上展现出卓越的推理性能,能高效处理复杂问题,超越了部分更大参数量的模型。

- 低成本训练与优化:采用创新的“谱-信号原则”训练框架,有效降低训练成本,后期训练费用仅为7800美元,显著低于行业平均水平。

- 开源与免费使用:遵循MIT开源协议,免费提供给研究人员和开发者,支持商业用途,极大地降低了使用门槛和成本。

- 多平台支持与易用性:模型在Hugging Face、GitHub和ModelScope等多个平台上线,方便用户快速部署和使用,具有良好的兼容性和易用性。

- 高效训练框架:通过监督微调和强化学习相结合的方式,优化模型性能,使小模型也能实现高效推理,提升了模型的实用性和灵活性。

VibeThinker-1.5B官网是什么

- GitHub仓库:https://github.com/WeiboAI/VibeThinker

- Hugging Face模型库:https://huggingface.co/WeiboAI/VibeThinker-1.5B

- arXiv技术论文:https://arxiv.org/pdf/2511.06221

VibeThinker-1.5B的适用人群

- 人工智能研究人员:可以利用其开源代码和模型架构进行学术研究,探索语言模型的优化和创新。

- 开发者和工程师:适用于需要高效推理和代码生成的应用开发,能快速集成到项目中,提升开发效率。

- 数据科学家:可用于数据分析和处理任务,借助其强大的数学推理能力,优化数据处理流程。

- 教育工作者和学生:为机器学习和人工智能的教学提供实用工具,帮助学生更好地理解和实践相关技术。

- 企业用户:适合需要低成本、高性能AI解决方案的企业,可用于商业应用开发,推动业务智能化转型。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...