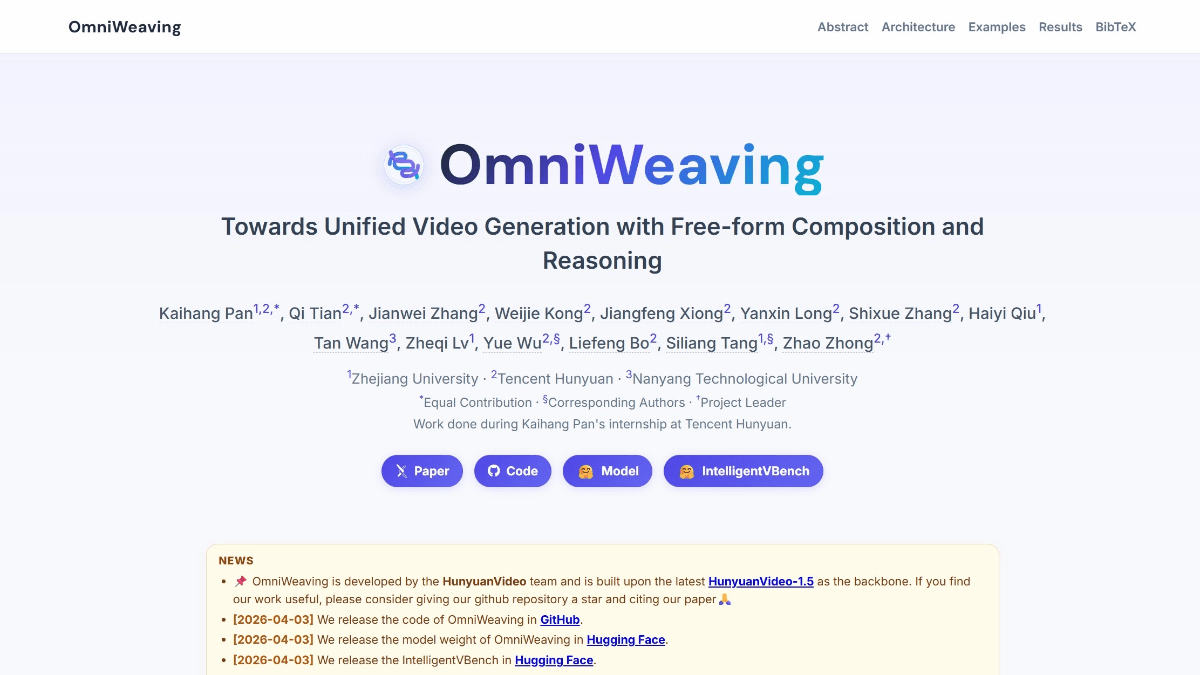

OmniWeaving是什么

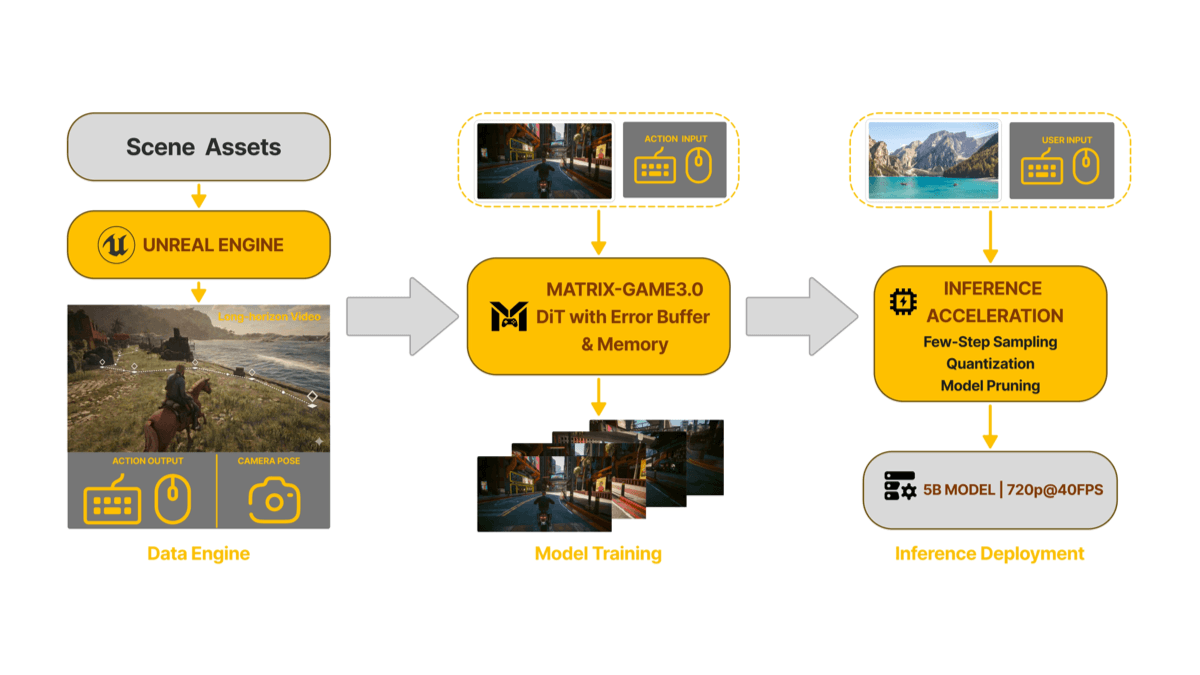

OmniWeaving是浙江大学、腾讯混元与南洋理工大学联合发布的开源统一视频生成模型,模型采用MLLM(Qwen2.5-VL)+ MMDiT + VAE三层架构,通过激活多模态大模型的"思考模式"进行推理增强,能理解自由形式的交错文本、图像与视频输入,自主推断复杂用户意图并生成语义精确的增强提示词。OmniWeaving支持文本/图像生成视频、视频编辑、多模态组合生成等多种任务,在开源统一视频生成领域达到SOTA性能。

OmniWeaving的功能特点

- 多模态统一理解与生成 :支持自由形式的交错输入(文本、多图像、视频),可统一处理各种模态组合,实现"任意模态→视频"的无缝转换,无需为不同任务切换独立模型。

- 推理感知的智能生成 :激活MLLM"思考模式",通过生成中间推理步骤主动推断复杂用户意图,将抽象模糊的需求转化为语义精确的增强提示词,弥合用户意图与像素级生成之间的鸿沟。

- 全链路视频创作能力 :覆盖从0到1的创作全流程:文本生成视频(T2V)、图像生成视频(I2V)、关键帧插值、多图像生成连续视频,支持事件演绎等复杂叙事场景。

- 智能视频编辑 :支持指令引导的视频到视频编辑(V2V),可执行全局风格转换、局部区域修改、物体增删替换等精细操作,实现"所想即所得"的可视化编辑。

- 深度语义注入技术 :采用Hidden States DeepStacking技术,从MLLM多层提取隐藏状态,捕获从细粒度细节到高层抽象的语义频谱,通过MLP连接器注入生成网络,优化复杂组合场景的表现。

- 开源SOTA性能 :在开源统一视频生成模型中达到最先进性能,VBench、OpenVE-Bench等基准测试显示其与专用模型(如HunyuanVideo)性能相当,有效缩小与Seedance-2.0等闭源商业方案的差距。

OmniWeaving的核心优势

- 统一的架构设计 :采用 MLLM(多模态大语言模型)+ MMDiT(多模态扩散Transformer)+ VAE 三层架构,一套模型统一支持文本生成视频、图像生成视频、视频编辑、多模态组合生成等多种任务,无需针对不同场景切换独立模型。

- 推理感知生成能力 :创新性地激活 MLLM 的"思考模式",从被动特征提取器升级为主动推理器。通过生成中间推理步骤,模型能自主推断复杂、模糊的用户意图,将抽象需求转化为语义精确的增强提示词,弥合意图理解与像素级生成之间的认知鸿沟。

- 深度语义融合技术 :引入 Hidden States DeepStacking 机制,从 MLLM 第8、16、24层等多层提取隐藏状态,捕获从细粒度细节到高层抽象的完整语义频谱,通过 MLP 连接器注入生成网络,显著提升复杂组合场景的生成质量。

- 开源领域 SOTA 性能 :在开源统一视频生成模型中达到最先进(SOTA)水平,在 VBench(T2V)和 OpenVE-Bench(V2V)基准上与专用模型(如 HunyuanVideo)性能相当,有效缩小了与 Seedance-2.0 等闭源商业系统的能力差距。

- 自由形式多模态输入 :突破传统模型对单一模态的依赖,支持文本、多图像、视频的任意交错组合输入,能处理"文本+多图像+视频"的复杂混合场景,实现真正意义上的多模态智能创作。

- 全链路创作与编辑 :覆盖从0到1的视频生成(T2V/I2V/关键帧生成)和从1到N的智能编辑(全局/局部修改、物体增删替换),满足从创意构思到后期调优的完整工作流需求。

OmniWeaving官网是什么

- 项目官网:https://omniweaving.github.io/

- GitHub仓库:https://github.com/Tencent-Hunyuan/OmniWeaving

- HuggingFace模型库:https://huggingface.co/tencent/HY-OmniWeaving

- arXiv技术论文:https://arxiv.org/pdf/2603.24458

使用OmniWeaving的操作步骤

- 环境准备 :克隆GitHub仓库并进入项目目录,准备Python环境(建议3.10+)。

- 安装依赖 :安装基础依赖包,可选安装Flash Attention、Flex-Block-Attention或SageAttention以加速推理并降低显存占用。

- 下载模型 :从HuggingFace下载OmniWeaving模型权重文件至本地指定目录。

- 执行推理 :通过命令行或脚本输入多模态数据(文本/图像/视频任意组合)进行视频生成,支持T2V、I2V、视频编辑、关键帧插值等多种任务模式。

- 启动交互界面(可选) :运行Gradio Demo启动可视化Web界面,通过浏览器上传素材、输入提示词并调整参数进行交互式创作。

OmniWeaving的适用人群

- 视频内容创作者与短视频博主 :支持从文本、图片快速生成视频素材,降低拍摄和后期制作成本,适合短视频、社交媒体内容的高效产出。

- 广告与营销从业者 :可通过产品图片配合文案生成动态广告视频,或用视频编辑功能快速调整创意素材,加速广告原型迭代。

- 游戏与动画开发者 :支持关键帧插值和事件演绎多图生成视频,可用于制作游戏过场动画、角色动作演示及概念预览。

- 教育与培训机构教师 :用文本生成教学演示视频,或基于教材图片生成动态讲解内容,提升教学素材的可视化效果和吸引力。

- 设计师与视觉创意工作者 :用于视觉概念快速验证、设计原型动态展示,支持多模态组合输入实现复杂创意场景的自由表达。

- 影视后期与剪辑师 :提供视频编辑、局部修改、物体增删替换等功能,辅助完成补帧、风格转换、素材修复等后期工作。

OmniWeaving的常见问题FAQ

Q:运行OmniWeaving需要什么配置?

A:建议使用NVIDIA GPU,显存至少需要16GB以上(推荐24GB+)。模型基于HunyuanVideo-1.5骨干网络,生成高分辨率长视频对显存要求较高。安装Flash Attention或SageAttention可有效降低显存占用。

Q:支持哪些推理加速方案?

A:支持Flash Attention 2、Flex-Block-Attention(稀疏注意力)和SageAttention三种加速方案,可显著减少推理时间和显存消耗,但需单独安装对应依赖。

Q:支持哪些输入组合?

A:支持自由形式交错输入:纯文本(T2V)、单图+文本(I2V)、多图(1-4张)+文本(组合生成)、视频+文本(V2V编辑)、视频+图像+文本(混合编辑)。

Q:"推理增强模式"如何使用?

A:输入图片和模糊意图描述(如"女子准备出门"),模型会自动生成<think>,理解场景逻辑后生成视频,适合复杂叙事场景。

Q:OmniWeaving与HunyuanVideo有什么区别?

A:OmniWeaving基于HunyuanVideo-1.5骨干网络,但增加了MLLM语义解析器和推理增强能力,是统一多任务模型,而HunyuanVideo主要专注单一文本生成视频任务。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...