联发科创新基地 (MediaTek Research) 近期宣布,正式开源两款针对繁体中文优化的多模态模型:Llama-Breeze2-3B 与 Llama-Breeze2-8B。这两款模型分别针对手机与个人电脑等不同运算平台设计,更具备函数调用能力,可灵活调用外部工具,拓展应用场景。不仅如此,联发科还以 Llama-Breeze2-3B 为基础,同步开源了一款 Android 应用程序,以及能生成自然台湾口音的语音合成模型 BreezyVoice,展现其在终端 AI 技术上的全面布局。

繁中多模态模型 Llama-Breeze2 系列:手机、PC 皆可高效运行

联发科创新基地此次开源的 Llama-Breeze2 系列繁体中文多模态基础模型,包含能在移动设备上轻巧运行的 Llama-Breeze2-3B,以及在个人电脑上提供更强大性能的 Llama-Breeze2-8B 轻量级版本。据联发科介绍,这一系列模型不仅精通繁体中文,更整合了多模态与函数调用等先进功能,使其能够理解图像信息,并能调用外部工具执行复杂任务。

为了进一步推动手机 AI 应用发展,联发科更以 Llama-Breeze2-3B 模型为核心,开发并开源了一款 Android 应用程序。这款应用程序旨在强化手机 AI 助手的各项能力,例如图像内容识别、外部工具调用等。与此同时,联发科也同步 释出 能够合成地道台湾口音的语音合成模型 BreezyVoice。上述三款模型与应用程序的开源内容,皆包含模型权重与部分执行代码,方便开发者进行研究与应用。

Llama-Breeze2 模型技术解析:基于 Llama 3 优化,兼具繁中、视觉与工具调用能力

深入分析 Llama-Breeze2 模型,其核心技术是基于 Meta 开源的 Llama 3 大语言模型进行优化。联发科进一步利用繁体中文语料库,强化了模型对繁体中文的理解能力,并整合了视觉语言模型以及函数调用 (Function Calling) 功能,赋予 Llama-Breeze2 系列模型三大特色:繁体中文优化、图像理解能力以及外部工具调用能力。

在繁体中文能力方面,联发科提供的对比结果显示,相较于同等参数规模的 Llama 3 3B Instruct 模型,Llama-Breeze2-3B 在生成的台湾夜市短文中,能准确列出知名夜市,例如士林夜市、饶河夜市和罗东夜市;而 Llama 3 3B Instruct 模型仅正确识别出士林夜市,却生成了两个虚构的夜市——电信夜市和世贸夜市。 这一结果突显了 Llama-Breeze2 系列模型在繁体中文理解上的优势。

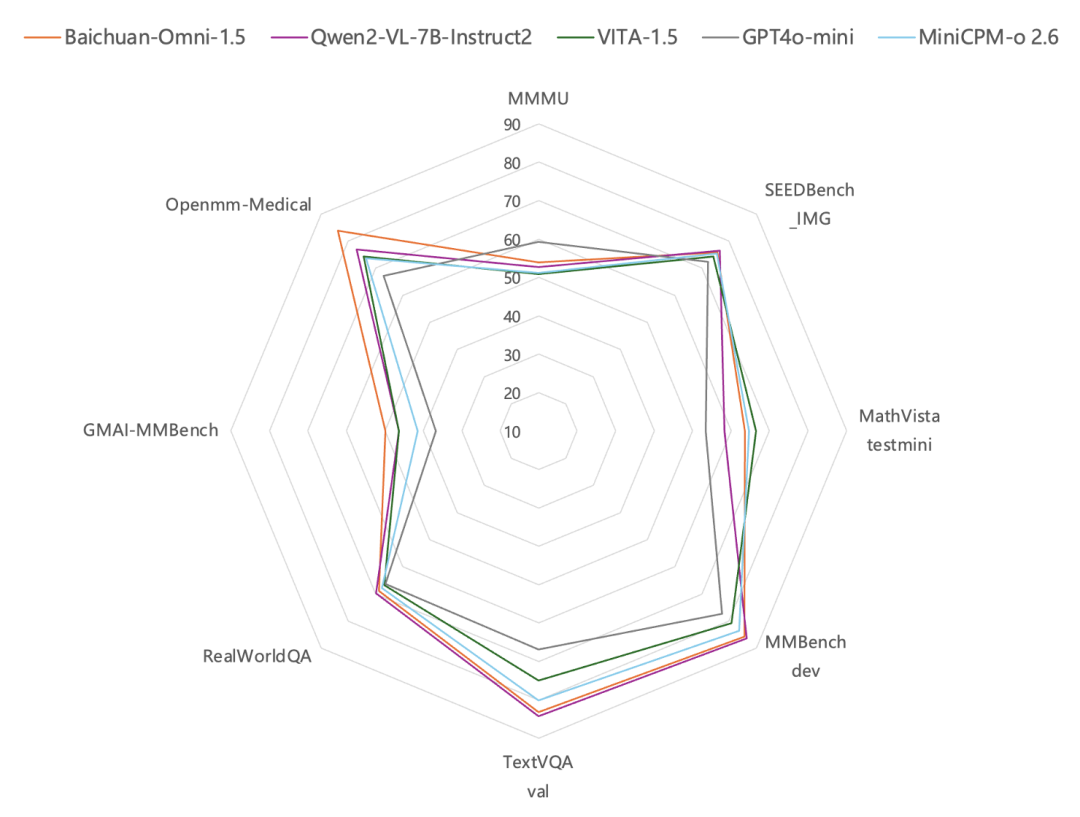

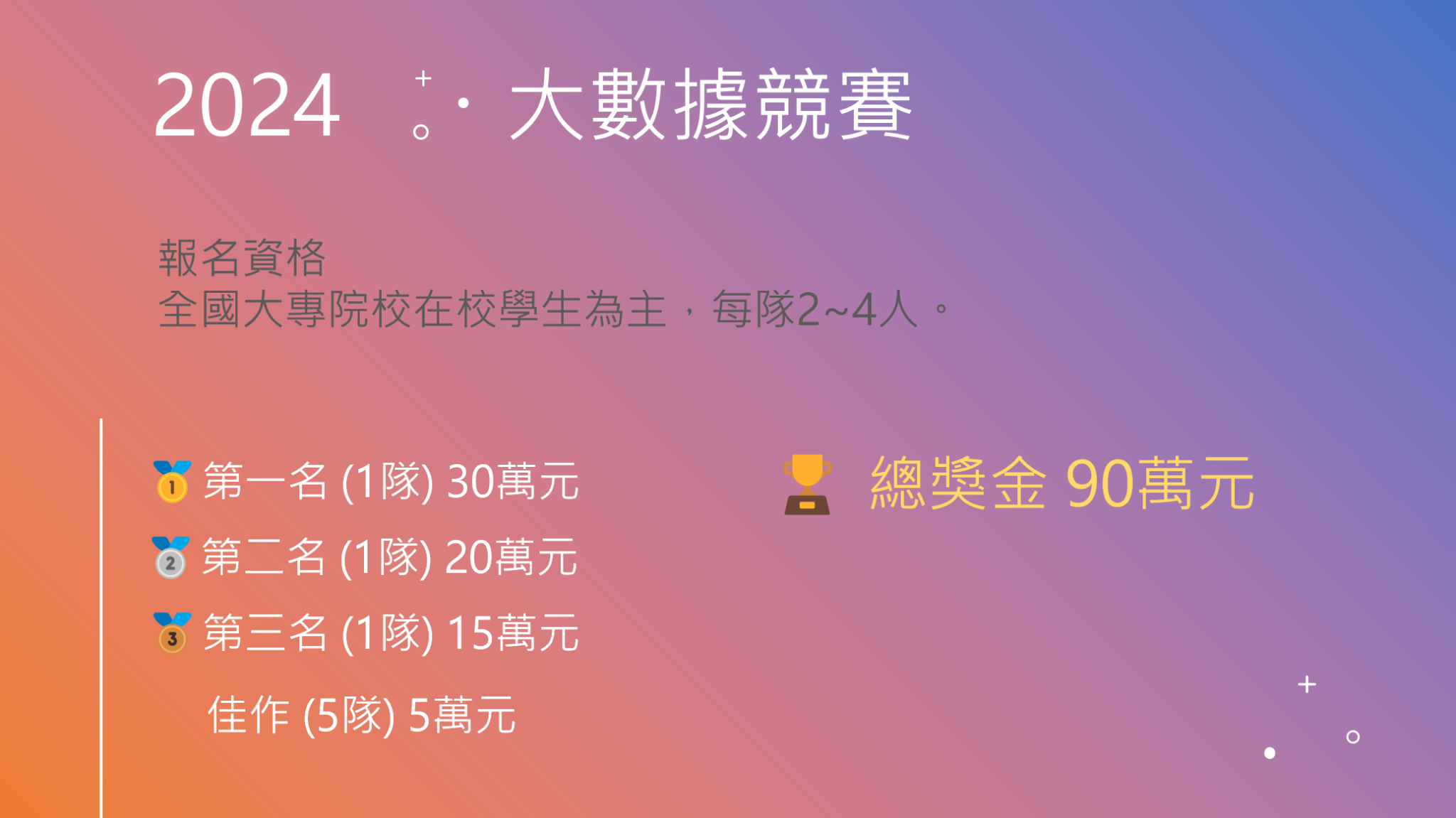

在多模态能力方面,Llama-Breeze2-3B 不仅能处理文字信息,更能有效分析图像内容,例如图表、光学字符识别 (OCR) 结果或景点照片等。模型都能够理解图像含义并做出 відповідь。 举例来说,在以下情境中:

用户提问: 请问前三名总共可获得多少奖金?

Llama-Breeze2-8B 回答: 根据图片信息,第一名的奖金为 30 万元,第二名为 20 万元,第三名为 15 万元。将这些数字加总,前三名奖金总额为 65 万元。

此外,Llama-Breeze2 系列模型具备函数调用功能,使其能够调用外部工具以完成更为复杂的任务。例如,当用户询问天气情况时,模型便可调用天气应用程序的 API 接口,即时获取最新天气信息,再将结果回复给用户,提供更智能化的互动体验。

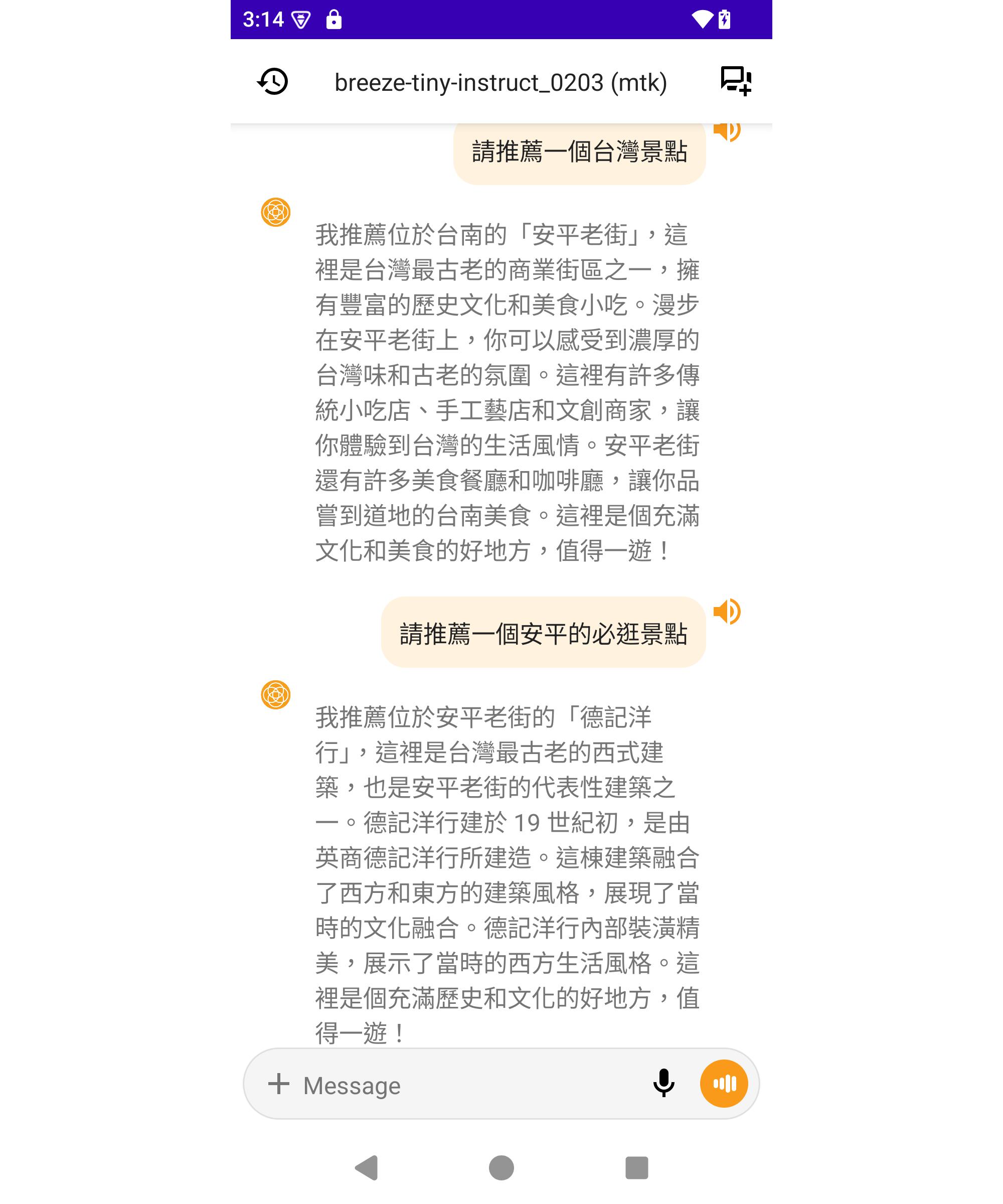

Android App 示例:Llama-Breeze2-3B 驱动手机 AI 应用

除了开源两款多模态语言模型外,联发科创新基地更进一步开源了一款可直接部署于手机端的 Android 应用程序。这款 App 以 Llama-Breeze2-3B 模型为基础,可作为个人 AI 助手,协助用户处理实时翻译、景点推荐等多项任务——如下图所示。更值得一提的是,该应用程序还具备语音生成功能,用户只需输入文字,模型即可生成自然流畅的语音回复,应用于智能导航等多元场景。

BreezyVoice 语音合成模型:五秒音频样本,生成地道台湾口音

本次开源计划中,联发科创新基地还同步推出了语音合成模型 BreezyVoice。这款模型特别针对繁体中文语音进行强化训练,采用轻量化架构设计,仅需输入 5 秒的示例音频,即可快速生成逼真度极高的语音。BreezyVoice 可作为 AI 助手的语音输出方案,提供更自然的互动体验。联发科指出,BreezyVoice 现已能在笔记本电脑上流畅运行,也能与任何大语言模型 (LLM) 或语音转文字系统结合,拓展更多应用可能性。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...