综合介绍

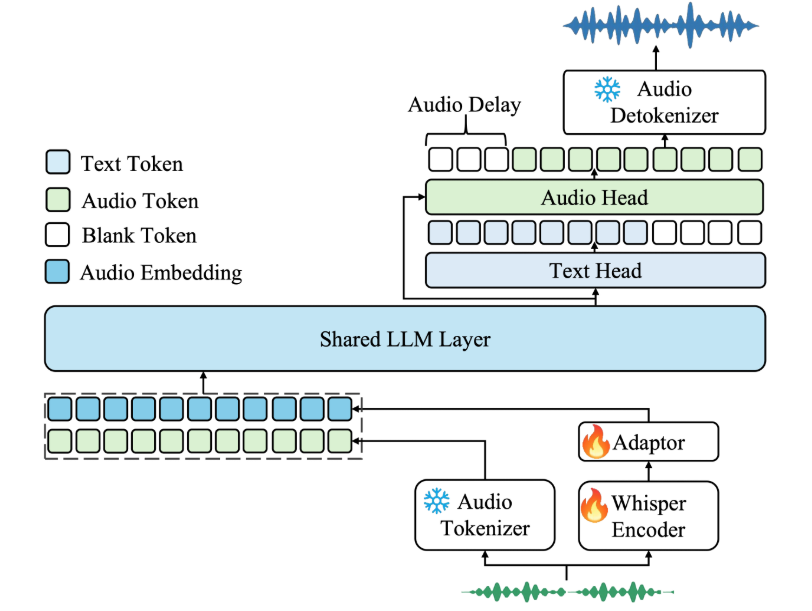

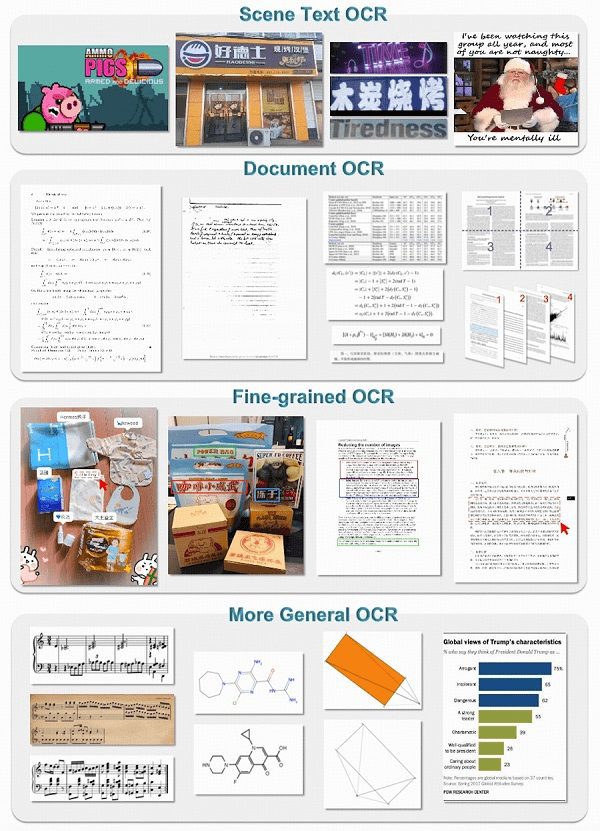

GOT-OCR2.0是一个阶跃星辰联合推出de 开源光学字符识别(OCR)模型,旨在通过一个统一的端到端模型推动OCR技术向OCR-2.0迈进。该模型支持多种OCR任务,包括普通文本识别、格式化文本识别、细粒度OCR、多裁剪OCR和多页OCR。GOT-OCR2.0的设计目标是提供一个通用且高效的解决方案,适用于各种复杂的OCR应用场景。

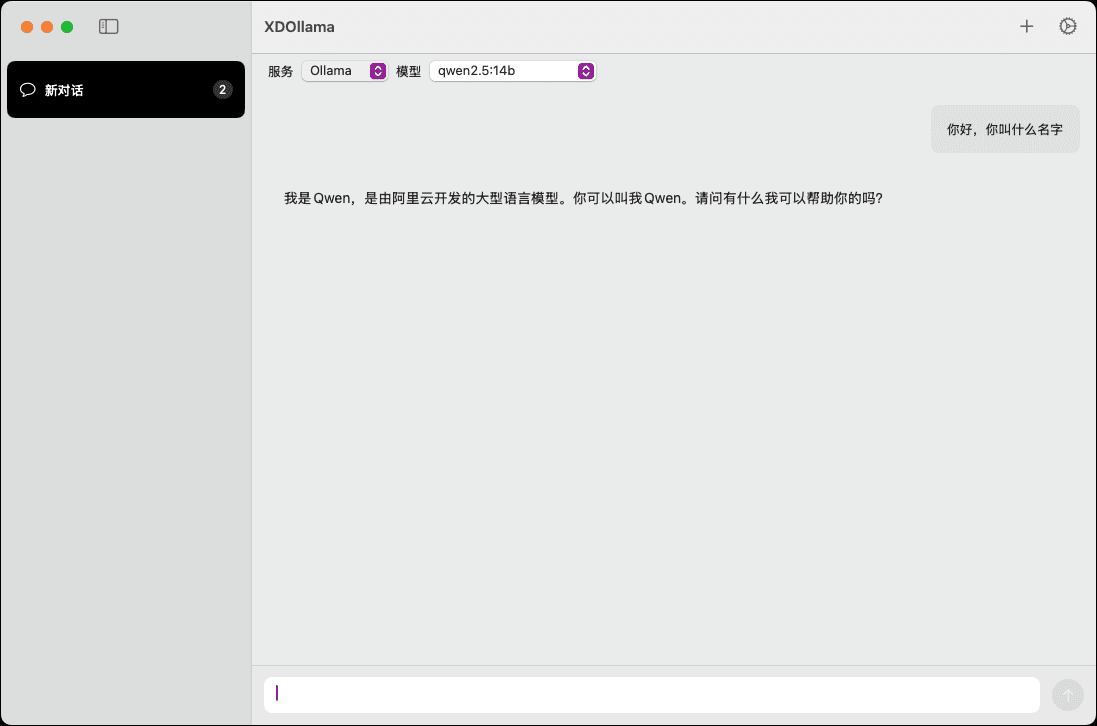

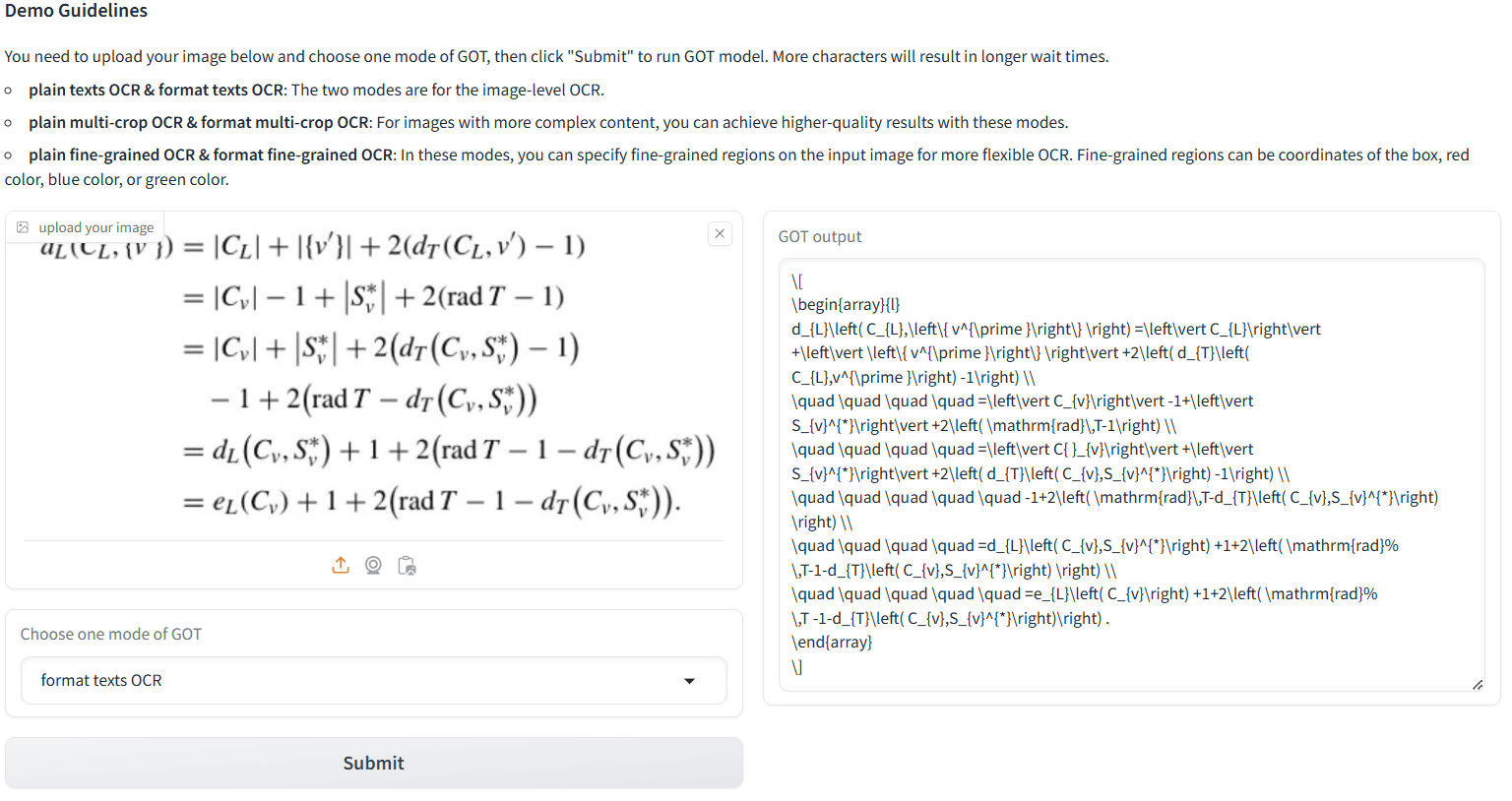

基于 QWen2 0.5 B 模型。号称 OCR 2.0,580M 参数的端到端 OCR 模型,拿到了 BLEU 0.972 分数。在线体验地址:https://huggingface.co/spaces/ucaslcl/GOT_online

功能列表

- 普通文本识别:识别图片中的普通文本内容。

- 格式化文本识别:识别并保留文本的格式信息,如表格、段落等。

- 细粒度OCR:识别图片中的细小文本和复杂背景下的文本。

- 多裁剪OCR:支持对图片进行多次裁剪并识别每个裁剪区域的文本。

- 多页OCR:支持对多页文档进行OCR处理。

使用帮助

安装流程

- 克隆项目代码:

git clone https://github.com/Ucas-HaoranWei/GOT-OCR2.0.git cd GOT-OCR2.0 - 创建并激活虚拟环境:

conda create -n got python=3.10 -y conda activate got - 安装项目依赖:

pip install -e . - 安装Flash-Attention:

pip install ninja pip install flash-attn --no-build-isolation

获取GOT模型权重

- Huggingface

- Google Drive

- 百度云(提取码:OCR2)

使用流程

- 准备输入数据:将需要进行OCR处理的图片或文档放置在指定的输入目录中。

- 运行OCR模型:

python3 GOT/demo/run_ocr_2.0.py --model-name /GOT_weights/ --image-file /an/image/file.png --type ocr - 查看输出结果:OCR处理后的文本将保存在指定的输出目录中,用户可以根据需要进行进一步处理。

功能操作详解

- 普通文本识别:将图片中的普通文本内容识别并输出为纯文本文件,适用于简单的文本提取任务。

- 格式化文本识别:在识别文本的同时保留其格式信息,如表格、段落等,适用于需要保留文档原始格式的场景。

- 细粒度OCR:针对复杂背景下的细小文本进行识别,适用于需要高精度文本提取的场景。

- 多裁剪OCR:对图片进行多次裁剪并识别每个裁剪区域的文本,适用于需要对图片进行多区域识别的场景。

- 多页OCR:支持对多页文档进行OCR处理,适用于处理长文档或多页PDF文件的场景。

通过上述步骤,用户可以轻松安装和使用GOT-OCR2.0模型进行各种OCR任务。该模型提供了丰富的功能模块,能够满足不同场景下的OCR需求。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...