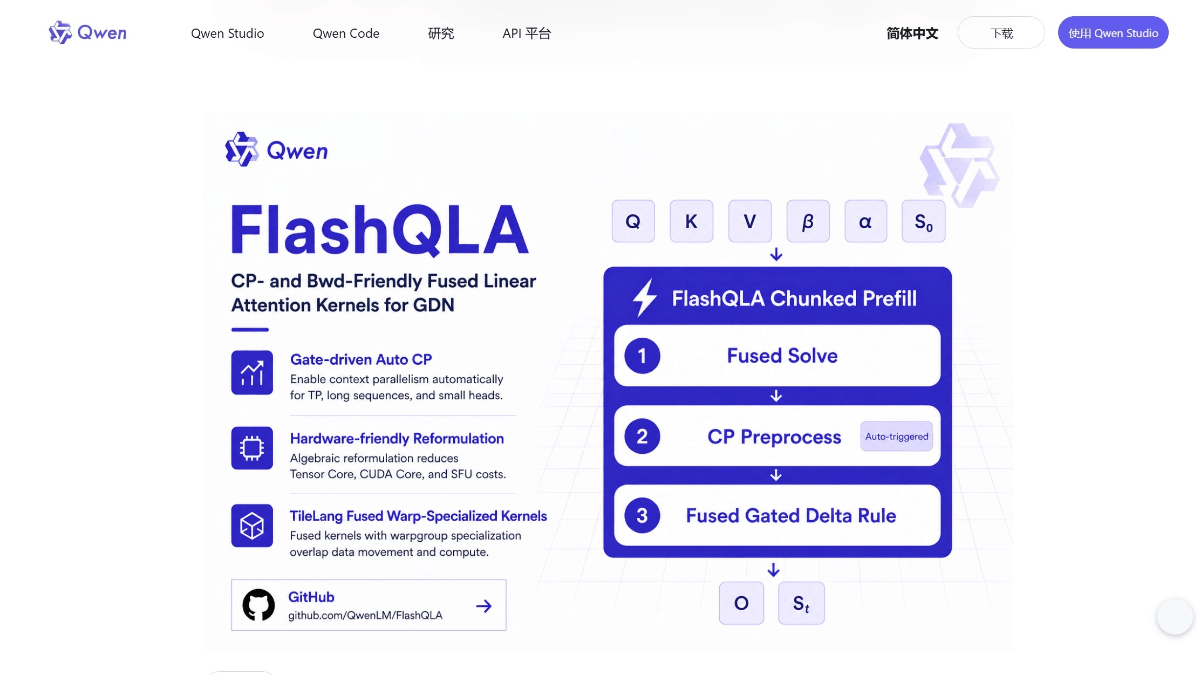

FlashQLA是什么

FlashQLA是通义千问(Qwen)团队开源的高性能线性注意力算子库,基于 TileLang 编译器框架构建,专为 Qwen 系列模型的 Gated Delta Network(GDN) 注意力层深度优化。通过算子融合、自动卡内序列并行与 Warp 组特化内核等技术,在 NVIDIA Hopper 架构 GPU 上实现前向 2–3 倍、反向 2 倍 的加速,覆盖从 2B 到 397B 全规格模型,显著降低大模型预训练与端侧 Agent 推理中注意力层的计算与访存开销。

FlashQLA的功能特色

- 高性能线性注意力计算:深度优化 GDN Chunked Prefill 的前向与反向流程,针对 Qwen3.5 / Qwen3.6 系列模型的 head 配置(h_v ∈ {64, 48, 32, 24, 16, 8})进行底层 kernel 调优,大幅降低计算延迟。

- Gate 驱动的自动卡内序列并行(AutoCP):利用 GDN 门控的指数衰减特性,在 Tensor 并行(TP)、长序列、小头数等场景下自动开启卡内序列并行,提升 GPU SM 利用率,无需手动配置。

- 算子融合加速:将多步计算合理融合为若干关键 fused kernel,减少 HBM 中间变量(W、U、S 等)的反复读写开销,缓解 memory-bound 瓶颈。

- 双层 API 接口:提供对齐 FLA 的高层 API(

chunk_gated_delta_rule)与底层前向/反向入口(chunk_gated_delta_rule_fwd/bwd),兼顾易用性与灵活性。 - 变长序列支持:内置

cu_seqlens参数,原生适配真实数据分布中的变长输入场景。 - 全规格模型覆盖:支持 2B 至 397B 参数规模的 Qwen 模型,适配 TP1 至 TP8 的分布式训练与推理部署。

FlashQLA的核心优势

- 硬件友好的代数改写:对 GDN Chunked Prefill 的数学流程进行等价改写,在不牺牲数值精度的前提下,有效降低 Tensor Core、CUDA Core 及 SFU(特殊函数单元)的计算开销。

- Warp 组特化内核设计:基于 TileLang 构建生产者-消费者 Warp 组协同机制,利用共享内存与 mbarrier 同步,实现数据搬运、Tensor Core 计算与 CUDA Core 计算的重叠隐藏,逼近硬件理论峰值。

- 滑动窗口 Warmup 机制:利用 GDN 门控的指数衰减特性,仅需 6–8 个 chunk 的 warmup 即可获取精确子序列初始状态,省去修正 M 矩阵的计算,进一步压缩预处理耗时。

- 条件式自动并行:通过数学模型自动决策并行度,仅在

batch_size × num_heads满足特定阈值时触发 AutoCP,平衡并行效率与访存代价,避免大 batch 场景下引入无效通信。

FlashQLA官网是什么

- 项目官网:https://qwen.ai/blog?id=flashqla

- GitHub仓库:https://github.com/QwenLM/FlashQLA

使用FlashQLA的操作步骤

- 环境准备:确认硬件为 NVIDIA Hopper 架构 GPU(H100/H200/H20,SM90+),系统已安装 CUDA 12.8 或更高版本,以及 PyTorch 2.8 或更高版本。

- 安装 FlashQLA:从 GitHub 仓库克隆源码后执行编译安装,通常通过

git clone https://github.com/QwenLM/FlashQLA.git进入目录后运行pip install -e .或对应 CUDA 扩展编译命令完成部署。 - 高层 API 快速调用:在模型代码中直接导入

chunk_gated_delta_rule,将原本基于 FLA(Flash Linear Attention)的 GDN Chunked Prefill 调用替换为 FlashQLA 提供的对齐接口,保持输入输出张量规格一致即可无痛加速。 - 底层 API 精细接入:如需自定义训练流程或反向传播逻辑,可显式调用

chunk_gated_delta_rule_fwd与chunk_gated_delta_rule_bwd,分别控制前向计算与梯度回传,灵活嵌入自定义模型架构中。 - 变长序列适配:在输入侧传入

cu_seqlens参数,将真实数据中的变长序列长度信息提供给 FlashQLA,使其在内部自动处理不同长度的序列分段与状态管理。 - 自动并行配置:无需手动调整,FlashQLA 会根据当前

batch_size × num_heads规模以及 TP 配置,自动判断是否触发 Gate 驱动的卡内序列并行(AutoCP),在 Tensor 并行、长序列或小头数场景下自动提升 SM 利用率。 - 模型训练/推理替换:在 Qwen3.5 / Qwen3.6 系列模型的注意力层实现中,将标准 GDN 计算逻辑替换为 FlashQLA 算子,覆盖从 2B 到 397B 的全规格模型,随后按原有流程启动预训练或推理服务。

- 性能验证:运行前后对比测试,检查前向计算是否达到 2–3 倍加速、反向计算是否达到约 2 倍加速,并确认数值精度与原始实现一致。

FlashQLA的适用人群

- 大模型预训练工程师:需要为 Qwen3.5/3.6 系列(2B–397B)进行 256K 长上下文预训练或全参数微调,希望降低注意力层端到端训练成本、缩短训练周期的团队。

- 大模型推理部署工程师:负责线上高并发服务部署,使用 Tensor 并行(TP)处理长序列输入,需要解决 chunked prefill 阶段 GPU 利用率低、吞吐瓶颈明显的生产环境运维人员。

- 端侧 Agent / 小模型开发者:聚焦 batch_size=1 的实时交互场景(如 Coding Agent、对话机器人),基于 0.8B–2B 小模型在端侧或边缘 GPU 上追求低延迟响应的 AI 应用开发者。

- 线性注意力架构研究者:从事 Gated Delta Network(GDN)或其他线性注意力(Subquadratic Attention)架构的算法研究,需要开箱即用的高性能算子以替代标准实现、加速实验迭代的科研人员。

- 底层 CUDA / Kernel 优化工程师:关注 TileLang 编译器、Warp 组特化内核、自动卡内序列并行(AutoCP)等前沿优化技术,希望参考或复用 FlashQLA 技术方案进行硬件亲和性算子开发的系统优化专家。

- Qwen 生态集成开发者:已在业务中深度接入 Qwen 系列模型,需要将现有基于 FLA(Flash Linear Attention)的 GDN 实现无缝迁移至 FlashQLA 以获得 2–3 倍加速,且对数值精度与接口兼容性有严格要求的工程团队。

FlashQLA的常见问题

Q:FlashQLA 支持哪些 GPU?A100 或 RTX 4090 能用吗?

A:不支持。FlashQLA 针对 NVIDIA Hopper 架构(SM90+)深度优化,仅适用于 H100、H200、H20 等型号。Ampere 架构(A100、A800、RTX 4090/3090 等)及更早版本无法直接受益,因其依赖 Hopper 特有的 Tensor Core 与线程组协作指令。

Q:对 CUDA 和 PyTorch 版本有什么硬性要求?

A:需要 CUDA 12.8 或更高版本,以及 PyTorch 2.8 或更高版本。低于此版本可能因编译器特性或 API 差异导致安装失败或性能不达标。

Q:FlashQLA 只能用于 Qwen 模型吗?其他线性注意力架构(如 Mamba、xLSTM)能否使用?

A:FlashQLA 主要针对 Qwen 系列模型的 Gated Delta Network(GDN)注意力层进行优化,覆盖 2B 至 397B 全规格。对于标准 Softmax Attention、Mamba-2、xLSTM 等其他 subquadratic 架构,需要另行编写或适配算子,无法直接开箱即用。

Q:相比原始 FLA(Flash Linear Attention)实现,性能提升有多少?

A:在 Hopper GPU 上,前向计算(Chunked Prefill)可实现约 2–3 倍加速,反向传播(训练)可实现约 2 倍加速。具体提升幅度受 batch size、序列长度、head 数及 Tensor 并行度影响。

Q:安装时编译失败或报 CUDA 错误怎么办?

A:首先确认 GPU 为 Hopper 架构且驱动支持 CUDA 12.8+;其次检查 PyTorch 版本是否 ≥2.8,并确保 nvcc 与 PyTorch 使用的 CUDA 版本一致。若使用多卡环境,建议先单卡编译验证。如仍失败,可参考 GitHub Issues 排查 TileLang 依赖与符号链接问题。

Q:自动卡内序列并行(AutoCP)需要手动开启吗?

A:不需要。FlashQLA 内置基于 GDN 门控指数衰减特性的数学决策模型,会根据

batch_size × num_heads 规模及 TP 配置自动判断是否触发 AutoCP。仅在长序列、小头数或 Tensor 并行场景下满足阈值时才会启动,避免大 batch 场景引入无效通信。© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...