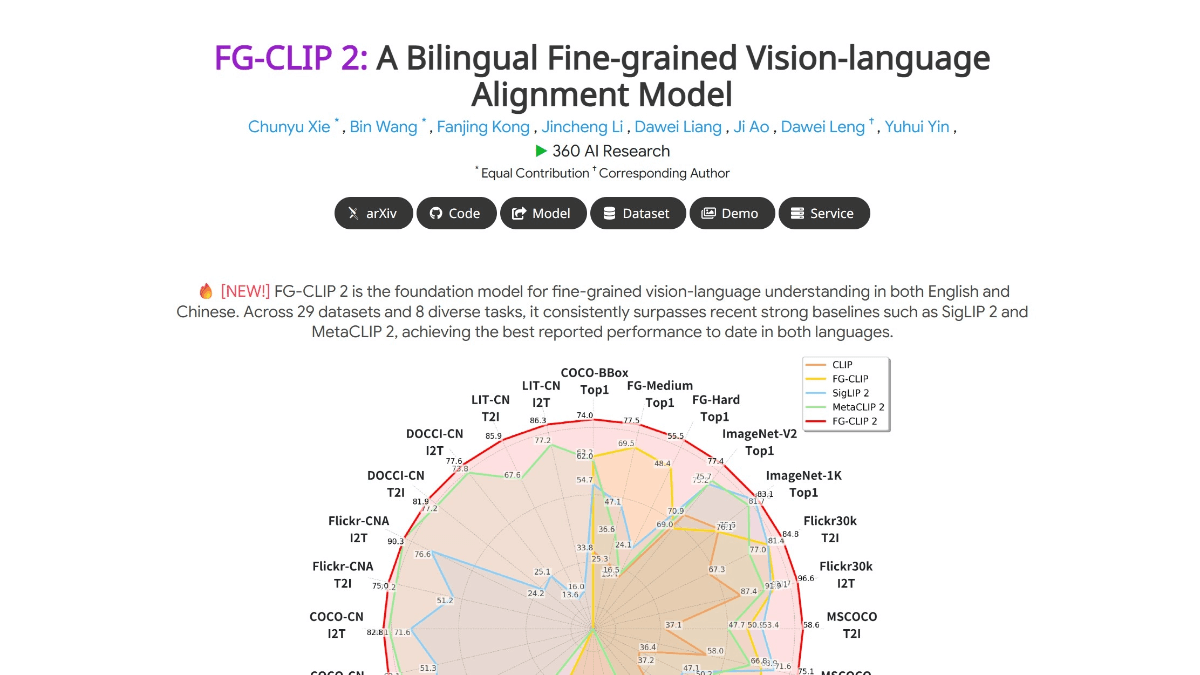

FG-CLIP 2是什么

FG-CLIP 2 是360人工智能研究院推出的全球领先的图文跨模态视觉语言模型(VL-M),在29项权威基准测试中超越Google和Meta的同类模型,成为目前性能最强的VL-M。能精准识别图像中的毛发、斑点、色彩、表情、空间关系等细节,例如区分不同品种的猫、判断物体在屏幕内外的位置,甚至理解复杂场景中的遮挡关系。同时支持中文和英文的细粒度理解,填补了中文跨模态模型的空白,可精准处理中文长文本检索、区域分类等任务。采用两阶段训练策略,先全局对齐图文语义,再聚焦局部细节对齐;结合五维协同优化体系,提升模型的抗干扰性和鲁棒性。

FG-CLIP 2的功能特色

- 双语支持:能同时处理中英文任务,实现真正的双语原生支持。

- 细粒度理解:精准识别图像中的细节,如物体的属性、空间关系等,提升视觉语言对齐的精度。

- 动态注意力:智能聚焦图像的关键区域,有效处理复杂的视觉场景。

- 层次化对齐:结合宏观场景和微观细节,逐步提升模型的理解能力。

- 优化双语协同:平衡中英文理解能力,提升双语任务的整体性能。

- 高并发响应:支持高并发场景下的快速响应,确保实时性和效率。

- 自适应输入:动态调整分辨率,适应不同尺寸的输入图像。

- 丰富的开源资源:提供完整的代码、模型权重和训练数据集,便于研究和开发。

FG-CLIP 2的核心优势

- 像素级细粒度理解:能精准识别图像中的毛发、斑点、色彩、表情、空间关系等细节,例如区分不同品种的猫、判断物体在屏幕内外的位置,甚至理解复杂场景中的遮挡关系。

- 中英文双语能力:支持中文和英文的细粒度理解,填补了中文跨模态模型的空白,可精准处理中文长文本检索、区域分类等任务。

- 创新训练方法:采用两阶段训练策略,先全局对齐图文语义,再聚焦局部细节对齐;结合五维协同优化体系,提升模型的抗干扰性和鲁棒性。

- 高质量数据集:基于自研的FineHard数据集,包含数十亿对中英文图文样本,以及千万级局部区域标注和难负样本,确保模型对细节的精准捕捉。

- 动态注意力机制:智能聚焦图像的关键区域,提升模型对复杂视觉任务的处理能力。

- 层次化对齐架构:结合宏观场景和微观细节,逐步提升模型的理解能力,增强视觉与语言的对齐精度。

- 优化的双语协同策略:平衡中英文理解能力,解决双语任务中的性能不平衡问题。

- 高并发响应速度:采用显式双塔结构,支持高并发场景下的快速响应,确保实时性和效率。

- 自适应输入尺寸:动态分辨率机制让模型能自适应处理不同尺寸的输入,提升灵活性和适应性。

FG-CLIP 2官网是什么

- 项目官网:https://360cvgroup.github.io/FG-CLIP/

- Github仓库:https://github.com/360CVGroup/FG-CLIP

- arXiv技术论文:https://arxiv.org/pdf/2510.10921

FG-CLIP 2的适用人群

- 家庭机器人开发者:需要让机器人理解复杂的家庭环境指令,FG-CLIP 2的细粒度视觉语言理解能力能够显著提升机器人的交互体验。

- 安防系统工程师:在安防监控领域,FG-CLIP 2能快速准确地识别和定位目标,提高安防系统的效率和可靠性。

- 电商技术团队:FG-CLIP 2可以优化商品搜索和推荐功能,提升用户体验,降低多语言适配成本,适合电商平台的技术团队。

- 自动驾驶研发人员:在自动驾驶系统中,FG-CLIP 2能准确识别道路环境中的物体和场景,提升系统的安全性和可靠性。

- 医疗影像分析师:FG-CLIP 2可以辅助医生进行图像诊断,提高诊断的准确性和效率,适合医疗影像分析领域的专业人士。

- 教育技术开发者:在开发智能教育工具时,FG-CLIP 2能根据图片内容提供相关知识,丰富教学内容和形式。

- 内容创作团队:在图像编辑和视频制作中,FG-CLIP 2可以根据文本描述快速找到合适的素材,提高创作效率。

- 智能客服系统开发者:FG-CLIP 2能理解用户上传的图片内容,提供更精准的解答和建议,提升客服服务质量。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...