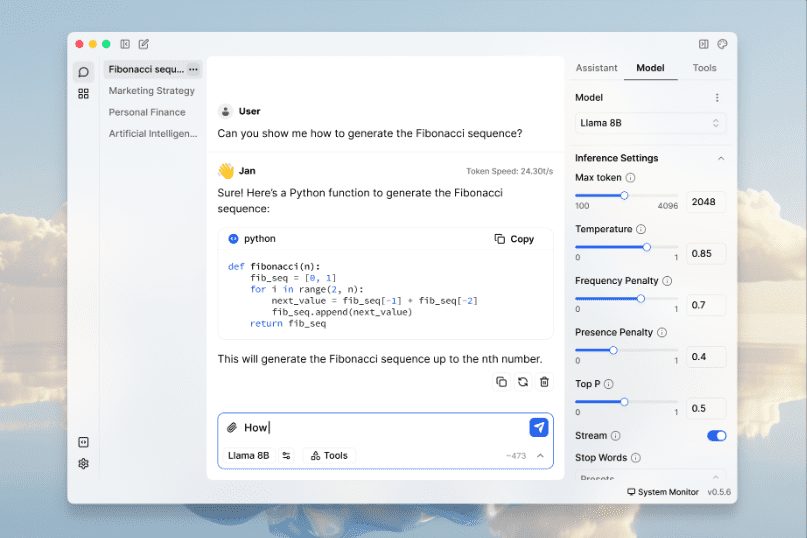

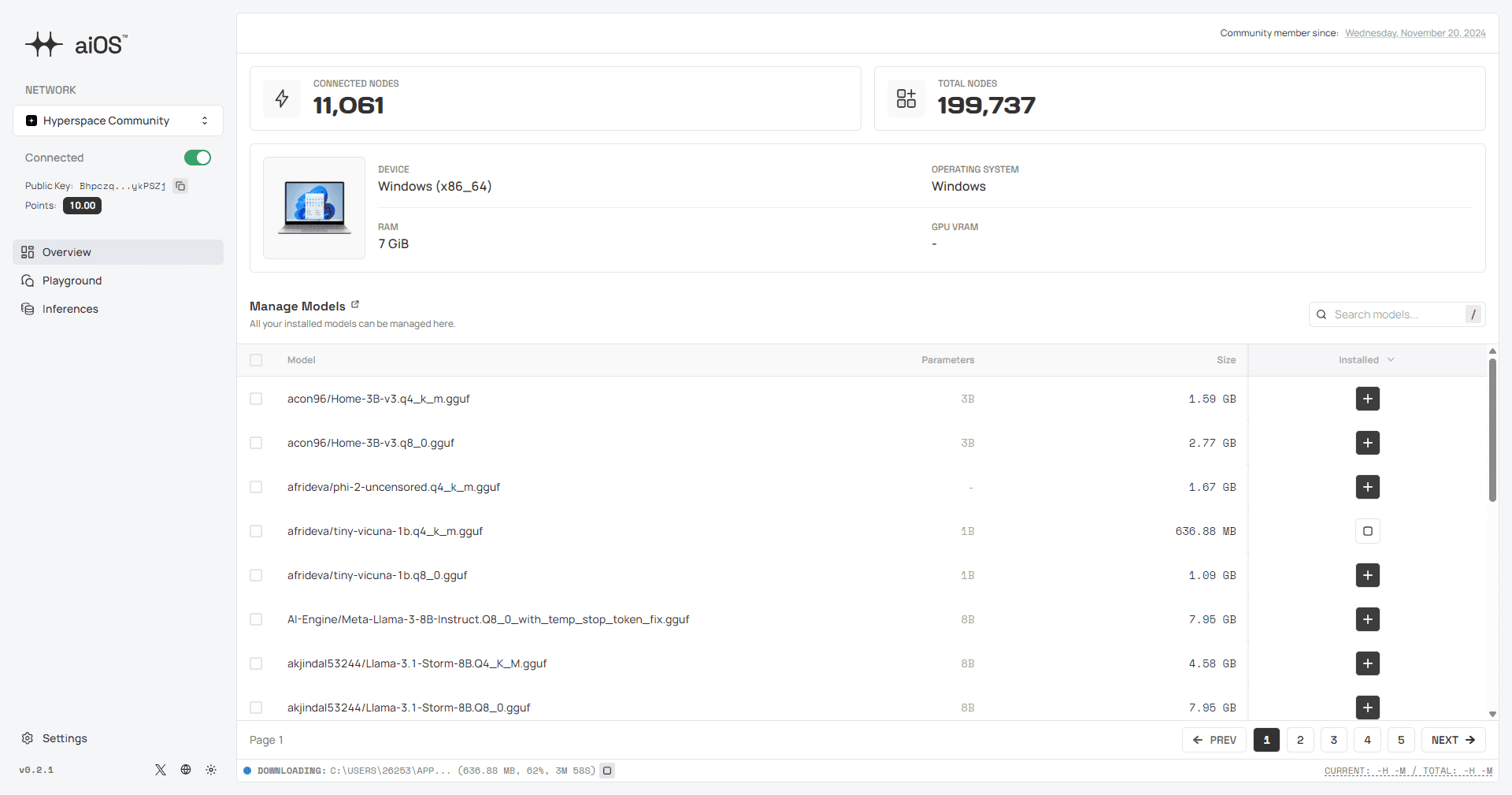

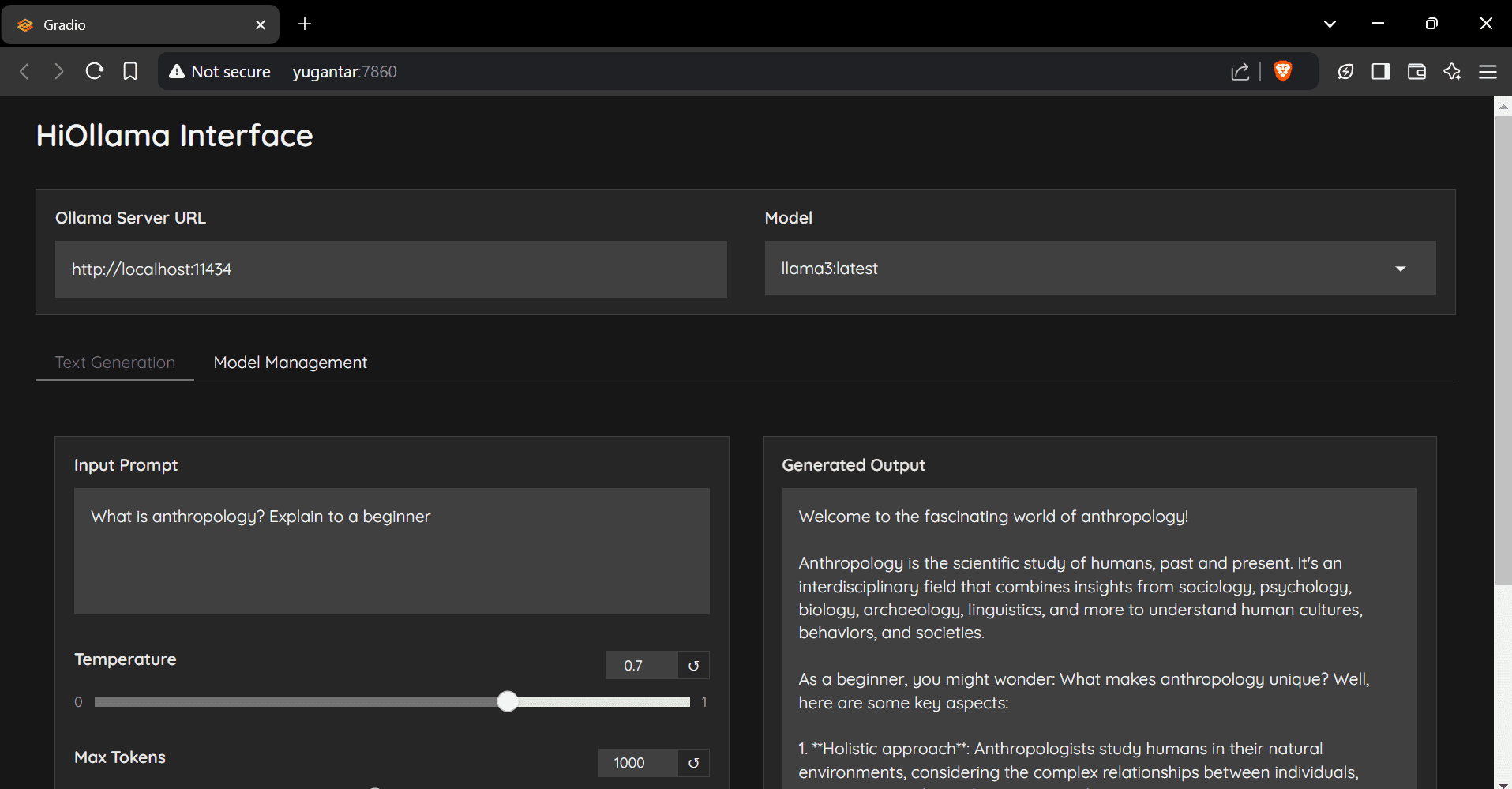

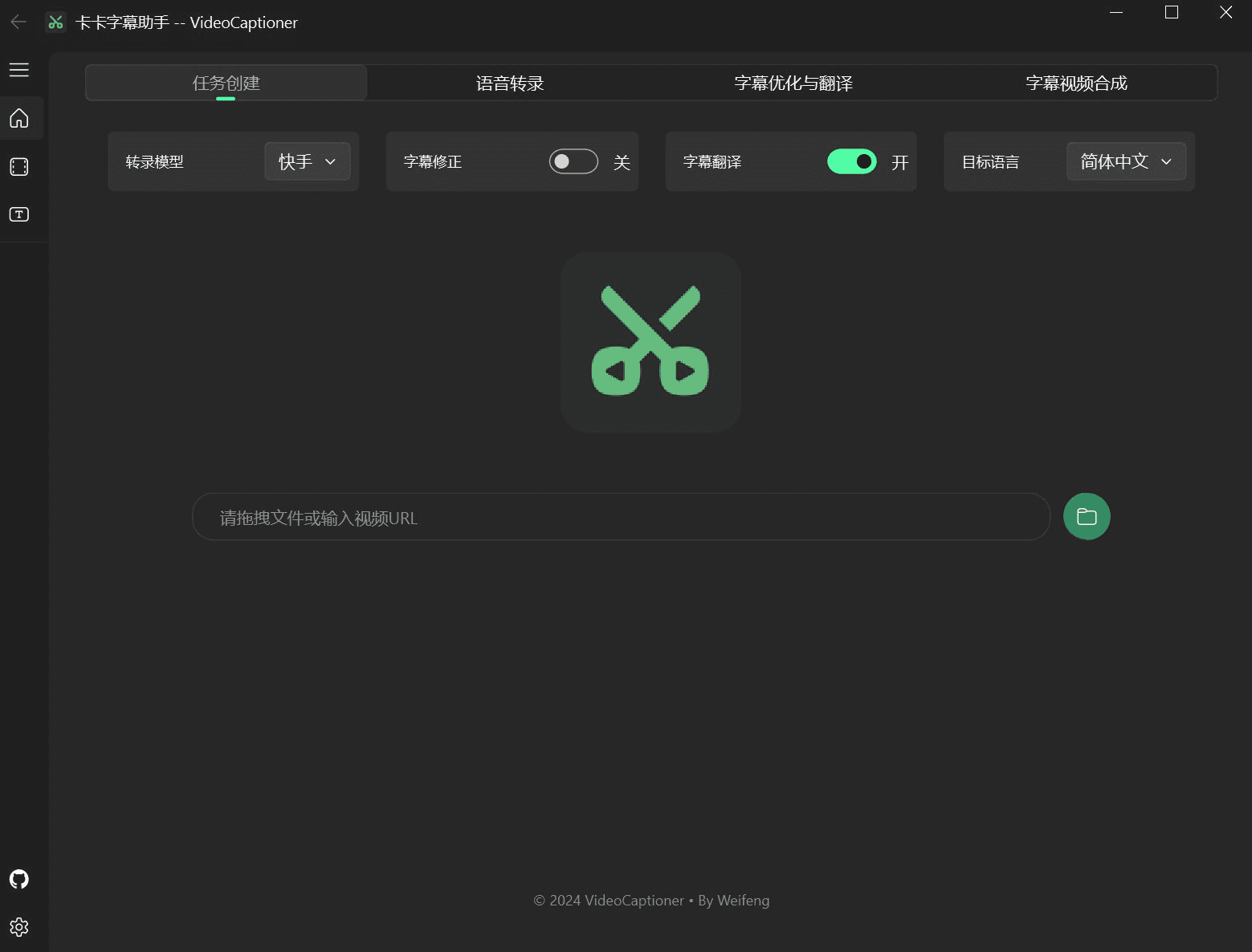

llama.cpp: herramienta de inferencia eficiente, compatible con varios equipos, fácil de implementar la inferencia LLM

Introducción general llama.cpp es una biblioteca implementada en C/C++ puro diseñada para simplificar el proceso de inferencia de los Modelos de Lenguaje Grande (LLM). Es compatible con una amplia gama de plataformas de hardware, incluyendo Apple Silicon, GPUs NVIDIA y GPUs AMD, y proporciona una variedad de cuant...