综合介绍

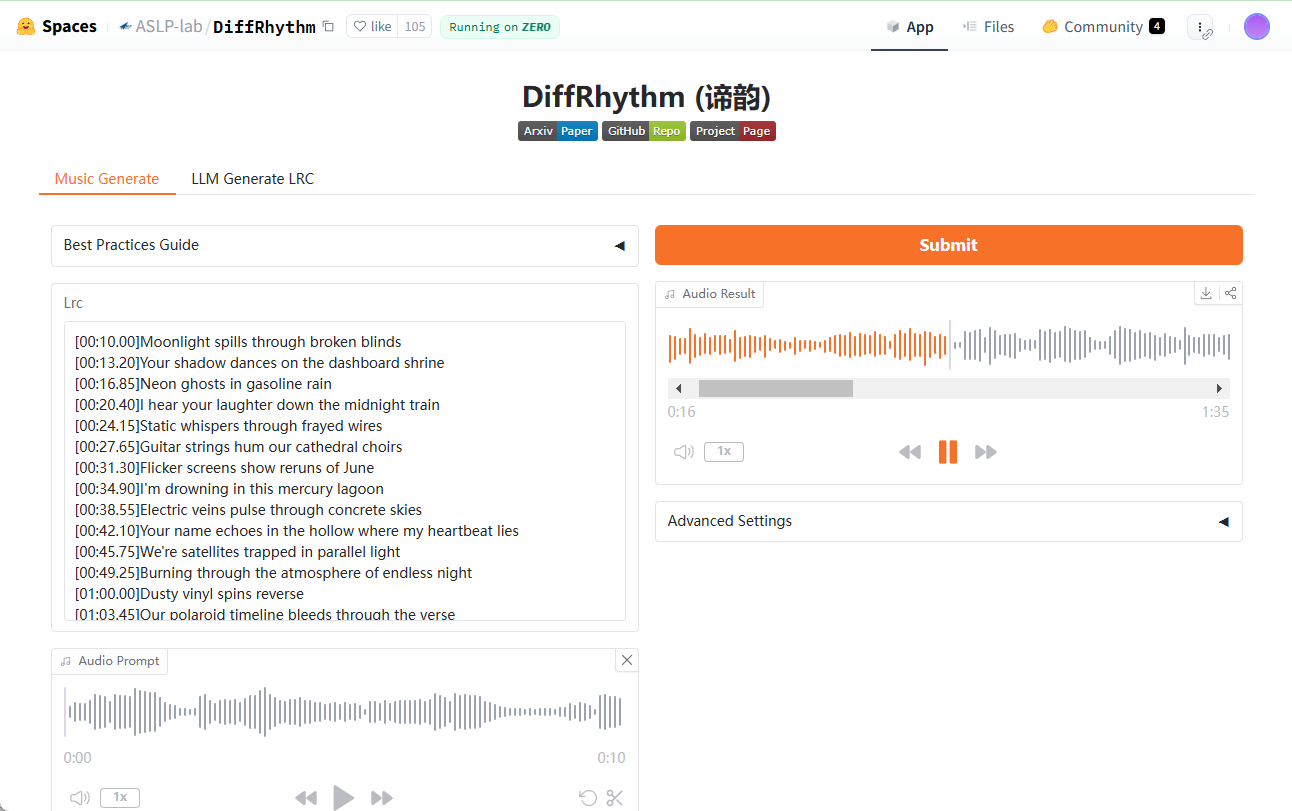

DiffRhythm 是由 ASLP-lab(西北工业大学音频、语音与语言处理小组)开发的一个开源项目,专注于通过人工智能技术实现端到端的音乐创作。它基于潜扩散模型(Latent Diffusion),能够在短短10秒内生成一首长达4分45秒的完整歌曲,包含人声和伴奏。这一工具不仅速度快,而且操作简单,只需提供歌词和风格提示即可生成高质量音乐作品。DiffRhythm 的目标是解决传统音乐生成模型复杂性高、生成时间长以及只能生成片段的痛点,适合音乐创作者、教育工作者和娱乐行业的用户使用。

封装ComfyUI工作流:Chttps://github.com/billwuhao/ComfyUI_DiffRhythm

体验地址:https://huggingface.co/spaces/ASLP-lab/DiffRhythm

功能列表

- 端到端歌曲生成: 输入歌词和风格提示,自动生成包含人声和伴奏的完整歌曲。

- 快速推理: 10秒内完成一首最长4分45秒的歌曲生成。

- 歌词与旋律同步: 确保生成的旋律与歌词音节和节奏自然匹配。

- 风格自定义: 支持多种音乐风格提示,生成符合用户需求的音乐。

- 开源支持: 提供源代码和模型,允许用户自定义和扩展功能。

- 高质量输出: 生成的音乐在音质和可听性上达到较高水准。

使用帮助

安装流程

DiffRhythm 是一个基于 GitHub 的开源项目,需要一定的编程基础来安装和运行。以下是详细的安装步骤:

- 环境准备

- 确保你的电脑已安装 Python 3.8 或以上版本。

- 安装 Git,用于从 GitHub 下载代码。

- 推荐使用虚拟环境(如

venv或conda)以避免依赖冲突。

- 下载项目代码

- 打开终端,输入以下命令克隆 DiffRhythm 仓库:

git clone https://github.com/ASLP-lab/DiffRhythm.git - 进入项目目录:

cd DiffRhythm

- 打开终端,输入以下命令克隆 DiffRhythm 仓库:

- 安装依赖

- 项目通常会提供

requirements.txt文件,列出所需的 Python 库。 - 在终端运行以下命令安装依赖:

pip install -r requirements.txt - 如果没有此文件,可参考 GitHub 页面或文档中的依赖说明,手动安装 PyTorch 等核心库。

- 项目通常会提供

- 下载预训练模型

- DiffRhythm 的预训练模型通常托管在 Hugging Face 或其他云存储平台。

- 访问 ASLP-lab/DiffRhythm-base 下载模型文件(如

cfm_model.pt)。 - 将下载的模型文件放入项目目录下的指定文件夹(通常在文档中有说明,如

models/)。

- 验证安装

- 在终端运行一个简单的测试命令(具体命令见 GitHub 的 README 文件),例如:

python main.py --test - 如果没有报错,说明安装成功。

- 在终端运行一个简单的测试命令(具体命令见 GitHub 的 README 文件),例如:

如何使用 DiffRhythm

DiffRhythm 的核心功能是通过输入歌词和风格提示生成歌曲。以下是详细操作流程:

1. 准备输入

- 歌词: 编写一段歌词(支持中文、英文等),保存为文本文件(如

lyrics.txt),或直接在命令行中输入。 - 风格提示: 准备一个简短的风格描述,例如“流行摇滚”、“古典钢琴”或“电子舞曲”。

2. 生成歌曲

- 打开终端,进入 DiffRhythm 项目目录。

- 运行生成命令(具体参数以官方文档为准,示例命令如下):

python generate.py --lyrics "lyrics.txt" --style "pop rock" --output "song.wav"

- 参数说明:

--lyrics: 指定歌词文件路径。--style: 输入音乐风格提示。--output: 指定输出音频文件路径和名称。

- 等待约10秒,程序会在指定路径生成一个 WAV 格式的音频文件。

3. 检查输出

- 生成完成后,找到

song.wav文件,使用任意音频播放器(如 Windows Media Player 或 VLC)播放。 - 检查歌词与旋律是否同步,音质是否符合预期。

特色功能操作详解

- 端到端歌曲生成: 无需分段处理,DiffRhythm 一次性生成完整歌曲。用户只需提供歌词和风格,无需额外调整参数即可获得成品。

- 快速推理: 得益于非自回归结构和潜扩散技术,生成速度极快。相比传统模型动辄几分钟的生成时间,DiffRhythm 的10秒生成极大提升效率。

- 歌词与旋律同步: 如果你发现生成的旋律与歌词不匹配,可以调整歌词的音节数,或在风格提示中加入“节奏清晰”等描述,优化输出效果。

- 风格自定义: 尝试不同风格提示,例如“爵士乐”、“民谣”或“嘻哈”,观察生成结果的变化。风格提示越具体,生成的音乐越贴近预期。

使用技巧

- 优化歌词: 短句歌词比长句更容易与旋律匹配,避免过于复杂的句式。

- 批量生成: 编写一个简单的脚本,循环调用

generate.py,可一次性生成多首歌曲。 - 调试输出: 如果生成结果不理想,检查日志文件(若有)或调整模型参数(如扩散步数),具体方法见 GitHub 文档。

注意事项

- 硬件要求: 生成过程需要较高的计算资源,推荐使用配备 GPU 的电脑以提升速度。

- 开源贡献: 如果你擅长编程,可以 fork 项目,优化代码或新增功能后提交 pull request。

- 版权提醒: 生成的音乐可能因风格相似性涉及版权风险,建议用于学习或非商业用途。

通过以上步骤,你可以快速上手 DiffRhythm,体验从歌词到完整歌曲的创作过程!

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...