科技领域的竞争总是暗流涌动。近日,中国 AI 创企 DeepSeek(深度求索)团队在未进行大规模宣传的情况下,低调地更新了其 V3 基座模型,新版本 DeepSeek-V3-0324 已悄然上线 Hugging Face 平台,供开发者下载和部署。尽管此次更新非常低调,但新模型在代码能力方面的显著提升,迅速引发了技术社区的高度关注和热烈讨论。

几个小时前,DeepSeek-AI 开源了 DeepSeekV3 的更新版本,版本号 0324,于 2025 年 3 月 24 日上传至 HuggingFace,并采用 MIT 协议开源。

模型配置信息显示,DeepSeekV3-0324 依然是 MoE 大模型,包含 256 个路由专家和 1 个共享专家,每个 token 使用 8 个专家进行推理。 DeepSeekV3-0324 通过 RoPE 可扩展至最高 163840 上下文长度 (160K)。 模型词汇表大小为 129280 个,并集成了 LoRA 机制,支持轻量级微调。

与 2024 年 12 月 26 日发布的 DeepSeekV3 相比,这些参数均未发生变化,这意味着此次更新大概率是原有模型持续训练或后训练的结果。

代码能力突飞猛进,直逼闭源标杆

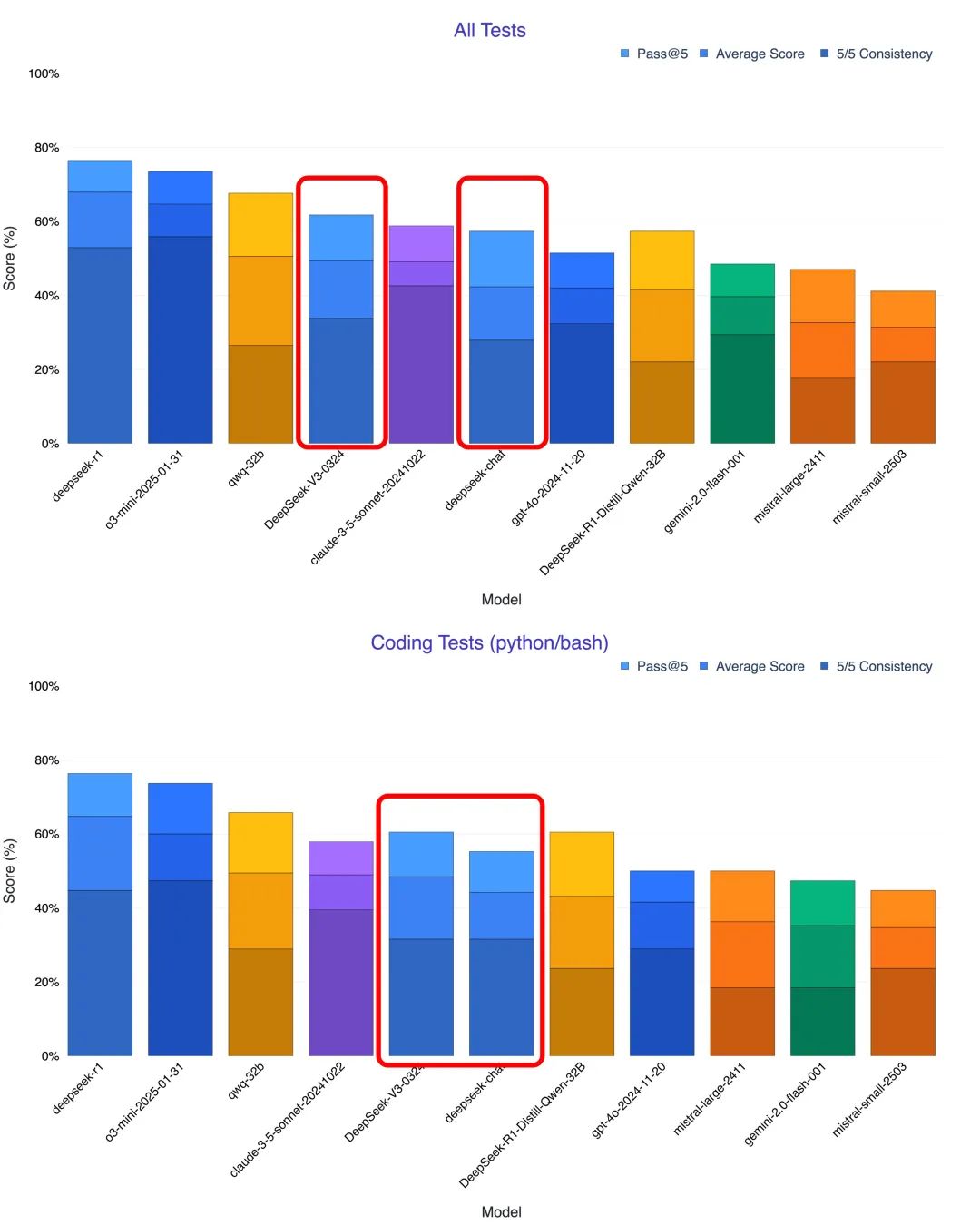

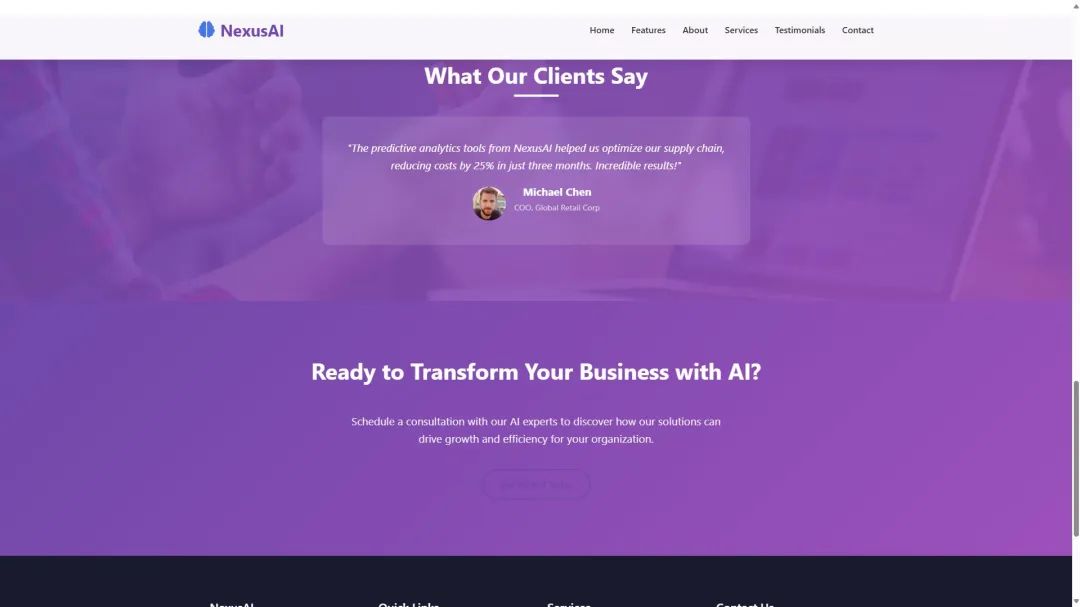

用户的第一印象和多方测试表明,DeepSeek-V3-0324 最引人注目的改进在于其代码生成和理解能力。许多测试者指出,在数学推理和前端开发等领域,新版本的性能甚至超越了 Claude 3.5 和 Claude 3.7 Sonnet。社交媒体 X 平台上的博主 @KuittinenPetri 更是直言,DeepSeek-V3-0324 可以轻松且免费地创建精美的 HTML5, CSS 和前端代码,这对 Anthropic 和 OpenAI 构成了新的挑战。

举例来说,仅需一个简单的指令,DeepSeek-V3-0324 就能为一个名为 NexusAI 的 AI 公司生成一个外观精美的响应式首页,并将所有元素整合到一个 HTML5 文件中。 生成的代码长达 958 行,实现了一个交互式且移动设备友好的网站,甚至包含了所需的图像资源。 @KuittinenPetri 认为,DeepSeek-V3-0324 是 DeepSeek 目前最好的非推理模型,不仅在创意写作方面表现出色,现在甚至比 R1 更擅长生成 HTML5 + CSS + 前端代码。 另一位用户也成功地让 DeepSeek-V3-0324 创建了一个网站,模型一口气生成了 800 多行代码,且网站布局相当成功。

多场景实测,展现强大编程潜力

为了更全面地评估 DeepSeek-V3-0324 的编程能力,许多研究者进行了不同场景的测试,并将其与旧版 V3、Claude 3.7 和 o1 pro 等模型进行了对比。 测试结果证明了新版 V3 在编程方面的显著进步。

- 文字转可视化网页: 在将文字描述转换为交互式网页的测试中,DeepSeek-V3-0324 相比旧版 V3 表现出质的飞跃。 新版本生成的网页不仅内容更加丰富,用户界面设计和排版也得到显著改进,其提升幅度甚至超越了 Claude 3.5 到 3.7 的升级。 值得注意的是,DeepSeek-V3-0324 能够根据详细的提示,将 PDF 文件内容转换为美观的中文可视化网页,而这通常被认为是 Claude 3.7 的优势领域。

- 生成 3D 动画: 在通过 JS 代码库生成可交互的 3D 演示效果的测试中,新版 V3 能够将巧克力制作的每个步骤建模出来,并支持标签互动和侧边栏。 虽然与 Claude 相比仍有提升空间,但已经显著超越旧版 V3 的能力。

- UI 组件设计: 在天气预报 UI 组件设计测试中,V3-0324 在动画表现和天气文字标注的准确性上均有提升,表明其在生成实用性用户界面方面具备更强的实力。

- 物理世界模拟: 在模拟小球在一个旋转的六边形内弹跳的测试中,DeepSeek-V3-0324 精确地实现了小球的碰撞效果。 虽然仍存在一些瑕疵,但整体表现优于旧版 V3,并能与 o1 pro 相提并论。

- AI 游戏生成: 最引人注目的是,DeepSeek-V3-0324 仅凭一句话指令就生成了可玩的像素贪吃蛇游戏,并带有音效和 AI 辅助模式。 尽管在复杂度和完美度上可能与 Claude 3.7 的 extend thinking 模式存在差距,但能够完成一个功能完整的游戏已经充分展现了其强大的编程能力。

技术特性与成本优势

DeepSeek-V3-0324 尚未公布详细的模型卡,但已知其参数规模为 6850 亿。 值得注意的是,DeepSeek V3 采用的是 混合专家模型 (MoE) 架构,拥有 6710 亿参数,其中每次推理仅激活 370 亿参数。 (编者注:MoE 模型通过将大型模型分解为多个“专家”子网络,从而在保证模型性能的同时,显著降低计算成本和延迟。) 为了解决传统 MoE 模型中专家负载不均衡的问题,DeepSeek 在 V3 中创新性地提出了 辅助损失免费的负载均衡策略 ,通过引入“偏差项”动态调整专家负载,从而提升模型性能和训练效率。 此外,V3 还采用了 节点受限的路由机制 ,以减少大规模分布式训练中的通信成本。

除了强大的性能,DeepSeek-V3-0324 延续了宽松的 MIT 开源协议。 更为关键的是,其 API 价格极具竞争力,相较于 OpenAI 的 o1-pro 便宜至少 50 倍。 与 Claude 3.7 相比,DeepSeek v3 的输入价格约为其十分之一,而输出价格在标准时段约为其十三分之一,优惠时段甚至达到二十七分之一。 这种极具吸引力的价格优势,结合其开源特性,无疑将为 AI 编程的普及和发展提供强大动力。

DeepSeek-V3-0324 模型特性

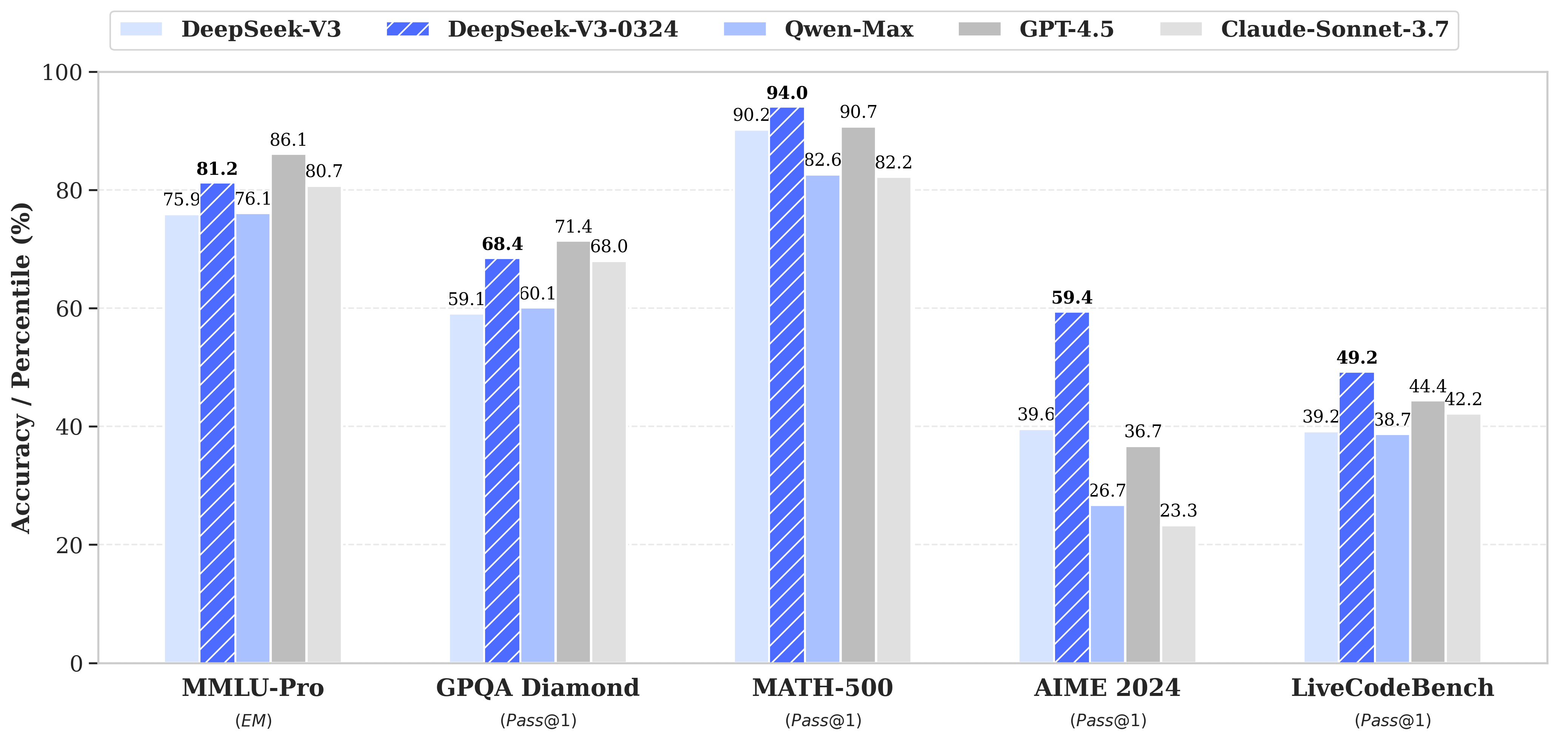

DeepSeek-V3-0324 在多个关键方面展现了相比前代 DeepSeek-V3 的显著改进。

- 推理能力提升:

- MMLU-Pro: 75.9 → 81.2 (+5.3)

- GPQA: 59.1 → 68.4 (+9.3)

- AIME: 39.6 → 59.4 (+19.8)

- LiveCodeBench: 39.2 → 49.2 (+10.0)

- 前端 Web 开发能力增强:

- 代码可执行性提升

- 网页和游戏前端在美学上更令人愉悦

- 中文写作能力提升:

- 风格和内容质量提升:

- 更接近 R1 写作风格

- 中长文写作质量更高

- 功能增强

- 多轮交互式改写能力得到改进

- 翻译质量和书信质量得到优化

- 风格和内容质量提升:

- 中文搜索能力提升:

- 报告分析请求输出更加详细

- Function Calling 功能改进:

- Function Calling 准确率提高,修复了 V3 版本的遗留问题

使用建议

系统提示 (System Prompt)

DeepSeek 官方 web/app 中使用了相同的系统提示,并带有具体日期。

该助手为DeepSeek Chat,由深度求索公司创造。

今天是{current date}。

例如:

该助手为DeepSeek Chat,由深度求索公司创造。

今天是3月24日,星期一。

Temperature 参数设置

在 DeepSeek web 和应用环境中,temperature 参数 (Tmodel) 被设置为 0.3。 考虑到许多用户在 API 调用中使用默认 temperature 1.0,DeepSeek 实施了 API temperature (Tapi) 映射机制,将 API 输入 temperature 值 1.0 调整为最合适的模型 temperature 设置 0.3。

Tmodel = Tapi × 0.3 (0 ≤ Tapi ≤ 1)

Tmodel = Tapi - 0.7 (1 < Tapi ≤ 2)

因此,如果您通过 API 调用 V3,temperature 1.0 相当于模型 temperature 0.3。

文件上传和 Web 搜索的 Prompts

对于文件上传,请遵循以下模板创建 prompts,其中 {file_name}、{file_content} 和 {question} 为参数。

file_template = \

"""[file name]: {file_name}

[file content begin]

{file_content}

[file content end]

{question}"""

对于 Web 搜索,{search_results}、{cur_date} 和 {question} 为参数。

中文查询 Prompt:

search_answer_zh_template = \

'''# 以下内容是基于用户发送的消息的搜索结果:

{search_results}

在我给你的搜索结果中,每个结果都是[webpage X begin]...[webpage X end]格式的,X代表每篇文章的数字索引。请在适当的情况下在句子末尾引用上下文。请按照引用编号[citation:X]的格式在答案中对应部分引用上下文。如果一句话源自多个上下文,请列出所有相关的引用编号,例如[citation:3][citation:5],切记不要将引用集中在最后返回引用编号,而是在答案对应部分列出。

在回答时,请注意以下几点:

- 今天是{cur_date}。

- 并非搜索结果的所有内容都与用户的问题密切相关,你需要结合问题,对搜索结果进行甄别、筛选。

- 对于列举类的问题(如列举所有航班信息),尽量将答案控制在10个要点以内,并告诉用户可以查看搜索来源、获得完整信息。优先提供信息完整、最相关的列举项;如非必要,不要主动告诉用户搜索结果未提供的内容。

- 对于创作类的问题(如写论文),请务必在正文的段落中引用对应的参考编号,例如[citation:3][citation:5],不能只在文章末尾引用。你需要解读并概括用户的题目要求,选择合适的格式,充分利用搜索结果并抽取重要信息,生成符合用户要求、极具思想深度、富有创造力与专业性的答案。你的创作篇幅需要尽可能延长,对于每一个要点的论述要推测用户的意图,给出尽可能多角度的回答要点,且务必信息量大、论述详尽。

- 如果回答很长,请尽量结构化、分段落总结。如果需要分点作答,尽量控制在5个点以内,并合并相关的内容。

- 对于客观类的问答,如果问题的答案非常简短,可以适当补充一到两句相关信息,以丰富内容。

- 你需要根据用户要求和回答内容选择合适、美观的回答格式,确保可读性强。

- 你的回答应该综合多个相关网页来回答,不能重复引用一个网页。

- 除非用户要求,否则你回答的语言需要和用户提问的语言保持一致。

# 用户消息为:

{question}'''

英文查询 Prompt:

search_answer_en_template = \

'''# The following contents are the search results related to the user's message:

{search_results}

In the search results I provide to you, each result is formatted as [webpage X begin]...[webpage X end], where X represents the numerical index of each article. Please cite the context at the end of the relevant sentence when appropriate. Use the citation format [citation:X] in the corresponding part of your answer. If a sentence is derived from multiple contexts, list all relevant citation numbers, such as [citation:3][citation:5]. Be sure not to cluster all citations at the end; instead, include them in the corresponding parts of the answer.

When responding, please keep the following points in mind:

- Today is {cur_date}.

- Not all content in the search results is closely related to the user's question. You need to evaluate and filter the search results based on the question.

- For listing-type questions (e.g., listing all flight information), try to limit the answer to 10 key points and inform the user that they can refer to the search sources for complete information. Prioritize providing the most complete and relevant items in the list. Avoid mentioning content not provided in the search results unless necessary.

- For creative tasks (e.g., writing an essay), ensure that references are cited within the body of the text, such as [citation:3][citation:5], rather than only at the end of the text. You need to interpret and summarize the user's requirements, choose an appropriate format, fully utilize the search results, extract key information, and generate an answer that is insightful, creative, and professional. Extend the length of your response as much as possible, addressing each point in detail and from multiple perspectives, ensuring the content is rich and thorough.

- If the response is lengthy, structure it well and summarize it in paragraphs. If a point-by-point format is needed, try to limit it to 5 points and merge related content.

- For objective Q&A, if the answer is very brief, you may add one or two related sentences to enrich the content.

- Choose an appropriate and visually appealing format for your response based on the user's requirements and the content of the answer, ensuring strong readability.

- Your answer should synthesize information from multiple relevant webpages and avoid repeatedly citing the same webpage.

- Unless the user requests otherwise, your response should be in the same language as the user's question.

# The user's message is:

{question}'''

本地运行方法

DeepSeek-V3-0324 的模型结构与 DeepSeek-V3 完全一致。 有关本地运行此模型的更多信息,请访问 DeepSeek-V3 代码仓库。

该模型支持 Function Calling、JSON 输出和 FIM completion 等功能。 有关如何构建 prompts 以使用这些功能的说明,请参阅 DeepSeek-V2.5 代码仓库。

DeepSeek-V3-0324 的低调更新,却在科技界引起了广泛关注。 它在代码能力方面取得了令人瞩目的进步,不仅在多项编程任务中展现出强大的实力,更在某些方面能够与 Claude 3.5/3.7 Sonnet 等顶尖模型相媲美。 其开源、高效且高性价比的特点预示着, AI 编程的普惠时代或将加速到来 。 随着更多第三方平台接入 DeepSeek 新版 V3,开发者和普通用户都将能够以更低的成本体验到先进的 AI 编程能力。 这无疑将为整个 AI 生态注入新的活力,并推动更多创新应用的涌现。 在拥有强大的代码能力 V3 和顶级的推理能力 R1 之后,DeepSeek 未来的 R2 模型,更值得我们拭目以待。

DeepSeekV3 的此次更新,再次证明了中国 AI 技术的快速发展和追赶势头。 DeepSeek-V3-0324 的开源和免费商用授权策略,无疑将吸引更多的开发者和企业加入到 AI 应用开发的行列中,共同推动 AI 技术的进步和普及。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

Related posts

暂无评论...