综合介绍

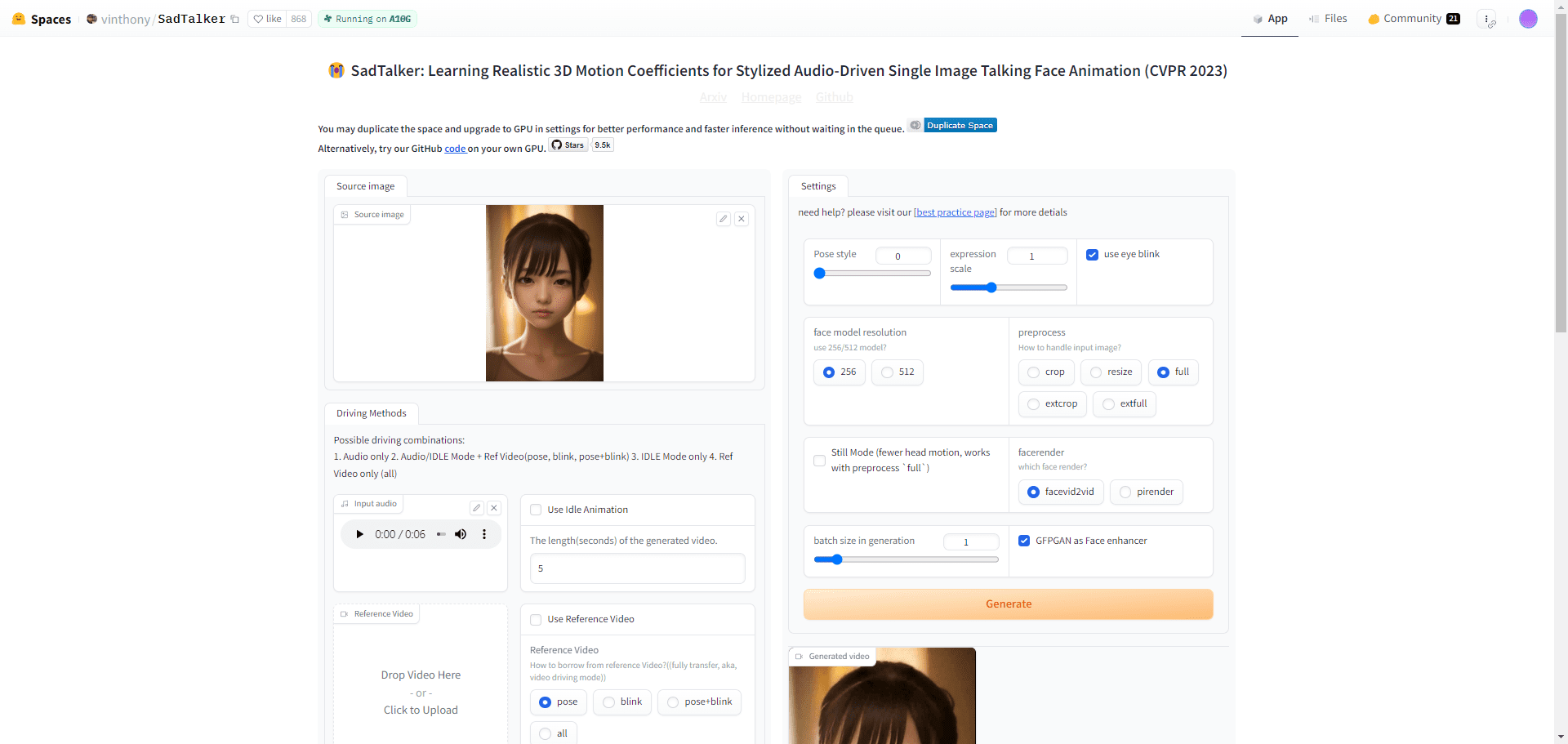

SadTalker是一个开源工具,能够将单张静态人像照片和音频文件结合,创造出逼真的说话头像视频,适用于个性化信息、教育内容等多种场景。革命性地使用3D建模技术,如ExpNet和PoseVAE,优秀地捕获细微的面部表情和头部动作。用户可以在个人项目和商业项目中使用SadTalker技术,例如信息传递、教学或市场营销。

推荐加强版:SVLS:SadTalker增强版,使用人像视频生成数字人,从照片生成数字人升级为视频生成数字人,并且通过插帧技术让数字人说话更加流畅。

功能列表

利用音频同步面部动作和表情

- 将静态人像照片转换为动态视频

- 音频文件同步口型动画

支持全身模式和表情增强器功能

提供可配置的WebUI界面

可通过Discord集成使用该技术

提供详尽的开发和使用文档

支持Windows、Linux/Unix及macOS

使用帮助

安装所需的Anaconda、Python和git

遵循文档安装环境和下载模型

使用本地WebUI或命令行界面进行动画生成

注意:

- 选择清晰的正面人像照片以获得最佳效果

- 使用清晰的音频文件以确保口型同步准确

根据网络上的资源,以下是使用SadTalker的基本步骤:

- 环境准备:

- 如果没有Python环境,安装Anaconda。

- 安装NVIDIA cuda-toolkit,以便在有英伟达显卡的电脑上使用GPU加速。如果只用CPU,处理速度会比较慢。

- 模型和库的安装:

- 下载并安装所需的模型和库文件。这些文件通常需要放在特定的目录下,例如

./checkpoints/或./gfpgan/weights/。

- 下载并安装所需的模型和库文件。这些文件通常需要放在特定的目录下,例如

- FFMPEG视频库安装:

- 安装FFMPEG,这是生成视频所必需的。

- TTS语音转换库安装:

- 安装edge-tts库,以便将文本转换为语音。

- 使用Web UI:

- 通过点击

webui.bat启动SadTalker的Web UI。 - 在Web UI中,上传图片到指定区域,并设置数字人转换时的参数。

- 生成数字人视频后,可以在界面中查看结果。

- 通过点击

- 命令行使用:

- 如果追求更多的可选项,可以通过命令行脚本的方式使用SadTalker。

- 使用命令行时,可以通过运行

task.sh文件来方便地生成任务。

- 注意事项:

- 使用时,确保图片质量好,以获得最佳效果。

- 如果遇到错误,比如

libiomp5md.dll冲突,可以尝试在app.py中设置环境变量KMP_DUPLICATE_LIB_OK=TRUE来解决。

以上步骤是基于网络上的教程和用户经验总结的,具体操作可能会有所变化。建议您参考SadTalker的官方文档和社区教程以获取最新和详细的指导。

SadTalker 安装

SadTalker Windows 下载

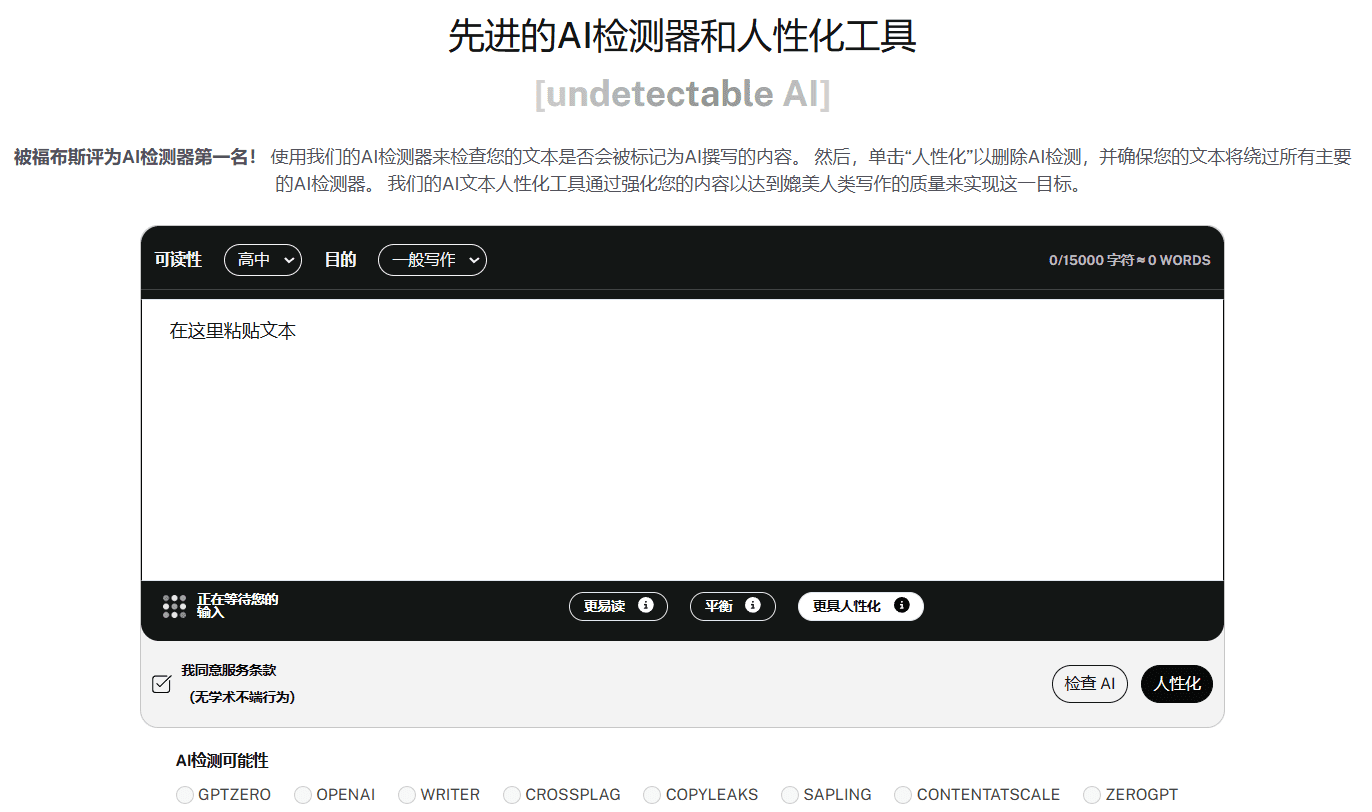

SadTalker 免费在线运行 WebUI

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...