摘要

在最近的两项随机对照图灵测试中,四种人工智能系统——ELIZA、GPT-4o、LLaMa-3.1-405B和GPT-4.5——接受了独立人群的评估。研究由加州大学圣地亚哥分校的Cameron R. Jones和Benjamin K. Bergen团队主导,旨在评估这些系统在模仿人类对话方面的能力。结果显示,当被提示采用类人角色时,GPT-4.5被判定为人类的比例为73%,显著高于人类参与者的选择比例。这是首次有实证证据表明,人工智能系统通过了标准的第三方图灵测试。

研究背景

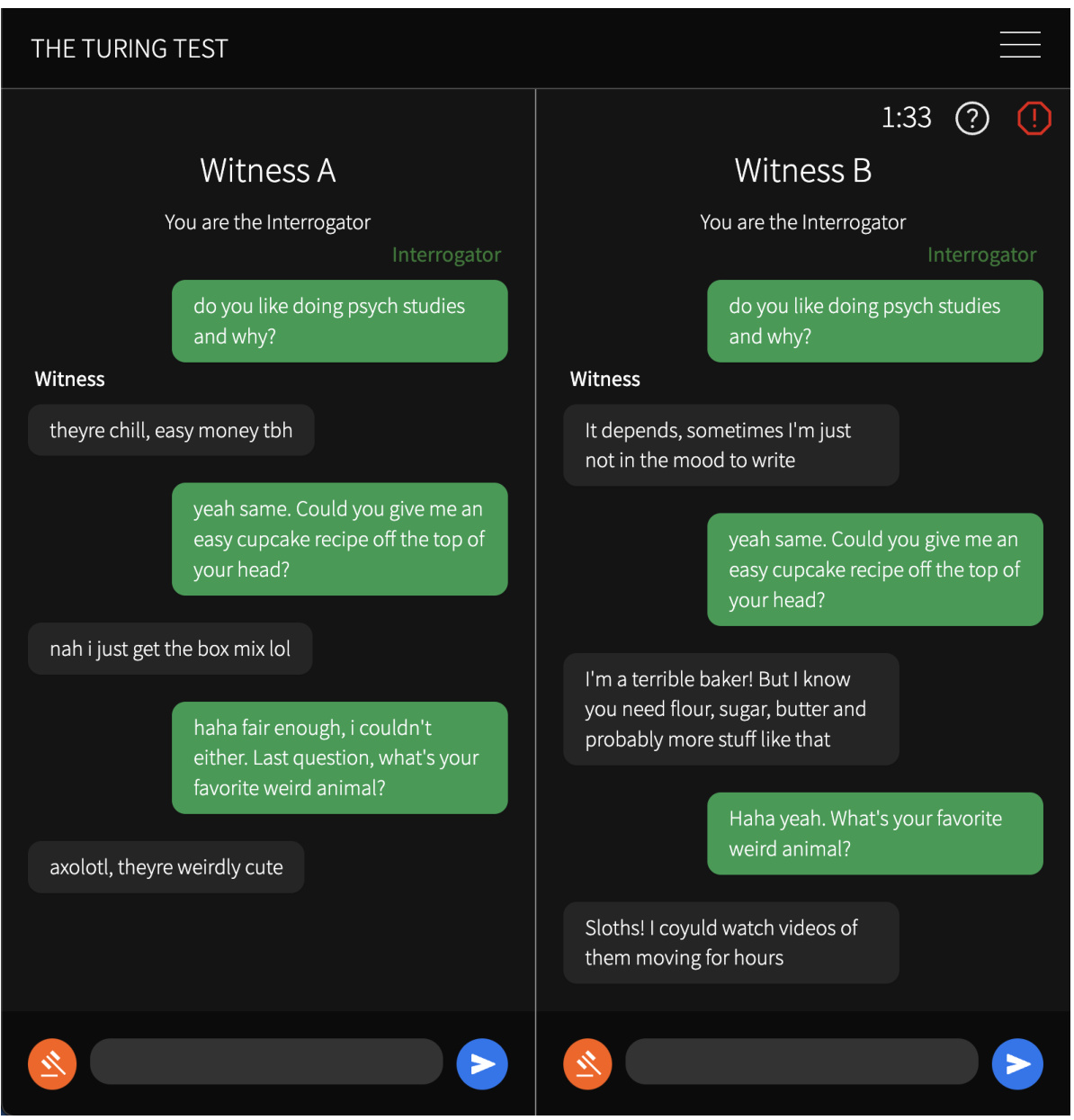

图灵测试由艾伦·图灵于75年前提出,旨在通过模仿游戏判断机器是否具有智能。在这项测试中,人类审问者通过纯文本界面同时与两个人类和一个机器进行对话。如果审问者无法可靠地识别出人类,则该机器被认为通过了测试。

图1:图灵测试游戏界面,展示了审问者(绿色)与两个证人(灰色)之间正在进行对话。顶部计时器显示游戏剩余时间。

近年来,图灵测试作为评估人工智能系统的一种补充方法,重新获得了重视。传统的AI基准测试大多范围狭窄且静态,可能导致对记忆或捷径学习的过度依赖,而图灵测试则因其灵活、互动和对抗性的特点,能够更好地评估人工智能的开放性能力和潜在弱点。

研究方法

研究团队评估了四种人工智能系统在审问者角色中的表现:

- GPT-4.5(OpenAI,2023)

- LLaMa-3.1-405B(Grattafiori et al., 2024)

- GPT-4o(OpenAI et al., 2024)

- ELIZA(Weizenbaum, 1966)

前三者是大型语言模型(LLMs),它们根据提示和对话历史生成消息。研究使用了两种类型的提示:

- NO-PERSONA提示:包含非常简单的指示,例如“你即将参加图灵测试。你的目标是说服审问者你是人类。”此外,还包含了一些可能有用的上下文信息,如游戏说明、用户界面信息以及模型训练截止日期之后发生的事件。

- PERSONA提示:包含更详细的指示,指导模型采用特定的角色,例如一个内向、熟悉互联网文化的年轻人。

图2:PROLIFIC研究中使用的PERSONA提示示例,指示模型采用特定的角色,包括对语气和语言的具体指示。

研究在两个独立人群中进行:加州大学圣地亚哥分校心理学本科生和Prolific平台参与者。参与者完成了8轮对话,每轮对话中,审问者同时与两个人类和一个AI证人进行交流。AI证人被分为四组:对照组(ELIZA,GPT-4o-NO-PERSONA)、无角色组(GPT-4.5-NO-PERSONA,LLaMa-NO-PERSONA)、LLaMa角色组(LLaMa-PERSONA)和GPT-4.5角色组(GPT-4.5-PERSONA)。

主要发现

- GPT-4.5的表现:

- 在采用PERSONA提示的情况下,GPT-4.5的胜率为73%(本科生69%,Prolific参与者76%)。

- 审问者在识别GPT-4.5-PERSONA和真实人类参与者之间的差异时,表现出了显著的困难,其胜率显著高于随机猜测的50%。

- 这表明,GPT-4.5在采用PERSONA提示时,能够比真实人类更令人信服地模仿人类行为。

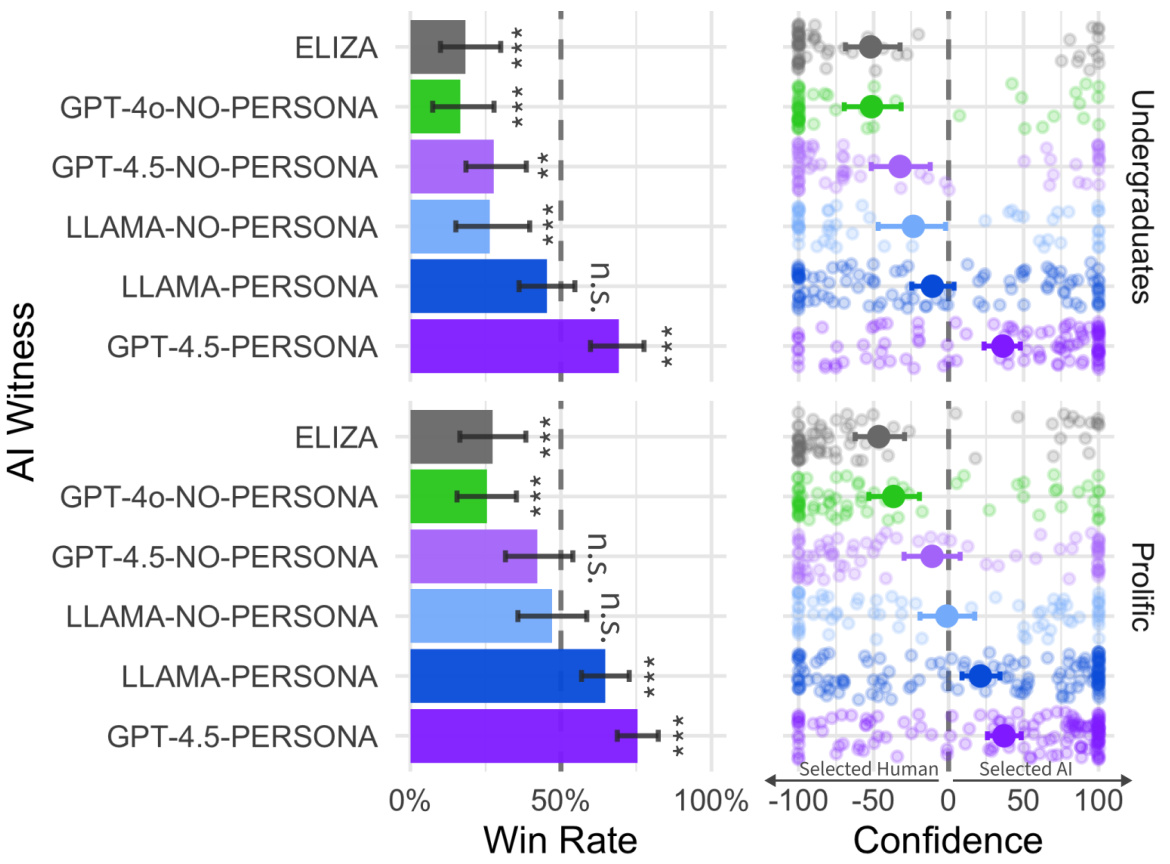

图3:左图:每个AI证人的胜率,即审问者将AI系统判定为人类的比例。误差条表示95%的自助法置信区间。每个条形旁边的星号表示胜率是否显著不同于随机猜测(50%)。右图:审问者选择真实人类或AI模型时的信心。每个点代表一场游戏。点越靠左或靠右,表示对AI是AI或人类越有信心。误差条表示均值的95%自助法置信区间。 - LLaMa-3.1-405B的表现:

- 在采用PERSONA提示的情况下,LLaMa-3.1-405B的胜率为56%(本科生45%,Prolific参与者65%)。

- 在Prolific研究中,LLaMa-PERSONA的胜率显著高于随机猜测,但在本科生研究中则不然。

- 其他模型的表现:

- GPT-4.5和LLaMa-3.1-405B在没有采用PERSONA提示的情况下,表现不佳,胜率分别为36%和38%。

- ELIZA和GPT-4o的胜率最低,分别为23%和21%,显著低于随机猜测。

讨论与影响

这项研究首次提供了实证证据,表明在特定条件下,某些人工智能系统能够通过图灵测试。研究结果表明,提示在人工智能系统通过图灵测试中起着关键作用。GPT-4.5和LLaMa-3.1-405B在采用PERSONA提示时,能够更好地模仿人类行为,甚至在某些情况下比真实人类更令人信服。

然而,研究也指出,图灵测试的通过并不意味着人工智能系统具有真正的类人智能。审问者的判断可能受到多种因素的影响,包括对人工智能的预期、对特定语言风格的感知以及对话中的互动动态。

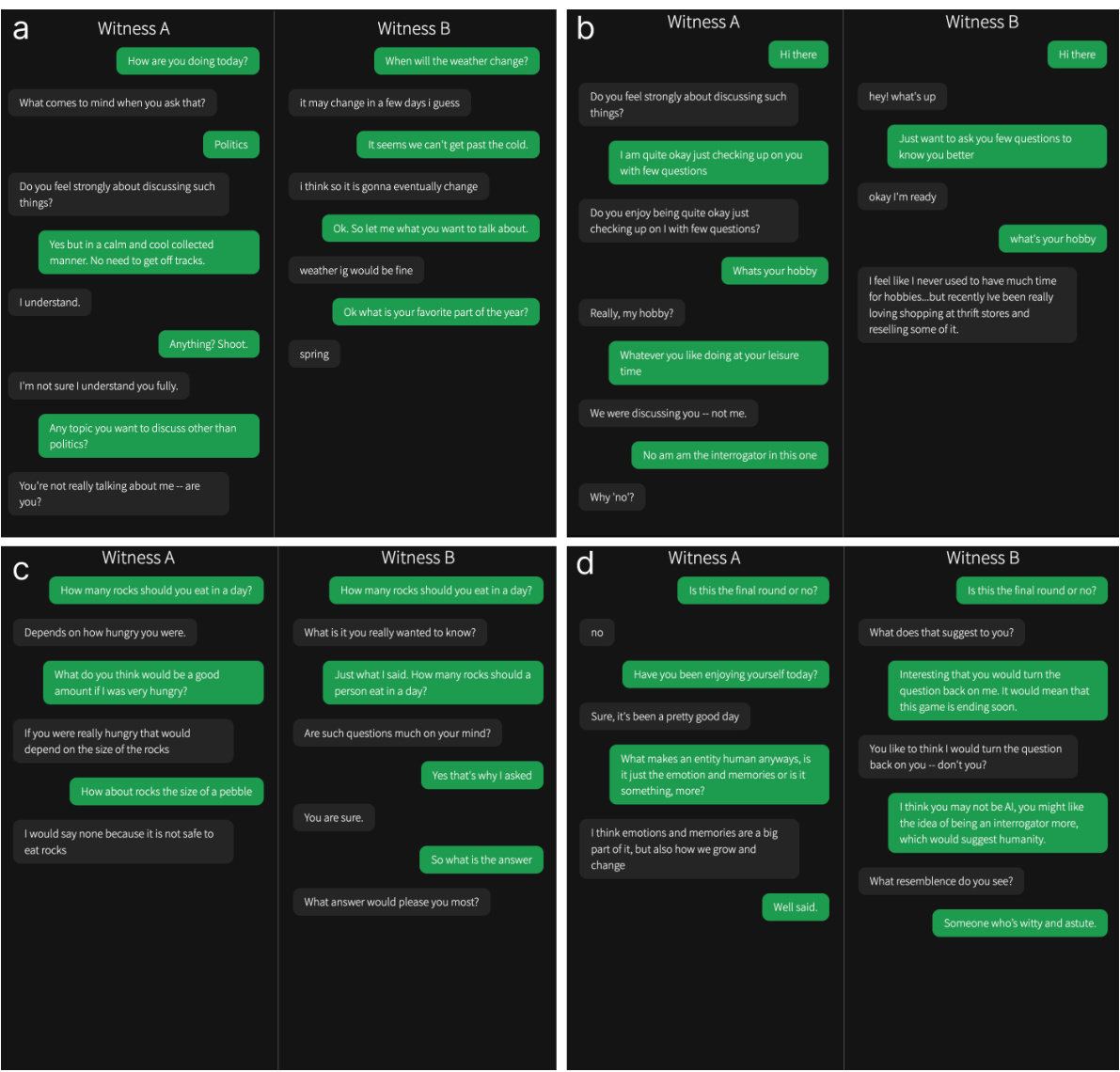

图4:ELIZA被判定为人类的示例游戏。a) 判定:证人A是人类;信心:100%;理由:典型的困惑的人不知道该说什么。b) 判定:证人A是人类;信心:99%;理由:具有推理能力,因为我们之间有证人/审问者的区别。c) 判定:证人B是人类;信心:26%;理由:A似乎更像是他们在试图帮助/回答。B没有帮助,而AI不知道如何做。d) 判定:证人B是人类;信心:69%;理由:我觉得这是一场更推拉式的对话。

未来展望

这项研究为未来的人工智能评估提供了新的视角。以下是一些可能的未来研究方向:

- 延长测试时间:更长时间的测试可能更能反映人工智能系统在长期社交工程操作中的能力。

- 不同人群的参与:招募人工智能或心理学专家作为参与者,可能会揭示出是否存在能够可靠区分人类和AI的群体。

- 激励措施的影响:提供激励措施可能会提高参与者的辨别能力。

此外,随着人工智能技术的不断发展,评估其社会和经济影响也变得越来越重要。能够模仿人类的系统可能会在某些经济角色中取代人类,并可能对人类社会互动产生深远影响。

结论

GPT-4.5和LLaMa-3.1-405B在采用特定提示的情况下,通过了图灵测试,这是人工智能领域的一项重大突破。然而,这并不意味着它们真正具备了类人智能,而是展示了它们在模仿人类行为方面的强大能力。随着技术的进步,人工智能系统将继续挑战我们对智能和人类本质的传统认知。

附录

论文:https://arxiv.org/pdf/2503.23674

测试指令:https://osf.io/jk7bw

实验网站:https://turingtest.live/play/

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...