Qwen3-VL是什么

Qwen3-VL是阿里云通义千问团队开源的多模态视觉语言大模型,参数量达2350亿,模型文件约471GB。包含指令版和思考版,采用增强的MRope交错布局、DeepStack等技术,可有效利用视觉变换器的多级特征,提升视频理解能力。在视觉感知基准测试中,指令版与Gemini 2.5 Pro持平甚至超越;思考版在多模态推理基准测试中达到最新水平。Qwen3-VL使用简单,通过transformers库即可加载模型,支持图像、文本输入,可生成文本输出。采用Apache 2.0协议,完全可商用,未来还将推出更小的模型版本。

Qwen3-VL的功能特色

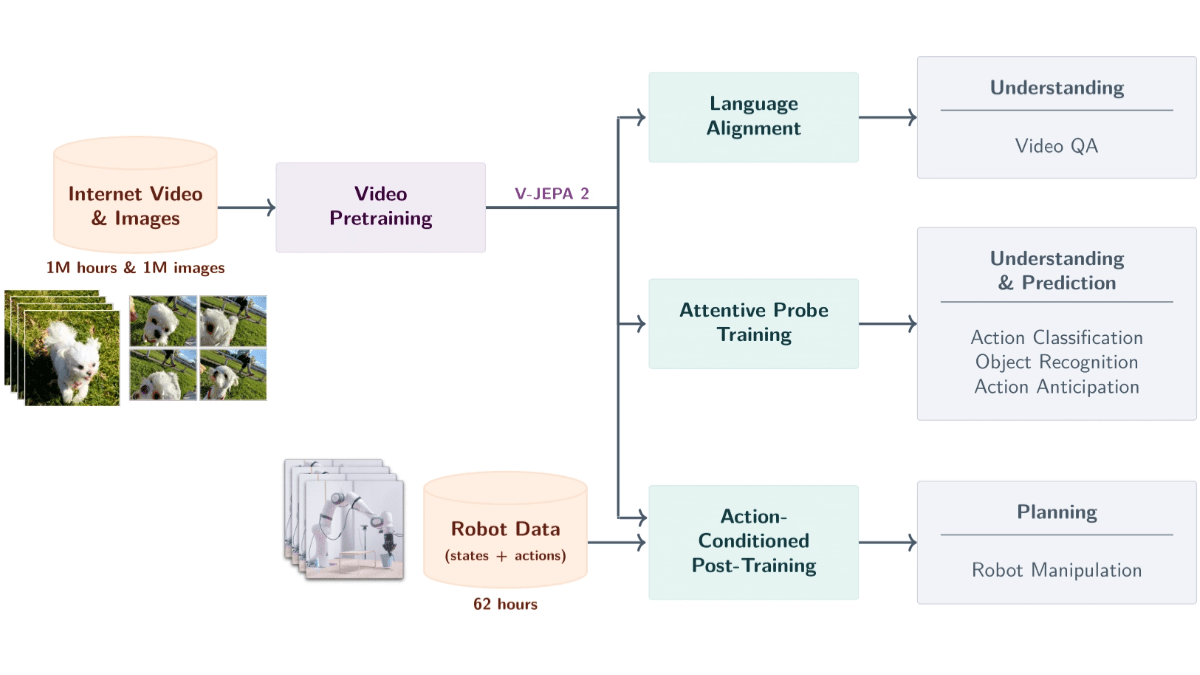

- 强大的视觉理解能力:Qwen3-VL能处理各种视觉任务,如图像分类、目标检测、图像描述等。通过增强的MRope交错布局和DeepStack技术,有效利用视觉变换器的多级特征,提升对图像和视频的时空建模能力,更准确地理解视觉内容。

- 卓越的多模态推理能力:模型在多模态推理基准测试中达到最新水平,能结合图像、文本等多种模态信息进行复杂的推理和决策。例如,在给定一张图片和一段相关文本的情况下,Qwen3-VL可以准确地理解两者之间的关系,并生成准确的描述或回答相关问题。

- 高效的文本生成能力:Qwen3-VL具备强大的文本生成能力,能根据输入的图像或视频生成高质量的文本描述,如生成图片的详细说明、视频的剧本等。可以根据文本提示生成与之相关的图像内容,实现文本到图像的生成。

- 灵活的模型架构:Qwen3-VL包含指令版和思考版等多种变体,满足不同的应用场景和需求。指令版在视觉感知基准测试中表现优异,思考版则更擅长多模态推理任务。模型支持多种数据类型和设备映射,方便用户根据实际需求进行灵活配置。

- 开源与可扩展性:Qwen3-VL采用Apache 2.0协议开源,完全可商用,无需白名单。所有权重已发布在Hugging Face上,方便开发者下载和使用。未来还将推出更小的模型版本,如20亿和70亿参数版本,以满足不同规模和性能需求的用户。

Qwen3-VL的核心优势

- 视觉智能体(Visual Agent):Qwen3-VL 能操作电脑和手机界面、识别 GUI 元素、理解按钮功能、调用工具、执行任务,在 OS World 等 benchmark 上达到世界顶尖水平,能通过调用工具有效提升在细粒度感知任务的表现。

- 纯文本能力媲美顶级语言模型:Qwen3-VL 在预训练早期即混合文本与视觉模态协同训练,文本能力持续强化,最终在纯文本任务上表现与 Qwen3-235B-A22B-2507 纯文本旗舰模型不相上下 —— 是真正“文本根基扎实、多模态全能”的新一代视觉语言模型。

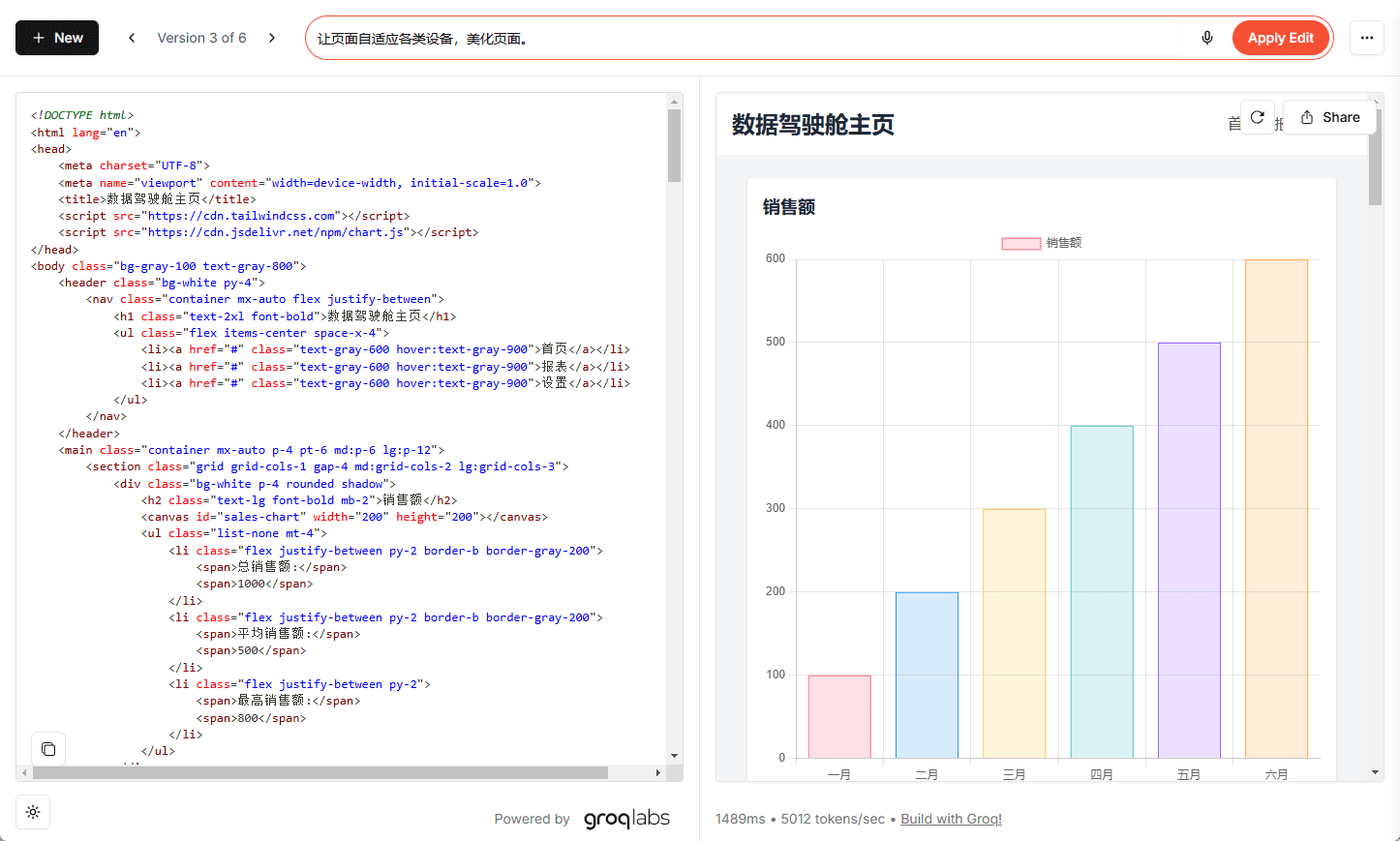

- 视觉 Coding 能力大幅提升:实现图像生成代码以及视频生成代码,例如看到设计图,代码生成 Draw.io/HTML/CSS/JS 代码,真正实现“所见即所得”的视觉编程。

- 空间感知能力大幅提升:2D grounding 从绝对坐标变为相对坐标,支持判断物体方位、视角变化、遮挡关系,能实现 3D grounding,为复杂场景下的空间推理和具身场景打下基础。

- 长上下文支持和长视频理解:全系列模型原生支持 256K token 的上下文长度,并可扩展至 100 万 token。这意味着,无论是几百页的技术文档、整本教材,还是长达两小时的视频,都能完整输入、全程记忆、精准检索,支持视频精确定位到秒级别时刻。

- 多模态思考能力显著增强:Thinking 模型重点优化了 STEM 与数学推理能力。面对专业学科问题,模型能捕捉细节、抽丝剥茧、分析因果、给出有逻辑、有依据的答案,在 MathVision、MMMU、MathVista 等权威评测中达到领先水平。

- 视觉感知与识别能力全面升级:通过优化预训练数据的质量和广度,模型现在能识别更丰富的对象类别——从名人、动漫角色、商品、地标,到动植物等,覆盖日常生活与专业领域的“万物识别”需求。

- OCR 支持更多语言及复杂场景:支持的中英外的语言从 10 种扩展到 32 种,覆盖更多国家和地区;在复杂光线、模糊、倾斜等实拍挑战性场景下表现更稳定;对生僻字、古籍字、专业术语的识别准确率也显著提升;超长文档理解和精细结构还原能力进一步提升。

Qwen3-VL的模型性能

- 视觉感知能力卓越:在视觉感知基准测试中,Qwen3-VL的指令版与Gemini 2.5 Pro持平甚至超越,展现出强大的图像和视频理解能力。

- 多模态推理能力领先:思考版在多模态推理基准测试中达到最新水平,能够精准地结合图像、文本等多模态信息进行复杂推理。

- 文本生成质量高:能根据输入的图像或视频生成高质量的文本描述,如图片的详细说明、视频的剧本等,生成的文本自然、准确且富有逻辑性。

- 模型效率高:尽管参数量庞大,但Qwen3-VL在实际应用中表现出较高的效率,能够快速处理复杂的多模态任务,为用户提供及时的响应。

- 适应性强:模型对不同类型的视觉和文本输入具有很强的适应性,无论是简单图像还是复杂视频,都能有效理解和生成相关输出。

Qwen3-VL官网是什么

- 项目官网:https://qwen.ai/blog?id=99f0335c4ad9ff6153e517418d48535ab6d8afef&from=research.latest-advancements-list

- Github仓库:https://github.com/QwenLM/Qwen3-VL

- HuggingFace模型库:https://huggingface.co/collections/Qwen/qwen3-vl-68d2a7c1b8a8afce4ebd2dbe

Qwen3-VL的适用人群

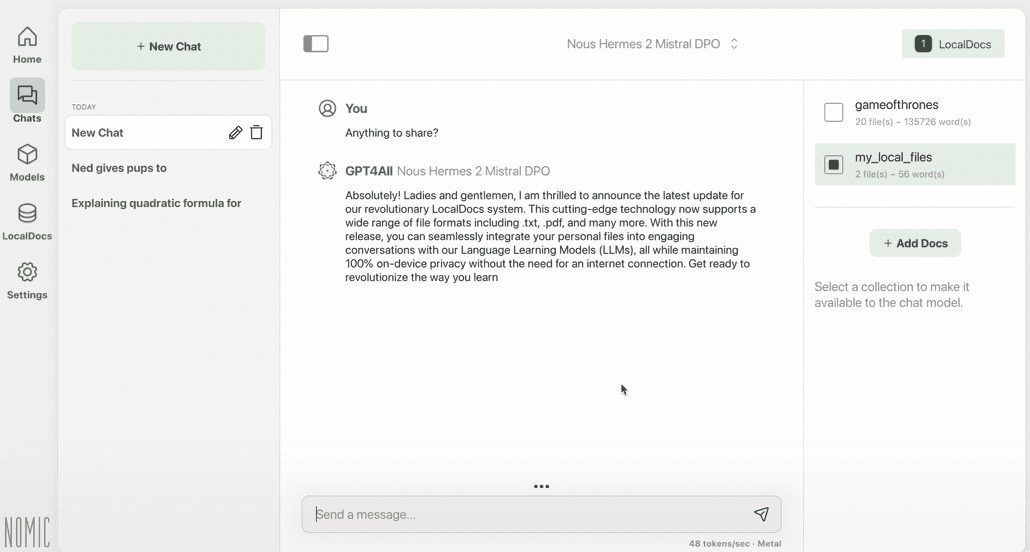

- 人工智能研究人员:Qwen3-VL为研究人员提供了强大的多模态研究平台,可用于探索视觉语言交互、多模态推理等前沿领域,推动人工智能技术的发展。

- 开发者与工程师:模型开源且完全可商用,开发者可以利用其强大的功能开发各种多模态应用,如智能图像标注、视频内容生成、多模态对话系统等,满足不同行业的需求。

- 企业与商业用户:企业可以将Qwen3-VL集成到业务流程中,提升内容创作、客户服务、数据分析等环节的效率和质量。例如,用于自动生成产品描述、智能客服中的多模态交互等。

- 教育工作者与学生:在教育领域,Qwen3-VL可以作为教学工具,帮助学生更好地理解复杂的视觉和语言信息,激发学生对人工智能的兴趣和创造力。

- 内容创作者:对于需要生成高质量文本和视觉内容的创作者来说,Qwen3-VL可以提供创意灵感和内容生成支持,如自动生成文章、脚本、图像描述等,提高创作效率。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...