综合介绍

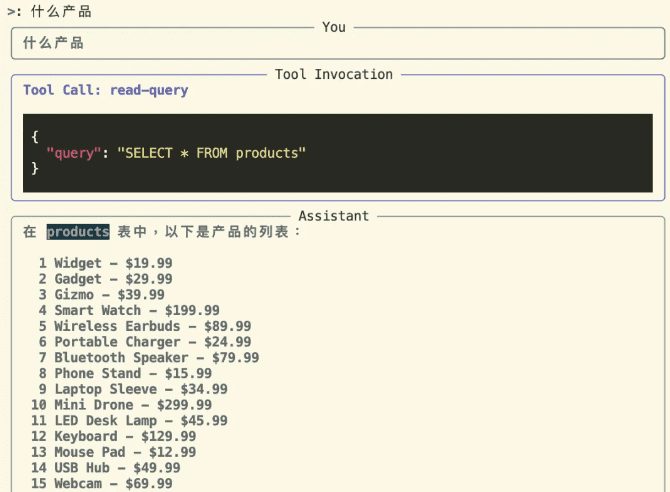

Model Context Provider CLI(mcp-cli)是一个用于与模型上下文提供服务器交互的协议级命令行工具。该工具允许用户发送命令、查询数据并与服务器提供的各种资源进行交互。mcp-cli 支持多个提供商和模型,包括 OpenAI 和 Ollama,默认模型分别为 gpt-4o-mini 和 qwen2.5-coder。该工具需要 Python 3.8 或更高版本,并且需要安装相应的依赖项。用户可以通过克隆 GitHub 仓库并安装必要的依赖项来使用该工具。

功能列表

- 支持与模型上下文提供服务器进行协议级通信

- 动态工具和资源探索

- 支持多个提供商和模型(OpenAI 和 Ollama)

- 提供交互模式,允许用户动态执行命令

- 支持的命令包括:ping、list-tools、list-resources、list-prompts、chat、clear、help、quit/exit

- 支持的命令行参数包括:--server、--config-file、--provider、--model

使用帮助

安装流程

- 克隆仓库:

git clone https://github.com/chrishayuk/mcp-cli

cd mcp-cli

- 安装 UV:

pip install uv

- 同步依赖项:

uv sync --reinstall

使用方法

- 启动客户端并与 SQLite 服务器交互:

uv run main.py --server sqlite

- 使用默认的 OpenAI 提供商和模型运行客户端:

uv run main.py --server sqlite

- 使用特定配置和 Ollama 提供商运行客户端:

uv run main.py --server sqlite --provider ollama --model llama3.2

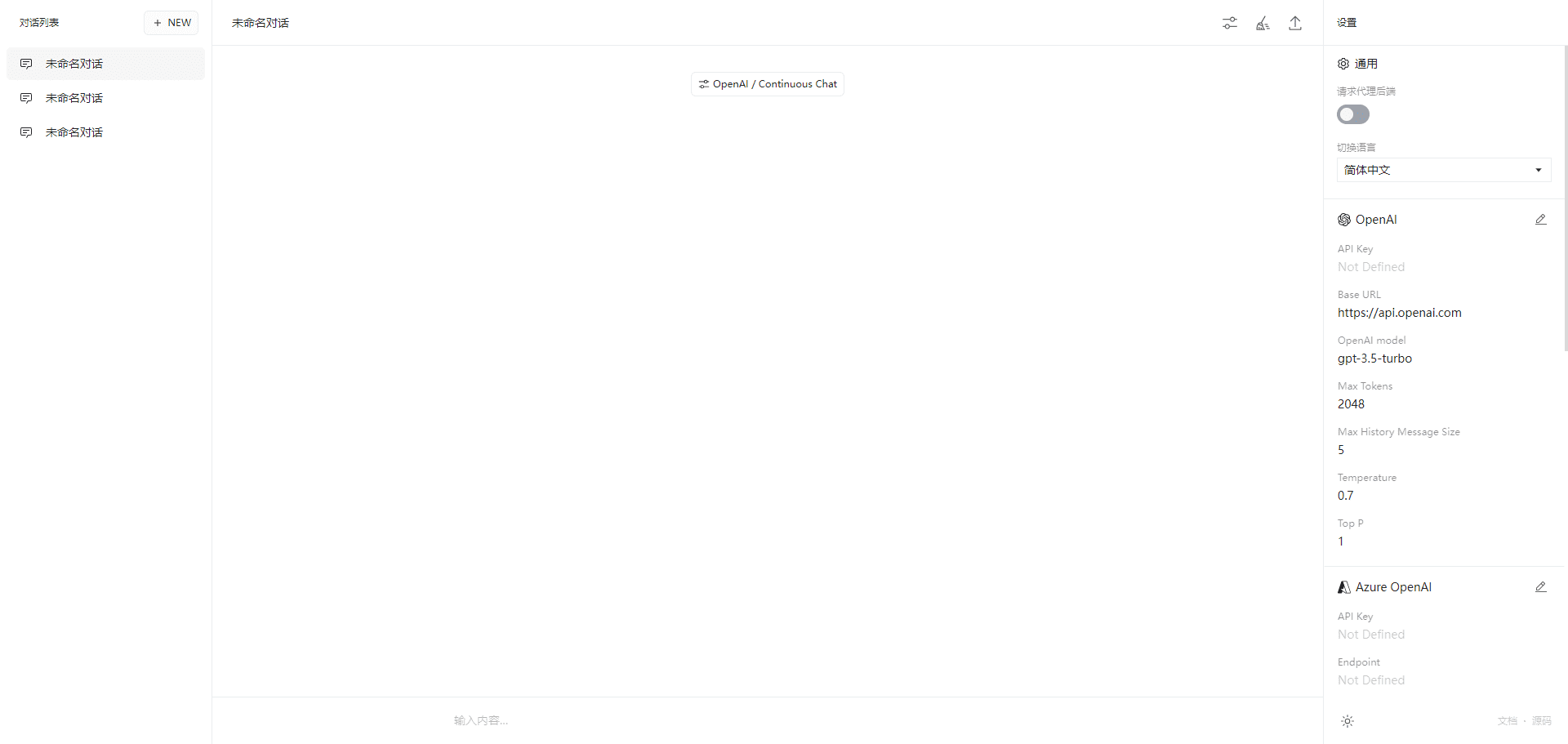

交互模式

进入交互模式并与服务器交互:

uv run main.py --server sqlite

在交互模式下,您可以使用工具并与服务器进行交互。启动时指定的提供商和模型将显示如下:

Entering chat mode using provider 'ollama' and model 'llama3.2'...

支持的命令

ping:检查服务器是否响应list-tools:显示可用工具list-resources:显示可用资源list-prompts:显示可用提示chat:进入交互聊天模式clear:清除终端屏幕help:显示支持的命令列表quit/exit:退出客户端

使用 OpenAI 提供商

如果您希望使用 OpenAI 模型,您应该在运行客户端之前设置 OPENAI_API_KEY 环境变量,可以在 .env 文件中或作为环境变量设置。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...