작은 모델, 큰 파워: 1/20 파라미터를 갖춘 QwQ-32B는 풀 피를 가진 DeepSeek-R1에 맞서 싸울 수 있습니다.

최근 AI 분야, 특히 대규모 언어 모델(LLM)의 추론 능력 향상에 있어 괄목할 만한 발전이 있었습니다. 그중에서도 강화 학습(RL)은 기존 모델의 성능 병목 현상을 극복하기 위한 핵심 기술로 떠오르고 있습니다. 많은 연구를 통해 RL이 모델의 추론 능력을 크게 향상시킬 수 있다는 것이 확인되었습니다. 예를 들어, DeepSeek R1 모델은 콜드 스타트 데이터와 다단계 학습을 통합하여 심층 사고와 복잡한 추론을 달성하여 당시 최고의 수준에 도달했습니다.

이러한 배경에서 알리클라우드는 QwQ-32B 모델을 출시하여 다시 한 번 업계의 관심을 끌었습니다. 320억 개의 매개 변수가 있는 이 모델은 성능 면에서 DeepSeek-R1 모델은 6,710억 개의 매개변수(활성화된 매개변수 370억 개)를 보유하고 있습니다. QwQ-32B의 뛰어난 성능은 방대한 세계 지식을 기반으로 사전 학습된 강력한 기본 모델의 지능을 향상시키는 데 있어 강화 학습의 효과를 강력하게 입증합니다.

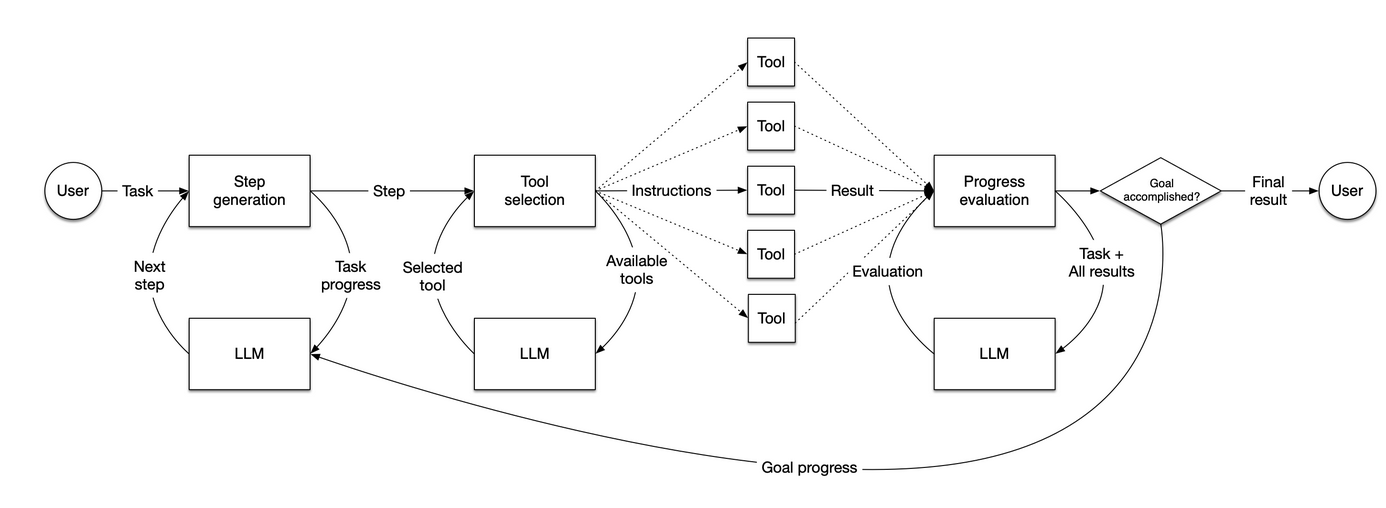

또한 알리윤은 에이전트 관련 기능을 QwQ-32B의 추론 모델에 통합하여 비판적으로 사고할 뿐만 아니라 도구를 활용하고 환경 피드백에 따라 추론 프로세스를 조정할 수 있게 되었습니다. 이러한 기술 발전은 RL 기술의 혁신적 잠재력을 입증하고 일반 인공 지능(AGI)으로 나아가는 길을 열어줍니다.

현재 QwQ-32B는 아파치 2.0 오픈소스 프로토콜에 따라 허깅 페이스와 모델스코프 플랫폼에 출시되었으며, 사용자는 다음을 통해 액세스할 수 있습니다. Qwen 채팅 경험.

소개

QwQ는 "Qwen" 모델 제품군의 추론 모델로, 기존의 명령어 미세 조정 모델보다 더 강력한 사고 및 추론 기능을 갖추고 있으며 특히 복잡한 퍼즐을 풀 때 다운스트림 작업에서 상당한 성능 향상을 보여줍니다. 중형 추론 모델인 qwQ-32B의 성능은 다음과 같습니다. 은 DeepSeek-R1 및 o1-mini와 같은 고급 추론 모델과 비슷합니다.

모델 기능.

- 유형학: 인과적 언어 모델

- 교육 단계지도 미세 조정 및 강화 학습을 포함한 사전 교육 및 사후 교육.

- 빌드RoPE 포지션 코딩, SwiGLU 활성화 기능, RMSNorm 정규화, Attention QKV 바이어스가 있는 트랜스포머 구조 Attention 메커니즘 바이어스

- 매개변수 규모325억 달러(32.5조 원)

- 임베디드되지 않은 레이어 파라미터 크기310억 달러(31조 원)

- 층: 64

- 책임자(GQA)쿼리 쪽은 40개, 키/값 쪽은 8개입니다.

- 컨텍스트 길이전체 131,072 토큰

다음 사항에 유의하십시오.최상의 경험을 위해 다음을 참조하세요. 사용 가이드라인 QwQ 모델은 나중에 배포됩니다.

사용자는 다음을 사용할 수 있습니다. 데모 체험을 하거나 QwenChat QwQ 모델에 액세스하려면 사고력(QwQ)을 여는 것을 잊지 마세요.

자세한 내용은 다음을 참조하세요. GitHub 리포지토리 too 공식 문서.

성능

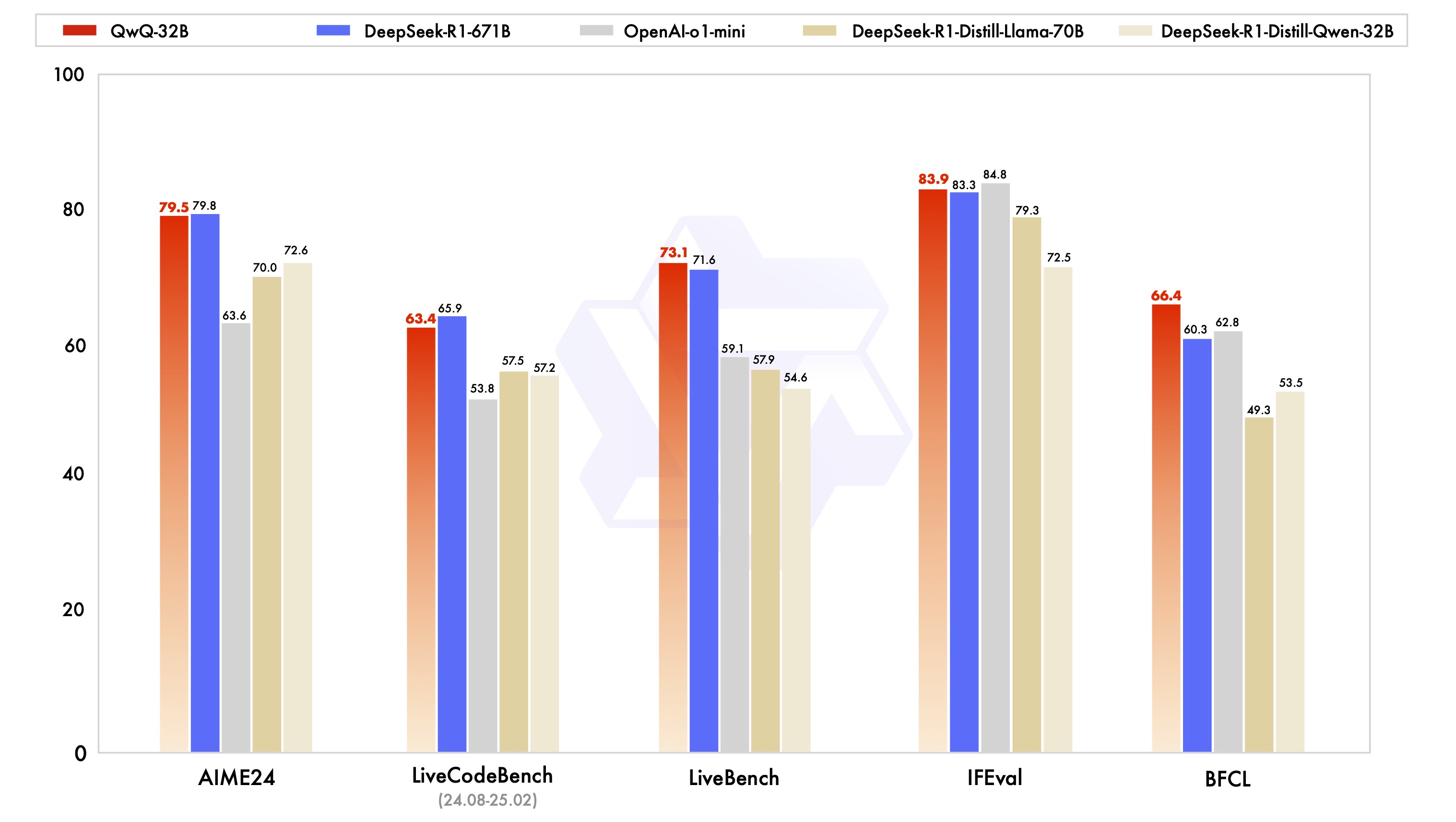

QwQ-32B 모델은 수학적 추론, 코드 작성 및 일반적인 문제 해결 능력을 종합적으로 살펴볼 수 있도록 설계된 일련의 벤치마크 테스트에서 평가되었습니다. 아래 차트는 딥서치-R1-Distilled-Qwen-32B, 딥서치-R1-Distilled-Llama-70B, o1-mini, 오리지널 딥서치-R1을 포함한 다른 주요 모델에 대한 QwQ-32B의 성능을 보여줍니다.

그 결과, QwQ-32B는 여러 주요 벤치마크에서 상위 모델과 비슷하거나 더 나은 성능을 보였습니다. 특히 주목할 만한 점은 QwQ-32B보다 훨씬 더 많은 파라미터를 가진 DeepSeek-R1에 대해서도 여전히 경쟁력을 유지하고 있어 모델 성능 향상에 있어 강화 학습의 큰 잠재력을 입증하고 있다는 점입니다.

강화 학습

QwQ-32B의 뛰어난 성능은 상당 부분 강화 학습(RL) 기술 덕분입니다. 간단히 말해, 강화 학습은 보상 또는 처벌 메커니즘을 통해 모델이 주어진 환경에서 최적의 결정을 내리는 방법을 학습하도록 유도하는 방법입니다. 기존의 지도 학습과 달리 강화 학습은 대량의 레이블이 지정된 데이터에 의존하지 않고 환경과 상호작용하며 시행착오를 통해 학습하여 궁극적으로 작업을 완료하는 데 필요한 전략을 습득합니다.

알리윤의 연구팀은 QwQ-32B를 훈련하는 동안 콜드 스타트 체크포인트에서 시작하여 결과 보상에 기반한 강화 학습 확장 방법을 구현했습니다. 초기 단계에서는 수학 및 코드 작업에 대한 RL 확장에 집중했습니다. 연구팀은 기존의 보상 모델에 의존하는 대신 수학 문제에 정확도 검증기를 사용하여 최종 정답의 정확성을 보장하고 코드 실행 서버를 사용하여 생성된 코드가 사전 정의된 테스트 케이스를 성공적으로 통과했는지 평가했습니다.

훈련이 진행됨에 따라 수학 및 코드 영역 모두에서 모델의 성능이 지속적으로 향상되었습니다. 첫 번째 단계가 끝난 후 연구팀은 일반 기능에 대한 RL 훈련 단계를 추가했습니다. 이 훈련 단계에서는 일반 보상 모델의 보상 신호와 여러 규칙 기반 유효성 검사기를 사용했습니다. 실험 결과에 따르면 몇 단계의 RL 훈련만으로도 수학적 및 코딩 능력에 큰 성능 저하를 일으키지 않고도 지침 준수, 인간 선호도 정렬, 에이전트 성능 측면에서 모델의 범용 기능을 효과적으로 개선할 수 있습니다.

다음은 Qwen-2.5-3B의 추론 능력이 뛰어난 이유에 대한 기사입니다:빅 모델은 어떻게 "더 똑똑해지나요?" 스탠포드 대학이 자기 계발의 핵심인 네 가지 인지 행동을 밝혀냈습니다.

사용 가이드라인

최적의 성능을 위해 다음 설정을 권장합니다:

- 모델이 출력에 대해 생각하도록 강제:: 모델이 다음을 사용하여 모델링되었는지 확인합니다.

<think>\n를 사용하면 출력물의 품질을 떨어뜨릴 수 있는 공허한 생각 콘텐츠를 생성하지 않게 됩니다. 만약apply_chat_template를 설정하고add_generation_prompt=True이 기능은 자동으로 구현됩니다. 그러나 이 경우 응답이 시작될 때 응답이 누락될 수 있습니다.<think>라벨링은 정상입니다. - 샘플링 매개변수:

- 활용

Temperature=0.6노래로 응답TopP=0.95끝없는 반복을 피하기 위해 욕심 많은 디코딩 대신. - 활용

TopK희귀한 것을 걸러내기 위해 20에서 40 사이 토큰 가 나타나며, 생성된 출력의 다양성을 유지합니다.

- 활용

- 표준화된 출력 형식벤치마킹할 때 프롬프트 프롬프트를 사용하여 모델 출력을 표준화하는 것이 좋습니다.

- 수학 문제프롬프트에 "단계별로 추론하고 최종 답은 \boxed{} 안에 입력하세요."를 추가합니다. " (단계별로 추론하고 최종 답은 \boxed{} 안에 입력하세요.

- 객관식 문제프롬프트에 다음 JSON 구조를 추가하여 응답을 표준화합니다."선택 사항을 표시하세요.

answer필드에 선택 문자만 입력합니다(예:.\"answer\": \"C\". "(다음 내용을answer필드에는 선택 항목이 표시되며 선택 문자만 포함됩니다(예\"answer\": \"C\").

- 긴 입력 처리32,768개 이상의 토큰을 입력하는 경우 YaRN 기술을 사용하여 모델이 긴 시퀀스 정보를 효과적으로 캡처하는 능력을 향상시킵니다.

지원되는 프레임워크의 경우 다음을 추가할 수 있습니다. config.json 파일을 사용하여 YaRN을 활성화합니다:

{

...,

"rope_scaling": {

"factor": 4.0,

"original_max_position_embeddings": 32768,

"type": "yarn"

}

}

배포의 경우 vLLM을 권장합니다. vLLM에 익숙하지 않은 경우 다음을 참조하세요. 공식 문서 을 입력하면 사용법을 확인할 수 있습니다. 현재 vLLM은 입력 길이가 변경되어도 스케일링 계수가 일정하게 유지되는 정적 YARN만 지원합니다.이는 짧은 텍스트를 처리할 때 모델의 성능에 영향을 줄 수 있습니다.. 따라서 긴 컨텍스트는 처리해야 할 때만 추가하는 것이 좋습니다. rope_scaling 구성.

QwQ-32B 사용 방법(QwQ-32B 사용)

다음의 간단한 예는 허깅 페이스 트랜스포머와 AliCloud DashScope API를 통해 QwQ-32B 모델을 사용하는 방법을 보여줍니다.

포옹하는 얼굴 트랜스포머를 통해

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "Qwen/QwQ-32B"

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype="auto",

device_map="auto"

)

tokenizer = AutoTokenizer.from_pretrained(model_name)

prompt = "How many r's are in the word \"strawberry\""

messages = [

{"role": "user", "content": prompt}

]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

model_inputs = tokenizer([text], return_tensors="pt").to(model.device)

generated_ids = model.generate(

**model_inputs,

max_new_tokens=32768

)

generated_ids = [

output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids)

]

response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0]

print(response)

알리클라우드 대시스코프 API를 통해.

from openai import OpenAI

import os

# Initialize OpenAI client

client = OpenAI(

# If the environment variable is not configured, replace with your API Key: api_key="sk-xxx"

# How to get an API Key:https://help.aliyun.com/zh/model-studio/developer-reference/get-api-key

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"

)

reasoning_content = ""

content = ""

is_answering = False

completion = client.chat.completions.create(

model="qwq-32b",

messages=[

{"role": "user", "content": "Which is larger, 9.9 or 9.11?"}

],

stream=True,

# Uncomment the following line to return token usage in the last chunk

# stream_options={

# "include_usage": True

# }

)

print("\n" + "=" * 20 + "reasoning content" + "=" * 20 + "\n")

for chunk in completion:

# If chunk.choices is empty, print usage

if not chunk.choices:

print("\nUsage:")

print(chunk.usage)

else:

delta = chunk.choices[0].delta

# Print reasoning content

if hasattr(delta, 'reasoning_content') and delta.reasoning_content is not None:

print(delta.reasoning_content, end='', flush=True)

reasoning_content += delta.reasoning_content

else:

if delta.content != "" and is_answering is False:

print("\n" + "=" * 20 + "content" + "=" * 20 + "\n")

is_answering = True

# Print content

print(delta.content, end='', flush=True)

content += delta.content

향후 작업

QwQ-32B의 출시는 Qwen 모델 제품군으로 추론을 강화하기 위해 강화 학습(RL)을 확장하는 초기 단계이지만 중요한 단계입니다. 이러한 탐색을 통해 알리윤은 강화 학습의 확장 적용에 대한 엄청난 잠재력을 목격했을 뿐만 아니라 사전 학습된 언어 모델 내에서 아직 개발되지 않은 잠재력도 인식했습니다.

알리윈은 차세대 '천 개의 질문' 모델의 개발을 앞두고 자신감을 갖고 있습니다. 더욱 강력한 기본 모델과 확장된 컴퓨팅 리소스로 구동되는 강화 학습 기술을 결합함으로써 일반 인공 지능(AGI)의 궁극적인 목표를 가속화할 수 있을 것으로 기대하고 있습니다. 또한, 알리클라우드는 더 긴 범위의 추론 기능을 구현하기 위해 에이전트와 RL의 심층적인 통합을 적극적으로 모색하고 있으며, 추론 지점에서의 확장을 통해 더 큰 지능을 실현하기 위해 최선을 다하고 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...