일반 소개

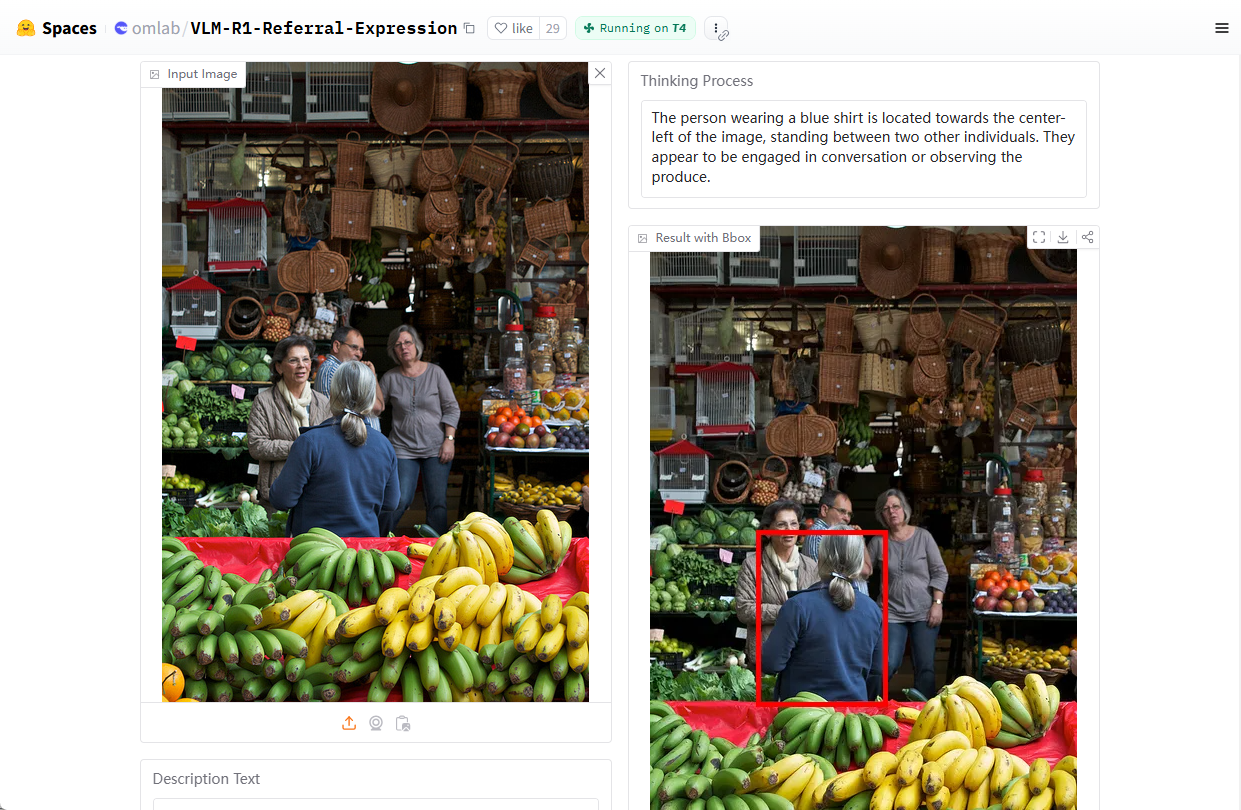

VLM-R1은 Om AI Lab에서 개발한 오픈 소스 시각 언어 모델링 프로젝트로 GitHub에서 호스팅되고 있습니다. 이 프로젝트는 다음을 기반으로 합니다. DeepSeek R1 방법과 결합된 Qwen2.5-VL VLM-R1은 특히 "사진에서 빨간 컵은 어디에 있나요?"와 같은 질문에 답하고 이미지에서 대상을 정확히 찾아내는 등 REC(표현 이해력)를 처리하는 데 능숙합니다. 타겟. 이 프로젝트는 개발자와 연구자가 시각 언어 작업을 탐색하고 개발할 수 있도록 상세한 설치 스크립트, 데이터 세트 지원, 교육 코드를 제공합니다. 2025년 2월 현재 이 프로젝트는 2,000개에 가까운 GitHub 해시태그를 기록하며 멀티모달 AI에 대한 광범위한 관심을 입증하고 있습니다.

데모 주소: https://huggingface.co/spaces/omlab/VLM-R1-Referral-Expression

기능 목록

- REC(표현적 이해 표현)를 의미합니다.자연어 명령을 구문 분석하여 이미지에서 특정 대상을 찾는 기능입니다.

- 공동 이미지 및 텍스트 처리이미지와 텍스트 동시 입력을 지원하여 정확한 분석을 생성합니다.

- 향상된 학습 최적화R1 방법으로 학습하여 복잡한 시각적 작업에서 모델 성능을 향상시킵니다.

- 오픈 소스 교육 코드모델을 쉽게 사용자 지정할 수 있도록 전체 교육 스크립트 및 구성 파일이 제공됩니다.

- 데이터 세트 지원내장된 COCO 및 RefCOCO 데이터 세트 다운로드 및 처리 기능으로 개발 프로세스가 간소화됩니다.

- 고성능 추론 지원플래시 어텐션 및 기타 기술과 호환되어 컴퓨팅 효율성을 향상시킵니다.

도움말 사용

설치 프로세스

VLM-R1은 Python 기반 프로젝트로 실행하려면 특정 환경 구성이 필요합니다. 다음은 사용자가 빠르게 시작하는 데 도움이 되는 자세한 설치 및 사용 단계입니다.

1. 환경 준비

- Anaconda 설치시스템 호환성을 보장하기 위해 아나콘다를 사용하여 Python 환경을 관리할 것을 권장합니다. 다운로드: Anaconda 공식 웹사이트. 설치가 완료되면 터미널을 엽니다.

- 가상 환경 만들기터미널에 다음 명령을 입력하여 다음과 같은 이름의 파일을 만듭니다.

vlm-r1Python 3.10 환경:conda create -n vlm-r1 python=3.10

- 활성화 환경: 방금 만든 환경을 활성화합니다:

conda activate vlm-r1

2. 프로젝트 종속성 설치

- 복제 프로젝트: 로컬에서 VLM-R1용 코드 저장소를 다운로드합니다. 터미널을 열고 입력합니다:

git clone https://github.com/om-ai-lab/VLM-R1.git cd VLM-R1 - 설치 스크립트 실행이 프로젝트는

setup.sh종속성 자동 설치를 위한 스크립트입니다. 터미널에서 실행합니다:bash setup.sh이 스크립트는 파이토치, 트랜스포머 등과 같은 핵심 라이브러리를 설치하여 환경이 준비되었는지 확인합니다.

3. 데이터 준비

- COCO 데이터 세트 다운로드VLM-R1은 COCO Train2014 이미지 데이터 세트를 사용하여 훈련되었습니다. 다음 명령을 실행하여 다운로드하고 압축을 풉니다:

wget http://images.cocodataset.org/train2014/train2014.zip unzip train2014.zip -d <your_image_root>압축을 푼 경로를 메모해 두세요.

<your_image_root>이후 구성에 필요합니다. - RefCOCO 라벨링 파일 다운로드RefCOCO 데이터 세트는 표현 작업을 참조하는 데 사용됩니다. 다운로드 링크는 프로젝트 문서에서 찾을 수 있으며, 압축을 풀고 적절한 디렉토리에 넣으세요.

4. 교육 모델

- 교육 매개변수 구성액세스

src/open-r1-multimodal디렉터리에서 트레이닝 스크립트의 매개 변수를 편집합니다. 예시:cd src/open-r1-multimodal수정

grpo_rec.py를 입력하거나 명령을 실행할 때 매개변수를 지정할 수 있습니다. 다음은 명령 예시입니다:torchrun --nproc_per_node=8 --nnodes=1 --node_rank=0 --master_addr="127.0.0.1" --master_port="12346" \ src/open_r1/grpo_rec.py \ --deepspeed local_scripts/zero3.json \ --output_dir output/my_model \ --model_name_or_path Qwen/Qwen2.5-VL-3B-Instruct \ --dataset_name data_config/rec.yaml \ --image_root <your_image_root> \ --max_prompt_length 1024 \ --num_generations 8 \ --per_device_train_batch_size 1 \ --gradient_accumulation_steps 2 \ --logging_steps 1 \ --bf16 \ --torch_dtype bfloat16 \ --num_train_epochs 2 \ --save_steps 100- 매개변수 설명:

--nproc_per_nodeGPU 수, 하드웨어에 맞게 조정할 수 있습니다.--image_root: COCO 데이터 세트 경로로 바꿉니다.--output_dir모델 저장 경로입니다.

- 매개변수 설명:

5. 기능 작동 흐름

REC(표현적 이해 표현)를 의미합니다.

- 테스트 스크립트 실행교육이 완료되면 제공된 테스트 스크립트를 사용하여 모델의 효과를 검증합니다. 입력

src/eval카탈로그:cd src/eval python test_rec_r1.py --model_path <your_trained_model> --image_root <your_image_root> --annotation_path <refcoco_annotation> - 입력 예사진을 업로드하고 "사진 속 파란색 차는 어디에 있나요?"와 같은 질문을 입력합니다. . 모델은 대상 위치의 좌표 또는 설명을 반환합니다.

이미지 및 텍스트 분석

- 입장 준비이미지 파일과 문제 텍스트를 지정된 디렉터리에 배치하거나 스크립트에서 직접 경로를 지정합니다.

- 추론 실행위의 테스트 스크립트를 사용하여 모델은 이미지 콘텐츠(예: 개체 카테고리, 위치 등)에 대한 분석을 출력합니다.

맞춤형 교육

- 데이터 집합 수정자체 데이터 집합을 사용하려면 다음과 같이 편집하세요.

data_config/rec.yaml를 클릭하고 이미지 경로와 레이블이 지정된 파일을 추가합니다. - 하이퍼파라미터 조정권한의 요구 사항을 충족하도록 수정됨

grpo_rec.py학습 속도, 배치 크기 등과 같은 매개 변수는

6. 주의 사항

- 하드웨어 요구 사항리소스가 제한되어 있는 경우 최소 8GB 이상의 RAM이 있는 GPU 또는 그 이하를 사용하는 것이 좋습니다.

num_generations매개변수를 사용하여 메모리 공간을 줄일 수 있습니다. - 디버그 모드훈련 중 설정 가능

export DEBUG_MODE="true"를 클릭하고 자세한 로그를 확인하세요. - 커뮤니티 지원문제가 발생하면 GitHub 이슈 페이지에서 질문하면 Om AI Lab 팀과 커뮤니티에서 도움을 드릴 것입니다.

위의 단계를 따르면 사용자는 비전 작업에 대한 연구를 수행하든 실제 애플리케이션을 개발하든 VLM-R1을 완벽하게 설치 및 사용하여 빠르게 시작하고 강력한 기능을 활용할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...