일반 소개

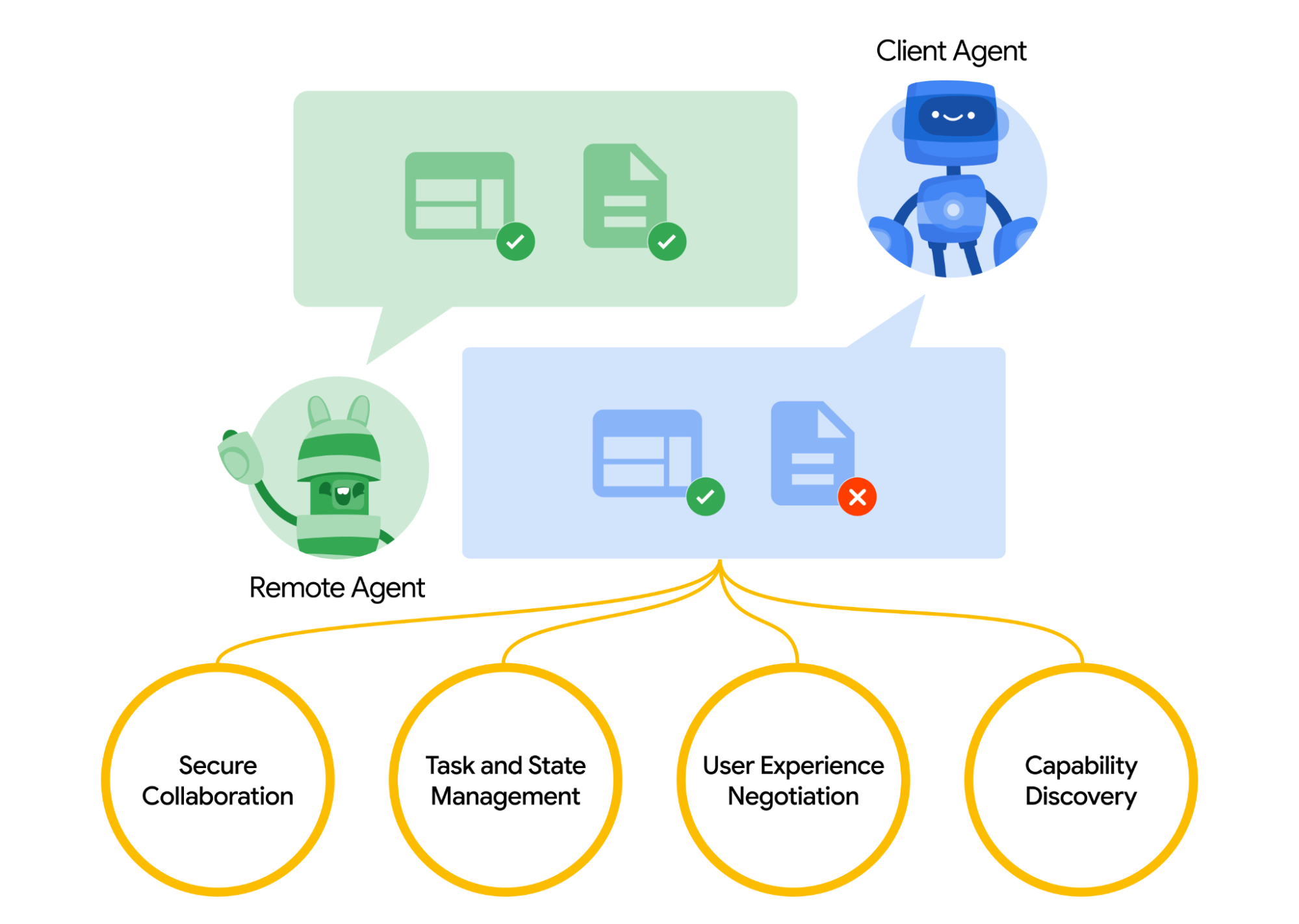

OpenVoice는 참조 화자의 음성을 복사하고 화자의 짧은 오디오 클립만을 사용하여 다국어 음성을 생성할 수 있는 다목적 인스턴트 음성 복제 방법입니다. OpenVoice는 음색을 복제하는 것 외에도 감정, 억양, 리듬, 일시 정지, 억양 등 음성 스타일을 세밀하게 제어할 수 있습니다.

OpenVoice 관련 텍스트 음성 변환 프로젝트: https://github.com/myshell-ai/MeloTTS

이 프로젝트는 데이터 세트를 사용하여 자체적으로 음성을 훈련할 수 있지만 훈련 인터페이스가 없습니다. 즉석 음성 복제와 동일하지 않으며 안정적으로 훈련된 모델을 사용하여 텍스트 음성 변환에 더 중점을 둡니다.

기능 목록

정확한 톤 복제: OpenVoice는 참조 톤을 정확하게 복제하고 여러 언어와 억양으로 음성을 생성할 수 있습니다.

유연한 음성 스타일 제어: OpenVoice를 사용하면 감정, 억양, 리듬, 일시 정지, 억양 등 음성 스타일을 세밀하게 제어할 수 있습니다.

제로 샷 교차 언어 음성 복제: 생성된 음성은 참조 음성과 동일한 언어일 필요도 없고 대규모 다국어 학습 데이터 세트에 제시될 필요도 없습니다.

추천:

1. 정확한 톤 복제. OpenVoice는 참조 톤을 정확하게 복제하고 여러 언어와 억양으로 음성을 생성할 수 있습니다.

2. 유연한 톤 제어. OpenVoice는 음성 스타일(예: 감정, 억양)은 물론 리듬, 일시 정지, 억양 등 기타 문체 매개변수를 세밀하게 제어할 수 있습니다.

3. 제로 샘플 언어 간 음성 복제. 음성이 생성되는 언어나 음성이 참조되는 언어 모두 대규모 화자 다국어 학습 데이터 세트에 존재할 필요는 없습니다.

도움말 사용

자세한 안내는 사용 지침을 참조하세요.

자주 묻는 질문과 답변은 QA에서 확인하시기 바라며, 정기적으로 질문과 답변 목록을 업데이트할 예정입니다.

MyShell에서 신청하세요:즉석 음성 재생 및 음성 합성(TTS) 서비스를 직접 사용하세요.

미니멀리스트 예시:고품질이 아니어도 OpenVoice를 빠르게 경험할 수 있습니다.

Linux 설치:연구자 및 개발자 전용입니다.

Google 콜랩의 빠른 평가판

%cd /content!git clone -b dev https://github.com/camenduru/OpenVoice%cd /content/OpenVoice!apt -y install -qq aria2!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/camenduru/OpenVoice/resolve/main/checkpoints_1226.zip -d /content -o checkpoints_1226.zip!unzip /content/checkpoints_1226.zip!pip install -q gradio==3.50.2 langid faster-whisper whisper-timestamped unidecode eng-to-ipa pypinyin cn2an!python openvoice_app.py --share

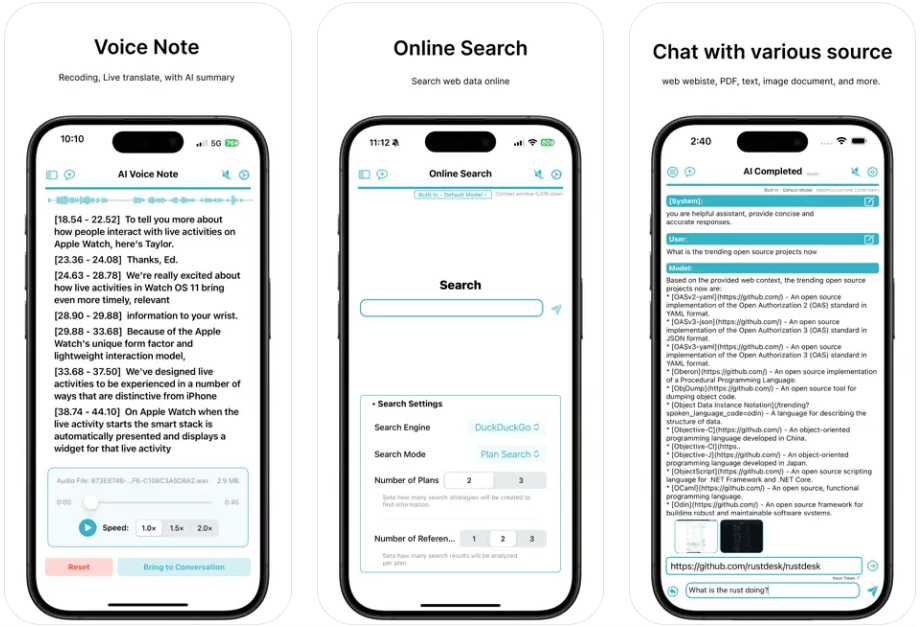

MyShell에서 신청

대부분의 사용자가 무료 TTS 및 라이브 음성 복제 서비스를 가장 편리하게 체험할 수 있는 방법은 MyShell에서 직접 체험하는 것입니다.

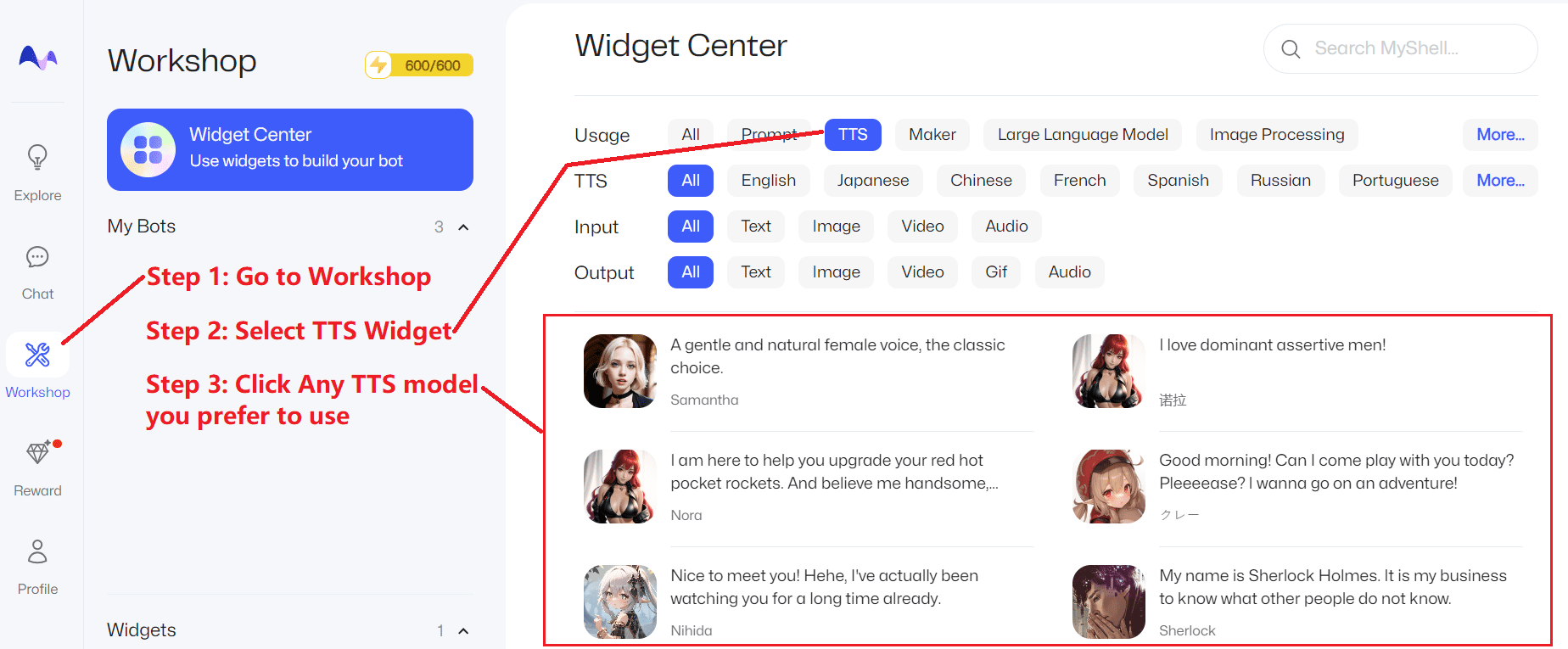

TTS 서비스

여기를 클릭하세요를 클릭하고 아래 단계를 따르세요:

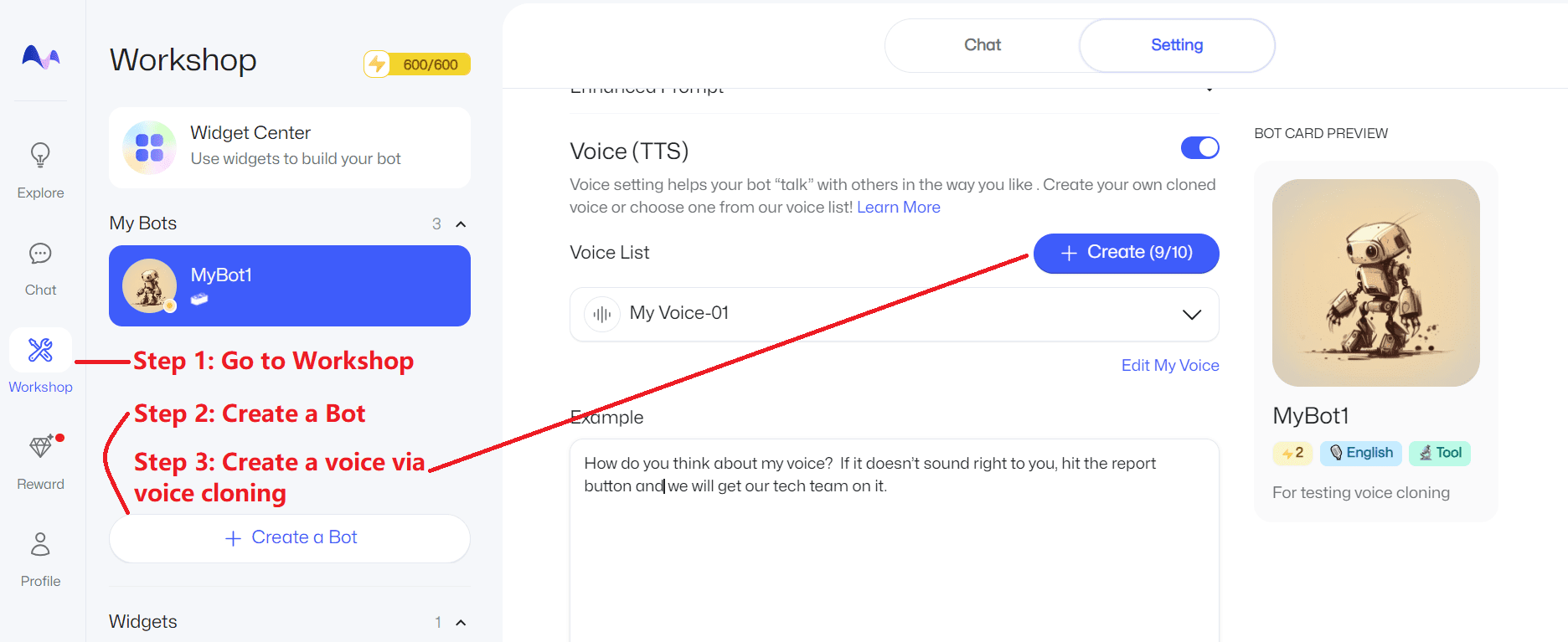

음성 복제

여기를 클릭하세요를 클릭하고 아래 단계를 따르세요:

미니멀리스트 예시

품질이나 안정성이 크게 중요하지 않고 OpenVoice를 빠르게 사용해보고 싶은 분들은 아래 링크 중 하나를 클릭하세요:

렙톤 AI:https://www.lepton.ai/playground/openvoice

MySHell:https://app.myshell.ai/bot/z6Bvua/1702636181

허깅페이스:https://huggingface.co/spaces/myshell-ai/OpenVoice

Linux 설치

이 섹션은 주로 Linux, Python 및 PyTorch에 능숙한 개발자와 연구원을 위한 것입니다. 이 리포지토리를 복제하고 다음을 수행합니다:

conda create -n openvoice python=3.9

콘다 오픈보이스 활성화

git clone git@github.com:myshell-ai/OpenVoice.git

cd OpenVoice

pip 설치 -e .

에서 [다음은 다음과 같습니다.] 체크포인트를 다운로드한 다음 압축을 풀고 체크 포인트 파일(종이)

1. 유연한 음성 스타일 제어:참조 [demo_part1.ipynb]OpenVoice가 복제된 음성의 스타일을 어떻게 제어하는지 알아보세요.

2. 언어 간 음성 복제:를 참조하세요.demo_part2.ipynb]MSML 교육 세트에서 표시되거나 표시되지 않는 언어 데모에 대해 알아보세요.

3. Gradio 데모:여기에서는 최소한의 로컬 그라데이션 시뮬레이션을 제공합니다. 그라데이션 데모에 문제가 있는 경우, 그라데이션 데모에 대한 자세한 내용은 demo_part1.ipynb및demo_part2.ipynb 및 [QnA] 사용 python -m openvoice_app --share 로컬 그라데이션 데모를 시작합니다.

3. 고급 사용자 가이드:기본 음성 모델은 사용자가 선호하는 모든 모델(모든 언어, 모든 스타일)로 대체할 수 있습니다. 데모에 표시된 것처럼 se_extractor.get_se 새 기본 스피커를 위한 톤 임베딩을 추출하는 방법.

4. 자연스러운 음성을 생성하기 위한 제안입니다:자연스러운 음성을 생성하기 위한 단일 또는 다중 화자 TTS 방법은 여러 가지가 있으며, 쉽게 사용할 수 있습니다. 기본 스피커 모델을 원하는 모델로 교체하기만 하면 음성의 자연스러움을 원하는 수준으로 끌어올릴 수 있습니다.

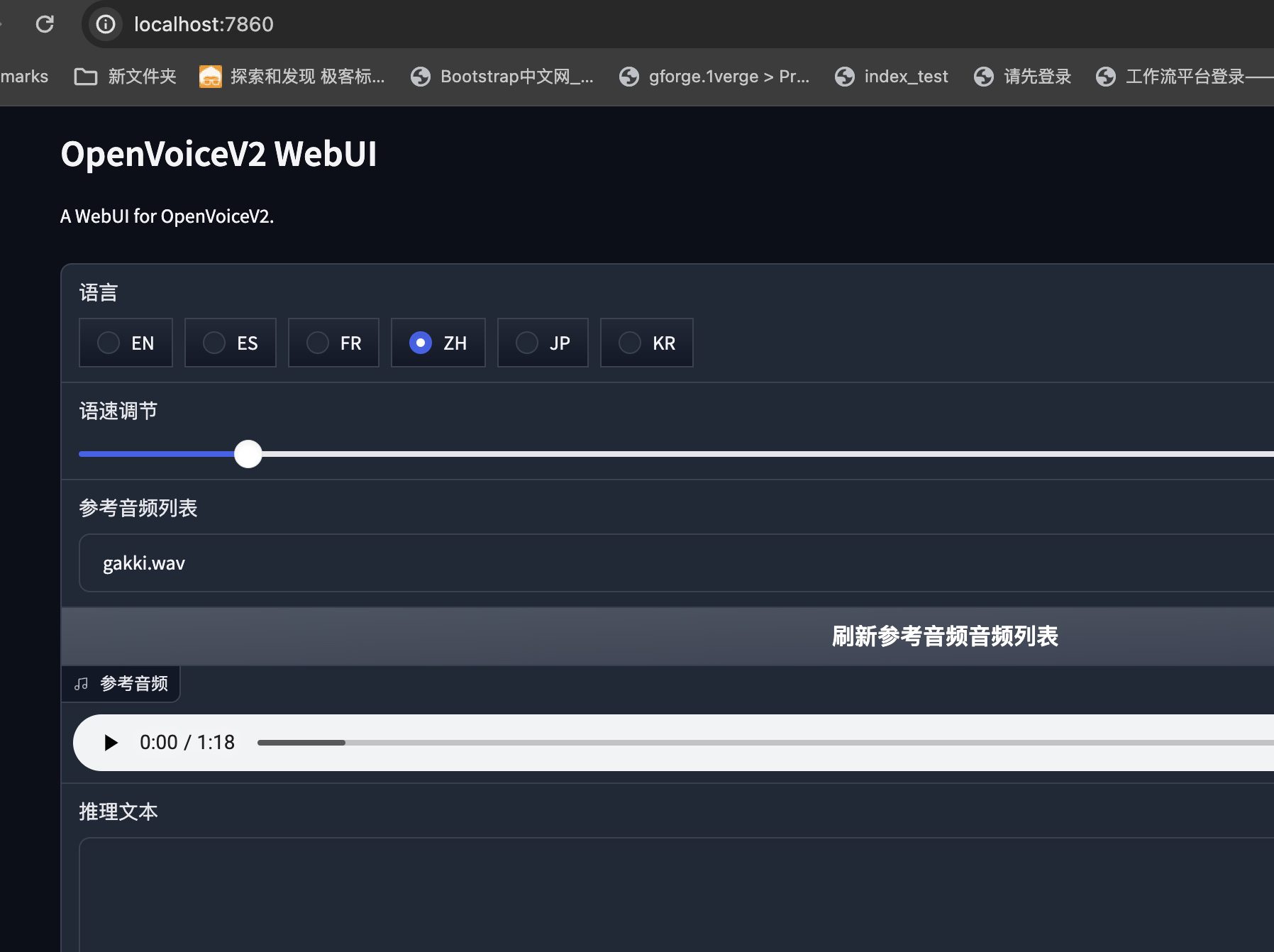

OpenVoiceV2 로컬 배포 튜토리얼, Apple MacOs 배포 프로세스

최근 OpenVoice 프로젝트가 V2 버전을 업데이트하여 새 모델이 중국어 추론에 더 친숙하고 음색이 어느 정도 개선되었으며, 이번에는 Apple의 MacOs 시스템에 V2 버전의 OpenVoice를 로컬로 배포하는 방법을 공유합니다.

먼저 OpenVoiceV2 zip 파일을 다운로드하세요:

OpenVoiceV2-for-mac代码和模型 https://pan.quark.cn/s/33dc06b46699

이 버전은 MacO에 최적화되었으며 중국어 음성의 음량이 수정되었습니다.

압축을 푼 후 먼저 프로젝트 디렉터리의 HF_HOME에서 현재 시스템의 다음 디렉터리로 허브 폴더를 복사합니다:

/Users/当前用户名/.cache/huggingface

이것은 Mac 시스템에서 허깅페이스 모델의 기본 저장 경로이며, 복사하지 않으면 10G 이상의 사전 학습 모델을 처음부터 다운로드해야 하므로 매우 번거롭습니다.

그런 다음 프로젝트의 루트 디렉토리로 돌아가서 명령을 입력합니다:

conda create -n openvoice python=3.10

Python 버전 3.10으로 가상 환경을 만들되, 버전은 3.10만 사용할 수 있습니다.

다음으로 가상 환경을 활성화합니다:

conda activate openvoice

시스템이 반환됩니다:

(base) ➜ OpenVoiceV2 git:(main) ✗ conda activate openvoice

(openvoice) ➜ OpenVoiceV2 git:(main) ✗

활성화에 성공했음을 나타냅니다.

하단 레이어에는 메카브가 필요하므로 설치는 브루를 통해 이루어집니다:

brew install mecab

종속성 설치를 시작합니다:

pip install -r requirements.txt

OpenVoice는 음소 추출만 담당하기 때문에 음성 변환에는 tts 지원도 필요하며, 여기서 기본 종속성은 멜로-tts 모듈에 있습니다.

멜로 디렉토리로 이동합니다:

(openvoice) ➜ OpenVoiceV2 git:(main) ✗ cd MeloTTS

(openvoice) ➜ MeloTTS git:(main) ✗

MeloTTS 종속성을 설치합니다:

pip install -e .

성공하면 사전 파일을 별도로 다운로드해야 합니다:

python -m unidic download

그런 다음 루트 디렉토리로 돌아가 프로젝트를 시작하세요:

python app.py

시스템이 반환됩니다:

(openvoice) ➜ OpenVoiceV2 git:(main) ✗ python app.py

Running on local URL: http://0.0.0.0:7860

IMPORTANT: You are using gradio version 3.48.0, however version 4.29.0 is available, please upgrade.

--------

To create a public link, set `share=True` in `launch()`.

이것으로 MacO에서 OpenVoice 배포가 완료되었습니다.

결론

OpenVoice의 획기적인 기능 중 하나는 제로 샷 언어 간 음성 복제를 수행할 수 있다는 점입니다. 해당 언어에 대한 대량의 화자 훈련 데이터를 제공하지 않고도 훈련 데이터 세트에 포함되지 않은 언어에 음성을 복제할 수 있습니다. 그러나 제로 샷 학습은 일반적으로 풍부한 레이블 데이터를 사용하는 기존의 지도 학습에 비해 알 수 없는 범주, 특히 복잡한 범주에서 정확도가 떨어지는 것이 사실입니다. 보조 정보에 의존하면 노이즈와 부정확성이 발생할 수 있으므로 OpenVoice는 일부 특정 음색에서는 잘 작동하지 않으며 이러한 문제를 해결하려면 기본 양식에 맞게 미세 조정해야 합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...