DeepSeek-R1 복제: 8K 수학적 예제를 통해 소규모 모델이 강화 학습을 통해 추론의 혁신을 이룰 수 있도록 지원합니다.

Github. https://github.com/hkust-nlp/simpleRL-reason

소개

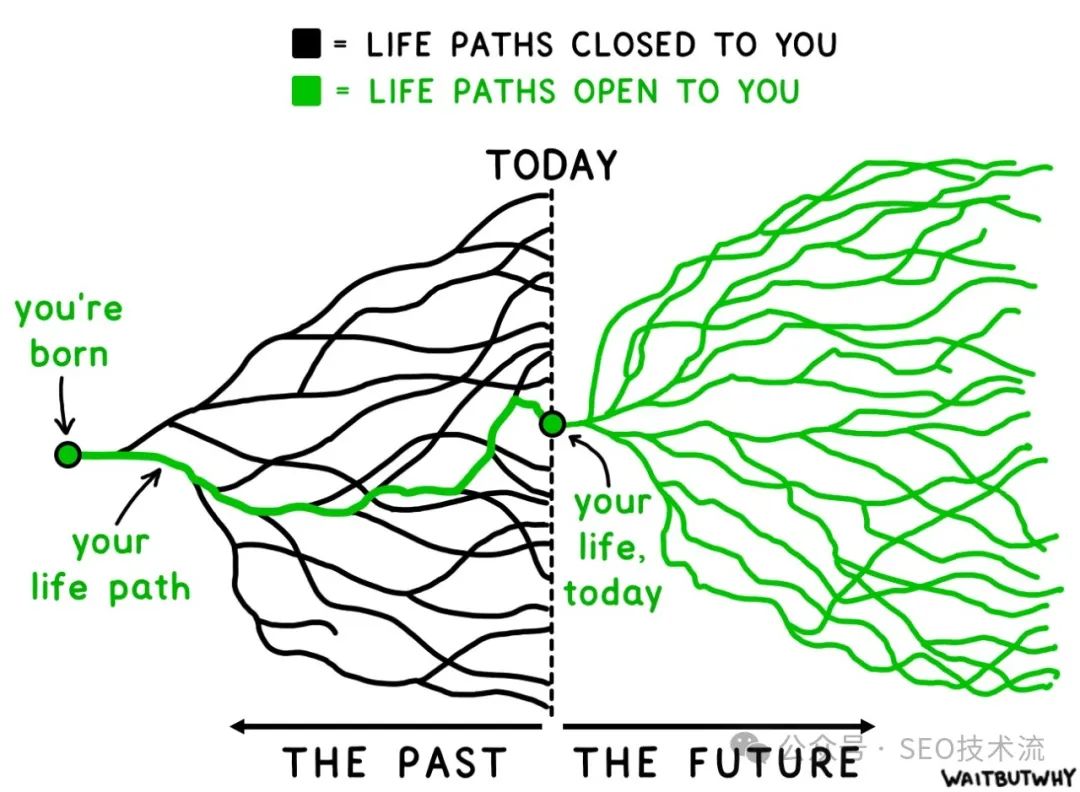

SFT를 수행하거나 보상 모델을 사용하지 않고 Qwen2.5-Math-7B 기본 모델에서 시작하는 Qwen2.5-SimpleRL-Zero 훈련의 동적 변형입니다. 평균 벤치마크 정확도와 길이는 8개의 복잡한 수학적 추론 벤치마크를 기준으로 합니다. 초기 단계에서 길이가 감소하는 것을 관찰했는데, 이는 Qwen2.5-Math-7B 기본 모델이 응답에 언어와 코드를 모두 생성하는 경향이 있어 출력이 길어지는 것을 발견했기 때문입니다. 이 기본 패턴은 모델이 더 적절한 형식으로 출력하는 방법을 학습하는 RL 단계에서 빠르게 억제되었고, 그 후 길이가 규칙적으로 증가하기 시작했습니다. 몇 번의 훈련 단계를 거친 후, DeepSeek-R1 논문에서 '깨달음의 순간'이라고 설명하는 모델 응답의 자기 성찰도 경험했습니다.

많은 연구자들이 증류, MCTS, 프로세스 기반 보상 모델, 강화 학습과 같은 O형 모델을 학습하기 위한 가능한 경로를 모색하고 있습니다. 최근DeepSeek-R1노래로 응답Kimi-k1.5이 목표를 달성하는 과정에서 MCTS와 보상 모델을 사용하지 않고도 간단한 RL 알고리즘을 사용하여 장기간의 연쇄적 사고(CoT)와 자기 성찰의 새로운 패턴을 학습하고 강력한 결과를 얻는 매우 간단한 방법을 시연했습니다. 그러나 이들의 실험은 대규모 RL 설정의 거대한 모델을 기반으로 했습니다. 소규모 모델에서도 유사한 행동을 보여줄 수 있는지, 얼마나 많은 데이터가 필요한지, 정량적 결과가 다른 방법과 어떻게 비교될지는 명확하지 않습니다. 이 블로그에서는 복잡한 수학적 추론에 대한 딥서치-R1-Zero와 딥서치-R1의 훈련을 Qwen-2.5-Math-7B(기본 모델)로 시작하여 규칙 기반 보상 모델링이 적용된 RL용 원본 MATH 데이터 세트의 8K(질의, 최종 답변) 예제만 사용하여 재현해 보았는데, 8K MATH 예제만 사용해도 다른 외부 신호 없이도 7B 기본 모델을 이 정도까지 끌어올릴 수 있다는 사실에 놀랐습니다:

모든 결과는 pass@1 정확도

| AIME 2024 | 수학 500 | AMC | 미네르바 수학 | 올림피아드벤치 | 평균 | |

|---|---|---|---|---|---|---|

| Qwen2.5-Math-7B-Base | 16.7 | 52.4 | 52.5 | 12.9 | 16.4 | 30.2 |

| Qwen2.5-Math-7B-Base + 8K MATH SFT | 3.3 | 54.6 | 22.5 | 32.7 | 19.6 | 26.5 |

| Qwen-2.5-Math-7B-Instruct | 13.3 | 79.8 | 50.6 | 34.6 | 40.7 | 43.8 |

| Llama-3.1-70B-Instruct | 16.7 | 64.6 | 30.1 | 35.3 | 31.9 | 35.7 |

| rStar-Math-7B | 26.7 | 78.4 | 47.5 | - | 47.1 | - |

| Eurus-2-7B-PRIME | 26.7 | 79.2 | 57.8 | 38.6 | 42.1 | 48.9 |

| Qwen2.5-7B-SimpleRL-Zero | 33.3 | 77.2 | 62.5 | 33.5 | 37.6 | 48.8 |

| Qwen2.5-7B-SimpleRL | 26.7 | 82.4 | 62.5 | 39.7 | 43.3 | 50.9 |

Qwen2.5-7B-SimpleRL-Zero는 8K MATH 예제만 사용하여 기본 모델에서 직접 간단한 RL 학습을 수행합니다. 기본 모델에 비해 평균 20점에 가까운 절대적인 성장을 달성합니다. 동일한 8K 데이터 SFT를 사용하는 Qwen2.5-Math-7B-Base와 비교했을 때 RL은 일반화 능력이 더 뛰어나며, 절대적인 측면에서 22% 더 높습니다. 또한 Qwen2.5-7B-SimpleRL-Zero는 평균적으로 Qwen-2.5-Math-7B-Instruct보다 성능이 뛰어나고 최근에 출시되었습니다.Eurus-2-7B-PRIME노래로 응답rStar-Math-7B(또한 Qwen-2.5-Math-7B를 기반으로 함)은 거의 동일합니다. 이러한 기준선에는 보상 모델과 같은 더 복잡한 구성 요소가 포함되어 있으며 최소 50배 이상의 고급 데이터를 사용합니다:

다양한 방법에 대한 비교 데이터

| Qwen2.5-Math-7B-Instruct | rStar-Math-7B | Eurus-2-7B-PRIME | Qwen2.5-7B-SimpleRL-Zero | |

|---|---|---|---|---|

| 기본 모델 | Qwen2.5-Math-7B | Qwen2.5-Math-7B | Qwen2.5-Math-7B | Qwen2.5-Math-7B |

| SFT 데이터 | 250만(오픈 소스 및 인하우스) | ~7.3M(수학, 누미나 수학 등) | 230K | 0 |

| RM 데이터 | 618K(사내) | ~7k(사내) | 0 | 0 |

| RM | Qwen2.5-Math-RM(72B) | 없음 | Eurus-2-7B-SFT | 없음 |

| RL 데이터 | 66K 쿼리 × 32개 샘플 | ~3.647 M × 16 | 150만 쿼리 × 샘플 4개 | 8K 쿼리 × 8개의 샘플 |

8K MATH 예제만으로 상당한 성장을 달성한 것에 대해 기쁘면서도 놀랍습니다. 특히, **수학 쿼리는 AIME나 AMC와 같은 까다로운 벤치마크보다 훨씬 쉽게 수행할 수 있음에도 불구하고, 이 간단한 RL 공식은 상당한 일반화 능력을 보여주며 기본 모델에 비해 절대적으로 최소 10점 이상의 성능을 향상시켰습니다. **이러한 일반화 효과는 동일한 데이터 세트에 대해 표준 SFT 학습을 수행했을 때는 예측할 수 없었던 것입니다. 우리는 커뮤니티가 추론을 위한 RL의 잠재력을 더욱 탐구할 수 있는 강력한 기준 설정이 되기를 바라며 훈련 코드와 세부 사항을 완전히 오픈 소스화했습니다.

다음에는 설정의 세부 사항과 긴 CoT 및 자기반성 패턴의 출현과 같은 RL 훈련 과정에서 일어나는 일에 대해 자세히 알아보겠습니다.

간단한 RL 레시피

DeepSeek R1과 마찬가지로, 저희의 RL 공식은 매우 간단하며 보상 모델이나 MCTS와 유사한 기술을 사용하지 않습니다. 생성된 응답의 형식과 정확성에 따라 보상을 할당하는 규칙 기반 보상 기능과 함께 PPO 알고리즘을 사용합니다:

- 답변이 지정된 형식의 최종 정답을 제공하고 정답이 맞으면 +1 보너스가 지급됩니다.

- 응답이 최종 정답을 제공하지만 오답인 경우 보상은 -0.5로 설정됩니다.

- 응답이 최종 답변을 제공하지 못하면 보상은 -1로 설정됩니다.

구현은 다음을 기반으로 합니다.OpenRLHF. 예비 실험에 따르면 이 보상 함수는 전략 모델이 원하는 형식의 응답을 생성하기 위해 빠르게 수렴하는 데 도움이 됩니다.

실험 설정

실험을 통해 우리는Qwen2.5-Math-7B-BaseAIME2024, AMC23, GSM8K, MATH-500, 미네르바 수학, 올림피아드 벤치 등 까다로운 수학적 추론 벤치마크에서 모델을 시작하고 평가했습니다. 훈련은 난이도 3~5의 MATH 훈련 데이터 세트에서 약 8,000개의 쿼리를 사용해 수행했습니다. 딥서치-R1-Zero와 딥서치-R1에 따라 각각 다음 두 가지 설정으로 실험을 진행했습니다:

- SimpleRL-ZeroSFT를 먼저 수행하지 않고 기본 모델에서 바로 RL을 수행합니다. 8K MATH(질의, 응답) 쌍만 사용합니다.

- SimpleRL먼저 콜드 스타트로 SFT를 생각하는 긴 체인을 수행합니다. SFT 데이터는 QwQ-32B-Preview에서 추출한 응답이 포함된 8K MATH 쿼리입니다. 그런 다음 RL 공식에 동일한 8K MATH 예제를 사용합니다.

1부: SimpleRL-Zero - 처음부터 집중적으로 학습하기

소개 섹션에서 8K MATH 예제만 사용함에도 불구하고 Qwen2.5-Math-7B-Instruct보다 성능이 뛰어나고 PRIME 및 rStar-Math와 비슷한 결과를 달성한 SimpleRL-Zero의 주요 결과를 보고했습니다. 아래에서 훈련 역학 및 몇 가지 흥미로운 신흥 패턴을 공유합니다.

교육 역학

교육 인센티브 및 전개 응답 길이

8개 벤치마크의 정확도(통과율@1) 및 응답 길이 평가

위 그림에서 볼 수 있듯이 모든 벤치마크의 정확도는 훈련 중에 꾸준히 증가하는 반면, 길이는 처음에는 감소했다가 점차 증가합니다. 추가 조사 결과, Qwen2.5-Math-7B 기본 모델은 처음에 많은 양의 코드를 생성하는 경향이 있으며, 이는 모델의 원래 학습 데이터 분포 때문일 수 있습니다. RL 학습이 점차 이 패턴을 제거하고 일반 언어로 추론하는 방법을 학습하기 때문에 처음에는 길이가 줄어드는 것으로 나타났습니다. 그 후 다음 예시와 같이 생성 길이가 다시 증가하기 시작하고 자기 반영 패턴이 나타나기 시작합니다.

자기 성찰의 출현

약 40단계에서 모델이 자기반성적 패턴을 생성하기 시작하는데, 이를 DeepSeek-R1 논문의 '깨달음의 순간'이라고 합니다. 아래에서 그 예를 보여드리겠습니다.

파트 II: SimpleRL - 모방 워밍업 연습을 통한 집중 학습

앞서 언급했듯이, RL로 진행하기 전에 장시간의 체인씽킹 SFT로 워밍업을 했으며, SFT 데이터 세트는 QwQ-32B-Preview에서 추출한 응답이 포함된 8K MATH 예제였습니다. 이 콜드 스타트의 잠재적 이점은 모델이 긴 체인씽크 모드에서 시작하여 이미 자기 반성적이기 때문에 RL 단계에서 더 빠르고 더 잘 학습할 수 있다는 것입니다.

주요 결과

| AIME 2024 | 수학 500 | AMC | 미네르바 수학 | 올림피아드벤치 | 평균 | |

|---|---|---|---|---|---|---|

| Qwen2.5-Math-7B-Base | 16.7 | 52.4 | 52.5 | 12.9 | 16.4 | 30.2 |

| Qwen2.5-Math-7B-Base + 8K QwQ 증류 | 16.7 | 76.6 | 55.0 | 34.9 | 36.9 | 44.0 |

| Eurus-2-7B-PRIME | 26.7 | 79.2 | 57.8 | 38.6 | 42.1 | 48.9 |

| Qwen2.5-7B-SimpleRL-Zero | 36.7 | 77.4 | 62.5 | 34.2 | 37.5 | 49.7 |

| Qwen2.5-7B-SimpleRL | 26.7 | 82.4 | 62.5 | 39.7 | 43.3 | 50.9 |

Qwen2.5-Math-7B-Base + 8K QwQ 증류와 비교했을 때, 이 모델은 RL 훈련 전 절대적인 측면에서 평균 6.91 TP3T만큼 Qwen2.5-7B-SimpleRL을 향상시켰습니다. 또한, 5개의 벤치마크 중 3개의 벤치마크에서 Qwen2.5-7B-SimpleRL이 Eurus-2-7B-PRIME을 능가하고 Qwen2.5-7B-SimpleRL-Zero를 능가하는 결과를 보였지만, QwQ 증류 단계가 제로 설정보다 큰 이득을 내지 못한 것은 다소 놀랍습니다. 강력한 롱 체인 사고 교사 모델이라는 점을 감안하면요.

교육 역학

교육 인센티브 및 전개 응답 길이

훈련 상태

8개 벤치마크의 정확도(통과율@1) 및 응답 길이 평가

Qwen2.5-SimpleRL의 훈련 역학은 Qwen2.5-SimpleRL-Zero와 비슷해 보입니다. 흥미롭게도, 장시간 연쇄 사고 SFT를 발전시켰음에도 불구하고 RL의 시작 부분에서 여전히 길이가 감소하는 것을 관찰할 수 있습니다. 이는 증류된 QwQ 추론 패턴이 소규모 전략 모델에서 선호되지 않거나 그 용량을 초과하기 때문인 것으로 추정됩니다. 그 결과, 이 모델은 이를 포기하고 스스로 새로운 긴 추론을 개발하는 법을 배웁니다.

결론

단순함은 궁극의 복잡성입니다.

- 레오나르도 다빈치(1452-1519), 이탈리아 르네상스 화가

감사 및 인용

우리가 구현한 강화 학습 알고리즘은 다음을 기반으로 합니다.OpenRLHF에서 확장되었습니다. 우리는vLLM추론을 수행하고 이를 기반으로 알고리즘을 개발합니다.Qwen2.5-Math의 평가 스크립트입니다. 특히, 오픈 소스 커뮤니티에 대한 혁신과 기여에 대해 DeepSeek-R1과 Kimi-k1.5의 개발자들에게 감사의 말씀을 전합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...