-- 대형 모델 API 가격 전쟁, 사용자 경험 최적화 및 기술 포함에 대한 심층적인 논리에 대해 논의합니다.

이미지 출처: DeepSeek 공식 문서

빅 AI 모델 분야의 경쟁이 가열되고 있는 가운데, 딥시크는 최근 자사의 API 서비스를 혁신적으로 사용하는하드 디스크 캐시 기술캐시 히트 부분의 가격을 이전 가격의 10분의 1로 직접 인하하여 다시 한 번 업계 가격의 바닥을 다시 한 번 갱신한 DeepSeek의 가격 조정은 충격적인 것입니다. 오랫동안 빅 모델 기술과 업계 동향에 관심을 가져온 서드파티 리뷰어로서, 저는 딥시크의 이번 조치가 기술 혁신에 따른 비용 혁명일 뿐만 아니라 빅 모델 API 사용자 경험의 심층적인 최적화이자 빅 모델 기술의 일반화를 가속화하는 중요한 단계라고 믿습니다.

기술 혁신: 하드 드라이브 캐시 미묘한 차이와 성능 향상

DeepSeek는 대규모 모델 API의 높은 비용과 대기 시간 문제가 오랫동안 널리 채택되는 데 제약이 되어 왔으며, 사용자 요청에 널리 퍼져 있는 문맥 반복이 이러한 문제의 주요 원인이라는 점을 깊이 인식하고 있습니다. 예를 들어, 여러 라운드의 대화에서는 각 라운드마다 이전 대화 기록을 다시 입력해야 하고, 긴 텍스트 처리 작업에서는 프롬프트에 반복되는 참조가 포함되는 경우가 많습니다. 반복 컴퓨팅 토큰 산술 연산이 낭비되고 지연 시간이 늘어납니다.

이러한 문제점을 해결하기 위해 딥시크는 문맥 기반 하드 드라이브 캐싱 기술을 창의적으로 도입했습니다. 핵심 원리는 대화 기록, 시스템 사전 설정, 몇 장면 예시 등 향후 재사용될 것으로 예상되는 컨텍스트 콘텐츠를 분산 하드 드라이브 어레이에 지능적으로 캐싱하는 것입니다. 사용자가 새 API 요청을 시작하면 시스템은 입력의 접두사 부분이 캐시된 콘텐츠와 일치하는지 자동으로 감지합니다(참고: 캐시에 닿으려면 접두사가 동일해야 함). 일치하는 경우 시스템은 다시 계산하지 않고 고속 하드 드라이브 캐시에서 직접 복제본을 읽어와 지연 시간과 비용을 모두 최적화합니다.

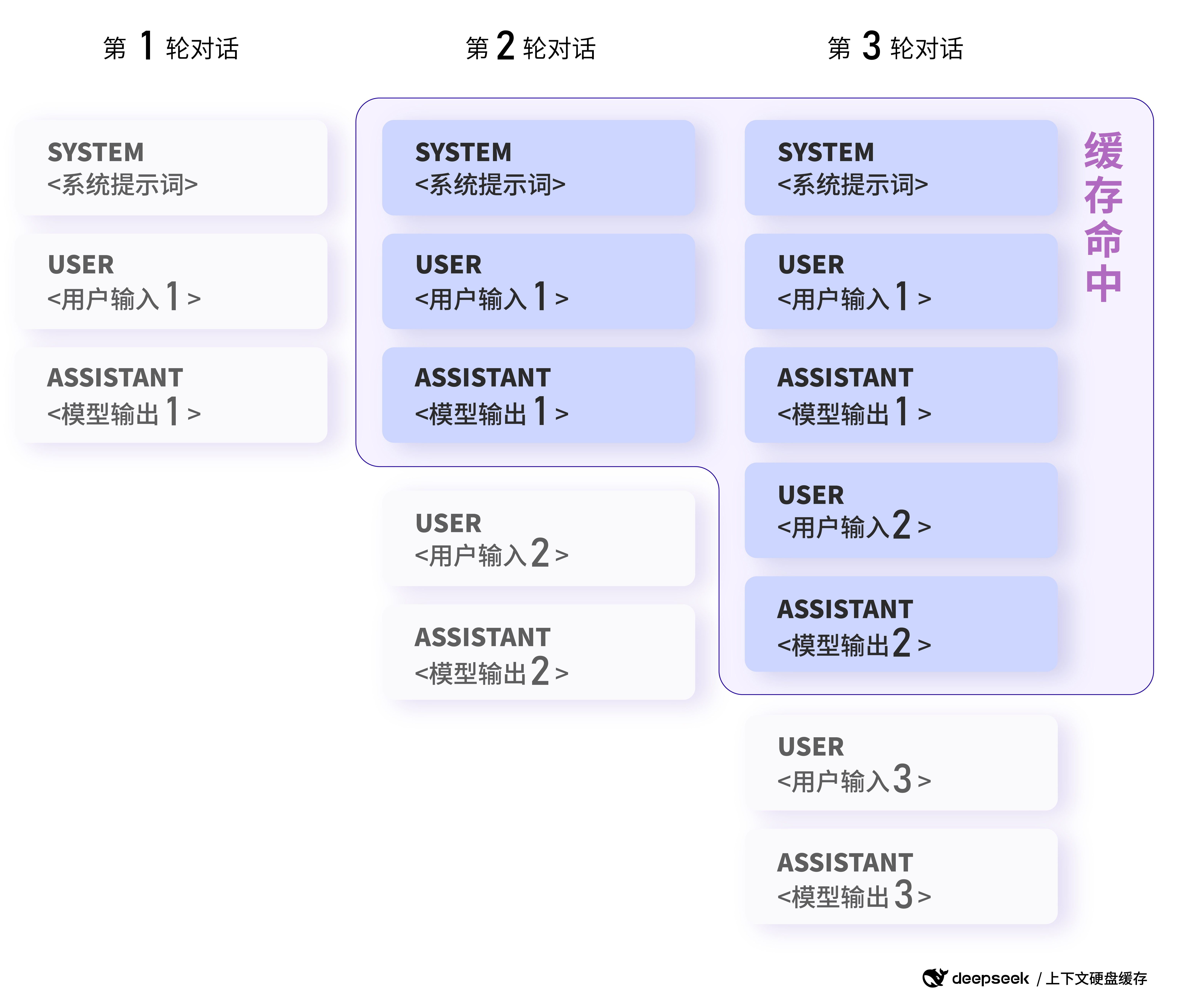

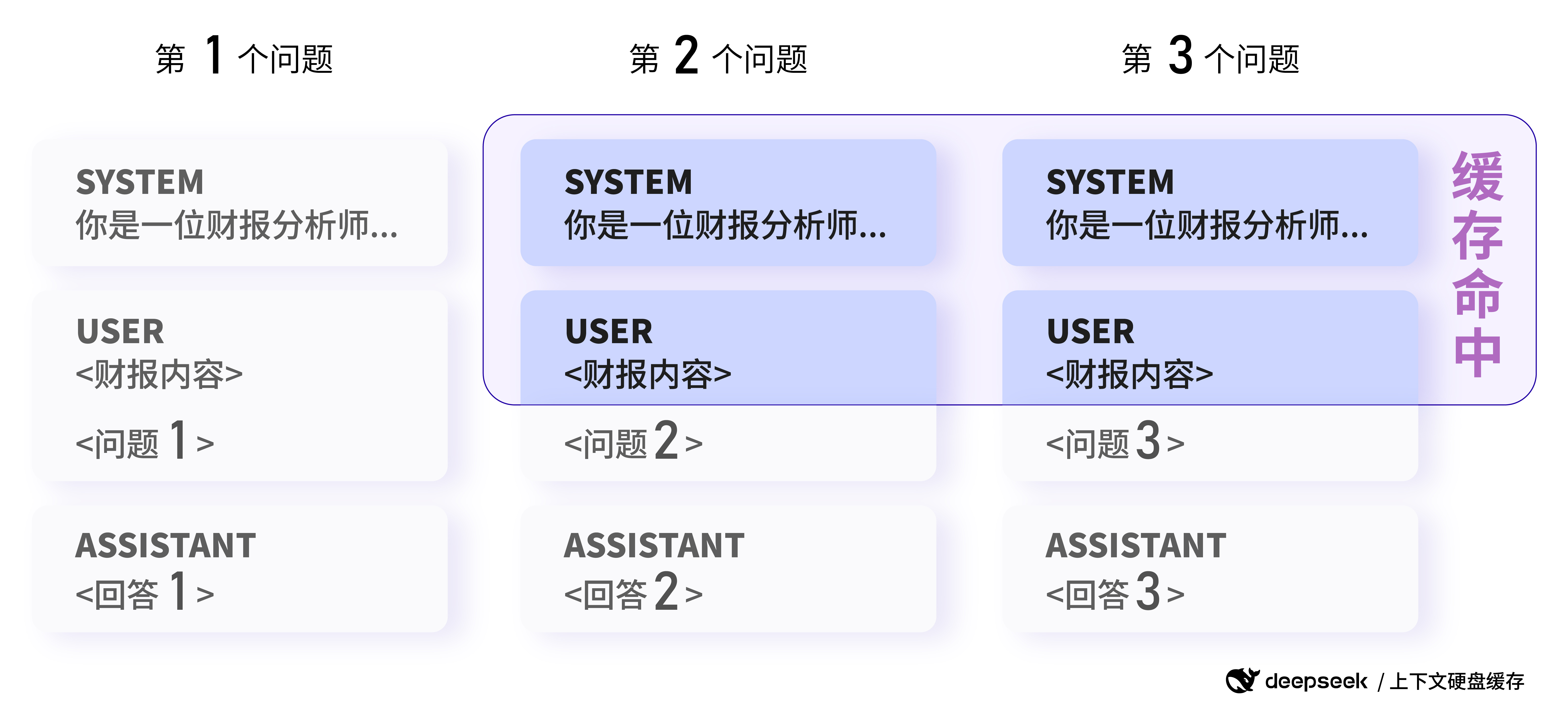

캐싱이 어떻게 작동하는지 더 명확하게 이해하기 위해 몇 가지 예를 살펴보겠습니다. DeepSeek 공식 예시가 제공됩니다:

예 1: 다자간 대화 시나리오

핵심 기능: 후속 대화 라운드가 이전 라운드의 컨텍스트 캐시를 자동으로 불러옵니다.

사용자가 일반적으로 하나의 주제에 대해 연속적으로 질문하는 다중 라운드 대화에서 DeepSeek의 하드 드라이브 캐싱은 대화 컨텍스트를 효율적으로 재사용할 수 있습니다. 예를 들어, 다음 대화 시나리오를 살펴보겠습니다:

첫 번째 요청:

messages: [

{"role": "system", "content": "你是一位乐于助人的助手"},

{"role": "user", "content": "中国的首都是哪里?"}

]

두 번째 요청:

messages: [

{"role": "system", "content": "你是一位乐于助人的助手"},

{"role": "user", "content": "中国的首都是哪里?"},

{"role": "assistant", "content": "中国的首都是北京。"},

{"role": "user", "content": "美国的首都是哪里?"}

]

이미지 출처: DeepSeek 공식 문서

다중 라운드 대화 시나리오에서 캐시 히트의 예: 후속 대화 라운드가 이전 라운드의 컨텍스트 캐시에 자동으로 히트를 기록합니다.

두 번째 요청에서는 접두사 부분(시스템 메시지 + 첫 번째 사용자 메시지)이 첫 번째 요청과 정확히 동일하므로 이 부분은 계산을 반복할 필요 없이 캐시가 처리하므로 지연 시간과 비용이 줄어듭니다.

딥시크의 공식 데이터에 따르면, 128K 입력과 대부분의 반복이 있는 극단적인 시나리오에서 첫 번째 토큰의 측정된 지연 시간이 13초에서 500밀리초로 급감하여 놀라운 성능 향상을 보였습니다. 극단적인 시나리오가 아닌 경우에도 지연 시간을 효과적으로 줄이고 사용자 경험을 개선할 수 있습니다.

또한, DeepSeek의 하드 드라이브 캐싱 서비스는 완전히 자동화되어 있으며 사용자에 독립적입니다. 코드나 API 인터페이스를 변경할 필요 없이 캐싱의 성능과 가격 이점을 누릴 수 있습니다. API가 반환하는 사용량 필드에 새로 추가된 prompt_cache_hit_tokens(캐시 히트)를 통해 사용자는 자신이 받은 캐시 히트 횟수를 확인할 수 있습니다. 토큰 (토큰 수) 및 prompt_cache_miss_tokens(누락된 토큰 수) 필드를 사용하여 캐시 히트를 실시간으로 모니터링하여 캐싱 성능을 더 잘 평가하고 최적화할 수 있습니다.

딥시크가 하드디스크 캐싱 기술을 대규모로 선도적으로 적용할 수 있었던 것은 첨단 모델 아키텍처와 떼려야 뗄 수 없는 관계입니다. 딥시크 V2가 제안한 MLA 구조(Multi-head Latent Attention)는 모델의 성능을 보장하면서 컨텍스트 KV 캐시의 크기를 크게 압축하여 저비용 하드디스크에 KV 캐시를 저장할 수 있게 함으로써 하드디스크 캐시 기술이 시장에 뿌리 내릴 수 있는 토대를 마련했습니다. 이를 통해 저비용 하드디스크에 KV 캐시를 저장할 수 있게 되어 하드디스크 캐싱 기술이 시장에 안착할 수 있는 기반을 마련했습니다.

이해 DeepSeek-R1 API 캐시 히트 대 가격:DeepSeek-R1 API 사용 자주 묻는 질문

응용 시나리오: 긴 텍스트 Q&A부터 코드 분석까지, 그 경계는 무한히 확장 가능합니다!

하드 디스크 캐싱 기술을 사용할 수 있는 시나리오는 매우 다양하며, 컨텍스트 입력이 필요한 거의 모든 대규모 애플리케이션이 이 기술의 이점을 누릴 수 있습니다. 원본 문서에서는 다음과 같은 일반적인 시나리오를 나열하고 보다 구체적인 예를 제공합니다:

- 미리 설정된 긴 프롬프트 단어가 있는 퀴즈 도우미입니다:

- 핵심 기능: 고정 시스템 프롬프트를 캐시하여 요청당 비용을 절감할 수 있습니다.

- 예시:

예 2: 긴 텍스트 Q&A 시나리오

핵심 기능: 동일한 문서를 여러 번 분석하면 캐시에 부하가 걸릴 수 있습니다.

사용자는 동일한 수익 보고서를 분석하고 서로 다른 질문을 해야 합니다:

첫 번째 요청:

messages: [

{"role": "system", "content": "你是一位资深的财报分析师..."},

{"role": "user", "content": "<财报内容>\n\n请总结一下这份财报的关键信息。"}

]

두 번째 요청:

messages: [

{"role": "system", "content": "你是一位资深的财报分析师..."},

{"role": "user", "content": "<财报内容>\n\n请分析一下这份财报的盈利情况。"}

]

두 번째 요청에서는 시스템 메시지와 사용자 메시지의 부분이 첫 번째 요청과 접두사가 같기 때문에 이 부분을 캐시로 처리하여 컴퓨팅 리소스를 절약할 수 있습니다.

- 여러 차례의 대화가 있는 롤플레잉 앱:

- 핵심 기능: 대화 기록의 높은 재사용률과 상당한 캐싱.

- (예제 1에 자세히 표시됨)

- 고정 텍스트 컬렉션에 대한 데이터 분석:

- 핵심 기능: 접두사 반복이 많은 동일한 문서에 대한 여러 분석 및 퀴즈.

- 예를 들어, 동일한 재무 보고서 또는 법률 문서에 대한 여러 분석 및 Q&A 세션이 있습니다. (예시 2에 자세히 나와 있습니다.)

- 코드 리포지토리 수준에서의 코드 분석 및 문제 해결 도구:

- 핵심 기능: 코드 분석 작업에는 대량의 컨텍스트가 포함되는 경우가 많으며, 캐싱은 비용 절감에 효과적일 수 있습니다.

- 단발성 학습:

- 핵심 기능: 프롬프트가 접두사로 붙은 몇 샷 예제를 캐시하여 여러 번의 몇 샷 호출 비용을 줄일 수 있습니다.

- 예시:

예 3: 몇 샷 학습 시나리오

핵심 기능: 동일한 Few-shot 예제를 접두사로 캐시하여 히트할 수 있습니다.

사용자는 역사 지식 퀴즈에서 모델의 효율성을 향상시키기 위해 Few-shot 학습을 사용합니다:

첫 번째 요청:

messages: [

{"role": "system", "content": "你是一位历史学专家,用户将提供一系列问题,你的回答应当简明扼要,并以`Answer:`开头"},

{"role": "user", "content": "请问秦始皇统一六国是在哪一年?"},

{"role": "assistant", "content": "Answer:公元前221年"},

{"role": "user", "content": "请问汉朝的建立者是谁?"},

{"role": "assistant", "content": "Answer:刘邦"},

{"role": "user", "content": "请问唐朝最后一任皇帝是谁"},

{"role": "assistant", "content": "Answer:李柷"},

{"role": "user", "content": "请问明朝的开国皇帝是谁?"},

{"role": "assistant", "content": "Answer:朱元璋"},

{"role": "user", "content": "请问清朝的开国皇帝是谁?"}

]

두 번째 요청:

messages: [

{"role": "system", "content": "你是一位历史学专家,用户将提供一系列问题,你的回答应当简明扼要,并以`Answer:`开头"},

{"role": "user", "content": "请问秦始皇统一六国是在哪一年?"},

{"role": "assistant", "content": "Answer:公元前221年"},

{"role": "user", "content": "请问汉朝的建立者是谁?"},

{"role": "assistant", "content": "Answer:刘邦"},

{"role": "user", "content": "请问唐朝最后一任皇帝是谁"},

{"role": "assistant", "content": "Answer:李柷"},

{"role": "user", "content": "请问明朝的开国皇帝是谁?"},

{"role": "assistant", "content": "Answer:朱元璋"},

{"role": "user", "content": "请问商朝是什么时候灭亡的"},

]

두 번째 요청에서는 동일한 4문항 예제가 접두사로 사용되므로 이 부분은 캐시에 의해 처리되고 마지막 문제만 다시 계산하면 되므로 Few-shot 학습 비용을 크게 줄일 수 있습니다.

이미지 출처: DeepSeek 공식 문서

데이터 분석 시나리오에서 캐시 적중의 예: 동일한 접두사를 가진 요청이 캐시에 적중할 수 있습니다(참고: 여기 이미지는 원래 데이터 분석 예시를 따르며 접두사 중복이라는 개념에 더 중점을 두고 있습니다. Few-shot 예시 시나리오도 같은 방식으로 해석할 수 있습니다).

이러한 시나리오는 빙산의 일각에 불과합니다. 하드 드라이브 캐싱 기술을 적용하면 긴 컨텍스트의 대규모 모델 API를 적용할 수 있는 상상력을 마음껏 펼칠 수 있습니다. 예를 들어, 더 강력한 긴 텍스트 작성 도구를 구축하고, 더 복잡한 지식 집약적 작업을 처리하고, 더 깊고 기억에 남는 대화형 AI 애플리케이션을 개발할 수 있습니다.

참조: 클로드에서 영감을 얻다

처리 효율을 획기적으로 개선하고 비용을 절감하기 위해 API 긴 텍스트 캐시 기능을 혁신한 Claude

간단하고 효과적인 RAG 검색 전략: 희소 + 고밀도 하이브리드 검색 및 재배치, '큐 캐싱'을 사용해 텍스트 청크에 대한 전체 문서 관련 컨텍스트를 생성합니다.

비용 이점: 대형 모델 생태계에 도움이 되도록 가격을 대폭 낮춥니다.

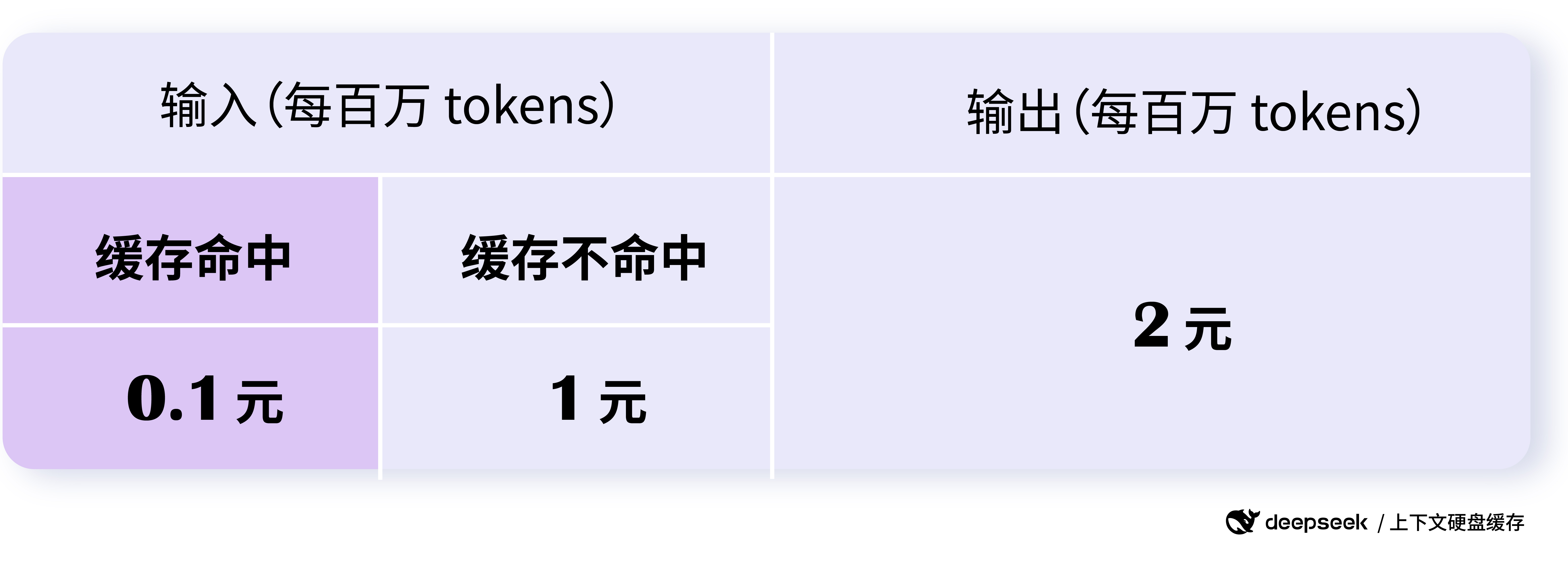

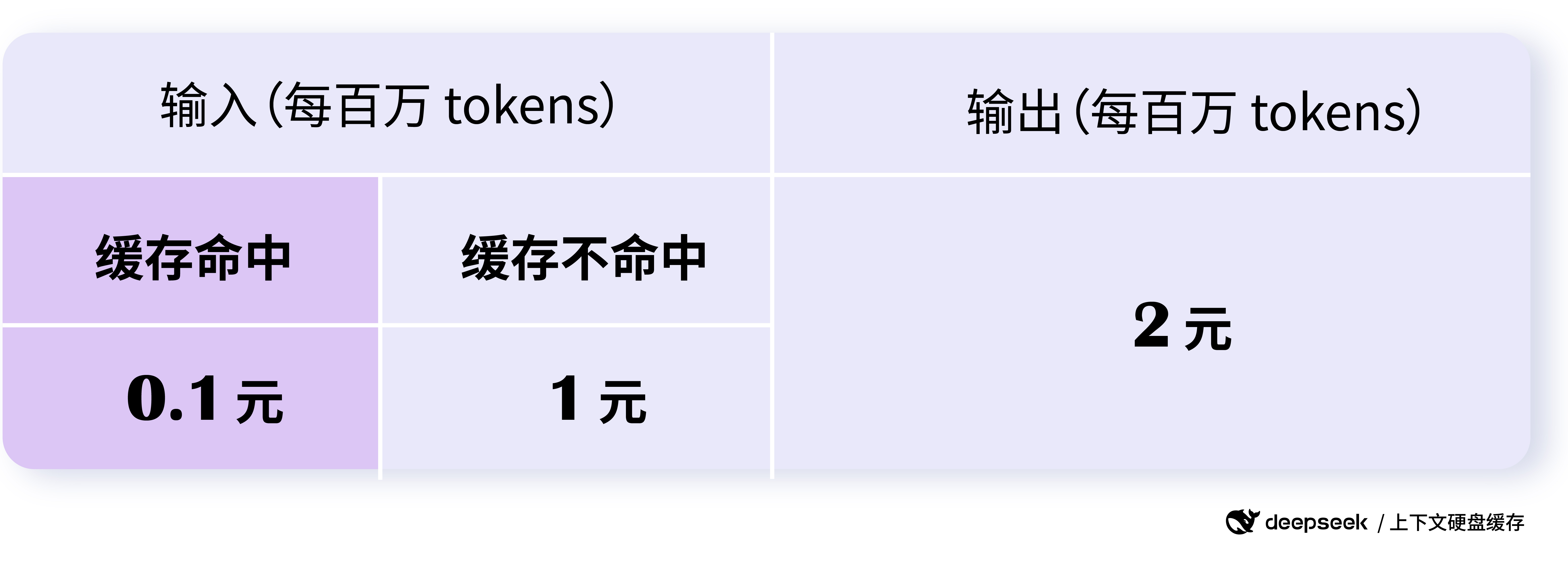

딥시크 API의 가격 조정은 "역대급"으로, 캐시 히트 부분은 100만 토큰당 0.10달러, 미히트 부분은 100만 토큰당 1달러로 책정되었습니다. 캐시 히트의 가격은 100만 토큰당 0.1달러, 미스의 가격은 100만 토큰당 1달러로, 이전 캐시 히트 가격보다 훨씬 낮아졌습니다.

딥시크의 공식 데이터에 따르면 최대 90%까지 절약할 수 있으며, 최적화 없이도 사용자는 전체적으로 50% 이상을 절약할 수 있습니다. 이러한 비용 이점은 대형 모델 적용의 문턱을 낮추고 대형 모델의 대중화를 가속화하는 데 큰 의미가 있습니다.

더욱 흥미로운 점은 DeepSeek의 가격 책정 전략입니다. 사용자가 캐시를 최대한 활용하고 프롬프트 디자인을 최적화하며 캐시 적중률을 높여 비용을 더욱 절감할 수 있도록 캐시 히트와 미스에 대한 가격을 사다리식으로 책정하고 있습니다. 동시에 캐시 서비스 자체나 캐시 저장 공간에 추가 요금이 부과되지 않아 사용자 친화적입니다.

이미지 출처: DeepSeek 공식 문서

딥시크 API 가격이 대폭 인하되어 캐시 히트가 0.1백만 토큰에 불과합니다.

딥서치 API의 대폭적인 가격 인하는 의심할 여지없이 대형 모델 가격 전쟁의 진화를 가속화할 것입니다. 그러나 이전의 단순한 가격 경쟁과는 달리, DeepSeek의 가격 인하는 기술 혁신과 비용 최적화를 기반으로 한 합리적인 가격 인하로, 보다 지속 가능하고 업계 주도적인 가격 인하입니다. 이러한 건전한 가격 경쟁은 궁극적으로 전체 빅모델 생태계에 도움이 될 것이며, 더 많은 개발자와 기업이 더 낮은 비용으로 고급 빅모델 기술을 누릴 수 있게 될 것입니다.

무제한 스트리밍 및 동시 접속, 안전하고 안정적인 캐싱 서비스

성능과 가격적인 이점 외에도 DeepSeek API의 안정성과 보안 또한 신뢰할 수 있습니다. DeepSeek API 서비스는 모든 사용자에게 무제한 스트리밍과 동시성을 제공하는 일일 1조 토큰 용량에 맞춰 설계되어 높은 부하 조건에서 서비스 품질을 보장합니다.

DeepSeek는 데이터 보안에도 만전을 기했습니다. 각 사용자의 캐시는 서로 분리되어 논리적으로 격리되어 있어 사용자 데이터의 보안과 프라이버시를 보장합니다. 오랫동안 사용하지 않은 캐시는 자동으로 비워지며(보통 몇 시간에서 며칠), 장기간 보관하거나 다른 용도로 사용하지 않으므로 잠재적인 보안 위험을 더욱 줄일 수 있습니다.

캐시 시스템은 64개의 토큰을 저장 단위로 사용하며, 64개 미만의 토큰은 캐시되지 않는다는 점에 유의하시기 바랍니다. 또한 캐시 시스템은 "최선의 노력"이며 100% 캐시 히트를 보장하지 않습니다. 또한 캐시 구성에는 몇 초가 걸리지만 긴 컨텍스트 시나리오의 경우 이 정도는 충분히 감수할 수 있습니다.

모델 업그레이드 및 향후 전망

하드 드라이브 캐싱 기술 출시와 함께 딥시크는 딥시크 채팅 모델을 딥시크-V3로, 딥시크 리서처 모델을 딥시크-R1로 업그레이드했다고 발표했습니다. 새로운 모델은 훨씬 저렴한 가격으로 향상된 성능과 기능을 제공하여 딥시크의 경쟁력을 더욱 강화합니다.

공식 가격 정보에 따르면, 2025년 2월 8일 24:00까지 할인된 가격으로 제공되는 DeepSeek-V3 API(deepseek-chat)는 캐시된 히트의 경우 0.1/백만 토큰, 놓친 입력의 경우 1백만 토큰, 출력의 경우 2백만 토큰에 불과합니다. DeepSeek-R1 API(deepseek-reasoner)는 32K 생각 체인 길이와 8K 최대 출력 길이의 추론 모델로, 입력 가격(캐시된 히트)은 1백만 토큰/달러로 포지셔닝되어 있습니다. 딥시크-R1 API(딥시크-추론자)는 32K의 사고 체인 길이와 8K의 최대 출력 길이를 가진 추론 모델로, 캐시된 히트에 대한 입력 가격은 백만 토큰당 1달러, 놓친 입력은 백만 토큰당 4달러, 출력(사고 체인 및 최종 답변의 모든 토큰)은 백만 토큰당 16달러로 책정됩니다. 그리고 최종 정답의 모든 토큰).

딥시크의 일련의 혁신적인 이니셔티브는 지속적인 기술 투자와 사용자 우선 철학을 보여줍니다. 딥시크와 더 많은 혁신의 힘을 통해 빅 모델 기술이 더욱 성숙해지고, 더욱 포용적이며, 모든 산업에 더욱 광범위한 변화를 가져올 것이라고 믿을 만한 충분한 이유가 있습니다.

결론

하드 디스크 캐싱 기술을 혁신적으로 사용하고 가격을 대폭 낮춘 DeepSeek API는 획기적인 돌파구입니다. 이는 빅 모델 API의 오랜 비용 및 지연 시간 문제를 해결할 뿐만 아니라 기술 혁신을 통해 사용자에게 더 나은 품질과 더 포괄적인 빅 모델 서비스를 제공하며, 딥시크의 행보는 빅 모델 API의 경쟁 패턴을 재정의하고 AI 기술의 인기와 적용을 가속화하며 궁극적으로 더 번영하고 개방적이며 포괄적인 빅 모델 생태계를 구축할 수 있을 것입니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...