R 제품군 중 가장 작은 모델로 최고의 속도, 효율성, 품질을 제공하여 일반 GPU 및 엣지 디바이스에서 강력한 AI 애플리케이션을 구축할 수 있습니다.

오늘, 저희는 명령 엔터프라이즈를 위해 특별히 개발된 R 시리즈 LLM(대규모 언어 모델)의 가장 작고 빠르며 마지막 모델인 R7B는 사용자에게 중요한 실제 작업을 처리할 수 있는 동급 개방형 모델에서 업계 최고의 성능을 제공합니다. 이 모델은 속도, 비용 효율성 및 계산 리소스를 최적화해야 하는 개발자와 기업을 위해 설계되었습니다.

R 제품군의 다른 모델과 마찬가지로 Command R7B는 128k의 컨텍스트 길이를 제공하며 몇 가지 중요한 비즈니스 애플리케이션 시나리오에서 탁월한 성능을 발휘합니다. 강력한 다국어 지원, 참조 검증을 거친 검색 증강 생성(RAG), 추론, 도구 사용 및 에이전트 동작이 결합되어 있습니다. 컴팩트한 크기와 효율성 덕분에 저사양 GPU, MacBook, 심지어 CPU에서도 실행할 수 있어 AI 애플리케이션을 프로덕션에 도입하는 데 드는 비용을 크게 절감할 수 있습니다.

작은 패키지에 담긴 고성능

포괄적인 모델

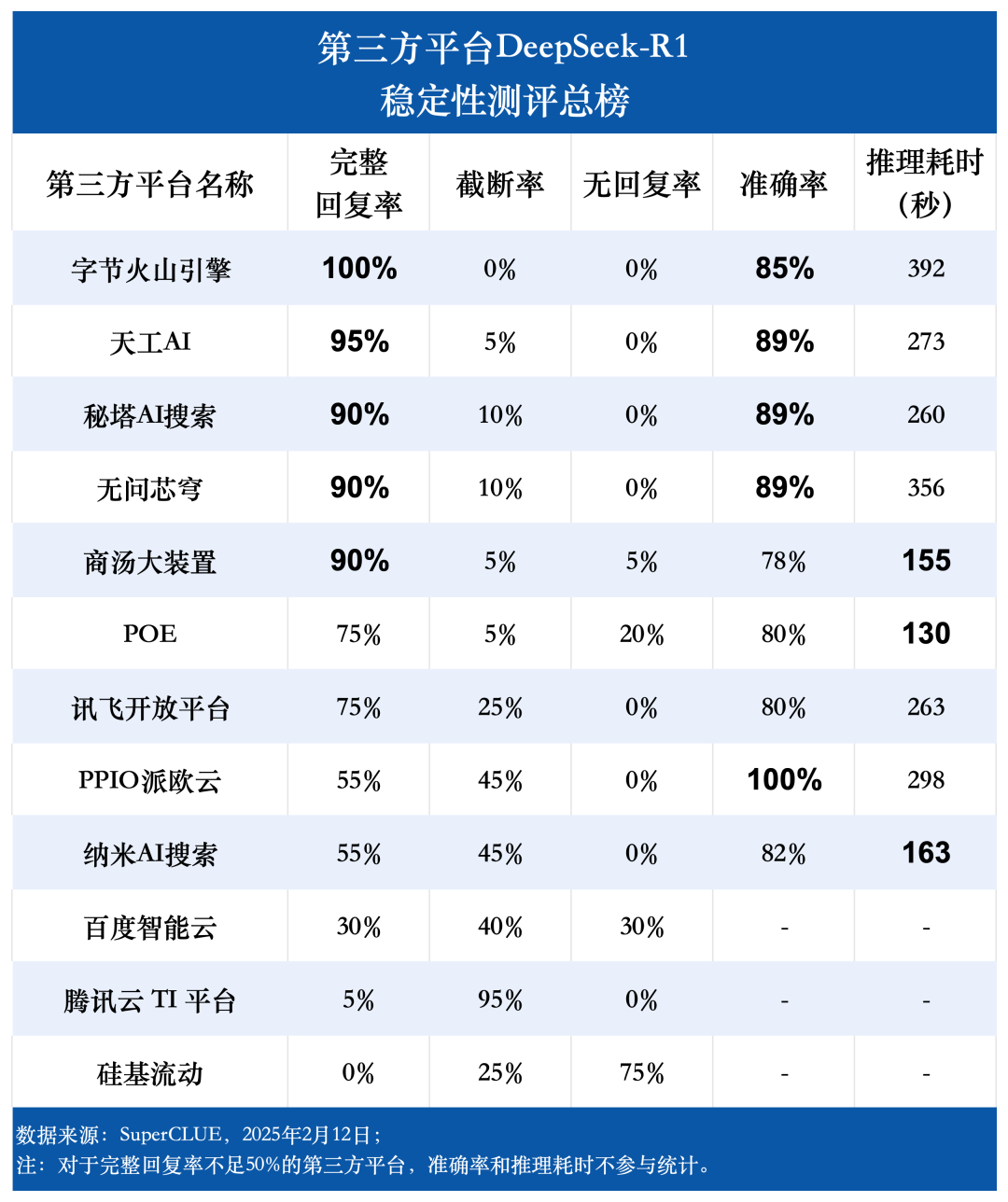

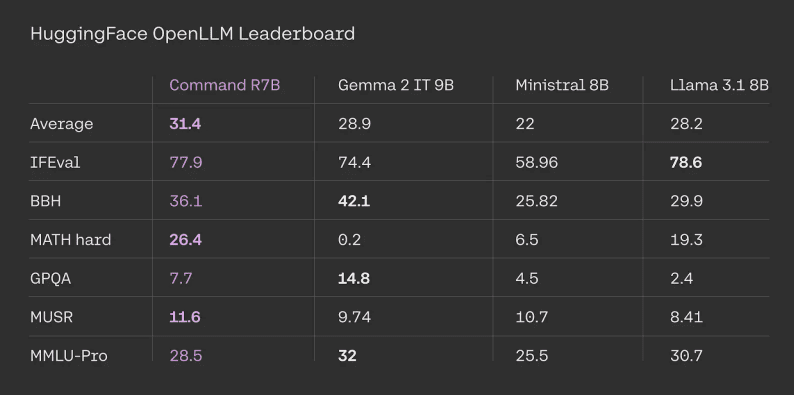

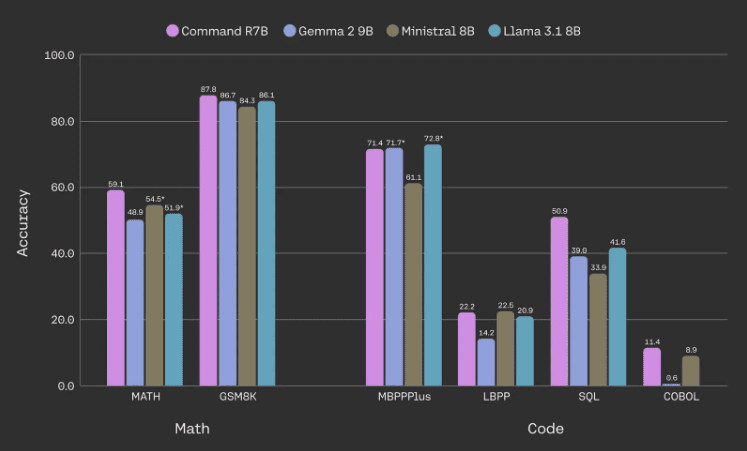

Command R7B는 다음과 같은 표준화되고 외부에서 검증 가능한 벤치마크에서 우수한 성능을 발휘합니다. 허깅페이스 오픈 LLM 리더보드. Command R7B는 비교 가능한 다른 오픈 가중치 모델에 비해 강력한 성능으로 모든 작업에서 평균 1위를 차지했습니다.

허깅페이스 리더보드 평가 결과. 경쟁자의 수치는 공식 순위표에서 가져온 것입니다. Command R7B의 결과는 공식 허깅페이스에서 제공한 팁과 평가 코드를 기반으로 저희가 계산한 것입니다.

수학, 코드 및 추론 작업의 효율성 향상

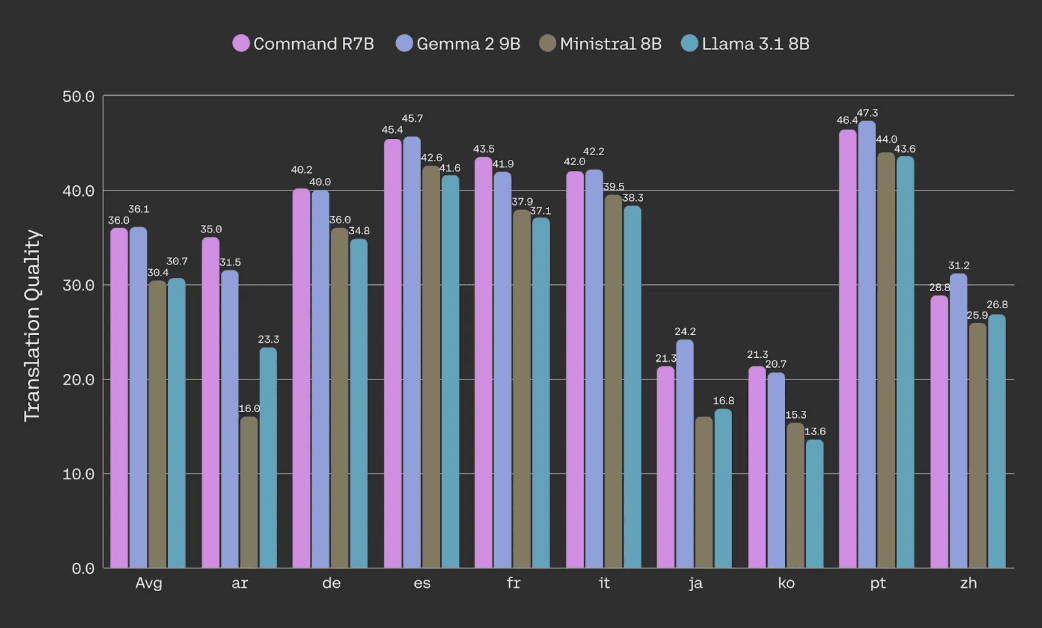

Command R7B의 주요 초점은 수학 및 추론, 코드 작성 및 다국어 작업의 성능을 개선하는 것입니다. 특히 이 모델은 더 적은 매개변수를 사용하면서도 일반적인 수학 및 코드 벤치마크에서 유사한 개방형 가중치 모델의 성능과 일치하거나 능가할 수 있습니다.

수학 및 코드 벤치마킹에서의 모델 성능. 모든 데이터는 내부 평가 결과이며, 별표가 표시된 숫자는 외부에서 보고된 결과 중 더 높은 수치입니다. MBPPPlus의 기본 버전을 사용하고, LBPP는 6개 언어의 평균, SQL은 3개 데이터세트(SpiderDev 및 Test의 고난도 및 초고난도 섹션, BirdBench, 내부 데이터세트)의 평균, COBOL은 자체적으로 개발한 데이터세트입니다.

NTREX 데이터 세트를 사용하여 평가한 문서의 번역 품질(말뭉치 spBLEU 메트릭을 통해).

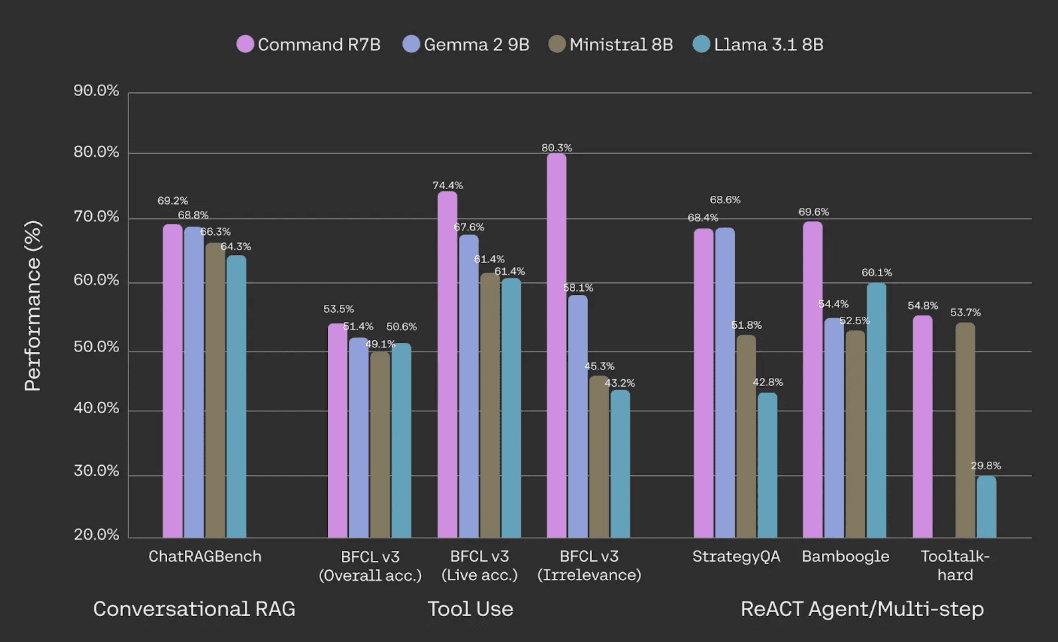

동급 최고의 RAG, 도구 사용 및 인텔리전스

Command R7B는 RAG, 도구 사용 및 AI 인텔리전스와 같은 핵심 비즈니스 애플리케이션을 처리하는 데 있어 비슷한 규모의 다른 개방형 가중치 모델보다 성능이 뛰어납니다. 내부 문서와 데이터를 기반으로 하는 비용 효율적인 모델을 찾는 조직에 이상적입니다. 다른 R 시리즈 모델과 마찬가지로, 저희의 RAG 로컬 인라인 참조가 제공되므로 착각을 크게 줄이고 사실 확인을 더 쉽게 할 수 있습니다.

ChatRAGBench(10개 이상의 데이터 세트 평균), BFCL-v3, StrategyQA, Bamboogle 및 Tooltalk-hard에 대한 성능 평가. 방법론 및 자세한 내용은 아래 각주 [1]을 참조하세요.

툴 사용 측면에서, 비슷한 규모의 모델과 비교했을 때 Command R7B가 산업 표준 측면에서 더 효율적이라는 것을 알 수 있습니다. 버클리 함수 호출 순위표 이는 Command R7B가 실제 세계의 다양하고 동적인 환경에서 도구 사용에 특히 능숙하며 실제 응용 프로그램에서 도구 사용의 중요한 측면인 불필요한 도구 호출을 피할 수 있음을 보여줍니다. 이는 Command R7B가 실제 세계의 다양하고 동적인 환경에서 도구 사용에 특히 능숙하며 실제 애플리케이션에서 도구 사용의 중요한 측면인 불필요한 도구 호출을 피할 수 있음을 보여줍니다.Command R7B의 다단계 도구 사용 능력은 빠르고 효율적인 AI 지능을 지원할 수 있게 해줍니다.

엔터프라이즈 사용 사례를 위한 최적화

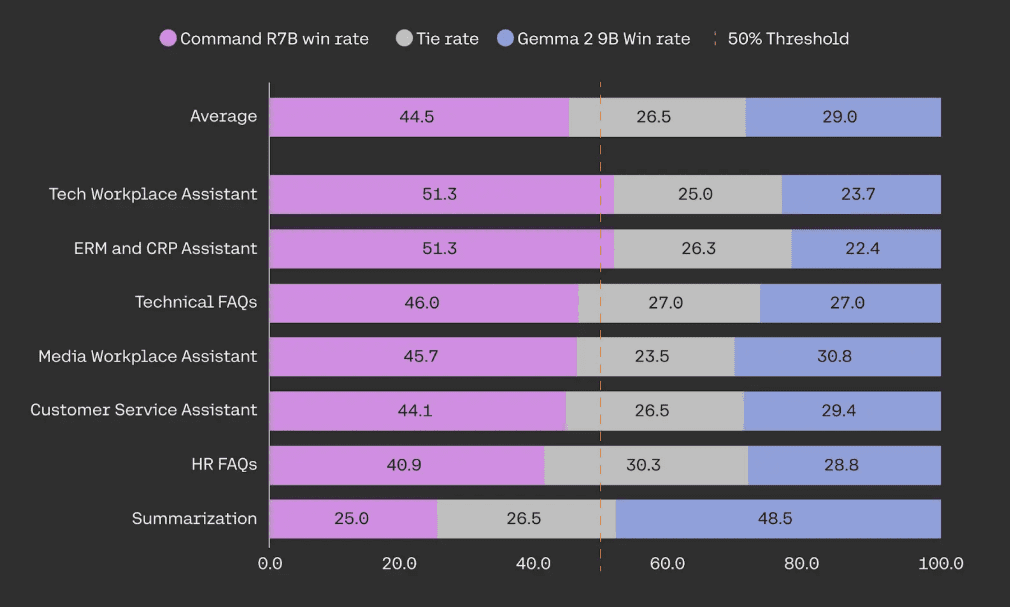

당사의 모델은 조직이 실제 환경에 AI 시스템을 배포할 때 필요한 기능을 충족하도록 최적화되어 있으며, R 시리즈는 효율성과 강력한 성능의 독보적인 균형을 제공합니다. 즉, 품질 평가의 표준인 인적 평가에서 우수한 성능을 보장하며, 고객 서비스, HR, 규정 준수, IT 지원 기능 등 고객이 관심을 갖는 AI 비서 구축을 위한 RAG 사용 사례에 대한 블라인드 일대일 테스트에서 Command R7B는 비슷한 크기의 개방형 가중치 모델보다 우수한 성능을 발휘합니다.

인적 평가에서는 949개의 엔터프라이즈 RAG 사용 사례 샘플에 대해 Gemma 2 9B를 대상으로 Command R7B를 테스트했습니다. 모든 예제는 유창성, 충실도 및 답변 유용성을 평가하기 위해 특별히 훈련된 인간 주석가가 최소 3번의 블라인드 주석을 달았습니다.

효율적이고 빠른

Command R7B의 컴팩트한 크기는 신속한 프로토타이핑과 반복을 위한 작은 서비스 설치 공간을 제공합니다. 챗봇 및 코드 어시스턴트와 같이 처리량이 많은 실시간 사용 사례에서 탁월한 성능을 발휘합니다. 또한 소비자용 GPU 및 CPU와 같은 인프라 배포 비용을 획기적으로 줄여 디바이스 측 추론을 지원합니다.

이 과정에서 고객의 데이터를 보호하기 위해 기업 수준의 보안 및 개인정보 보호 표준을 타협하지 않았습니다.

빠른 시작

Command R7B는 현재 다음 주소에서 구입할 수 있습니다. Cohere 플랫폼 다음에서도 사용할 수 있습니다. 허깅페이스 온 액세스. AI 연구 커뮤니티에 최첨단 기술에 대한 폭넓은 접근성을 제공하기 위해 모델의 가중치를 공개하게 되어 기쁘게 생각합니다.

| Cohere API 가격 | 가져오기 토큰 | 출력 토큰 |

|---|---|---|

| 명령 R7B | $0.0375 / 1m | $0.15 / 1m |

[1] 대화형 RAG: 10개의 데이터 세트에 대한 ChatRAGBench 벤치마크의 평균 성능 테스트로, 대화형 작업, 긴 입력 처리, 양식 분석, 금융 환경에서의 데이터 정보 추출 및 조작 등 다양한 환경에서 응답을 생성하는 능력을 테스트합니다. 평가 방법론을 개선하기 위해 하이쿠, GPT3.5, Command R과 함께 PoLL 판별자 통합(Verga et al., 2024)을 사용하여 일관성을 높였습니다(20,000개의 수동 평가 기준, 원래 버전의 0.57에 비해 Fleiss의 카파 = 0.74). 도구 사용: 2024년 12월 12일 BFCL-v3 벤치마크에서의 성능. 사용 가능한 모든 점수는 공개 순위표에서 얻은 것이며, 그렇지 않은 경우 공식 코드베이스를 사용한 내부 평가입니다. 경쟁사의 경우, BFCL '프롬프트' 또는 '함수 호출' 점수 중 더 높은 점수를 보고합니다. 전체 점수, 실시간 하위 집합 점수(실제의 다양하고 동적인 환경에서 도구 사용 테스트), 관련 없는 하위 집합 점수(모델이 불필요한 도구 호출을 피하는 방법 테스트)를 보고합니다.REACT 에이전트/멀티스텝: 저희는 LangChain REACT 인터넷에 연결된 지능이 복잡한 문제를 분해하고 성공적인 연구 수행을 위한 계획을 수립하는 능력은 Bamboogle과 StrategyQA를 사용하여 평가했습니다. Bamboogle은 PoLL 통합을 사용하여 평가했으며, StrategyQA는 모델이 형식 지침을 따르는지 평가하고 최종적으로 '예' 또는 '아니오'로 대답하여 판단하는 방식으로 평가했습니다. ' 또는 '아니오'로 대답하여 판단을 내렸습니다. ToolTalk는 계정 관리, 이메일 전송, 캘린더 업데이트와 같은 복잡한 사용자 작업을 완료하기 위해 모델에 복잡한 추론을 수행하고 사용자로부터 정보를 적극적으로 찾도록 요구하며, ToolTalk-hard는 공식 ToolTalk 라이브러리의 소프트 성공률을 사용하여 평가합니다. ToolTalk를 사용하려면 모델이 함수 호출 API를 노출해야 하는데, 이는 Gemma 2 9B에서는 제공되지 않습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...