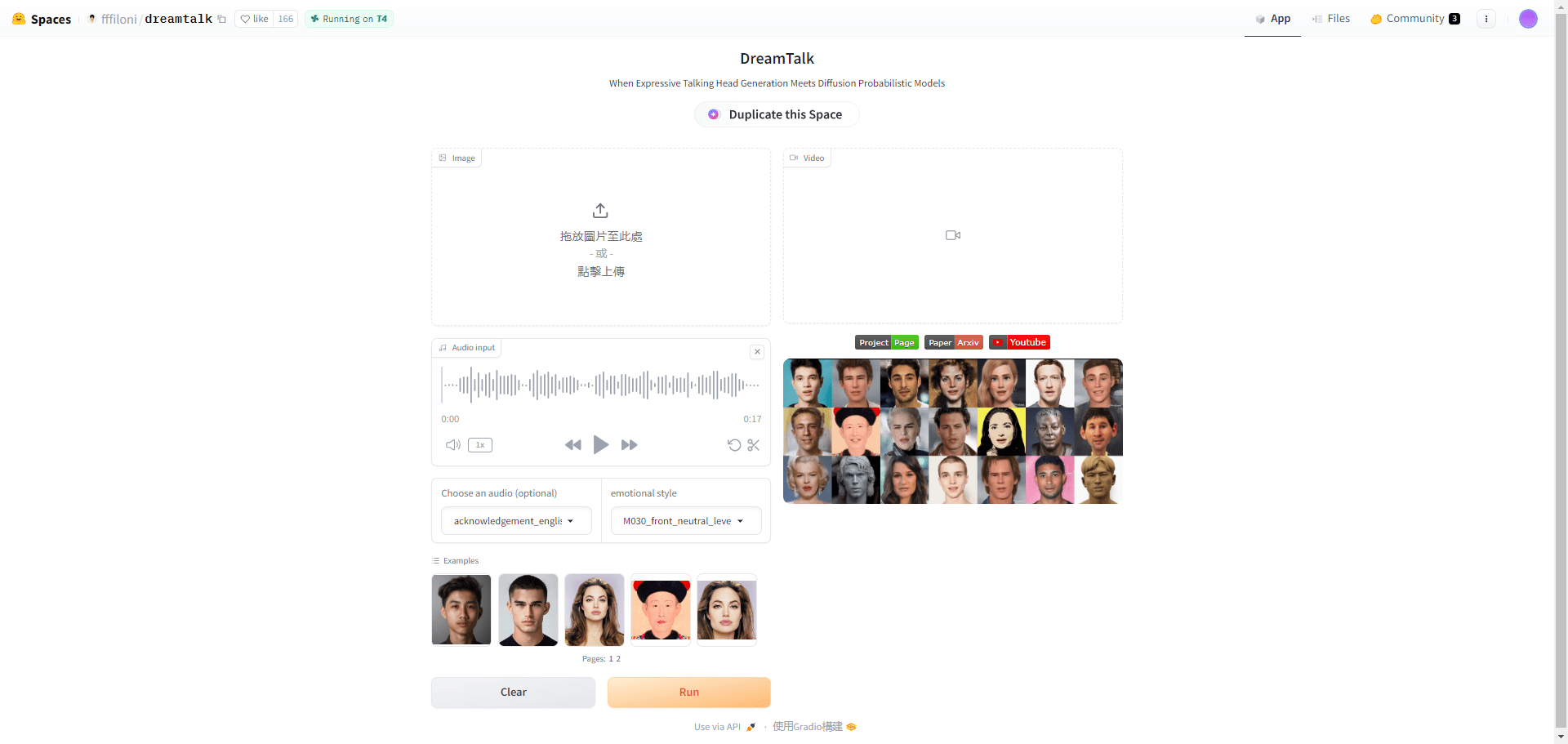

DreamTalk 综合介绍

DreamTalk是一个扩散模型驱动的表情说话头生成框架,由清华大学、阿里巴巴集团和华中科技大学联合开发。主要由降噪网络、风格感知嘴唇专家和风格预测器三部分构成,能够基于音频输入生成多样而真实的说话头像。该框架能处理多种语言和噪声音频,提供高质量的面部运动和准确的嘴型同步。

DreamTalk 功能列表

根据音频生成逼真的说话头部视频

支持多种语言和语音输入

支持多种风格和表情的输出

支持自定义人物头像和风格参考

支持在线演示和代码下载

DreamTalk 使用帮助

访问项目主页查看更多信息和演示视频

访问论文地址阅读技术细节和实验结果

访问GitHub地址下载代码和预训练模型

遵循安装指南配置环境和依赖

运行inference_for_demo_video.py进行推理和生成视频

根据参数说明调整输入和输出选项

DreamTalk在线体验地址

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...