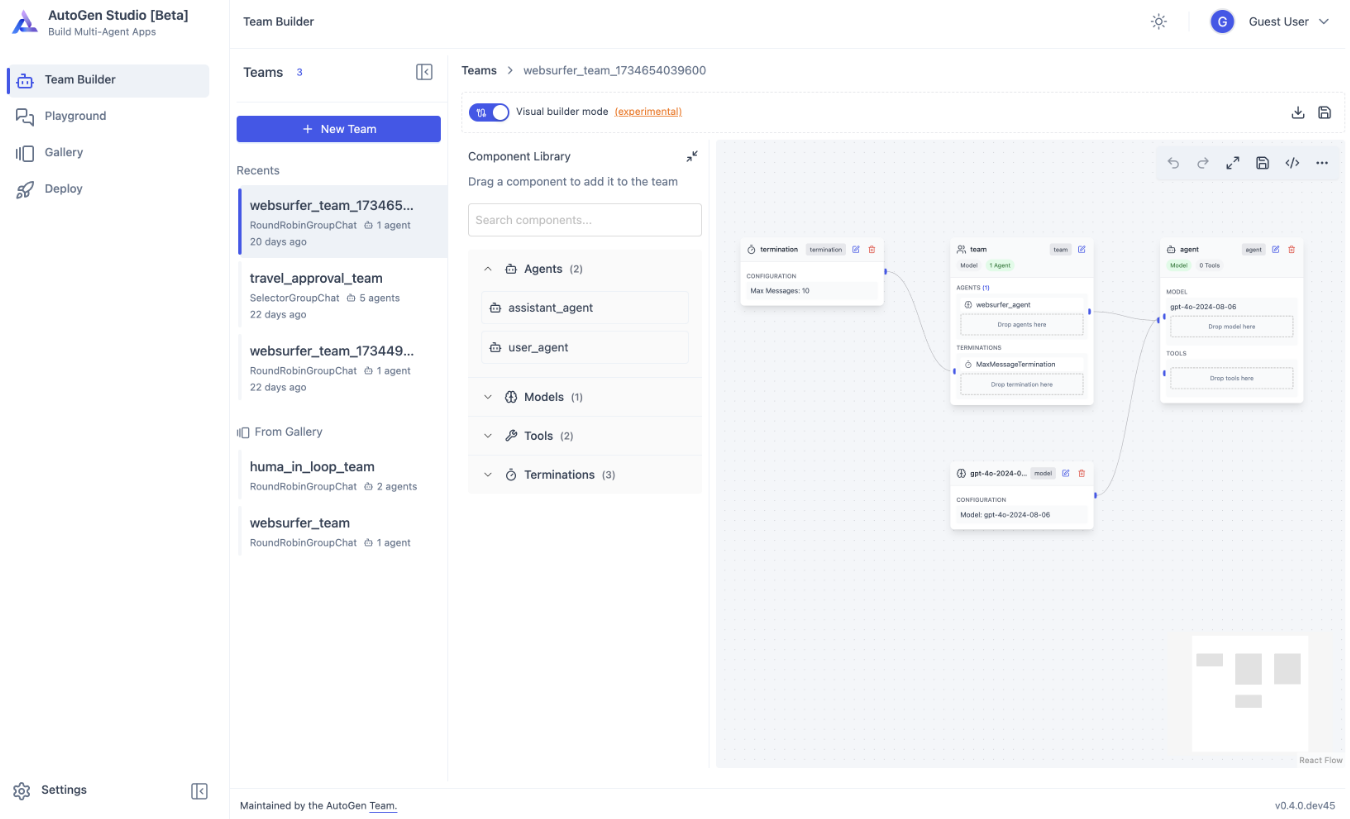

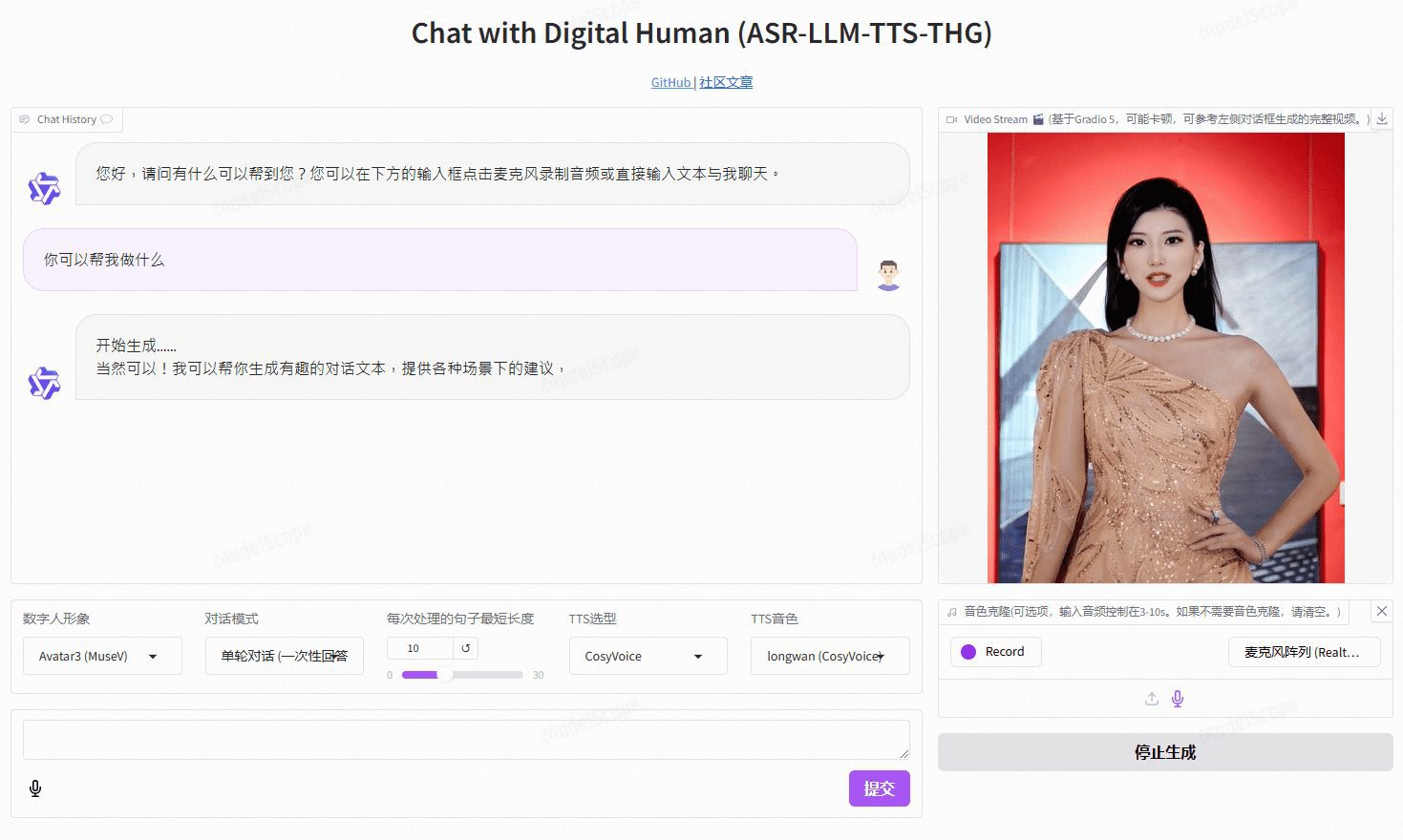

VideoChat: голосовой интерактивный цифровой собеседник в реальном времени с возможностью клонирования изображения и тембра, поддержка комплексных голосовых решений и каскадных решений.

Общее введение

VideoChat - это проект цифрового человека для голосового взаимодействия в реальном времени, основанный на технологии с открытым исходным кодом и поддерживающий сквозные голосовые схемы (GLM-4-Voice - THG) и каскадные схемы (ASR-LLM-TTS-THG). Проект позволяет пользователям настраивать образ и тембр цифрового человека, поддерживает клонирование тембра и синхронизацию губ, вывод видеопотока и задержку первого пакета до 3 секунд. Пользователи могут ознакомиться с его функциональностью с помощью онлайн-демонстраций, а также развернуть и использовать его на месте с помощью подробной технической документации.

Адрес для демонстрации: https://www.modelscope.cn/studios/AI-ModelScope/video_chat

Список функций

- Голосовое взаимодействие в реальном времени: поддержка сквозных голосовых решений и каскадных решений

- Индивидуальный образ и тон: пользователи могут настроить внешний вид и звук цифрового человека в соответствии со своими потребностями

- Клонирование голоса: поддержка клонирования голоса пользователя для обеспечения персонализированного голосового опыта.

- Низкая задержка: задержка первого пакета составляет всего 3 секунды, что обеспечивает бесперебойную интерактивную работу.

- Проект с открытым исходным кодом: основан на технологии с открытым исходным кодом, пользователи могут свободно изменять и расширять функции

Использование помощи

Процесс установки

- Конфигурация среды

- Операционная система: Ubuntu 22.04

- Версия Python: 3.10

- Версия CUDA: 12.2

- Версия факела: 2.1.2

- проект клонирования

git lfs install git clone https://github.com/Henry-23/VideoChat.git cd video_chat - Создание виртуальной среды и установка зависимостей

conda create -n metahuman python=3.10 conda activate metahuman pip install -r requirements.txt pip install --upgrade gradio - Скачайте файл с весами

- Рекомендуется использовать CreateSpace для загрузки, настроен git lfs для отслеживания весовых файлов

git clone https://www.modelscope.cn/studios/AI-ModelScope/video_chat.git - Начальные услуги

python app.py

Процесс использования

- Настройка ключа API::

- Если производительность локальной машины ограничена, вы можете использовать Qwen API и CosyVoice API, предоставляемые платформой обслуживания больших моделей Aliyun, Hundred Refine, на

app.pyНастройте API-ключ в

- Если производительность локальной машины ограничена, вы можете использовать Qwen API и CosyVoice API, предоставляемые платформой обслуживания больших моделей Aliyun, Hundred Refine, на

- локальный вывод::

- Если вы не используете API-KEY, вы можете использовать его в

src/llm.pyответить пениемsrc/tts.pyНастройте локальный метод вывода, чтобы удалить ненужный код вызова API.

- Если вы не используете API-KEY, вы можете использовать его в

- Начальные услуги::

- быть в движении

python app.pyНачните обслуживание.

- быть в движении

- Настройка цифровых персон::

- существовать

/data/video/Каталог для добавления записанного видео с цифровым изображением человека. - модификации

/src/thg.pyв списке avatar_list класса Muse_Talk, добавив имя изображения и bbox_shift. - существовать

app.pyПосле добавления имени цифровой персоны в avatar_name в Gradio перезапустите службу и дождитесь завершения инициализации.

- существовать

Подробная процедура работы

- Индивидуальное изображение и тон: в

/data/video/каталог, чтобы добавить записанное видео с цифровым изображением человека вsrc/thg.pyмодификацияMuse_Talkклассavatar_listдобавьте название изображения иbbox_shiftПараметры. - клонирование речи: в

app.pyСредняя конфигурацияCosyVoice APIили используяEdge_TTSВыполните локальное рассуждение. - Комплексные голосовые решения: Использование

GLM-4-Voiceмодели, обеспечивающие эффективную генерацию и распознавание речи.

- Зайдите по адресу локально развернутой службы и перейдите в интерфейс Gradio.

- Выберите или загрузите пользовательское видео с цифровыми персонами.

- Настройте функцию клонирования голоса для загрузки образца голоса пользователя.

- Начните голосовое взаимодействие в реальном времени и оцените возможности диалога с низкой задержкой.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...