Держите ИИ на нижней границе, "мальчик, похоронивший фотографию", причастен к делу о задержании человека! Эти трюки научат вас определять подлинность фотографий

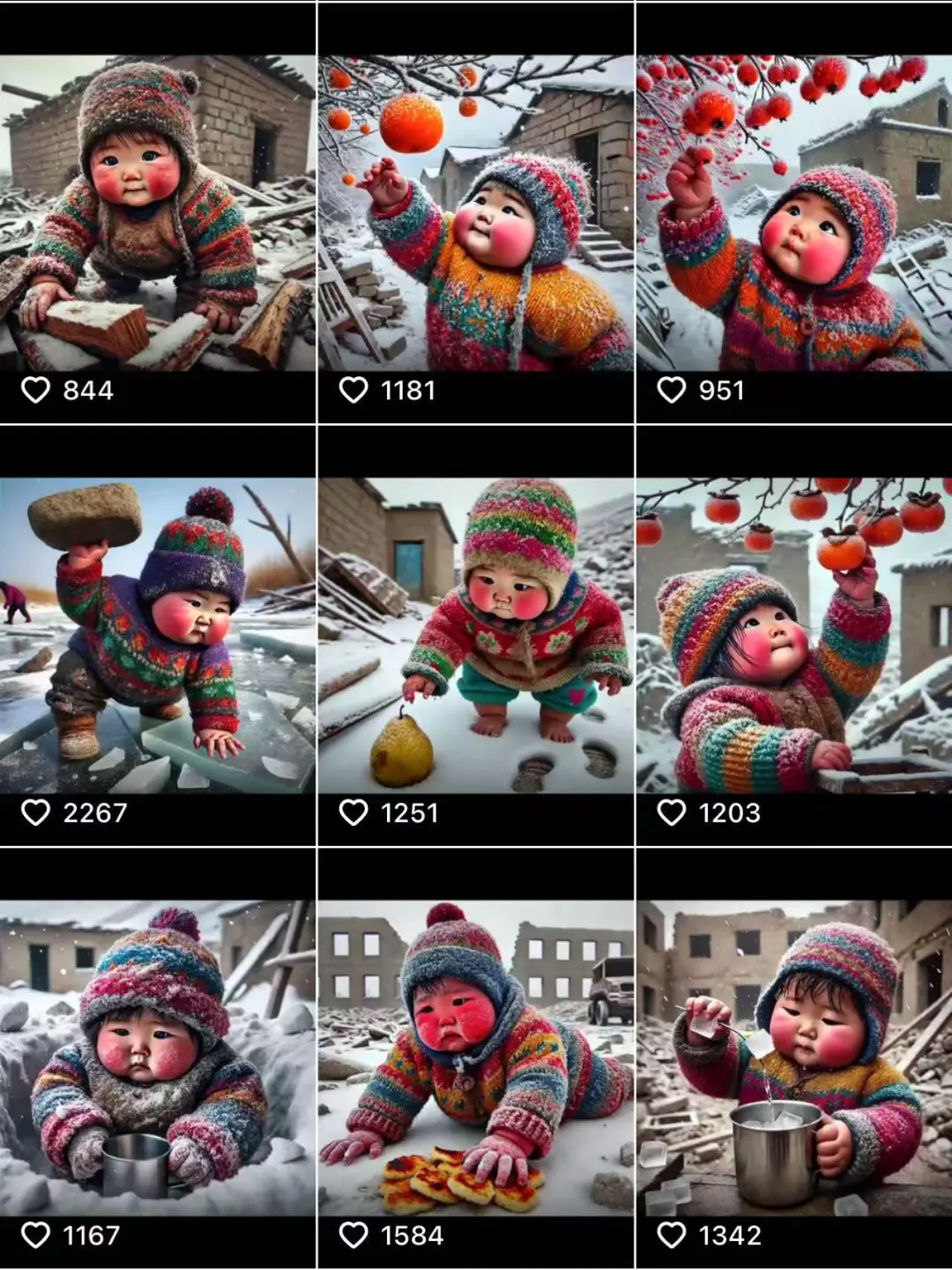

7 января в тибетском уезде Тингри произошло землетрясение магнитудой 6,8, и многие люди следят за ходом спасательных работ и молятся за безопасность пострадавших районов. Между тем, на фоне всех этих добрых чувств и забот, в Интернете быстро стала популярной фотография "маленького мальчика, погребенного под обломками".

Эта фотография, сопровождаемая словами "Землетрясение Рикадзе", вызвала слезы у множества людей, а также десятки тысяч лайков и ретвитов. Большинство людей не поняли, что это была всего лишь поддельная картинка, сгенерированная искусственным интеллектом.

Правда всплывает, контент ИИ украден

Если внимательно присмотреться к этой фотографии, то кажется, что мальчик в шапке, погребенный под обломками, находится в критической и душераздирающей ситуации, и это действительно похоже на снимок с места катастрофы.

Однако внимательные нетизены нашли разгадку - у мальчика на снимке был лишний палец. Позже полиция установила, что картинка была сгенерирована искусственным интеллектом и не имела никакого отношения к землетрясению.

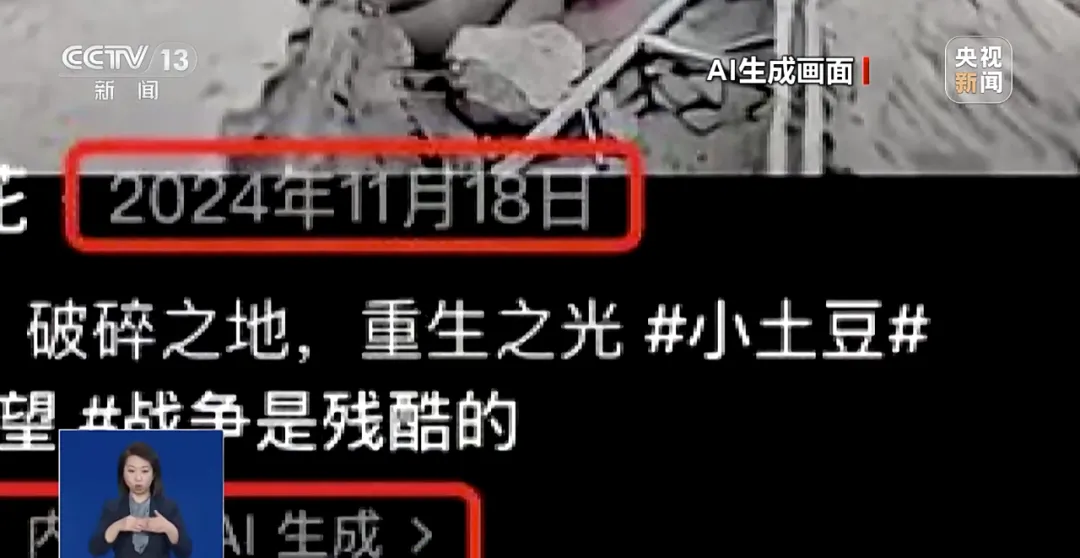

Это изображение принадлежит создателю ИИ, мистеру Хэ, и изначально было коротким видеоматериалом, опубликованным в ноябре прошлого года. Его первоначальным намерением было привлечь внимание к детям на войне с помощью контента ИИ, но он не понимал, что материал был злонамеренно украден и объединен с землетрясением.

Распространители слухов не могут избежать ответственности

Пират - это нетизен из Цинхая. Чтобы получить трафик, он объединил эту сгенерированную ИИ картинку с катастрофой землетрясения и даже обозначил ее ключевыми словами, такими как "землетрясение Рикадзе", пытаясь привлечь внимание.

Такое поведение не только мешает общественным слушаниям, но и реальным спасателям в зоне бедствия вносит ненужную путаницу, в итоге нетизен был задержан полицией в соответствии с законом.

Согласно соответствующим положениям Закона о наказаниях для органов управления общественной безопасностью и Уголовного закона, тем, кто распространяет ложную информацию о бедствии, грозит заключение под стражу или даже более суровое уголовное наказание. Этот фарс со слухами еще раз предупредил всех о том, что Интернет - не место вне закона.

Технология искусственного интеллекта становится рассадником слухов?

О чем многие не задумываются, так это о том, как дешево можно создать слух. С помощью простого слова можно менее чем за 30 секунд создать видеоролик катастрофы, который будет достаточно фальшивым, чтобы быть реальным, и даже сопровождаться дикторским текстом.

Хотя государство выпустило соответствующие постановления, требующие, чтобы контент, созданный искусственным интеллектом, был четко маркирован, но фактическая реализация этого эффекта не оправдала ожиданий. В данном случае на фотографии изначально был водяной знак "сгенерировано ИИ", но он был легко удален распространителями слухов.

Как обычные люди могут распознать "поддельные изображения ИИ"?

Мы должны быть бдительны, когда речь идет о контенте, создаваемом искусственным интеллектом. Вот несколько приемов, которые помогут вам быстро проверить его на подлинность:

1. детали наблюдений

На изображениях, созданных искусственным интеллектом, могут возникать проблемы с некоторыми деталями, особенно со сложными или нестандартными элементами:

- Рука или палецСгенерированные искусственным интеллектом детали рук часто бывают ненормальными, например, с несколькими пальцами, отсутствующими пальцами, искаженными формами или неправильными пропорциями.

- Глаза и черты лицаЛица, сгенерированные искусственным интеллектом, могут иметь асимметричные глаза, размытые края или разрозненные черты.

- Слова и символыТекст, сгенерированный искусственным интеллектом, часто содержит беспорядочные, неправильные или неразборчивые символы.

- Справочные данные: На заднем плане могут быть запутанные, разрозненные объекты или элементы, не соответствующие законам физики (например, взвешенные тени).

2. Проверка текстуры и логической последовательности

В изображениях, созданных искусственным интеллектом, иногда отсутствуют текстуры и детали, характерные для реального мира, а иногда игнорируются правила логики:

- Излишняя гладкость: чрезмерно гладкая поверхность кожи или предмета.

- Повторение деталей: например, схожие узоры на локальных участках, таких как листья, кирпичи и т.д.

- Свет и тень: Направление источника света не совпадает с положением теней.

- проблема отражения: Отражения в зеркалах или воде не соответствуют реальным объектам.

- Пропорции и расположение объектов: Часто встречаются странные размеры или расстановки, например, мебель плавает или не соответствует пропорциям.

3. анализ разрешения и качества изображений

- Непоследовательное разрешение: Изображения, созданные искусственным интеллектом, могут выглядеть размытыми в одних местах и слишком резкими в других.

- распределение цветовИзображения AI могут быть перенасыщенными или однородными по цвету, в них отсутствуют тонкие переходы реальной сцены.

- пиксельные артефакты: Сгенерированные AI изображения могут иметь неравномерную пиксельную текстуру при увеличении.

- Обработка краев: Края объектов могут быть слишком резкими или размытыми, чтобы естественно сочетаться с фоном.

4. Внимание к физическим законам и деталям движения

Если изображение включает в себя движение или динамические элементы:

- эффект размытияРазмытие движения, сгенерированное искусственным интеллектом, может не соответствовать реальной картине движения.

- траектория: Быстро движущиеся объекты могут не иметь истинного трека движения или наложения изображения.

- законы физикиЕстественная физическая динамика на реальных фотографиях (например, ветер сдувает листья) может быть трудно поддаваться идеальной передаче искусственным интеллектом.

5. понимание стилистических особенностей графических инструментов ИИ

Различные инструменты искусственного интеллекта создают изображения, отличающиеся друг от друга по стилю:

- Середина путешествия: Изображения, как правило, очень художественные и любят добавлять эффекты размытия или чрезмерной резкости.

- Стабильная диффузия: Иногда возникают искажения на краях и мелких объектах.

- ДАЛЛ-И: При создании сложных сцен могут возникать логические ошибки или ошибки детализации.

Технология - это всего лишь инструмент, и лучшее его использование зависит от сердец и умов людей.

Инцидент с "похороненным мальчиком" - это зеркало. Оно отражает две стороны технологии ИИ - она может либо помочь нам создать новые возможности, либо, если использовать ее не по назначению, стать распространителем слухов.

Но это не значит, что мы должны "держаться подальше" от технологий ИИ. Напротив, нам необходимо правовое регулирование, технологические усовершенствования и чувство ответственности в сердце каждого. В эпоху Интернета грань между правдой и ложью порой очень размыта, но ваше спокойствие и рациональность могут заставить тщательно сплетенную ложь потерять почву.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...