Qwen3.6-Max-Preview - 阿里发布的通义千问系列最新旗舰模型

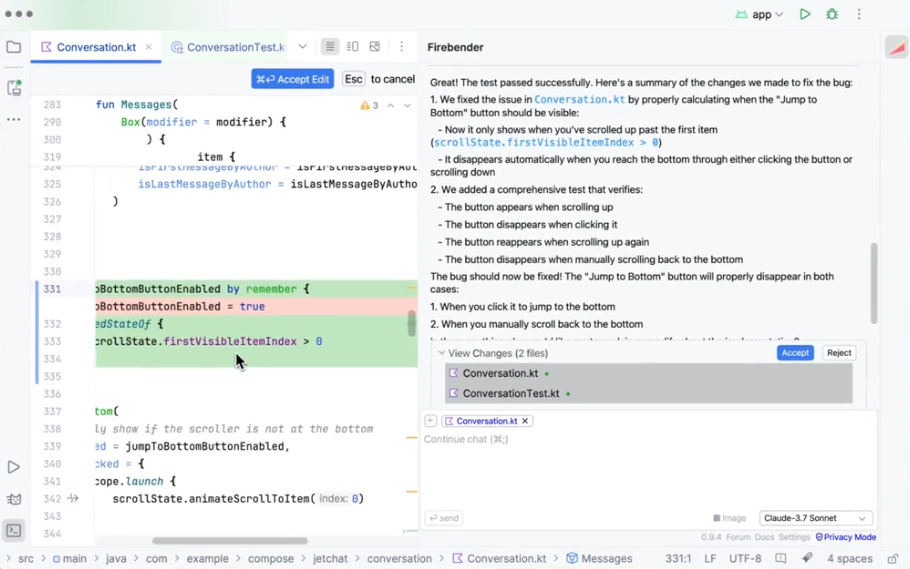

Qwen3.6-Max-Preview是什么

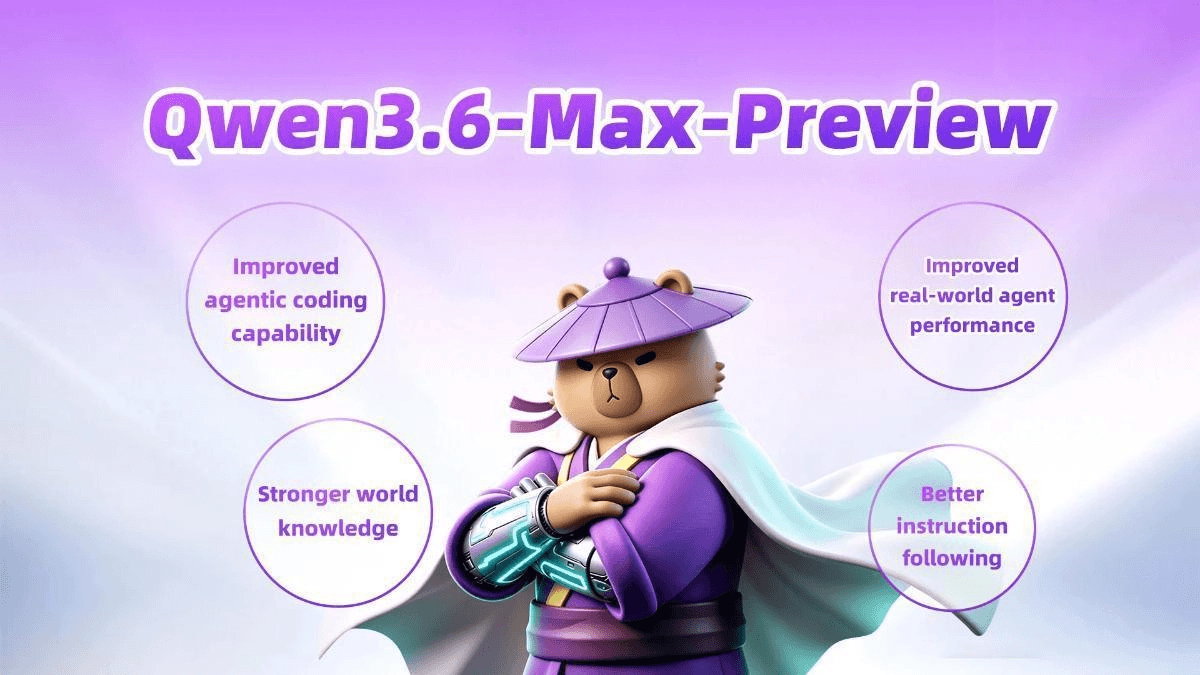

Qwen3.6-Max-Preview 是阿里巴巴发布的通义千问系列最新旗舰模型,定位在 Qwen3.6-Plus 之上。模型主打顶尖编码能力与 Agentic 工作流支持,在 SWE-bench Pro、Terminal-Bench 2.0 等六大主流编码基准测试中登顶,前端代码生成表现尤为突出。支持 260K жетоны 长上下文,引入 preserve_thinking 功能,可在多轮工具调用中保留思维链,显著提升长程 Agent 任务完成率。

Qwen3.6-Max-Preview的功能特色

- 顶尖编码性能:在 SWE-bench Pro、Terminal-Bench 2.0、SkillsBench、SciCode 等六大主流编码基准测试中全面登顶,SciCode 提升达 10.8 分,SkillsBench 提升 9.9 分。

- 前端代码生成领先:QwenWebBench 评测 ELO 达 1558,大幅领先 Клод Opus 4.5(1182),擅长 UI/Web 开发场景。

- Сверхдлинное контекстное понимание:支持 260K tokens 上下文窗口,可应对长文档分析、大型代码库理解与复杂多轮对话。

- Agentic 工作流增强:引入

preserve_thinking功能,在多轮工具调用中保留思维链(Chain-of-Thought),避免 Agent "遗忘"前期约束,提升长程任务完成率。 - 世界知识与指令遵循升级:SuperGPQA 提升 2.3 分,ToolcallFormatIFBench 提升 2.8 分,知识覆盖与指令执行更精准。

- 开源替代方案:提供 Qwen3.6-35B-A3B 开源版本(Apache 2.0 协议),SWE-bench Verified 得分 73.4%,可在消费级硬件本地部署。

Qwen3.6-Max-Preview的核心优势

- 编码能力全面登顶:在 SWE-bench Pro、Terminal-Bench 2.0、SkillsBench、SciCode 等六大权威编码基准测试中均排名第一,综合编程实力行业领先。

- 前端代码生成大幅领先:QwenWebBench ELO 达 1558,显著超越 Claude Opus 4.5(1182),在 UI/Web 开发场景下代码质量与还原度更优。

- Agentic 任务执行更稳定:独家支持

preserve_thinking功能,可在多轮工具调用中持续保留思维链,避免长程 Agent 任务中途"失忆"或偏离目标。 - 长上下文深度理解:支持 260K tokens 上下文窗口,可一次性处理大型代码库、长文档与复杂多轮对话,信息关联能力更强。

- 知识与指令精准度双提升:SuperGPQA 世界知识得分提升 2.3 分,ToolcallFormatIFBench 指令遵循提升 2.8 分,回答更准确、工具调用更规范。

Qwen3.6-Max-Preview的操作步骤

- Qwen Studio:可直接在 chat.qwen.ai 网页端免费体验,使用阿里云账号登录后,在模型选择栏切换至 Qwen3.6-Max-Preview,输入提示词即可开始对话。

- API 接入:通过阿里云 Model Studio 调用,模型名称为

qwen3.6-max-preview,兼容 OpenAI/Anthropic API 格式;需设置DASHSCOPE_API_KEY,目前 Preview 阶段免费。 - 开源替代:如需本地部署,可选择同期开源的 Qwen3.6-35B-A3B(Apache 2.0 协议),SWE-bench Verified 得分 73.4%,可在消费级硬件上运行。

Qwen3.6-Max-Preview的适用人群

- 软件开发者与全栈工程师:模型在 SWE-bench Pro、Terminal-Bench 2.0 等六大编码基准登顶,适合复杂算法实现、代码调试、自动化脚本编写及大型项目开发。

- 前端与 UI/Web 开发者:QwenWebBench ELO 达 1558,大幅领先竞品,擅长根据设计稿或描述生成高质量 HTML/CSS/JavaScript 代码,还原界面细节。

- AI Agent 与自动化工作流开发者::

preserve_thinking功能支持多轮工具调用中保留思维链,适合构建需要长程规划、多步骤执行的智能体应用。 - 需处理大型代码库的技术人员:支持 260K tokens 长上下文,可一次性导入整个项目代码库进行架构分析、跨文件重构或代码审查。

- 企业技术团队与产品经理:通过阿里云 Model Studio API 接入,兼容 OpenAI/Anthropic 格式,便于集成到现有 DevOps 流程或内部工具链。

Qwen3.6-Max-Preview的常见问题

Q:API 接入的模型名称是什么?兼容哪些格式?

A:API 模型名称为 qwen3.6-max-preview,兼容 OpenAI 和 Антропология 的 API 调用格式,便于快速集成到现有应用或工作流中。

Q:Preview 阶段是否收费?后续定价如何?

A:当前 Preview 阶段完全免费。阿里云表示仍在收集反馈并持续迭代,正式版定价将在后续公布。

Q:有开源版本可以本地部署吗?

A:有。同期开源的 Qwen3.6-35B-A3B(Apache 2.0 协议)可作为替代方案,SWE-bench Verified 得分 73.4%,支持在消费级硬件上通过 vLLM、Ollama 等框架本地运行。

Q:上下文窗口支持多长?

A:Qwen3.6-Max-Preview 支持 260K tokens 上下文窗口,适合大型代码库分析、长文档理解与复杂多轮对话;如需更长上下文可考虑 Qwen3.6-Plus(1M tokens)。

Q:与 Claude Opus 4.6、GPT-5.4 相比表现如何?

A:在 Terminal-Bench 2.0 上与 Claude Opus 4.6 持平(65.4%),前端/UI 代码生成大幅领先;Claude 在 SWE-bench Verified 仍保持领先(80.8%);GPT-5.4 在 GUI 自动化与 OSWorld 任务上占优,Qwen 更专注编码与前端生成场景。

Q:Preview 阶段使用有什么注意事项?

A:Preview 阶段免费,但输入输出数据可能被用于模型改进与优化,建议避免输入敏感个人信息或核心商业机密代码,等待正式版发布后再处理高敏感场景。

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...