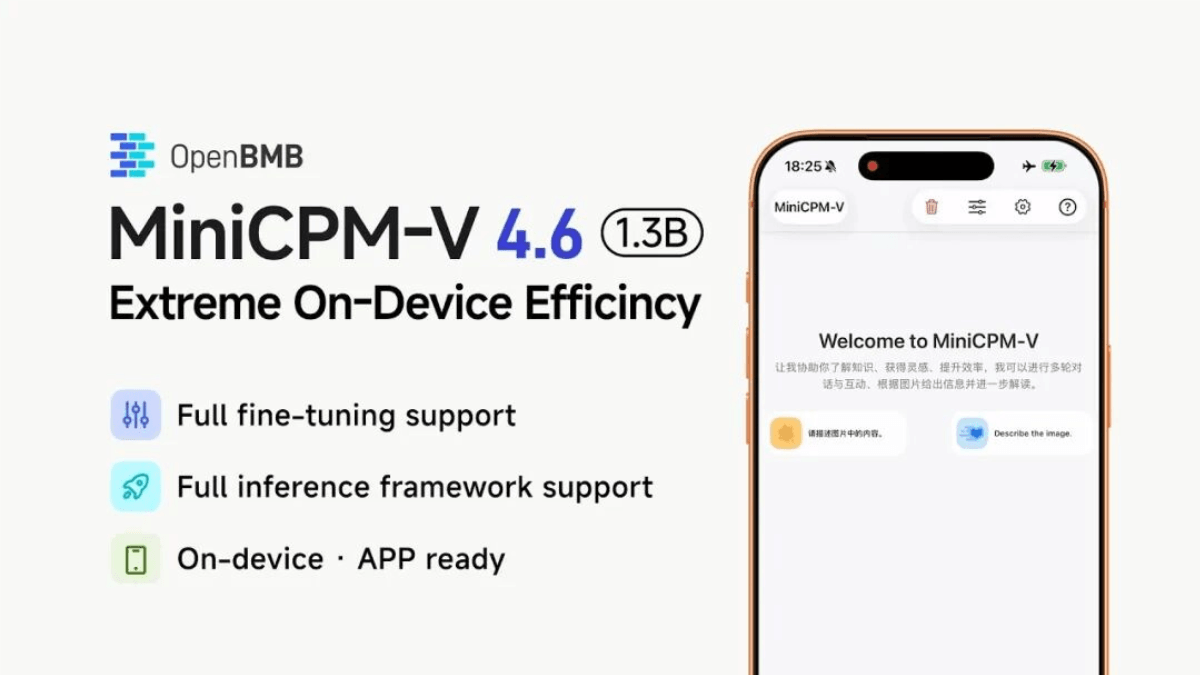

MiniCPM-V 4.6 - 面壁智能联合清华开源的端侧多模态大模型

MiniCPM-V 4.6是什么

MiniCPM-V 4.6 是面壁智能(OpenBMB)联合清华大学发布并开源的端侧多模态大模型。模型总参数量仅 1.3B,是 MiniCPM-V 系列有史以来最小的模型,在多模态综合能力上超越了阿里 Qwen3.5-0.8B 和谷歌 Gemma 4 E2B-it 等同尺寸标杆,实现了尺寸更小、效率更高、性能更好的突破。

MiniCPM-V 4.6的功能特色

- 多模态统一理解:支持文本、图像、视频三种输入模态,可执行图文对话、视频理解、视觉问答、OCR 文字识别等任务,输出为文本形式。

- 超高清图像解析:基于 LLaVA-UHD v4 架构,支持 3136×3136 等超高分辨率图像输入,首字响应延迟(TTFT)仅 75.7 毫秒。

- 视觉 Token 早压缩:在 ViT 浅层引入窗口注意力机制进行 Токен 压缩,视觉编码阶段浮点运算量降低 55.8%,大幅节省图像编码开销。

- 混合压缩率切换:支持 4× 高精度模式(细粒度视觉解析)与 16× 高吞吐模式(高并发工业场景)灵活切换,适配不同业务需求。

- Удлиненное контекстное окно:支持 262K жетоны 的上下文长度,可处理长文档、长视频序列等复杂多轮对话场景。

- 端侧全平台部署:原生适配 iOS、Android、HarmonyOS 三大移动平台,边缘端适配代码全部开源,可在手机端本地运行。

- 多框架推理兼容:原生支持 vLLM、SGLang、llama.cpp、Ollama 等主流推理框架,开发者可按需选择后端。

- 多格式量化版本:提供 GGUF(CPU 2GB)、BNB / AWQ / GPTQ(GPU 3GB)等量化版本,基础版仅需 4GB 显存即可运行。

- 原生微调支持:官方深度适配 ms-swift 与 LLaMA-Factory 微调框架,提供中英双语 CookBook 教程,降低二次开发门槛。

- 深度推理变体:提供 MiniCPM-V 4.6 Thinking 版本,支持链式思考(Chain-of-Thought)深度推理,同样配备多格式量化版本。

MiniCPM-V 4.6的核心优势

- LLaVA-UHD v4 架构:采用第四代 LLaVA-UHD 架构,针对高分辨率图像处理进行深度优化。

- ViT 内部视觉 Token 早压缩:在 ViT 浅层引入窗口注意力机制进行 Token 压缩,视觉编码阶段浮点运算量降低 55.8%,节省约一半的图像编码开销。

- 混合 4x/16x 视觉 Token 压缩率:支持灵活切换——4 倍模式精度拉满,适合细粒度视觉解析;16 倍模式速度起飞,适合高并发工业场景与端侧部署。

- 端侧全平台覆盖:可部署于 iOS、Android、HarmonyOS 三大主流移动平台,边缘适配代码全部开源。

MiniCPM-V 4.6官网是什么

- Репозиторий GitHub:https://github.com/OpenBMB/MiniCPM-V-edge-demo

- Библиотека моделей HuggingFace:https://huggingface.co/openbmb/MiniCPM-V-4.6

MiniCPM-V 4.6的操作步骤

- Получение весов моделей:从 Hugging Face(

openbmb/MiniCPM-V-4.6)或 ModelScope 下载模型文件,也可直接通过git cloneвозможноhuggingface-cli拉取仓库。 - 加载量化版本(可选):若显存或内存受限,按需下载对应量化版本,GGUF 格式适配 CPU(2GB 内存即可运行),BNB / AWQ / GPTQ 格式适配 GPU(3GB 显存起步)。

- Настройка среды выполнения:安装对应依赖,如使用 vLLM 需配置 CUDA 环境并安装

vllm包;使用 llama.cpp 需编译对应后端并加载 GGUF 文件;基础版 BF16 运行需约 4GB 显存。 - 执行推理调用:通过命令行或 API 方式加载模型,输入文本、图像或视频进行多模态推理;高分辨率图像可切换 4× 或 16× 视觉 Token 压缩率以平衡精度与速度。

- 移动端本地部署:下载官方开源的 iOS / Android / HarmonyOS 边缘适配代码,将模型集成至 App 工程中,实现端侧离线运行。

- 模型微调(可选):使用官方适配的 ms-swift 或 LLaMA-Factory 框架,准备图文数据集,参照中英双语 CookBook 教程执行 LoRA 或全参数微调。

- 部署 Thinking 版本(可选):如需深度推理能力,下载

MiniCPM-V-4.6-Thinking及其量化版本,按相同流程加载即可启用链式思考模式。

MiniCPM-V 4.6的适用人群

- 端侧应用开发者:需要在 iOS、Android、HarmonyOS 移动设备上集成多模态 AI 能力的 App 开发者,可利用官方开源的边缘适配代码实现本地离线运行。

- 边缘计算与物联网工程师:面向资源受限场景(如智能摄像头、工控机、边缘网关),模型最低仅需 2GB 内存/3GB 显存,适合低功耗硬件部署。

- 中小企业与创业团队:开源免费(Apache 2.0)且部署成本极低,无需昂贵 GPU 集群即可搭建图文问答、OCR 识别、视频理解等 AI 服务。

- AI 研究员与高校师生:1.3B 小参数规模便于快速实验和复现,原生支持 ms-swift 与 LLaMA-Factory 微调,适合多模态大模型方向的学术研究。

- 数据隐私敏感型企业:支持完全本地化私有化部署,医疗、金融、政务等领域可避免敏感图像和文档数据上传云端。

MiniCPM-V 4.6的常见问题

Q:模型的开源协议是什么?可以免费商用吗?

A: 采用 Apache 2.0 协议开源,允许免费商用、二次开发和分发。

Q:MiniCPM-V 4.6 与前几代有什么区别?

A: 这是 MiniCPM-V 系列有史以来最小的模型(1.3B),首次引入 ViT 内部视觉 Token 早压缩与混合 4×/16× 压缩率机制,在保持更小体积的同时,多模态综合能力超越同尺寸标杆模型。

Q:模型采用了什么架构?

A: 基于 LLaVA-UHD v4 架构,视觉编码器为 SigLIP2-400M,语言基座为 Qwen3.5-0.8B,上下文窗口支持 262K tokens。

Q:视觉 Token 压缩是什么?有什么好处?

A: 在 ViT 浅层引入窗口注意力机制进行 Token 早压缩,视觉编码阶段浮点运算量降低 55.8%,可节省约一半的图像编码开销。支持 4×(高精度)和 16×(高吞吐)两种压缩率灵活切换。

Q:模型性能在同级别中处于什么水平?

A:Искусственный анализ Intelligence Index 得分 13,为 2B 参数以下开源模型最高分;MMMU-Pro 得分 38%,同样为同尺寸最高,超越 Qwen3.5-0.8B 和 Gemma 4 E2B-it。

Q:推理速度表现如何?

A: 在 RTX 4090 + vLLM 环境下,处理 3136² 超高清图片首字响应延迟(TTFT)仅 75.7 毫秒,较 Qwen3.5-0.8B 快 2.2 倍;1344² 分辨率吞吐量达 2624 token/s(每秒 14.3 张图片)。

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...