За штормом DeepSeek: Нг предупреждает, что открытое соревнование моделей изменит ландшафт ценностей ИИ в США и Китае

Дорогие друзья.

на этой неделе DeepSeek Поднявшаяся шумиха позволила многим понять несколько важных тенденций: (i) Китай догоняет США в области генеративного ИИ, что оказывает значительное влияние на цепочку поставок ИИ; (ii) открытые весовые модели превращают базовый слой модели в товар, создавая возможности для разработчиков приложений; и (iii) увеличение масштаба - не единственный путь развития ИИ. Несмотря на то, что в отрасли большое внимание уделяется арифметической мощности, алгоритмические инновации быстро снижают стоимость обучения.

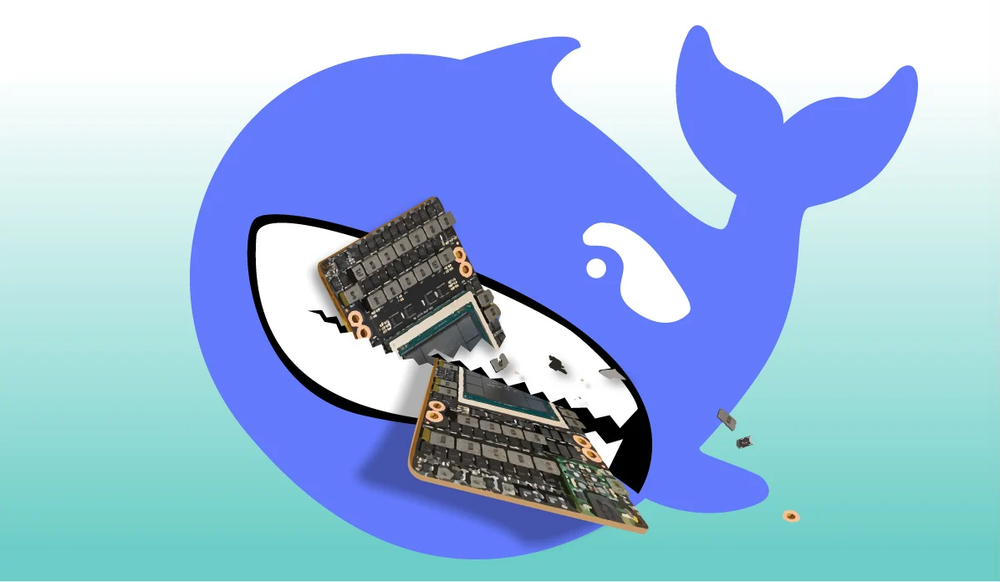

Около недели назад китайская компания DeepSeek выпустила DeepSeek-R1 Модель, которая в бенчмарках показывает результаты, сопоставимые с OpenAI o1, открыта для взвешивания под лицензией MIT. На прошлой неделе в Давосе многие бизнес-лидеры из нетехнических кругов спрашивали меня об этом. В понедельник на фондовом рынке произошла "DeepSeek распродажа": акции ряда американских технологических компаний, включая NVIDIA, упали (и на момент написания статьи частично восстановились).

Я считаю, что DeepSeek доказывает следующие моменты:

Китайский генеративный ИИ сокращает отставание от США.. Когда ChatGPT выйдет в ноябре 2022 года, США значительно опередят Китай в области генеративного ИИ. Восприятие людей меняется медленно, поэтому в последнее время в Китае и США все еще есть друзья, которые считают, что Китай отстает. Но на самом деле за последние два года этот разрыв стремительно сокращается. via lit. десять тысяч вопросов по общим принципам (идиома); fig. длинный список вопросов и ответов (Моя команда использует его уже несколько месяцев), Кими С такими китайскими моделями, как InternVL и DeepSeek, становится ясно, что Китай сокращает разрыв и даже имеет временное преимущество в таких областях, как генерация видео.

Меня радует, что DeepSeek-R1 выпускается в открытом виде с подробным техническим отчетом". В отличие от этого, несколько американских компаний продвигают политику, ограничивающую открытый исходный код, раздувая гипотетические риски, такие как "вымирание ИИ". Теперь ясно, что модели с открытым исходным кодом и открытыми весами стали ключевой частью цепочки поставок ИИ: многие компании примут их. Если США продолжат блокировать открытый исходный код, Китай будет доминировать в цепочке поставок, и в конечном итоге большинство компаний будут использовать модели, которые отражают китайские ценности в большей степени, чем американские.

Открытые модели взвешивания приводят к тому, что базовый уровень модели становится товарным. Как я уже говорил, цены на токены для больших языковых моделей стремительно падают, и открытое взвешивание ускоряет эту тенденцию и предоставляет разработчикам больше возможностей. openAI o1 берет 60 долларов за миллион выходных токенов.А DeepSeek R1 стоит всего 2,19 долл.Разница в цене почти в 30 раз вызвала всеобщее беспокойство по поводу тенденции снижения цен. Разница в цене почти в 30 раз привела к тенденции снижения цен, которая привлекла всеобщее внимание.

Бизнес по обучению базовых моделей и продаже доступа к API сопряжен с определенными трудностями. Многие компании в этой сфере все еще ищут способы окупить высокую стоимость обучения. Об этой проблеме красноречиво говорится в статье "AI's $600 Billion Conundrum" (но, чтобы не быть голословным, я считаю, что компании, занимающиеся разработкой базовых моделей, отлично справляются со своей работой, и надеюсь на их успех). Напротив, создание приложений на основе базовых моделей открывает огромные возможности для бизнеса. Поскольку другие инвестировали миллиарды в обучение моделей, вы можете получить их за несколько долларов, чтобы разрабатывать такие приложения, как чат-боты для обслуживания клиентов, обобщающие системы электронной почты, врачи с искусственным интеллектом, помощники для работы с юридическими документами и многое другое.

Развитие ИИ зависит не только от масштабирования.. Аргумент о том, что масштабирование моделей способствует прогрессу, широко распространен. Если честно, я был одним из первых сторонников аргумента о масштабировании. Компании привлекли миллиарды долларов, продвигая тезис о том, что увеличение капитала приведет к (i) масштабированию и (ii) неуклонному улучшению показателей. Это привело к чрезмерному сосредоточению на масштабировании в ущерб другим направлениям прогресса. Из-за запрета на чипы искусственного интеллекта в США команде DeepSeek пришлось применить множество оптимизаций на более слабых графических процессорах H800, что в итоге позволило снизить стоимость обучения модели (без учета инвестиций в исследования) до 6 миллионов долларов.

Пока неясно, действительно ли это приведет к снижению арифметического спроса. Иногда снижение цены на единицу товара приводит к увеличению общих расходов. Я думаю, что в долгосрочной перспективе у человечества практически нет верхнего предела спроса на интеллект и арифметические способности, так что даже если стоимость снизится, люди все равно будут потреблять больше интеллектуальных ресурсов.

Социальные сети пестрят противоречивыми интерпретациями прогресса DeepSeek, намечая различные позиции, как тест Роршаха на чернильную кляксу. Я не думаю, что геополитическое влияние DeepSeek-R1 еще полностью осознано, но для разработчиков приложений ИИ это просто находка. Моя команда уже приступила к мозговому штурму новых идей, которые могут быть реализованы только с помощью открытых, продвинутых моделей вывода. Сейчас все еще самое лучшее время для создания приложений ИИ!

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...