AssemblyAI: высокоточная платформа для анализа речи в текст и аудиоинтеллекта

Общее введение

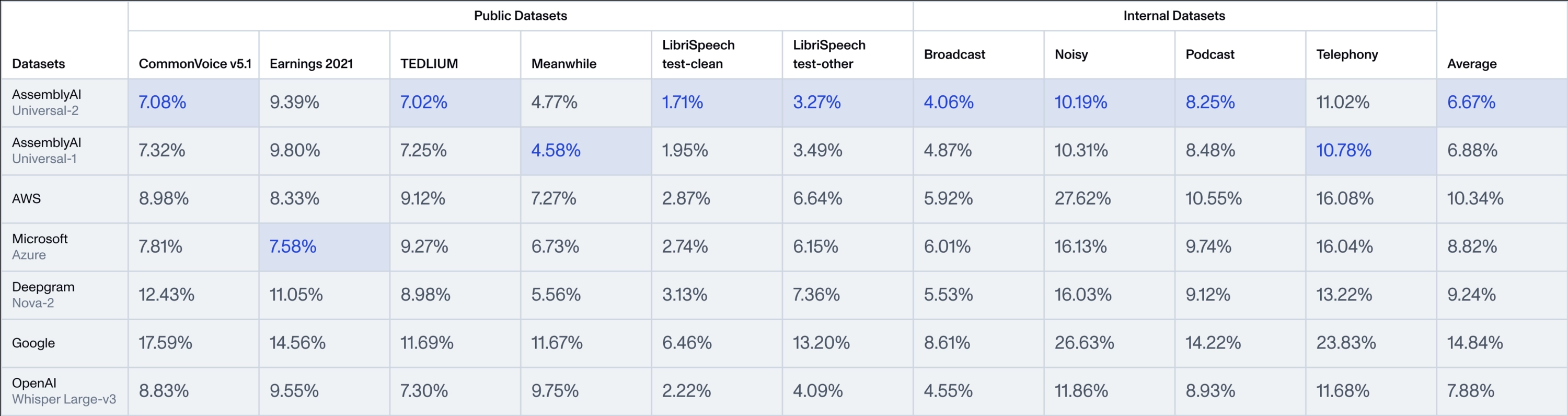

AssemblyAI - это платформа, ориентированная на технологии речевого искусственного интеллекта, предоставляющая разработчикам и предприятиям эффективные инструменты для анализа речи в текст и аудио. Основным направлением является серия моделей Universal, особенно недавно выпущенная Universal-2, которая является самой продвинутой моделью преобразования речи в текст на сегодняшний день. universal-2 основана на базе Universal-1 с более чем 12,5 миллионами часов многоязычных аудиоданных для обучения, и способна точно передать сложность реальных разговоров и предоставить высокоточные аудиоданные. Universal-2 создан на основе Universal-1 с более чем 12,5 миллионами часов многоязычных данных аудиообучения, чтобы точно передать сложность реальных диалогов и предоставить высокоточные аудиоданные. По сравнению с Universal-1, Universal-2 улучшает 241 TP3T в распознавании правильных существительных (например, имен, брендов), 211 TP3T в распознавании смешанного цифро-алфавитного содержимого (например, телефонных номеров, почтовых ящиков) и 151 TP3T в форматировании текста (например, пунктуации, капитализации), значительно снижая точность "последней мили" традиционной модели. "AssemblyAI открывает эти передовые технологии для глобальных пользователей с помощью простых в использовании API-интерфейсов и уже используется Spotify, Fireflies и другими компаниями для создания интеллектуальных речевых продуктов в таких областях, как запись совещаний и анализ контента.

Список функций

- преобразование речи в текст: Преобразование аудиофайлов или живых аудиопотоков в высокоточный текст с поддержкой нескольких языков и различных аудиоформатов.

- Обнаружение спикера: Автоматическое определение различных дикторов в аудио для сценариев диалога между несколькими людьми.

- Анализ настроения: Анализ эмоциональных тенденций в речи, таких как положительные, отрицательные или нейтральные, для улучшения пользовательского опыта.

- транскрипция в режиме реального времени: Обеспечивает функциональность преобразования речи в текст в реальном времени с низкой задержкой, подходящую для голосовых агентов или живых субтитров.

- Моделирование аудиоинтеллекта: Включает в себя расширенные функции, такие как просмотр контента, определение темы, поиск ключевых слов и многое другое.

- Рамка LeMUR: Обработка транскрибированного текста с помощью крупномасштабной языковой модели, поддержка создания резюме, вопросов и ответов и многое другое.

- Поколение субтитров: Поддерживает экспорт файлов субтитров в формате SRT или VTT для упрощения создания видеоконтента.

- Конфиденциальность PII: Автоматически определяет и блокирует конфиденциальную информацию в аудио, например имена или номера телефонов.

Использование помощи

AssemblyAI - это облачный API-сервис, который не требует локальной установки для использования своих мощных возможностей. Здесь представлено подробное руководство, которое поможет вам начать работу и глубже изучить его возможности.

Регистрация и получение ключей API

- Посетите официальный сайт: Откройте браузер и введите

https://www.assemblyai.com/Перейдите на главную страницу. - Зарегистрируйтесь для получения учетной записиНажмите на кнопку "Зарегистрироваться" в правом верхнем углу и введите адрес электронной почты и пароль, чтобы завершить процесс регистрации. После регистрации вы автоматически войдете в панель управления.

- Получить ключ: Найдите область "Ключ API" на приборной панели и нажмите "Копировать", чтобы скопировать ключ. Это единственная учетная запись для вызова API, и ее следует хранить в безопасности.

- Бесплатная пробная версия: Бесплатный кредит для новых пользователей, не нужно сразу привязывать способы оплаты.

Основная функция Эксплуатация

Основой AssemblyAI является интеграция с API, и ниже приведен пример использования семейства моделей Universal на языке Python. Вы также можете использовать другие языки (например, Java, Node.js), обратившись к документации на сайте.

Передача речи в текст (Универсал-2)

- предварительно: Убедитесь, что имеется аудиофайл (например.

sample.mp3) или ссылку URL. - Установка SDK: Запускается в терминале:

pip install assemblyai

- пример кода::

import assemblyai as aai

aai.settings.api_key = "你的API密钥" # 替换为你的密钥

transcriber = aai.Transcriber()

transcript = transcriber.transcribe("sample.mp3")

print(transcript.text) # 输出文本,如“今天天气很好。”

- Сильные стороны "Универсал-2: По умолчанию используется модель Universal-2, которая распознает собственные существительные (например, "Чжан Вэй") и форматированные числа (например, "6 марта 2025") точнее, чем Universal-1, часто за несколько секунд. Время обработки обычно составляет всего несколько секунд.

транскрипция в режиме реального времени

- Применимые сценарии: Прямые трансляции, телеконференции и другие потребности в режиме реального времени.

- пример кода::

from assemblyai import RealtimeTranscriber import asyncio async def on_data(data): print(data.text) # 实时输出文本 transcriber = RealtimeTranscriber( api_key="你的API密钥", sample_rate=16000, on_data=on_data ) async def start(): await transcriber.connect() await transcriber.stream() # 开始接收音频流 asyncio.run(start()) - рабочий процессГоворите в микрофон после выполнения задания, и текст будет отображаться в реальном времени. Низкая задержка Universal-2 обеспечивает быстрые и точные результаты.

Обнаружение спикера

- Метод включения::

config = aai.TranscriptionConfig(speaker_labels=True) transcript = transcriber.transcribe("sample.mp3", config=config) for utterance in transcript.utterances: print(f"说话人 {utterance.speaker}: {utterance.text}") - Примеры результатов::

说话人 A: 你好,今天会议几点? 说话人 B: 下午两点。 - привлекать внимание к чему-л.: Universal-2 более стабильно работает при разговоре с несколькими людьми и уменьшает путаницу.

Анализ настроения

- Метод включения::

config = aai.TranscriptionConfig(sentiment_analysis=True) transcript = transcriber.transcribe("sample.mp3", config=config) for result in transcript.sentiment_analysis: print(f"文本: {result.text}, 情感: {result.sentiment}") - Примеры результатов::

文本: 我很喜欢这个产品, 情感: POSITIVE 文本: 服务有点慢, 情感: NEGATIVE

Поколение субтитров

- операционный код::

transcript = transcriber.transcribe("sample.mp3") with open("captions.srt", "w") as f: f.write(transcript.export_subtitles_srt()) - в конце концов: Создать

.srtфайл, который можно напрямую импортировать в программу для редактирования видео.

Особенности: LeMUR Framework

- Введение функции: LeMUR сочетает в себе крупномасштабное моделирование языка для обработки результатов транскрипции, например, для создания аннотаций.

- процедура::

- Получите идентификатор транскрипта:

transcript = transcriber.transcribe("sample.mp3") transcript_id = transcript.id - Создайте резюме:

from assemblyai import Lemur lemur = Lemur(api_key="你的API密钥") summary = lemur.summarize(transcript_id) print(summary.response) - Образец вывода: "На встрече обсуждался ход работы над проектом, который планируется завершить на следующей неделе".

- Получите идентификатор транскрипта:

предостережение

- Поддерживаемые форматы: Совместимость с 33 аудио/видео форматами, такими как MP3, WAV и др.

- Настройки языкаПоддерживается 99+ языков, доступ к которым можно получить через

language_code="zh"Укажите китайский язык. - выставление счетов: Оплата за час звучания, цены смотрите на официальном сайте.

Следуя этим шагам, вы сможете в полной мере использовать мощные возможности Universal-2 для создания эффективных голосовых приложений.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...