AgenticSeek: ИИ-помощник для автоматизации задач, работающий полностью локально

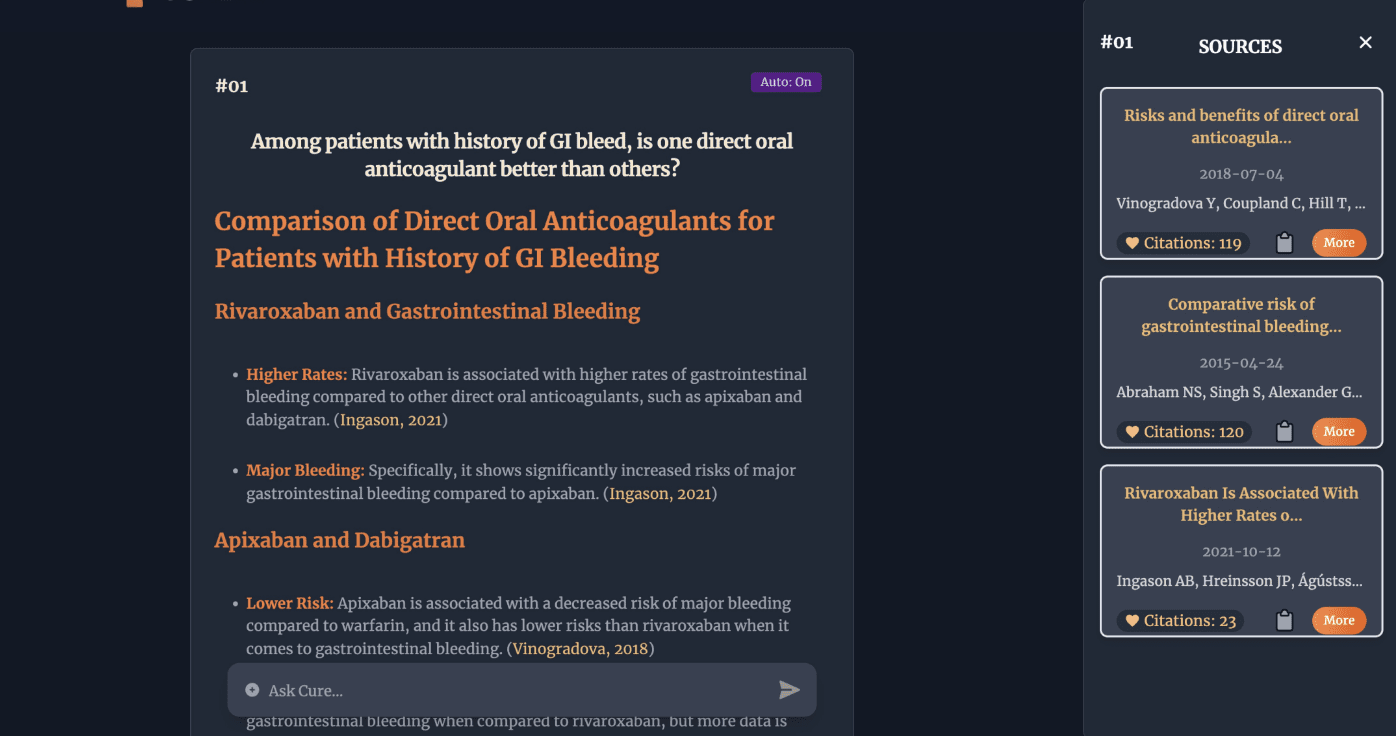

Общее введение

AgenticSeek - это ИИ-помощник с открытым исходным кодом, который работает полностью на базе Deepseek Разработка модели R1. Он не требует облачного API и не влечет за собой ежемесячной платы в сотни долларов. Его цель - стать интеллектуальным помощником, подобным фильму "Джарвис", способным выполнять такие задачи, как написание кода, управление файлами, просмотр веб-страниц и т. д. на компьютере пользователя, обеспечивая при этом конфиденциальность данных. Разработчики Мартин. Legrand позиционирует ее как Манус Локальная альтернатива AI, с акцентом на локальный запуск 100%. По состоянию на март 2025 года на GitHub существует 181 звезда и 16 форков, сообщество продолжает активно развиваться и приветствует участников.

Список функций

- Полностью локальное управление: Не требуется подключение к Интернету, все вычисления производятся на устройстве пользователя, и утечка данных исключена.

- голосовое взаимодействие: Поддерживает голосовые команды и голосовые ответы для повышения удобства работы.

- работа файловой системы: Просмотр и работа с локальными файлами через Bash.

- Написание и отладка кода: Поддержка генерации кода и исправления ошибок для Python, C, Golang и других языков.

- автономная коррекция ошибок: Если команда не выполняется или возникает ошибка кода, ИИ автоматически повторяет попытку и исправляет ее.

- Интеллектуальная постановка задач: Автоматический выбор соответствующего функционального блока в зависимости от типа задачи.

- Совместная работа нескольких агентов: Сложные задачи могут быть разделены, спланированы и выполнены несколькими агентами.

- Поддержка инструментов: Встроенный поиск, изучение файлов и другие утилиты.

- функция памяти: Сохранение истории диалога и предпочтений пользователя, а также поддержка длительных контекстных обменов.

- веб-браузер: Может самостоятельно перемещаться по веб-страницам и извлекать информацию.

Использование помощи

Установка и использование AgenticSeek требует некоторой технической подготовки, но шаги понятны. Ниже приведено подробное руководство, которое поможет вам быстро начать работу.

Процесс установки

- Подготовка к защите окружающей среды

- Убедитесь, что ваш компьютер поддерживает Python 3, рекомендуется не менее 8 ГБ оперативной памяти, а ваш GPU нуждается в более чем 8 ГБ видеопамяти (12 ГБ рекомендуется для моделей 14B).

- Установите Git для загрузки кода.

- Загрузите и установите Ollama (инструмент для работы с локальными моделями), который является зависимым компонентом ядра. Посетите Оллама Официальный сайт Получить.

- Скачать AgenticSeek

- Откройте терминал (CMD или PowerShell для Windows, Terminal для Mac/Linux).

- Введите команду clone project:

git clone https://github.com/Fosowl/agenticSeek.git - Перейдите в каталог проектов:

cd agenticSeek

- Создание виртуальной среды

- Введите команду для создания автономной среды:

python3 -m venv agentic_seek_env - Активируйте окружающую среду:

- Окна:

agentic_seek_env\Scripts\activate - Mac/Linux:

source agentic_seek_env/bin/activate

- Окна:

- Введите команду для создания автономной среды:

- Установка зависимостей

- После активации среды запустите ее:

pip install -r requirements.txt - Или воспользуйтесь сценарием автоматической установки (Mac/Linux):

./install.sh

- После активации среды запустите ее:

- Настройка и загрузка моделей

- Убедитесь, что Ollama установлена, и запустите службу:

ollama serve - загрузка Deepseek R1 модель (рекомендуется 14B, для устройств с низкой конфигурацией - 7B):

ollama pull deepseek-r1:14b - компилятор

config.ini, настроенный на локальный запуск:[MAIN] is_local = True provider_name = ollama provider_model = deepseek-r1:14b

- Убедитесь, что Ollama установлена, и запустите службу:

- Запустить AgenticSeek

- Вход:

python main.py - Появление подсказки терминала означает, что запуск прошел успешно.

- Вход:

Функции Поток операций

голосовое взаимодействие

- Способ открытия: в

config.iniустанавливатьspeak = Trueответить пениемlisten = True. - пользоваться: Скажите "Запустить голосовой режим" при запуске, а затем задавайте вопросы голосом, например "Напишите для меня код".

- точка: ИИ ответит голосом, убедившись, что микрофон и динамики работают.

- принимать к сведению: В первый раз может потребоваться настройка громкости, а на устройствах низкого класса может возникнуть задержка.

работа файловой системы

- Настройка каталога: в

config.iniуказанный вwork_dirнапример./Users/你的用户名/文档. - пользоваться: Введите "List all text files" (Список всех текстовых файлов), и AI выдаст результаты.

- Дополнительные возможности: В нем говорится "Проанализируйте содержимое этого файла", и он извлечет ключевую информацию.

- изысканность: Поддерживаются такие команды Bash, как "создать новую папку".

Написание и отладка кода

- метод работы: Введите "Написать алгоритм сортировки на Python", и ИИ сгенерирует код.

- регулировка компонентов во время тестирования: Если в коде есть ошибка, скажите "исправить эту ошибку", и ИИ проанализирует ее и изменит.

- Поддерживаемые языки: В настоящее время включает Python, C, Golang, позже будет расширен.

веб-браузер

- пользоваться: Введите "Найти последние новости ИИ", и ИИ перейдет на страницу и соберет информацию.

- ограничение: В настоящее время извлекается только текст, парсинг изображений и видео не поддерживается.

- изысканность: Вы можете указать ключевые слова, например "Поиск обновлений Deepseek R1".

автономная коррекция ошибок

- метод работы: Никаких специальных настроек не требуется. Если команда не выполняется, ИИ автоматически пытается восстановить ее.

- типичный пример: Если вы введете неправильную команду "открыть файл X", AI укажет, что файл не существует, и предложит альтернативу.

Дистанционное управление (опция)

- взятьЕсли производительность локального оборудования недостаточна, для запуска модели можно использовать сервер.

- перейти::

- Запустите Ollama на сервере и получите IP-адрес (например.

192.168.1.100). - Запустите серверный скрипт:

python server_ollama.py - локальная модификация

config.ini::[MAIN] is_local = False provider_name = server provider_model = deepseek-r1:14b provider_server_address = 192.168.1.100:5000 - Работает локально:

python main.py

- Запустите Ollama на сервере и получите IP-адрес (например.

предостережение

- требования к оборудованию: модели 7B требуют 8 ГБ видеопамяти, 14B - 12 ГБ (например, RTX 3060), а 32B - 24 ГБ+.

- регулировка компонентов во время тестирования: Если запуск не удался, проверьте, запущена ли Ollama, или проверьте журнал ошибок терминала.

- обновление: Регулярная эксплуатация

git pullПолучите новейшие функции. - лицензия: Проект с открытым исходным кодом и свободен под лицензией GPL-3.0.

сценарий применения

- Средства программирования

Вы застряли при написании кода, например при отладке сложной логики. AgenticSeek генерирует код и исправляет ошибки, а также объясняет детали кода. - Управление документами

Компьютерные файлы захламлены. Создав каталог, AI может перечислять файлы, извлекать их содержимое и даже выполнять пакетные операции. - Поддержка обучения

Студенты могут использовать его для анализа документов, поиска информации и создания заметок с помощью голосового взаимодействия для повышения эффективности работы. - Постановление о конфиденциальности

AgenticSeek работает локально, без подключения к Интернету, что обеспечивает информационную безопасность при работе с конфиденциальными данными.

QA

- Правда ли, что 100% работает локально?

Да, при использовании Ollama или режима сервера вся обработка является локальной, а нелокальные опции (такие как OpenAI) являются только дополнительными. - Что делать, если у меня нет достаточного количества оборудования?

Используйте модель 7B или запустите более высокую модель через удаленный сервер. - А если что-то пойдет не так?

Убедитесь, что Ollama запущена, проверьтеconfig.iniконфигурацию. Если он по-прежнему не работает, вы можете подать заявку на GitHub. - Что лучше, чем Манус ИИ?

Он ориентирован на локальную работу и защиту конфиденциальности для тех, кто не хочет использовать облачные сервисы.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...