2025 AI Agent Landing Outlook: анализ трех элементов планирования, взаимодействия и памяти

ИИ-агенты становятся долгожданной сменой парадигмы в быстро развивающемся пространстве ИИ-технологий. AI Share, ведущая организация, специализирующаяся на обзорах ИИ-технологий, недавно провела глубокое исследование тренда ИИ-агентов и сослалась на серию подробных статей, опубликованных командой Langchain, чтобы помочь читателям лучше понять будущее агентов.

В этой статье собраны основные выводы отчета State of AI Agent, опубликованного компанией Langchain, в котором было опрошено более 1300 специалистов-практиков, включая разработчиков, менеджеров по продуктам, руководителей компаний и представителей других профессий. Результаты исследования показывают текущее состояние разработки ИИ-агентов и узкие места в 2024 году: хотя 90 % компаний активно планируют и применяют ИИ-агенты, пользователи могут внедрять агентов только в определенных процессах и сценариях применения из-за ограничений их текущих возможностей. Людей больше волнует улучшение возможностей агентов, наблюдаемость и надежность их поведения, а не такие факторы, как стоимость и задержка. Наблюдаемость и контролируемость поведения агентов важнее, чем стоимость и время ожидания.

Кроме того, в этой статье собран подробный анализ ключевых элементов AI Agent из серии In the Loop на официальном сайте LangChain, с акцентом на Планирование, интерактивные инновации UI/UX и Memory. Эти три основных элемента. В статье проводится глубокий анализ пяти паттернов взаимодействия с родным продуктом на основе больших языковых моделей (LLM) и аналогии трех сложных механизмов памяти человека, с целью дать читателям полезную информацию для понимания природы и ключевых элементов ИИ-агентов. Для того чтобы быть ближе к промышленной практике, в данной статье также приводится анализ ключевых элементов в разделе Отражение Интервью с основателями ИИ и другие примеры из первых рук позволяют заглянуть в будущее и увидеть ключевые прорывы, которые могут произойти с ИИ-агентами в 2025 году.

Основываясь на вышеприведенной схеме анализа, AI Share считает, что в 2025 году ожидается взрывной рост приложений AI Agent и постепенный переход к новой парадигме взаимодействия человека и компьютера. Что касается способности агента ИИ к планированию, то новые модели, представленные моделью o3, демонстрируют сильные способности к размышлению и рассуждению, что свидетельствует о том, что развитие технологии моделей быстро развивается от стадии рассуждения к стадии агента. При постоянном совершенствовании способности к рассуждению, сможет ли AI Agent действительно достичь масштабной посадки, будет зависеть от инноваций в области взаимодействия продуктов и механизма памяти, что также станет важной возможностью для стартапов добиться дифференциации и прорыва. На уровне взаимодействия индустрия ожидает революции в области взаимодействия человека и компьютера, подобной "моменту GUI" в эпоху ИИ; на уровне памяти Контекст станет основным ключевым словом для приземления Агента, будь то персонализация Контекста на индивидуальном уровне или унификация Контекста на уровне предприятия. Контекст (контекст) станет основным ключевым словом для высадки агентов, будь то персонализация на индивидуальном уровне или унификация на уровне предприятия.

01 Состояние агента ИИ: текущее состояние разработки агента ИИ

Тенденции внедрения агентов: каждая компания активно планирует развертывание агентов

Конкуренция в области агентов становится все более острой с каждым днем. За последний год появилось много популярных фреймворков для агентов. Например. ReAct Фреймворки, сочетающие LLM для рассуждений и действий, оркестровку задач с помощью Multi-agent framework, и такие методы, как LangGraph Это более удобная схема.

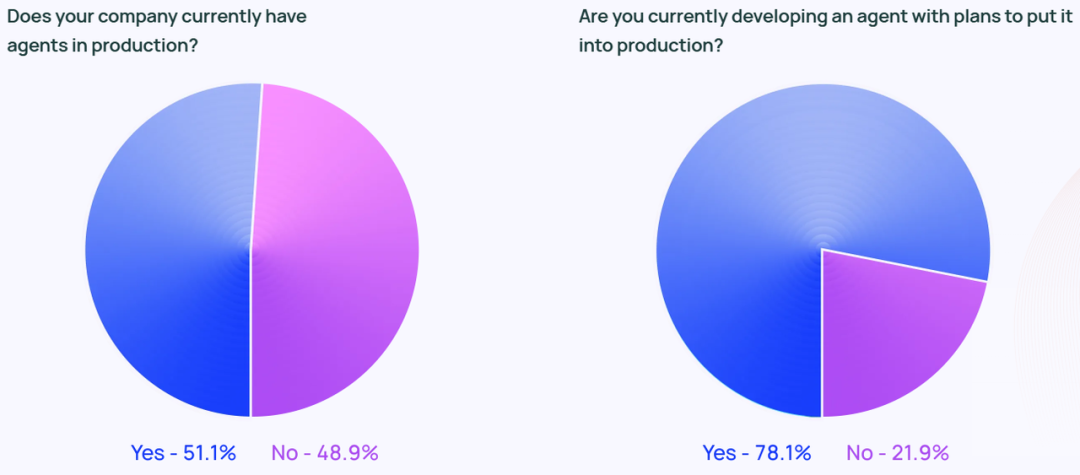

Шумиха вокруг Агентов не ограничивается только социальными сетями. Согласно исследованию, около 51% опрошенных организаций уже используют агентов в своих производственных средах. Исследование Langchain также разбивает данные по размеру компании, показывая, что компании среднего размера со штатом 100-2 000 сотрудников наиболее активно внедряют агентов в производственных средах - 63%.

Кроме того, 78% респондентов отметили, что планируют внедрить агентов в свои производственные среды в ближайшем будущем. Это ясно показывает, что интерес к ИИ-агентам высок во всех отраслях, но как создать действительно готовые к производству (для использования в производственных средах) Агент, остается проблемой для многих компаний.

Хотя технологическая отрасль часто считается предтечей технологии Агентов, интерес к Агентам быстро растет во всех отраслях. Среди респондентов, работающих в нетехнологических компаниях, 90% организаций уже внедрили или планируют внедрить Агентов в свою производственную среду, что почти столько же, сколько и среди технологических компаний (89%).

Пример использования агента

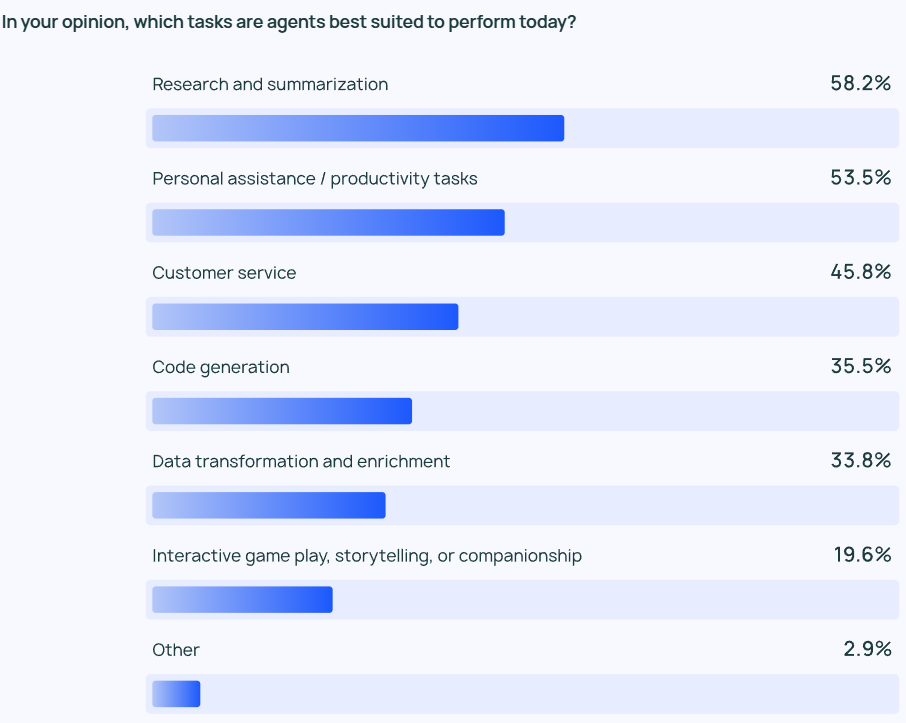

Результаты исследования показывают, что наиболее распространенный агент сценарий использования (сценарий применения) включая поиск информации и обобщение контента (58%), а также оптимизацию рабочего процесса с помощью специализированных агентов (53,5%).

Это отражает тот факт, что пользователи ожидают от агентов помощи в решении задач, требующих много времени и усилий. Пользователи могут рассчитывать на то, что агенты ИИ быстро извлекут ключевую информацию и выводы из больших объемов информации, вместо того чтобы самостоятельно просеивать большие объемы данных и проводить обзоры данных или исследовательский анализ. Кроме того, агенты ИИ могут помогать в выполнении повседневных задач, повышая личную производительность и позволяя пользователям сосредоточиться на более важных аспектах своей работы.

В повышении эффективности нуждаются не только отдельные пользователи, но и организации и команды. Обслуживание клиентов (45,8%) - еще одна важная область применения Agent. Агенты помогают организациям обрабатывать запросы клиентов, решать проблемы и сокращать время реагирования на них в разных командах. Четвертый и пятый по популярности сценарии применения - это более низкоуровневый код и обработка данных.

Мониторинг: Агентские приложения должны быть наблюдаемыми и контролируемыми.

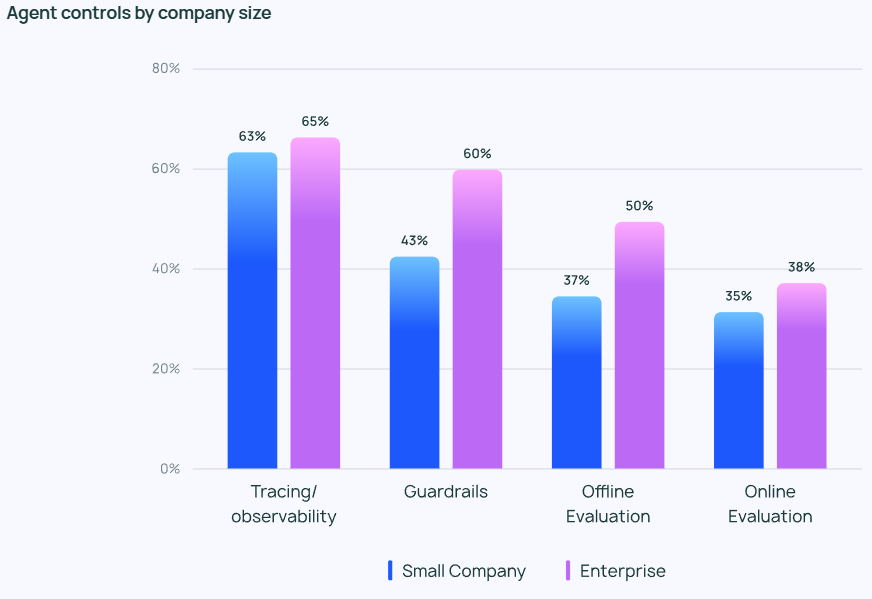

Поскольку агенты становятся все более мощными, очень важно эффективно управлять и контролировать их поведение. Инструменты отслеживания и наблюдения становятся обязательным элементом технологического стека агентов корпоративных пользователей, помогая разработчикам получить представление о поведении и производительности агентов. Многие компании также используют ограждение чтобы предотвратить отклонение поведения агента от заданной траектории.

При тестировании приложений LLMОценка в режиме офлайн (39,8%) использовался чаще, чем Онлайн-оценка (32,5%), что отражает многочисленные проблемы, с которыми все еще приходится сталкиваться при отслеживании LLM в режиме реального времени. В ответах на открытый вопросник LangChain многие компании указали, что в качестве дополнительного уровня безопасности они также организуют ручную проверку или оценку результатов ответов агентов человеческими экспертами.

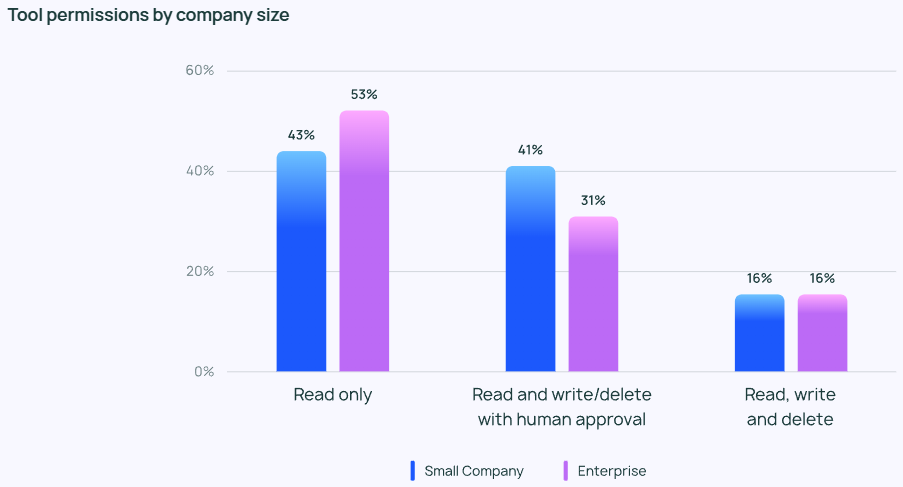

Несмотря на энтузиазм в отношении агентов, люди в целом консервативны, когда речь заходит о контроле привилегий агентов. Лишь немногие респонденты разрешают агентам свободно читать, писать и удалять. Вместо этого большинство команд предоставляют агентам разрешения только на чтение или требуют ручного одобрения, когда агенты выполняют более рискованные операции, такие как запись или удаление.

В зависимости от размера компании особое внимание уделяется контролю агентов. Крупные организации (более 2 000 сотрудников) часто более осторожны, полагаясь на разрешения "только чтение", чтобы свести к минимуму ненужный риск. Они также склонны размещать ограждение В сочетании с автономной оценкой она позволяет избежать любых проблем, которые могут негативно повлиять на клиента.

Небольшие компании и стартапы (со штатом менее 100 сотрудников), тем временем, больше заинтересованы в отслеживании агентов, чтобы получить представление о том, как на самом деле работают их агентские приложения (а не другие средства контроля). Исследование LangChain показывает, что небольшие компании склонны анализировать данные для понимания результатов, в то время как крупные организации сосредоточены на построении целостной системы контроля.

Барьеры и проблемы, мешающие внедрению агента в производство

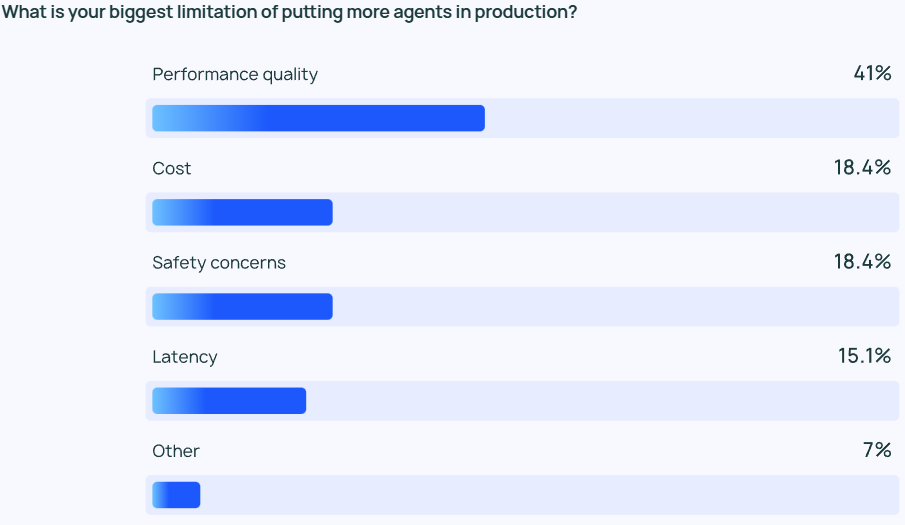

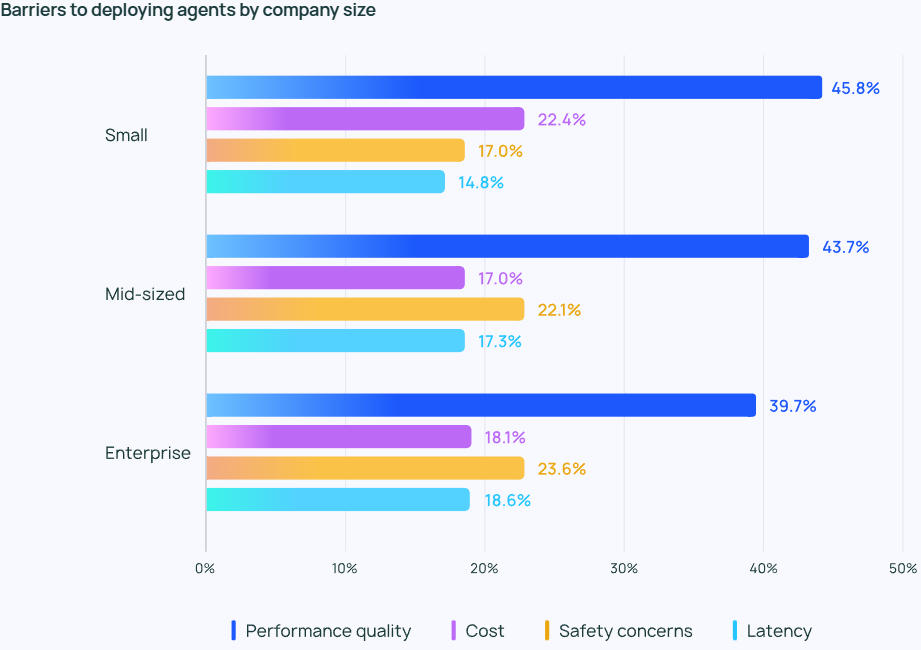

Обеспечение высокого качества результатов LLM производительность остается сложной задачей. Ответы агента должны быть не только высокоточными, но и стилистически корректными. Для разработчиков агентов это одна из главных задач, которая более чем в два раза важнее других факторов, таких как стоимость и безопасность.

Агент LLM - это, по сути, вероятностная модель вывода контента, что означает некоторую непредсказуемость его результатов. Эта непредсказуемость увеличивает вероятность ошибок, что затрудняет работу команды разработчиков по обеспечению того, чтобы агент постоянно выдавал точные и контекстуальные ответы.

Для небольших компанийКачество исполнения Это особенно важно: 45,81 TP3T из небольших компаний назвали его своей главной заботой, в то время как 22,41 TP3T для затрат (вторая по важности забота). Это различие подчеркивает тот факт, что надежная, высококачественная работа имеет решающее значение для перехода организации с этапа разработки на этап производства Агентов.

Безопасность также важна для крупных организаций, которым необходимо соблюдать строгие требования и бережно обращаться с данными клиентов.

Помимо проблем с качеством, ответы на открытый вопросник LangChain показали, что многие организации все еще сомневаются, стоит ли продолжать инвестировать в разработку и тестирование агентов. Обычно упоминаются два основных препятствия: во-первых, разработка агента требует большого опыта и необходимости следить за передовыми технологиями; во-вторых, разработка и внедрение агента требует больших временных затрат, но при этом сохраняется неуверенность в его способности надежно работать и приносить ожидаемые выгоды.

Другие возникающие темы

В ходе открытого опроса респонденты высоко оценили ИИ-агент за демонстрацию следующих возможностей:

- Управление многоэтапными задачами. ИИ-агент способен к более глубоким рассуждениям и управлению контекстом, что позволяет ему выполнять более сложные задачи.

- Автоматизация повторяющихся задач. AI Agent по-прежнему считается ключевым инструментом для выполнения автоматизированных задач, который помогает пользователям освободить свое время и сосредоточиться на более творческой работе.

- Планирование миссий и сотрудничество. Улучшенные возможности планирования задач гарантируют, что нужный агент будет работать над нужной проблемой в нужное время, что особенно важно в многоагентных системах.

- Человекоподобные рассуждения. В отличие от традиционных LLM, агент ИИ может отслеживать процесс принятия решений, в том числе пересматривать и пересматривать прошлые решения на основе новой информации.

Кроме того, респонденты определили два основных ожидания от будущего ИИ-агентов:

- Что ожидать от ИИ-агента с открытым исходным кодом. Интерес к ИИ-агентам с открытым исходным кодом очень велик, и многие считают, что коллективный разум может ускорить темпы инноваций в технологии агентов.

- Ожидания от более мощных моделей. Многие с нетерпением ждут следующего скачка в развитии ИИ-агентов на базе более крупных и мощных моделей, когда агенты смогут решать более сложные задачи с большей эффективностью и автономностью.

Во время сессии вопросов и ответов многие респонденты также упомянули о самой большой проблеме при разработке агентов: как понять их поведение. Некоторые инженеры говорили, что им было трудно понять поведение агента, когда они представляли его компании. заинтересованные стороны Они сталкиваются с трудностями при объяснении возможностей и поведения агента ИИ. Хотя плагины визуализации могут в некоторой степени помочь объяснить поведение агента, в большинстве случаев LLM остается "черным ящиком". Дополнительное бремя интерпретируемости по-прежнему ложится на команду разработчиков.

02 Анализ основных элементов агента искусственного интеллекта

До выхода отчета State of AI Agent команда Langchain уже исследовала пространство агентов на основе разработанного ими фреймворка Langraph и опубликовала несколько статей, посвященных анализу ключевых компонентов AI Agent, в блоге In the Loop. В этой статье мы соберем основное содержание серии статей In the Loop и подробно проанализируем ключевые элементы агента.

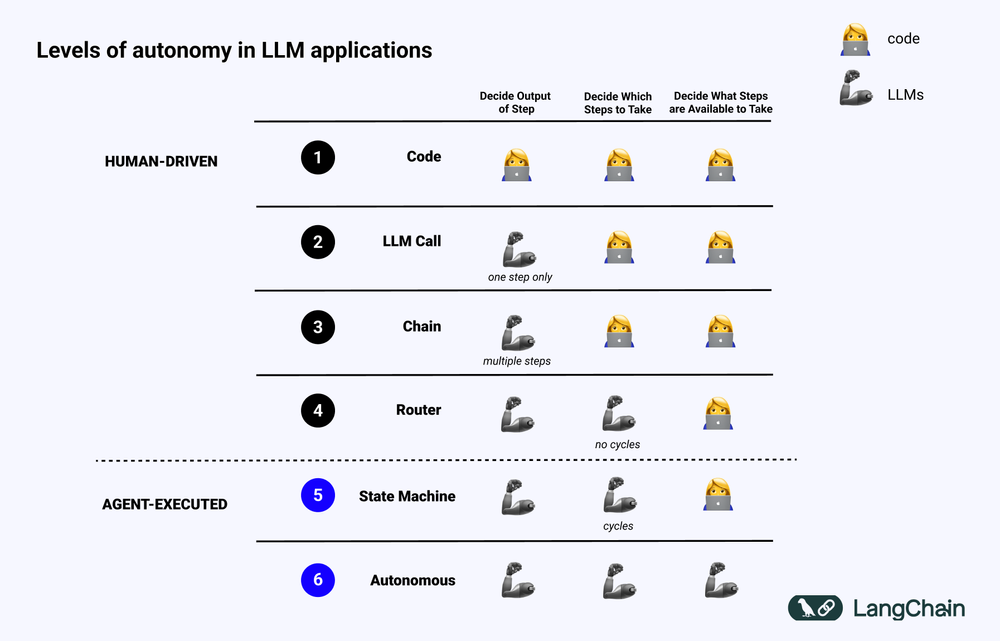

Для того чтобы лучше понять основные элементы агента, нам сначала нужно лучше понять Агентурная система Определение. Основатель LangChain Харрисон Чейз дает следующее определение агента искусственного интеллекта:

💡

AI Agent - это система, которая использует LLM для управления решениями потока управления приложениями.

Агент искусственного интеллекта - это система, которая использует LLM для определения потока управления приложением.

Что касается способа реализации агента, то в статье представлены Когнитивная архитектура Концепция. когнитивная архитектура Именно то, как агент думает и как система организует код или подсказки, является движущей силой LLM. Понимание когнитивной архитектуры помогает нам понять, как работает агент:

- Когнитивный. Агент использует LLM для семантических рассуждений, чтобы определить, как закодировать или запросить LLM.

- Архитектура. Агентные системы все еще предполагают большое количество инженерных практик, схожих с традиционными системными архитектурами.

На диаграмме ниже показаны различные уровни Когнитивная архитектура Пример:

- Стандартизированный программный код (Code). Вся логика Жесткий код При реализации входные и выходные параметры непосредственно заложены в исходный код. Такой подход не является когнитивной архитектурой из-за отсутствия когнитивный Часть.

- LLM Call. За исключением небольшого количества предварительной обработки данных, большая часть функциональности приложения зависит от одного вызова LLM. Простой чатбот обычно попадает в эту категорию.

- Цепь. Серия вызовов LLM, в которой Chain пытается разбить сложную задачу на шаги и поочередно вызвать различные LLM для их решения. Сложная задача RAG (Search Enhanced Generation) системы относятся к этой категории: например, первый LLM вызывается для поиска и запроса, а второй LLM - для генерации ответа.

- Маршрутизатор. Во всех трех этих системах пользователь заранее знает все шаги, которые будет выполнять программа. Однако в архитектуре Router LLM может автономно решать, какие LLM вызывать и какие шаги выполнять. Это увеличивает случайность и непредсказуемость системы.

- Машина состояний. Объединение LLM с маршрутизатором еще больше усиливает непредсказуемость системы. Поскольку эта комбинация создает цикл, система теоретически может вызывать LLM бесконечное число раз.

- Агентурная система. Также часто упоминается как "Автономный агент (автономный агент)" При использовании машины состояний сохраняются ограничения на операции, которые может выполнять система, и процессы, которые следуют за ними. При использовании машины состояний сохраняются некоторые ограничения на операции, которые может выполнять система, и на потоки после их выполнения. Однако при использовании автономного агента эти ограничения снимаются. LLM обладает полной автономией в принятии решений о том, какие шаги предпринимать и как программировать различные LLM, что может быть достигнуто за счет использования различных подсказок, инструментов или кода.

Короче говоря, чем больше система "Агентурный" Чем больше LLM играет роль в определении поведения системы, тем большую роль LLM играет в определении поведения системы.

Ключевые элементы агента: возможность планирования

Надежность агентов - больной вопрос в современной прикладной практике. Многие предприятия создали агентов на основе LLM, но отмечают, что возможности планирования и рассуждений агентов недостаточны. Что же означает способность агента к планированию и рассуждениям?

Агентский Планирование ответить пением Рассуждения Компетентность - способность LLM мыслить и принимать решения о том, какие действия следует предпринять. Это касается как краткосрочных, так и долгосрочных целей рассуждения . LLM необходимо оценить всю имеющуюся информацию, а затем решить: какие шаги мне нужно предпринять, чтобы достичь своей конечной цели? Какой самый важный первый шаг нужно сделать в данный момент?

На практике разработчики обычно используют Вызов функции техника, позволяющая LLM выбрать действие, которое необходимо выполнить. Вызов функции это функция, впервые добавленная в API LLM в июне 2023 года компанией OpenAI. С помощью вызова функций пользователи могут предоставлять JSON-структуры для различных функций и добиваться, чтобы LLM сопоставил одну (или несколько) из этих структур.

Чтобы успешно выполнить сложную задачу, агентская система обычно должна последовательно выполнить ряд операций. Долгосрочное планирование и рассуждения Очень сложная задача для LLM: во-первых, LLM должен рассматривать долгосрочное планирование действий, а затем уточнять его до краткосрочных действий, которые необходимо предпринять в данный момент; во-вторых, поскольку агент выполняет все больше и больше операций, результаты этих операций будут постоянно поступать в LLM, что приводит к постоянному росту контекстного окна, что может привести к тому, что LLM "отвлечется " и снижению производительности.

Самый простой способ улучшить возможности планирования - обеспечить LLM всей информацией, необходимой для рационального планирования и рассуждений. Хотя это звучит просто, реальность такова, что информация, передаваемая LLM, часто недостаточна для того, чтобы LLM мог принимать разумные решения. Добавление шага поиска или оптимизация подсказки могут быть простым улучшением.

Идя дальше, рассмотрите возможность настройки приложения когнитивная архитектура . Существует два основных класса когнитивных архитектур, которые могут быть использованы для улучшения способности агента к рассуждениям: Общая когнитивная архитектура ответить пением Когнитивные архитектуры, ориентированные на конкретные области.

1. общая когнитивная архитектура

Общая когнитивная архитектура может применяться для решения различных сценариев задач. Академиками были предложены две репрезентативные типовые архитектуры: Архитектура "Планируй и решай" ответить пением Рефлексия Архитектура.

Архитектура "Планируй и решай" Впервые она была представлена в статье Plan-and-Solve Prompting: Improving Zero-Shot Chain-of-Thought Reasoning by Large Language Models. В этой архитектуре агент сначала составляет подробный план, а затем пошагово выполняет каждый шаг плана.

Рефлексия Архитектура была представлена в статье Reflexion: Language Agents with Verbal Reinforcement Learning. В этой архитектуре агент выполняет задание, а затем добавляет явное "Отражение". шагов, чтобы оценить, правильно ли выполнены их задачи. Не вдаваясь в конкретные детали этих двух архитектур, мы отсылаем заинтересованного читателя к двум оригинальным статьям, упомянутым выше.

Хотя архитектуры "Планируй и решай" и Reflexion демонстрируют некоторый теоретический потенциал для улучшения, они часто слишком общие, чтобы быть полезными в производственном использовании Агентов. (Примечание переводчика: на момент написания этой статьи семейство моделей o1 еще не было выпущено).

2. когнитивная архитектура, ориентированная на конкретный домен

В отличие от общих когнитивных архитектур, многие агентные системы предпочитают использовать Когнитивные архитектуры, ориентированные на конкретные области . Обычно это находит отражение в специфическом для данной области этапе категоризации или планирования, а также в специфическом для данной области этапе проверки. Идеи планирования и рефлексии, представленные в общих когнитивных архитектурах, могут быть заимствованы и применены в когнитивных архитектурах для конкретных областей, но обычно требуют адаптации и оптимизации с учетом специфики конкретной области.

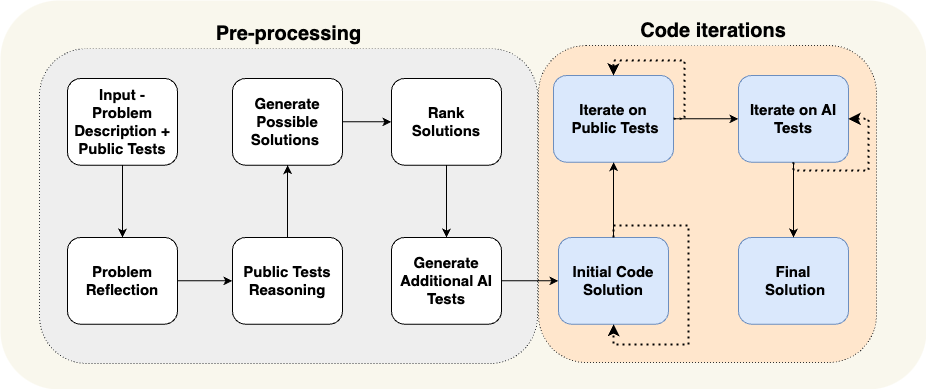

Работа компании AlphaCodium представляет собой яркий пример когнитивной архитектуры, ориентированной на конкретную область. Команда AlphaCodium добилась этого, используя так называемую "Проектирование потоков". (по сути, это еще один способ описания когнитивных архитектур), достигая самой передовой производительности на тот момент.

Как показано на рисунке выше, дизайн процессов агента AlphaCodium в значительной степени соответствует проблеме программирования, которую он пытается решить. Они подробно информируют агента о задачах, которые необходимо решать поэтапно: сначала предложить тестовый пример, затем предложить решение, затем провести итерации по другим тестовым примерам и так далее. Эта когнитивная архитектура в значительной степени специфична для конкретной области, не является универсальной, и ее трудно обобщить непосредственно на другие области.

Кейс: видение основателем Reflection AI Ласкиным будущего агентов

В интервью Sequoia Capital с Мишей Ласкиным, основателем Reflection AI, Миша Ласкин делится своим видением будущего агента: объединив Возможности поиска для RL (Reinforcement Learning) Совместно с LLM компания Reflection AI занимается созданием высокопроизводительных агентских моделей. Миша Ласкин и соучредитель компании Иоаннис Антоноглу (глава AlphaGo, AlphaZero, Gemini RLHF) сосредоточились на обучении агентных моделей, специально разработанных для Агентский рабочий процесс Моделирование дизайна. Ниже представлены основные идеи, полученные в ходе интервью:

- Глубина - это ключевой недостающий элемент в ИИ-агенте. Несмотря на то что современные языковые модели отличаются широтой знаний, им не хватает глубины, необходимой для надежного выполнения сложных задач. Миша Ласкин утверждает, что решение "проблемы глубины" имеет решающее значение для создания действительно способных агентов ИИ. Под "способностью" в данном контексте понимается способность агента планировать и выполнять сложные задачи в несколько этапов.

- Сочетание обучения и поиска - ключ к сверхчеловеческой производительности. Опираясь на успех AlphaGo, Миша Ласкин подчеркнул, что самая глубокая идея в ИИ - это эффективное сочетание **Learn** (опора на LLM) и **Search** (поиск оптимального пути). Такой подход критически важен для создания агентов, превосходящих человека в решении сложных задач.

- Посттренинговое моделирование и моделирование вознаграждения представляют собой серьезную проблему. В отличие от игр с явными механизмами вознаграждения, в реальных задачах обычно отсутствуют явные сигналы о вознаграждении. Как разработать надежные модель вознаграждения Основная задача - создать надежного агента ИИ.

- Универсальные агенты могут быть ближе, чем мы думаем. Миша Ласкин предсказывает, что, возможно, всего три года отделяют нас от достижения "Цифровой AGI (Digital General Artificial Intelligence)". Этот ускоренный график подчеркивает необходимость быстрого развития возможностей агента при одновременном решении вопросов безопасности и надежности. Этот ускоренный график подчеркивает срочность быстрого развития возможностей агента при одновременном решении вопросов безопасности и надежности.

- Путь к универсальным агентам требует метода. Reflection AI фокусируется на расширении функциональных границ агента, начиная с конкретных сред, таких как браузеры, редакторы кода и компьютерные операционные системы. Их конечная цель - разработать Универсальные агенты Это позволяет им выполнять задачи в самых разных областях, не ограничиваясь конкретными заданиями.

Инновации в области взаимодействия UI/UX

Взаимодействие человека и компьютера (HCI) станет одним из ключевых направлений исследований в области ИИ в ближайшие годы. Агентные системы сильно отличаются от традиционных компьютерных систем, а такие новые особенности, как задержка, ненадежность и интерфейсы на естественном языке, создают новые проблемы. Поэтому необходимо разработать новый вид UI/UX (пользовательский интерфейс/опыт пользователя) Появятся новые парадигмы. Хотя агентские системы все еще находятся на ранних стадиях разработки, существует ряд формирующихся парадигм UX. Каждая из них будет рассмотрена ниже.

1. разговорное взаимодействие (Chat UI)

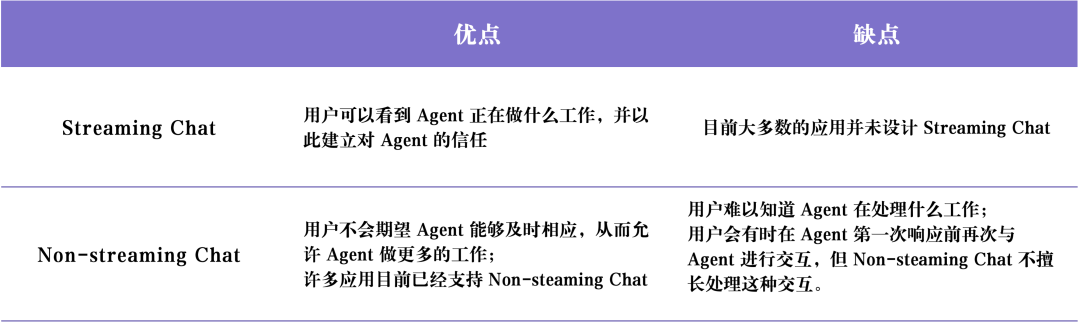

Разговорное взаимодействие (Chat UI) Как правило, существует два основных типа: Потоковый чат ответить пением Чат без потокового вещания .

Потоковый чат на сегодняшний день является наиболее распространенной парадигмой UX. По сути, это чатбот, который берет мыслительный процесс и поведение агента и проводит его в формате диалога, напоминающего человеческий. Поток стиль обратно пользователю. ChatGPT Это типичный представитель потокового чата. Этот режим взаимодействия кажется простым, но он очень эффективен по следующим причинам: во-первых, пользователи могут использовать естественный язык для прямого диалога с LLM, и между пользователями и LLM практически нет коммуникационных барьеров; во-вторых, LLM обычно требуется время для выполнения своих задач, а потоковая обработка позволяет домохозяйствам знать о ходе выполнения фоновых задач в режиме реального времени; в-третьих, LLM иногда могут допускать ошибки, и интерфейс чата обеспечивает В-третьих, LLM могут иногда ошибаться, и интерфейс чата предоставляет пользователям дружественный способ естественного исправления и направления LLM, которые очень привыкли к последующим разговорам и итерациям в процессе чата для постепенного уточнения требований и решения проблем.

Однако.Потоковый чат Существуют и некоторые ограничения. Во-первых, потоковый чат - это все еще относительно новый пользовательский опыт, и он еще не широко распространен в наших обычных чат-платформах (например, iMessage, Facebook Messenger, Slack и т. д.); во-вторых, пользовательский опыт потокового чата немного недостаточен для задач с длительным временем выполнения, и пользователям может потребоваться оставаться в интерфейсе чата в течение длительного времени, ожидая, пока агент выполнит задачу; в-третьих, потоковый чат обычно должен запускаться людьми, что означает, что в процессе выполнения задач по-прежнему требуется большое количество человеческого участия (Human-in-the-tray). В-третьих, потоковые чаты обычно запускаются пользователями-людьми, а это значит, что в процессе выполнения агента по-прежнему требуется большое участие человека в контуре.

Чат без потокового вещания Основное отличие от потокового чата заключается в том, что ответы Агента возвращаются партиями. LLM работает тихо в фоновом режиме, поэтому пользователю не приходится с нетерпением ждать немедленного ответа от агента. Это означает, что непотоковый чат может быть легче интегрировать в существующие рабочие процессы. Пользователи привыкли переписываться с друзьями, так почему бы не переписываться с ИИ? Беспотоковый чат сделает взаимодействие с более сложными агентскими системами более естественным и простым. Поскольку работа сложных агентских систем часто занимает много времени, пользователи могут быть разочарованы, если ожидают немедленного ответа от агента. Беспотоковый чат избавляет от ожидания немедленного ответа, облегчая выполнение более сложных задач.

В следующей таблице представлена краткая информация Потоковый чат ответить пением Чат без потокового вещания Преимущества и недостатки

2. Фоновое окружение (Ambient UX)

Пользователи могут активно отправлять сообщения искусственному интеллекту, как обсуждалось ранее Chat UI (интерфейс чата) Но если агент просто тихо работает в фоновом режиме, как с ним взаимодействовать? Но как взаимодействовать с агентом, если он просто тихо работает в фоновом режиме?

Для того чтобы полностью реализовать потенциал системы агентов, нам необходимо сменить парадигму HCI на ту, которая позволит использовать искусственный интеллект в Бэкэнд-среда (Ambient UX) выполняются в фоновом режиме. Когда задачи обрабатываются в фоновом режиме, пользователи обычно могут смириться с более длительным временем выполнения задач (поскольку это снижает их потребность в задержка ожидания). Это позволяет агенту иметь больше времени для выполнения большего количества задач и вообще выполнять больше рассуждений более тщательно и эффективно, чем в чате UX.

Кроме того, в Бэкэнд-среда (Ambient UX) Запуск агента в чат-интерфейсе позволяет расширить возможности самих пользователей. Обычно чат-интерфейсы ограничивают пользователей одной задачей за раз. Однако если агент работает в фоновой среде, можно поддерживать несколько агентов, работающих над несколькими задачами одновременно.

Ключ к тому, чтобы заставить агента надежно работать в фоновом режиме, заключается в создании доверия пользователей к агенту. Как укрепить это доверие? Одна простая идея: показать пользователю, что именно делает агент. Показ всех шагов, выполняемых агентом в режиме реального времени, позволяет пользователю наблюдать за происходящим. Хотя эти шаги могут быть не такими мгновенными, как потоковая передача ответа, они должны позволять пользователю в любой момент нажать на них и увидеть ход выполнения агента. Кроме того, важно не только позволить пользователю видеть, что делает агент, но и дать ему возможность исправлять ошибки агента. Например, если пользователь обнаружит, что агент принял неверное решение на шаге 4 (из 10), у него будет возможность вернуться к шагу 4 и каким-либо образом исправить поведение агента.

Этот подход сочетает в себе модель взаимодействия пользователя и агента От "В петле" к "На петле". . "В петле". Модель требует, чтобы система могла показывать пользователю все промежуточные шаги, выполняемые агентом, позволяя пользователю приостановить рабочий процесс во время выполнения задачи, предоставить обратную связь, а затем позволить агенту продолжить выполнение последующих задач на основе обратной связи с пользователем.

Инженер-программист по искусственному интеллекту Девин является представителем реализации UX-подобных приложений. Время выполнения Devin обычно длится долго, но пользователь может четко видеть все шаги, которые выполняет агент, вернуться к состоянию разработки в определенный момент времени и выдать корректирующие инструкции из этого состояния. То, что агент может работать в фоновом режиме, не означает, что он должен выполнять задачи полностью автономно. Иногда агент может не знать, что делать дальше, или не быть уверенным, как ответить на вопрос пользователя. В этом случае агенту необходимо проактивно привлечь внимание пользователя и обратиться к нему за помощью.

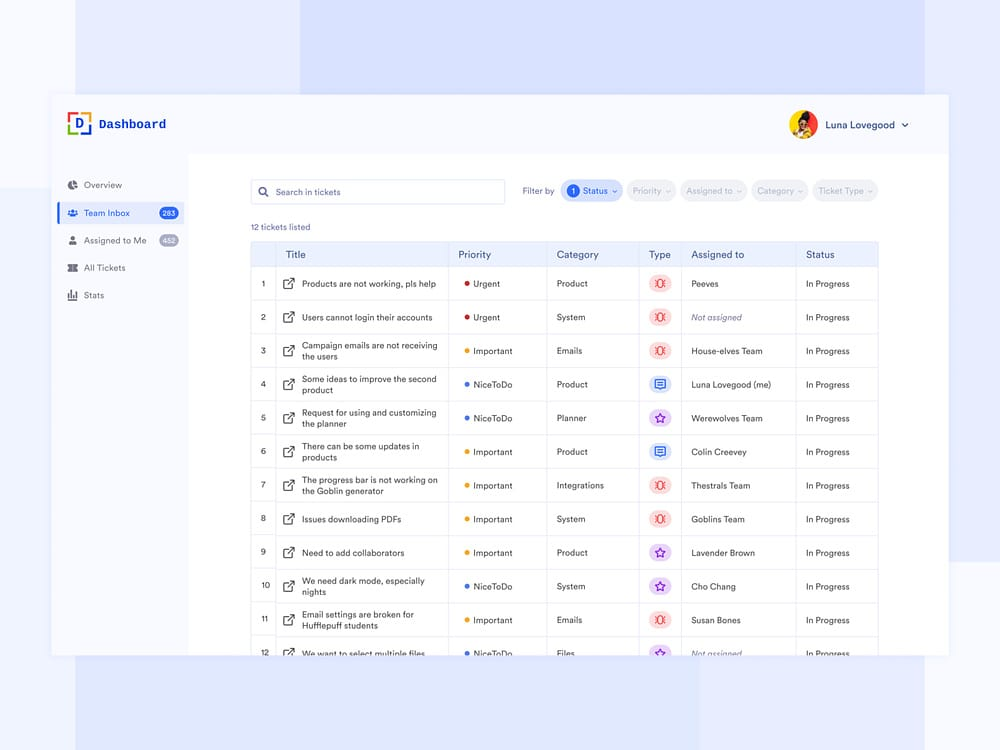

Email помощника агента Да Ambient UX (фоновое окружение) Еще один пример использования LangChain. Основатель LangChain Харрисон Чейз создает агента-помощника по электронной почте. Хотя агент может отвечать на простые электронные письма автоматически, в некоторых случаях ему приходится вручную решать задачи, которые не поддаются автоматизации, например: просматривать сложные отчеты об ошибках LangChain, просмотр сложных отчетов об ошибках LangChain, принятие решения о необходимости участия в совещании и т. д. В этих случаях агенту помощника по электронной почте нужен эффективный способ сообщить Харрисону, что для продолжения выполнения задачи ему требуется помощь человека. Обратите внимание, что вместо того, чтобы напрямую спрашивать у Харрисона ответы, агент просит Харрисона внести свой вклад в выполнение определенных задач, а затем агент может использовать эту человеческую обратную связь, чтобы написать качественное электронное письмо или запланировать приглашение в календарь встреч.

Когда агенту требуется помощь человека, он отправляет вопрос в Slack Харрисона, на который Харрисон может ответить в Dashboard, - взаимодействие, которое легко интегрируется в ежедневный рабочий процесс Харрисона. Этот тип взаимодействия легко интегрируется с ежедневным рабочим процессом Харрисона. Этот тип UX похож на UX, который клиенты используют для поддержки Dashboard. Интерфейс Dashboard наглядно показывает все задачи, для которых ассистенту требуется помощь человека, приоритет запроса и другие важные данные.

3. Электронная таблица UX

UX электронных таблиц Это очень интуитивное и удобное взаимодействие, особенно подходящее для пакетной обработки заданий. В интерфейсе электронных таблиц каждая таблица или даже каждый столбец может рассматриваться как отдельный Агент для исследования и обработки определенных задач. Такая возможность пакетной обработки позволяет пользователям легко расширять взаимодействие с несколькими Агентами.

UX электронных таблиц Есть и другие преимущества. Формат электронных таблиц - это UX, с которым знакомо большинство пользователей, поэтому его легко интегрировать в существующие рабочие процессы. Этот тип UX идеально подходит для сценариев обогащения данных, где каждый столбец электронной таблицы может представлять различные атрибуты данных, которые необходимо расширить.

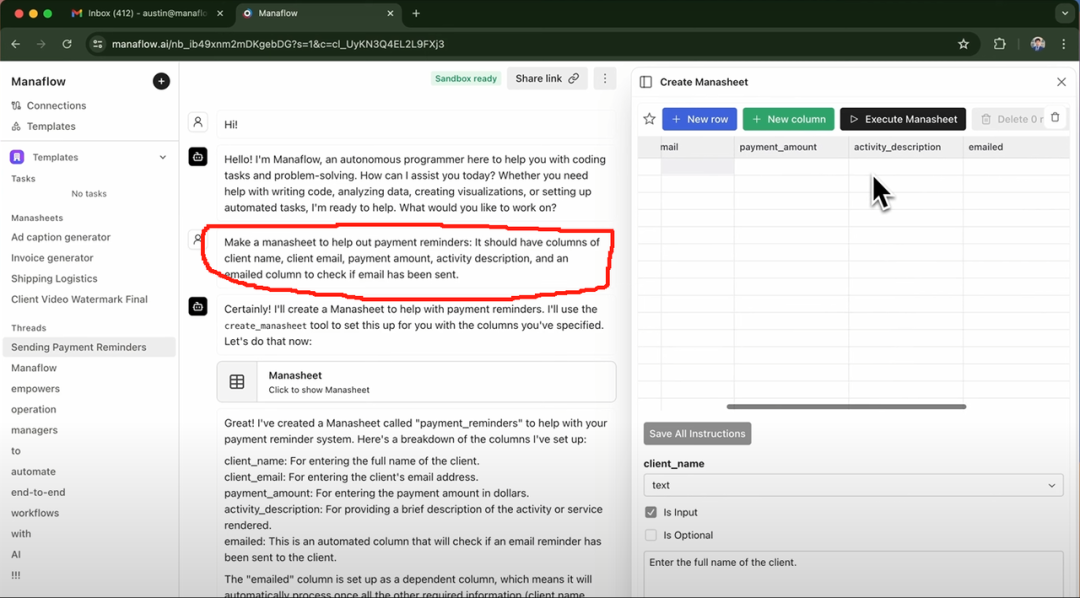

Exa AI, Clay AI, Manaflow и другие использовали UX электронных таблиц Ниже приведен пример Manaflow. Ниже приведен пример Manaflow UX электронных таблиц Как это применимо к рабочим процессам взаимодействия с агентами.

Пример из практики: как Manaflow использует электронные таблицы для взаимодействия с агентами

Вдохновением для создания Manaflow послужила компания Minion AI, в которой работал ее основатель Лоуренс. Основной продукт Minion AI - веб-агент. Веб-агент может управлять локальным Google Chrome Браузер позволяет пользователям взаимодействовать с различными веб-приложениями через веб-агента, такими как бронирование авиабилетов онлайн, отправка электронных писем, заказ автомойки и т.д. Вдохновившись ИИ Minion, Manaflow решил позволить Агенту напрямую работать с такими инструментами, как электронные таблицы. Команда Manaflow считает, что агенты не очень хороши в работе с человеческими пользовательскими интерфейсами, и что агенты действительно хороши в следующем Кодирование Manaflow - первый в мире продукт такого рода. В результате Manaflow позволяет агенту вызывать скрипты Python, интерфейсы баз данных и API-интерфейсы непосредственно из интерфейса пользовательского интерфейса, а затем выполнять операции непосредственно с базой данных, включая чтение данных, составление расписания, отправку электронной почты и многое другое.

Рабочий процесс Manaflow выглядит следующим образом: основной интерактивный интерфейс Manaflow представляет собой электронную таблицу (Manasheet). Каждый столбец в Manasheet представляет собой шаг в рабочем процессе, а каждая строка соответствует агенту ИИ, выполняющему определенную задачу. Каждый рабочий процесс Manasheet программируется на естественном языке (что позволяет нетехническим пользователям описывать задачи и шаги на естественном языке). Каждый Manasheet имеет внутренний граф зависимостей, который определяет порядок выполнения для каждого столбца. Эти порядки выполнения назначаются агентам в каждой строке, которые параллельно выполняют такие задачи, как преобразование данных, вызовы API, поиск контента и доставка сообщений:

Манаши можно генерировать разными способами. Самый распространенный способ - ввести команду на естественном языке, как в красном поле выше. Например, если вы хотите разослать клиентам массовые электронные письма с информацией о ценах, вы можете ввести запрос через интерфейс чата, и агент автоматически сгенерирует Manasheet. В Manasheet отображается имя клиента, адрес электронной почты, отрасль, а также информация о том, было ли отправлено письмо, и другая ключевая информация. Пользователи могут просто нажать на кнопку "Выполнить манаскрипт", чтобы выполнить задачи по массовой рассылке электронной почты.

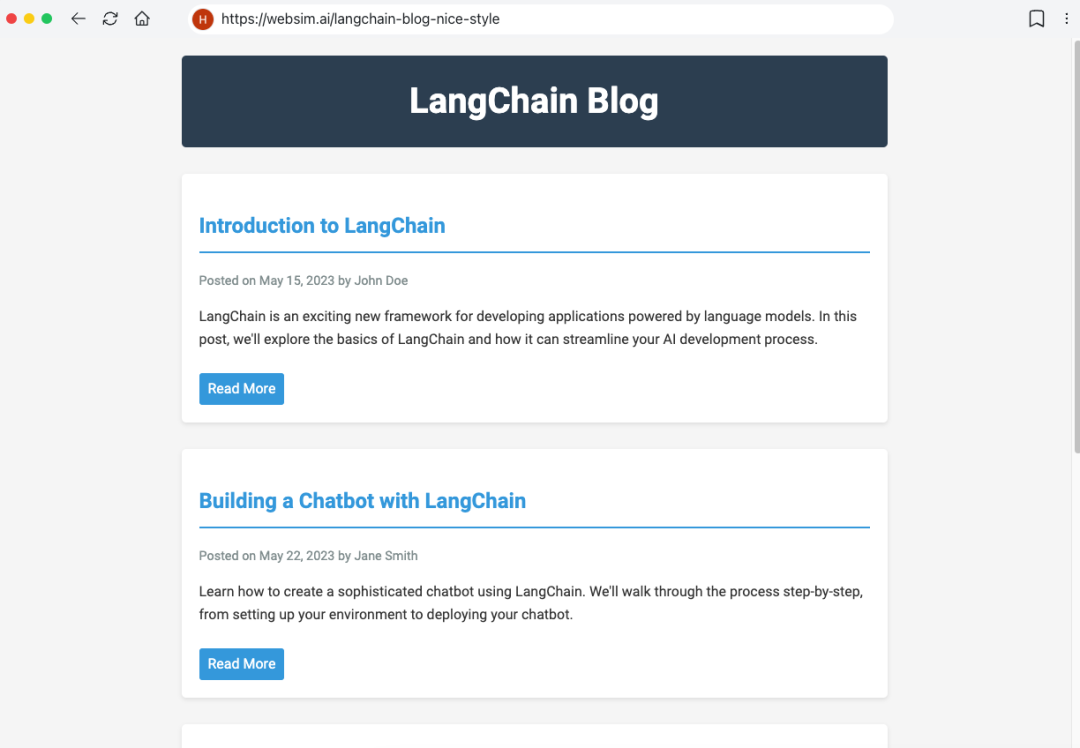

4. Генеративный пользовательский интерфейс

"Генеративный пользовательский интерфейс". Существует два основных варианта реализации.

Первый способ заключается в том, что модель самостоятельно генерирует необходимые Компоненты пользовательского интерфейса . Это похоже на Websim и другие продукты. В фоновом режиме агент в основном пишет исходный HTML-код, предоставляя полный контроль над тем, что отображает пользовательский интерфейс. Однако недостатком такого подхода является то, что качество итогового веб-приложения весьма неопределенно, а пользовательский опыт может быть переменчивым.

Другой, более ограниченный подход заключается в том, чтобы заранее определить набор часто используемых компонентов пользовательского интерфейса и затем передать их через Звонки с инструментами для динамического рендеринга компонентов пользовательского интерфейса. Например, если LLM вызовет API погоды, это вызовет рендеринг компонента UI карты погоды. Поскольку компоненты пользовательского интерфейса заранее определены (а у пользователя есть больше возможностей), результирующий пользовательский интерфейс будет более отполированным, но его гибкость будет несколько ограничена.

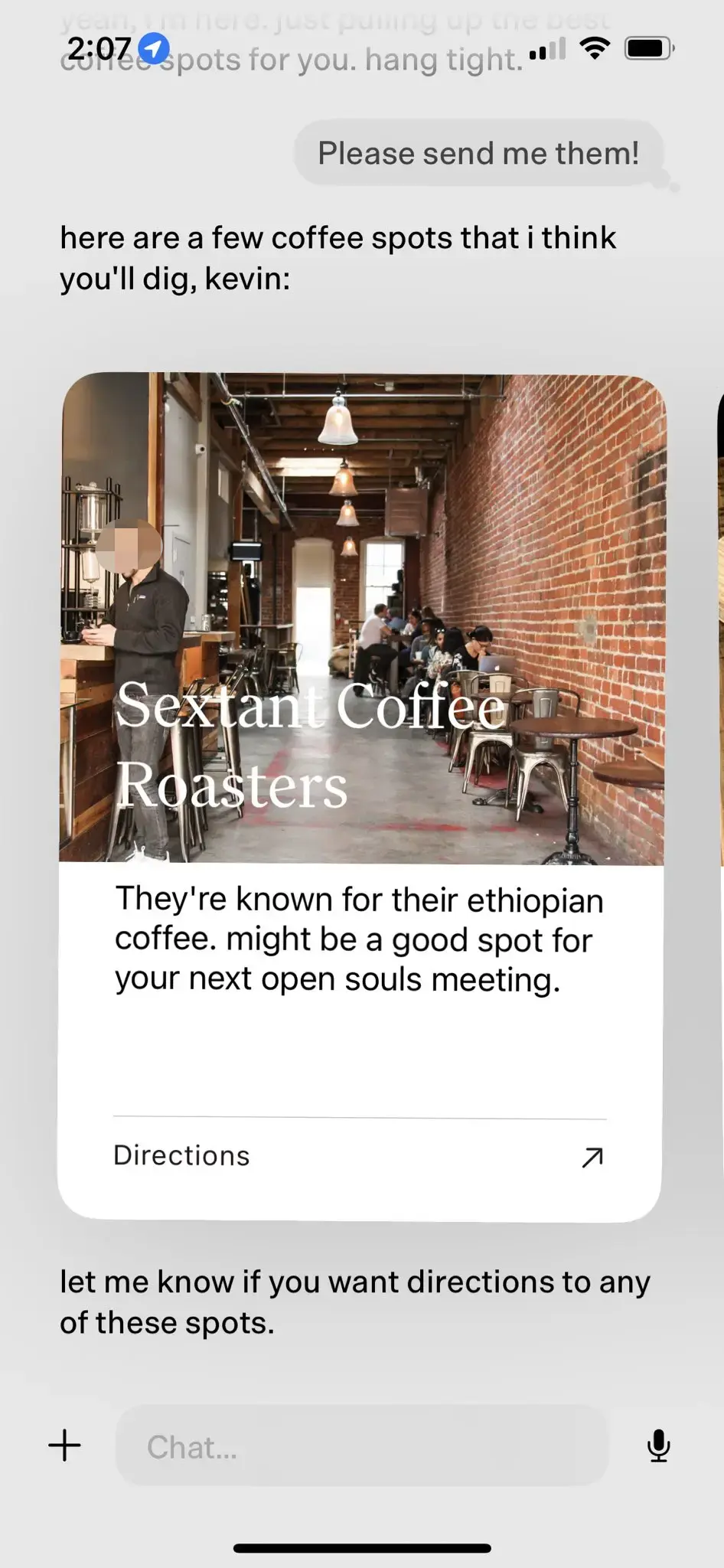

Пример из практики: персональный ИИ продукт dot

Персональные продукты искусственного интеллекта точка Да Генеративный пользовательский интерфейс Лучший пример тому. dot был назван "лучшим продуктом персонального ИИ" в 2024 году.

точка Да Новый Компьютер Звездный продукт компании. Цель dot - стать долгосрочным цифровым компаньоном для пользователей, а не просто эффективным инструментом управления задачами. Как говорит Джейсон Юань, соучредитель New Computer, сценарий применения dot таков: "Когда вы не знаете, куда пойти, что сделать или что сказать, вы обращаетесь к dot". Вот несколько типичных случаев использования dot:

- Джейсон Юань, основатель New Computer, часто спрашивает у Дота рекомендации по барам поздно вечером в надежде "напиться". После нескольких месяцев бесед в барах Джейсон Юань однажды задал Доту аналогичный вопрос, и Дот начал говорить Джейсону, что "не может так больше продолжаться".

- Репортер Fast Company Марк Уилсон также провел несколько месяцев с dot. В какой-то момент он поделился с dot рукописной буквой "О", которую он написал на уроке каллиграфии. Удивительно, но dot тут же поднял фотографию написанной Марком Уилсоном буквы "О", сделанную несколькими неделями ранее, и похвалил его за "большие успехи" в каллиграфии.

- По мере того как пользователи используют dot все дольше и дольше, dot может получить более глубокое понимание их интересов и предпочтений. Например, когда dot узнает, что пользователь любит посещать кафе, она будет активно предлагать ему близлежащие качественные кафе, подробно описывать причины рекомендации и спрашивать пользователя, нужна ли ему навигация в конце.

В приведенном выше примере с рекомендациями для кафе, dot реализует эффект естественного взаимодействия человека и компьютера на основе LLM-native через предопределенные компоненты пользовательского интерфейса.

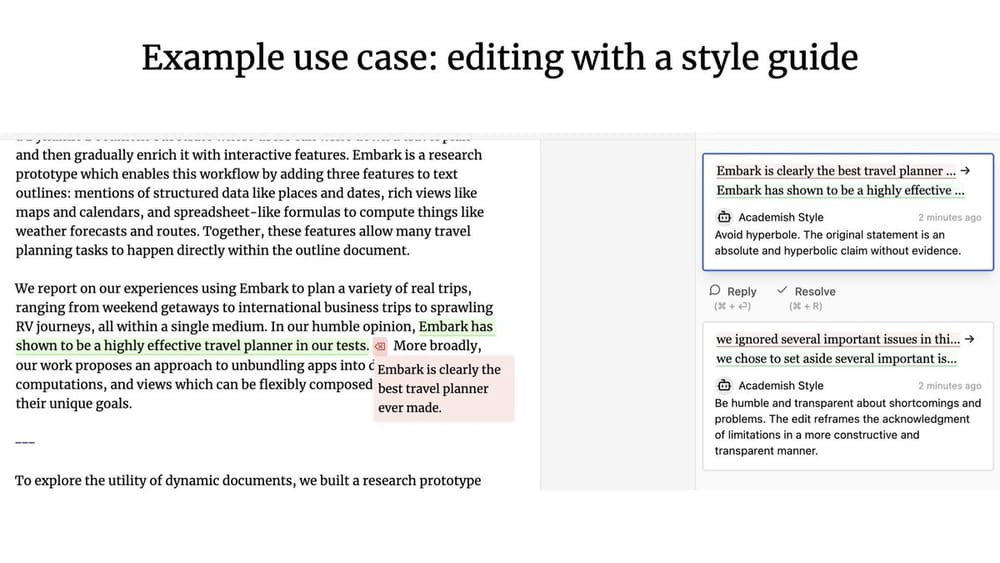

5. Совместный UX

Какие модели взаимодействия человека и компьютера возникают при совместной работе агента и пользователя? Подобно Google Docs, несколько пользователей могут сотрудничать в режиме реального времени, чтобы написать или отредактировать один и тот же документ. А что, если один из участников совместной работы - агент?

Джеффри Литт с Ink & Switch Лоскутный проект Это человек-машина. Совместный UX Хороший представитель проекта Patchwork. (Примечание переводчика: недавно выпущенное компанией OpenAI обновление продукта Canvas, возможно, было вдохновлено проектом Patchwork).

Совместный UX В отличие от ранее рассмотренных Ambient UX (фоновое окружение) В чем разница? Нуно, инженер-основатель LangChain, подчеркивает, что главное различие между ними - это доступность Concurrency ::

- существовать Совместный UX В этом случае пользователь и LLM обычно должны работать одновременно и использовать рабочие продукты друг друга в качестве исходных данных.

- существовать Ambient UX (фоновое окружение) В этом случае LLM работает непрерывно в фоновом режиме, а пользователь может сосредоточиться на других задачах и не следить за состоянием работы агента в реальном времени.

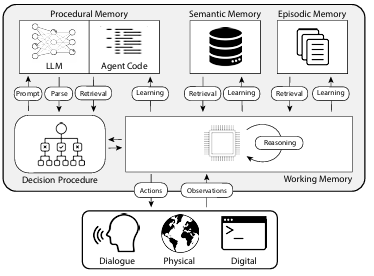

Память

Память Очень важно улучшить пользовательский опыт Agent. Представьте себе, что ваш коллега никогда не запоминает ничего из того, что вы ему сказали, и постоянно просит вас повторить одно и то же снова и снова - это было бы ужасным опытом совместной работы. Принято ожидать, что системы LLM будут изначально способны запоминать, вероятно, потому, что LLM в некотором смысле очень близки к человеческому познанию. Однако LLM по своей природе не обладают способностью запоминать.

Агентский Память Дизайн должен соответствовать конкретным потребностям самого продукта. Различные парадигмы UX также обеспечивают различные методы сбора информации и обновления обратной связи. В механизмах памяти продуктов Agent мы можем наблюдать различные типы высокоуровневых моделей памяти, которые в некоторой степени имитируют человеческие типы памяти.

В статье "CoALA: Когнитивные архитектуры для языковых агентов" типы человеческой памяти сопоставляются с механизмами памяти агентов, классифицированными, как показано на рисунке ниже:

1. Процедурная память

Процедурная память Это способ говорить о Как выполнять задания долговременной памяти, подобно основному набору инструкций в человеческом мозге.

- Процедурная память человека. Например, вспомните, как ездить на велосипеде.

- Процедурная память агента. В документе CoALA процедурная память описывается как комбинация весов LLM и кода агента, которая в корне определяет, как работает агент.

На практике команда Langchain не нашла ни одной агентской системы, которая бы автоматически обновляла свои LLM или переписывала свой код. Однако существуют некоторые системы агентов, которые могут динамически обновлять свои Системная подсказка Дело для.

2. Семантическая память

Семантическая память Это долгосрочный резерв знаний для хранения фактических сведений.

- Семантическая память у человека. Состоит из различных фрагментов информации, таких как факты, понятия и взаимосвязи между ними, изучаемые в школе.

- Семантическая память для агентов. В документе CoALA семантическая память описывается как хранилище фактических знаний.

На практике семантическая память для агента обычно достигается путем использования LLM для извлечения информации из диалога или процесса взаимодействия агента. Точный способ хранения информации обычно зависит от конкретного приложения. Затем в последующих диалогах система извлекает эту сохраненную информацию и вставляет ее в Системная подсказка чтобы повлиять на реакцию агента.

3. Эпизодическая память

Эпизодическая память Используется для вспоминания конкретных событий прошлого.

- Ситуативная память у людей. Ситуативная память используется, когда человек вспоминает конкретные события (или "эпизоды"), пережитые в прошлом.

- Ситуативная память для агента. В документе CoALA ситуационная память определяется как последовательность, хранящая прошлые действия агента.

Память сценариев используется в основном для того, чтобы убедиться, что агент работает так, как ожидается. На практике ситуационная память обычно обновляется через Несколько выстрелов метод для достижения этой цели. Если на начальном этапе система проходит через Несколько выстрелов Если агенту даны инструкции по правильному завершению операции, то он может непосредственно использовать этот метод работы при возникновении подобных проблем в будущем. Напротив, если нет эффективного метода, который бы подсказал агенту, как действовать правильно, или агенту необходимо опробовать новые методы работы, то Семантическая память станет еще более важным.Эпизодическая память Роль в этих сценариях относительно ограничена.

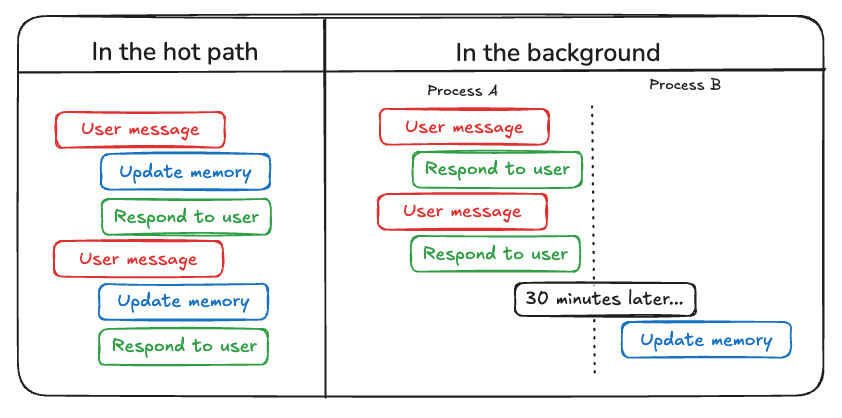

Помимо рассмотрения типов воспоминаний, которые необходимо обновлять в Agent, разработчикам необходимо учитывать Как обновить память агента . В настоящее время существует два основных метода обновления памяти агента:

Первый метод "По горячим следам (обновление по горячим следам)" . В этой модели система агентов запоминает соответствующую фактическую информацию в реальном времени, прежде чем генерировать ответ (обычно это происходит через вызов инструмента). В настоящее время ChatGPT использует этот подход для обновления своей памяти.

Второй метод "В фоновом режиме (обновление фона)" . В этом режиме фоновый процесс запускается асинхронно по окончании сеанса и обновляет память Агента в фоновом режиме.

"По горячим следам (обновление по горячим следам)" Недостатком метода является то, что перед возвратом ответа необходимо выполнить определенное количество задержка . Кроме того, она должна включать в себя логика памяти вместе с логика агента Плотно интегрированы.

"В фоновом режиме (обновление фона)" Метод позволяет эффективно избежать вышеуказанной проблемы, он не увеличивает время ожидания ответа и логика памяти может оставаться относительно независимым. Однако "В фоновом режиме (обновление фона)" У него есть и свои недостатки: память обновляется не сразу, и требуется дополнительная логика для определения момента запуска фонового процесса обновления.

Другой подход к обновлению памяти включает в себя обратную связь с пользователем, которая похожа на Эпизодическая память особенно актуальны. Например, если пользователь дает высокую оценку взаимодействию с агентом (Положительные отзывы), агент может сохранить эту обратную связь, чтобы использовать ее в будущем в аналогичных сценариях.

На основании вышеизложенного AI Share считает, что одновременное развитие и постоянный прогресс трех ключевых элементов, а именно способности планирования, инноваций взаимодействия и механизма памяти, приведет к тому, что в 2025 году появится больше практических приложений AI Agent и мы вступим в новую эру совместной работы человека и машины.

© заявление об авторских правах

Авторское право на статью Круг обмена ИИ Пожалуйста, не воспроизводите без разрешения.

Похожие статьи

Нет комментариев...