综合介绍

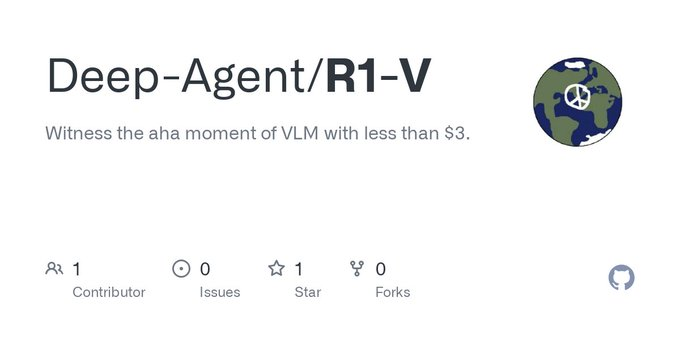

R1-V 是一个开源项目,旨在通过低成本的强化学习(RL)实现视觉语言模型(VLM)的突破。该项目利用可验证的奖励机制,激励 VLMs 学习通用的计数能力。令人惊叹的是,R1-V 的 2B 模型在仅需 100 个训练步骤后,其性能就超过了 72B 模型,而训练成本不到 3 美元。整个训练过程在 8 块 A100 GPU 上进行,耗时仅 30 分钟,总成本为 2.62 美元。R1-V 项目完全开源,用户可以通过 GitHub 平台访问和贡献代码,利用 R1-V 模型进行实验和开发,探索 AI 的无限潜力。

功能列表

- 视觉语言模型:结合图像和文本数据进行处理和分析。

- 强化学习:通过可验证的奖励机制提升模型的泛化能力。

- 低成本训练:在短时间内以低成本实现高效训练。

- 深度学习:支持复杂的深度学习任务,提升模型的准确性和效率。

- 自然语言处理:处理和理解自然语言文本,支持多语言。

- 计算机视觉:分析和理解图像内容,支持图像分类、目标检测等任务。

- 开源代码:提供完整的开源代码,方便用户下载、修改和贡献。

- 社区支持:活跃的开发者社区,提供技术支持和交流平台。

使用帮助

安装流程

- 克隆仓库:在终端中运行以下命令克隆项目仓库:

git clone https://github.com/Deep-Agent/R1-V.git

- 安装依赖:进入项目目录并安装所需依赖:

cd R1-V

pip install -r requirements.txt

- 配置环境:根据项目需求配置环境变量和路径。

使用方法

- 加载模型:在代码中加载 R1-V 模型:

from r1v import R1VModel

model = R1VModel()

- 处理图像和文本:使用模型处理图像和文本数据:

image_path = 'path/to/image.jpg'

text = '描述图像的文本'

result = model.process(image_path, text)

print(result)

- 训练模型:根据需要训练模型以适应特定任务:

model.train(data_loader)

详细功能操作流程

- 图像分类:加载图像并使用模型进行分类:

from PIL import Image

image = Image.open('path/to/image.jpg')

classification = model.classify(image)

print(classification)

- 目标检测:使用模型进行目标检测:

detections = model.detect_objects(image)

for detection in detections:

print(detection)

- 文本生成:根据图像生成描述性文本:

description = model.generate_text(image)

print(description)© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...