ByteDance 등이 고정밀 FLUX에 필적하는 99.51 TP3T 파라미터 감소를 실현한 최초의 1.58비트 FLUX 양자화 모델 출시!

하이라이트 분석

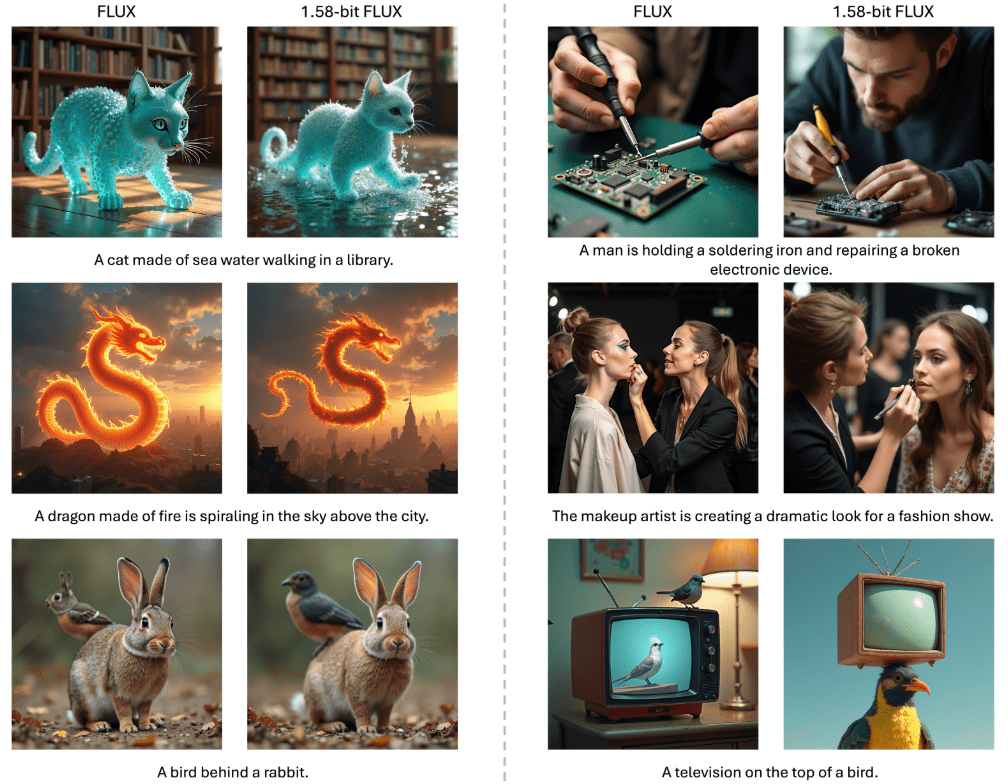

- 1.58비트 FLUX첫 번째는 다음과 같습니다. FLUX 시각적으로 트랜스포머 매개변수(총 119억 개)를 1.58비트 양자화 모델로 99.5% 줄여 이미지 데이터에 의존할 필요가 없어지고 스토리지 요구 사항이 대폭 줄어듭니다.

- 1.58비트 연산에 최적화된 효율적인 선형 커널을 개발하여 상당한 메모리 절감 및 추론 가속화를 달성했습니다.

- 증명 1.58비트 FLUX 까다로운 T2I 벤치마크에서는 고정밀 FLUX 모델과 비슷한 성능을 보였습니다.

빠른 요약

해결된 문제

- 현재 텍스트-생성-이미지(T2I) 모델(예: DALLE 3 및 Stable Diffusion 3)은 추론에 필요한 파라미터 수가 많고 메모리 요구량이 높아 리소스가 제한된 장치(예: 모바일 장치)에 배포하기 어렵습니다.

- 이 백서는 스토리지 및 메모리 요구 사항을 줄이면서 추론 효율을 개선하기 위해 T2I 모델에서 매우 낮은 비트 양자화(1.58비트)의 가능성에 초점을 맞추고 있습니다.

제안 프로그램

- FLUX.1-dev 모델을 양자화 대상으로 선택하고 이미지 데이터에 액세스하지 않고 학습 후 양자화 방법을 사용하여 가중치를 1.58비트({-1, 0, +1}로 제한된 값)로 압축했습니다.

- 추론 효율성을 더욱 개선하기 위한 전용 저비트 연산 최적화 커널을 개발했습니다.

적용된 기술

- 1.58비트 중량 정량화비트넷 b1.58과 유사한 방법을 사용하여 모델의 선형 레이어 가중치를 1.58비트로 압축하고 2비트 부호화된 정수를 통해 가중치를 저장함으로써 매우 낮은 비트화를 달성합니다.

- 비지도 정량적 방법는 FLUX.1-dev 모델 자체의 자체 감독 메커니즘에만 의존하며, 혼합 정밀도 체계나 추가 학습 데이터에 의존할 필요가 없습니다.

- 커스텀 커널저비트 연산에 최적화된 추론 커널로, 메모리 사용량과 추론 지연 시간을 줄여줍니다.

펀치

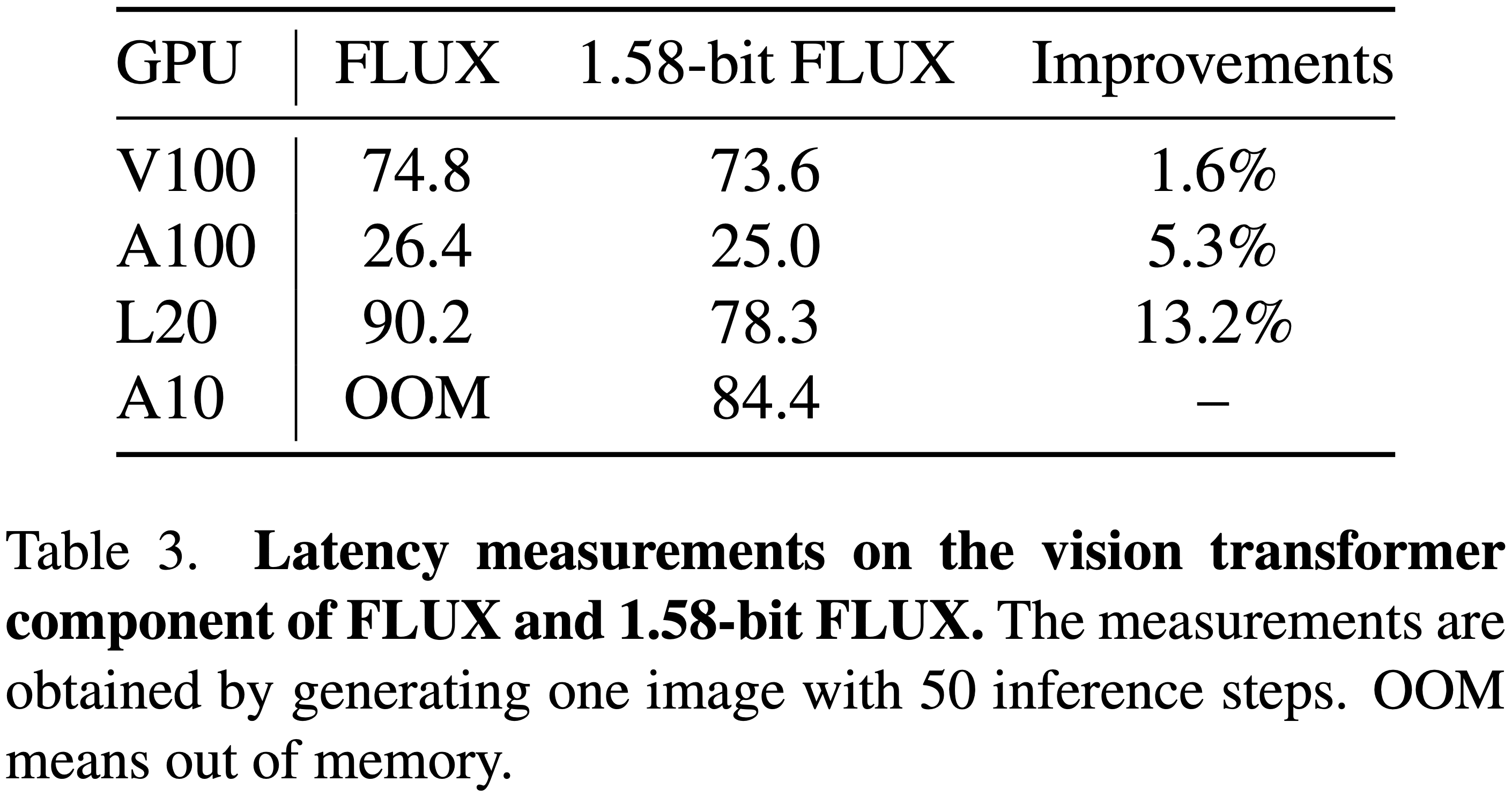

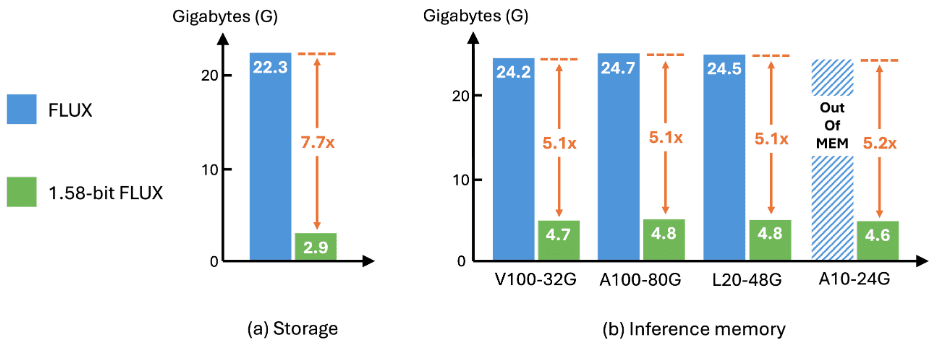

- 스토리지 효율성16비트에서 2비트로 압축되어 모델 스토리지 요구 사항이 7.7배 감소했습니다.

- 추론 효율성추론 중 메모리 사용량이 5.1배 감소하고 추론 지연 시간이 크게 개선되었습니다.

- 품질 생성GenEval 및 T2I Compbench 벤치마크에서 생성 품질은 기본적으로 고정밀 FLUX와 동등한 수준으로, 체계의 효과와 유용성을 입증했습니다.

결과

설정

정량화 가능총 7,232개의 큐로 구성된 Parti-1k 데이터 세트와 T2I CompBench 트레이닝 세트의 큐로 구성된 보정된 데이터 세트를 사용하여 정량화를 수행했습니다. 전체 프로세스는 이미지 데이터와 완전히 독립적이며 추가 데이터 세트가 필요하지 않습니다. 정량화는 FLUX에서 FluxTransformerBlock 및 FluxSingleTransformerBlock의 모든 선형 레이어 가중치를 1.58비트로 압축하며, 이는 전체 모델 파라미터의 99.5%를 차지합니다.

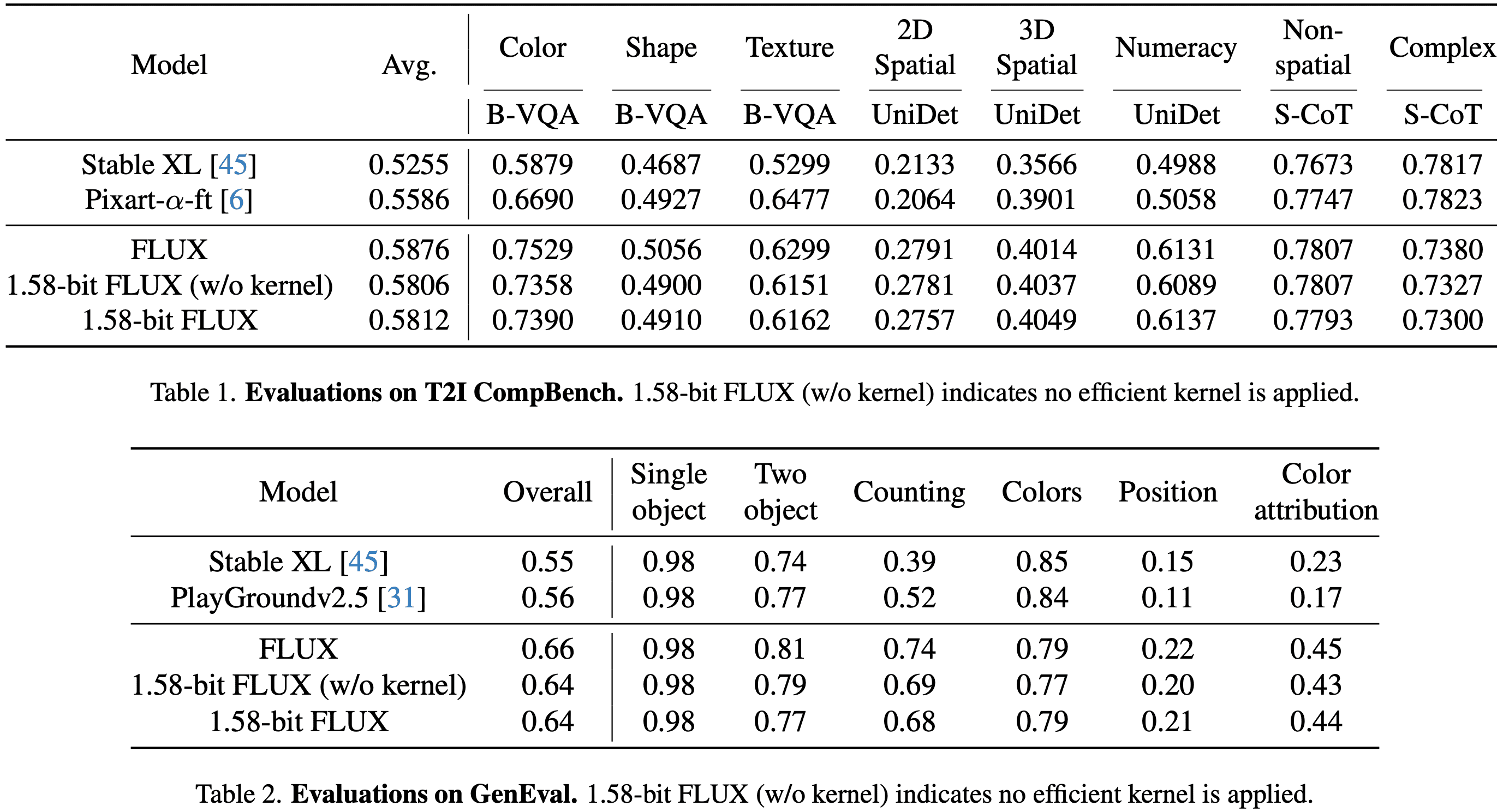

가치 평가공식 이미지 생성 프로세스에 따라 GenEval 데이터 세트와 T2I CompBench 검증 세트에서 FLUX 및 1.58비트 FLUX를 평가합니다.

- GenEval 데이터 세트: 각각 4개의 이미지를 생성하는 553개의 프롬프트가 포함되어 있습니다.

- T2I CompBench 검증 세트평가는 8개 카테고리로 진행되었으며, 각 카테고리당 300개의 프롬프트가 10개의 이미지를 생성하여 총 24,000개의 이미지가 평가 대상에 포함되었습니다.

- 모든 이미지는 1024 × 1024 해상도(FLUX 및 1.58비트 FLUX)로 생성됩니다.

결국

공연표 1과 2에서 볼 수 있듯이 1.58비트 FLUX의 성능은 T2I Compbench 및 GenEval 벤치마크에서 고정밀 FLUX와 비슷합니다. 사용자 정의 선형 커널 적용 전후의 성능 변화는 미미하여 구현의 정확성을 더욱 검증할 수 있습니다.

효율성아래 그림 2에서 볼 수 있듯이 1.58비트 FLUX는 모델 저장 및 추론 메모리에서 상당한 개선을 달성합니다. 추론 지연 시간 측면에서 아래 표 3에서 볼 수 있듯이, 특히 L20 및 A10과 같이 성능은 낮지만 배포하기 쉬운 GPU에서 개선 효과가 두드러집니다.

결론 및 토론

이 백서에서는 다음을 소개합니다. 1.58비트 FLUX99.5%의 경우, 트랜스포머 파라미터를 1.58비트로 양자화했으며, 계산 커널을 커스터마이징하여 다음과 같은 개선이 이루어졌습니다:

- 스토리지 요구 사항 감소모델 스토리지 요구 사항을 7.7배 줄입니다.

- 추론 메모리 감소추론 메모리 사용량을 5.1배 이상 줄입니다.

이러한 압축 효과를 달성했음에도 불구하고 1.58비트 FLUX는 T2I 벤치마크에서 높은 시각 품질을 유지하면서 고정밀 모델과 비슷한 성능을 보였습니다. 다음과 같은 이점을 기대할 수 있습니다. 1.58비트 FLUX 커뮤니티가 모바일 디바이스에 더 적합한 모델을 개발하도록 인센티브를 제공할 수 있습니다.

현재 제한 사항

속도 향상에 대한 제한 사항

- 1.58비트 FLUX는 모델 크기와 메모리 소비를 줄이지만, 활성화 값 정량화 및 고급 커널 최적화의 부재로 인해 지연 시간 개선이 제한적입니다.

- 지금까지 달성한 결과를 고려할 때 커뮤니티가 1.58비트 모델에 대한 커스텀 커널 구현을 개발하도록 동기를 부여할 것으로 기대합니다.

시각적 품질의 한계에 대해

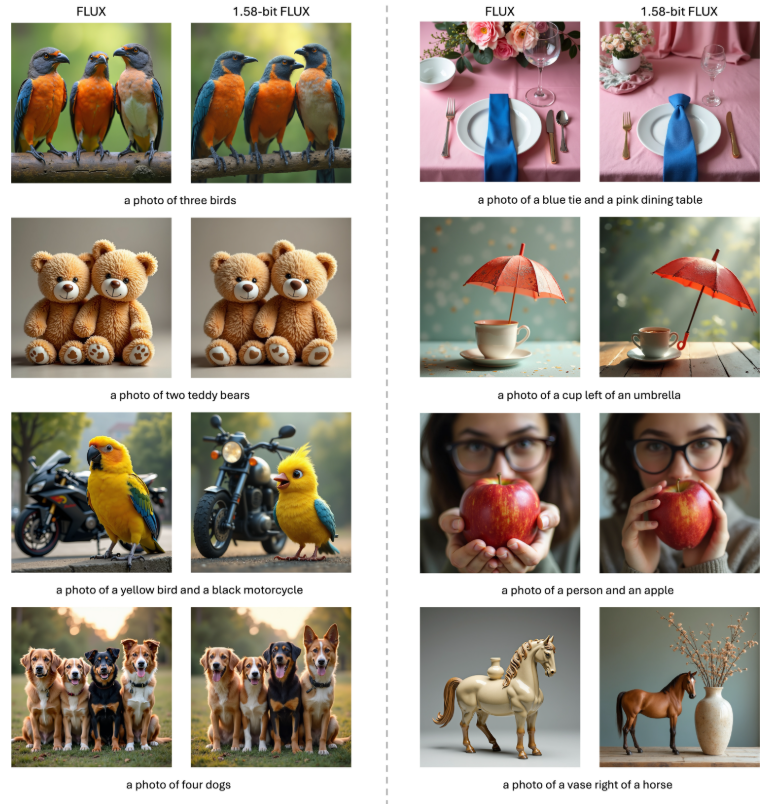

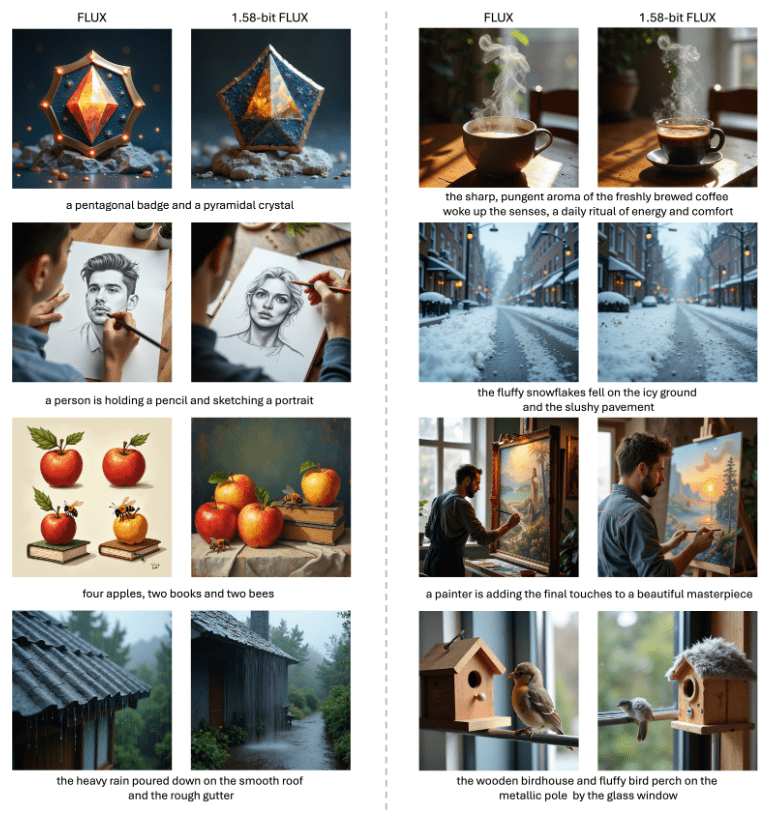

- 아래 그림 1, 3, 4에서 볼 수 있듯이 1.58비트 FLUX는 텍스트 단서와 매우 일치하는 생생하고 사실적인 이미지를 생성하지만 초고해상도 디테일을 렌더링할 때는 여전히 원본 FLUX 모델보다 뒤처집니다.

- 향후 연구를 통해 이 격차를 좁힐 계획입니다.

- 1.58비트 FLUX와 1.58비트 FLUX의 시각적 비교. 1.58비트 FLUX는 1.58비트 양자화를 사용한 FLUX와 비슷한 생성 품질을 보여주며, 시각적 Transformer의 11.9B 파라미터 중 99.5%가 +1, -1 또는 0으로 제한됩니다. 일관성을 위해 각 비교의 모든 이미지는 동일한 잠재 노이즈 입력을 사용하여 생성됩니다. 1.58비트 FLUX는 맞춤형 1.58비트 커널을 사용했습니다. 일관성을 위해 각 비교의 모든 이미지는 동일한 잠재적 노이즈 입력을 사용하여 생성되었습니다. 1.58비트 FLUX는 사용자 지정 1.58비트 커널을 사용합니다.

추론 코드 및 가중치가 공개됩니다: https://github.com/Chenglin-Yang/1.58bit.flux

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...