일반 소개

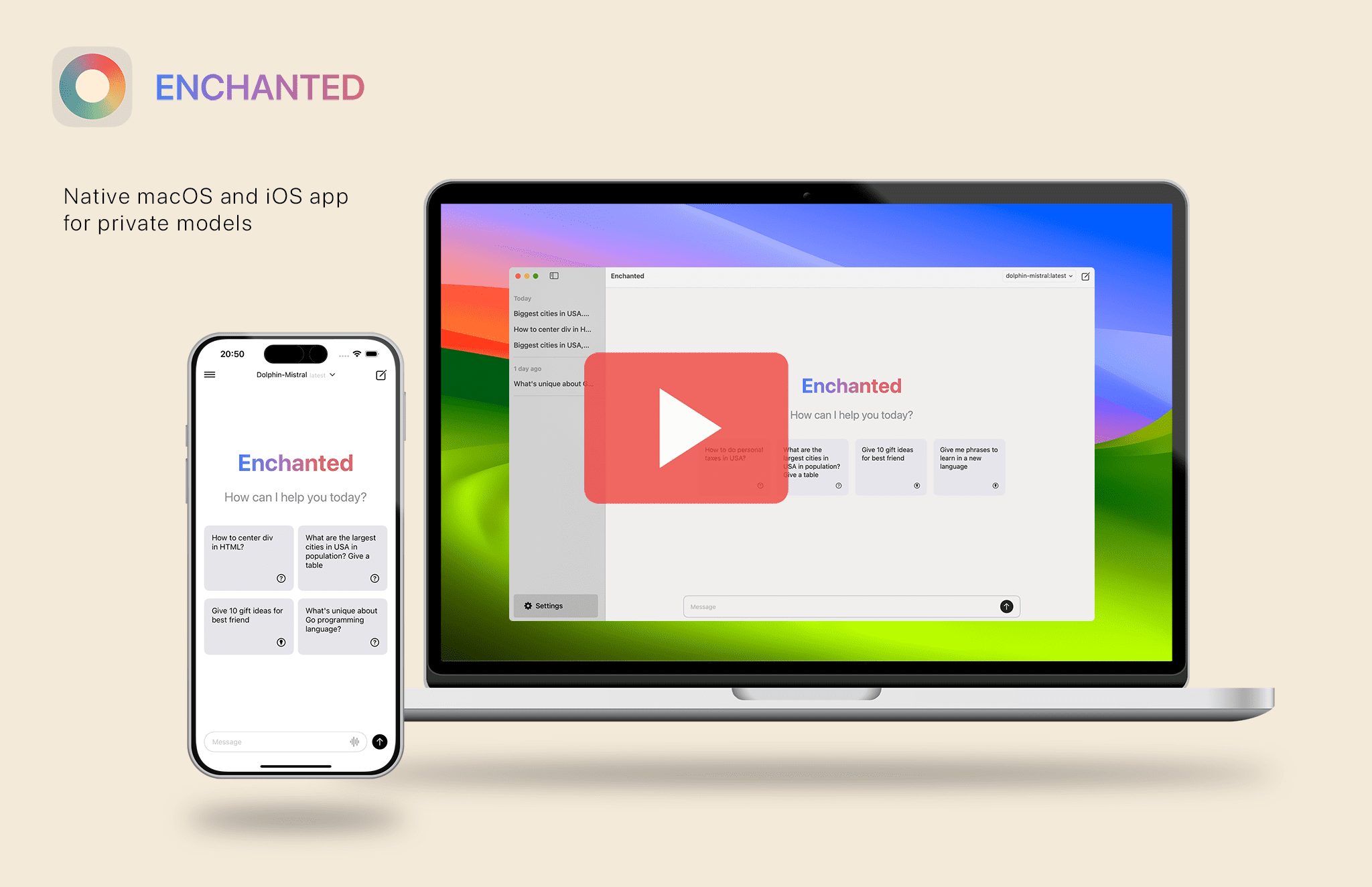

Xorbits Inference(Xinference)는 대규모 언어 모델(LLM), 음성 인식 모델, 멀티모달 모델 등 다양한 AI 모델에 대한 추론을 지원하는 강력하고 포괄적인 분산 추론 프레임워크입니다. 사용자는 클릭 한 번으로 자체 모델을 쉽게 배포하거나 클라우드, 로컬 서버 또는 PC에서 실행되는 내장된 최첨단 오픈 소스 모델을 사용할 수 있습니다.

기능 목록

- 대규모 언어 모델, 음성 인식 모델, 멀티모달 모델을 포함한 여러 AI 모델을 통한 추론 지원

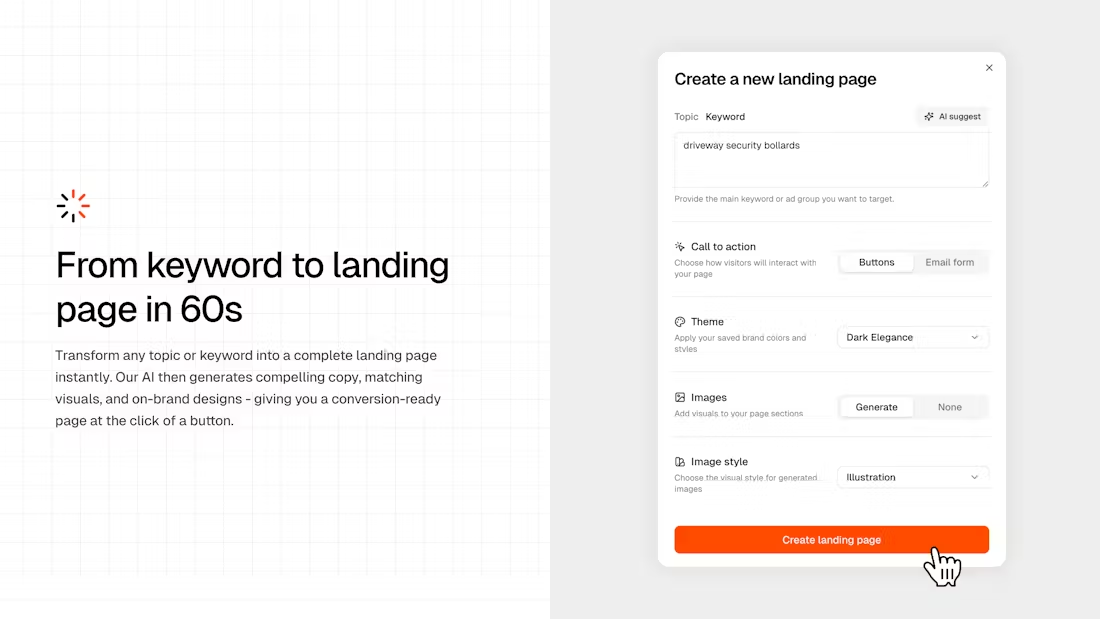

- 실험 및 프로덕션 환경의 설정을 간소화하는 원클릭 배포 및 서비스 모델

- 클라우드, 로컬 서버 및 PC에서 실행 지원

- 사용자 편의를 위한 다양한 최첨단 오픈 소스 모델 내장

- 풍부한 문서 및 커뮤니티 지원 제공

도움말 사용

설치 프로세스

- 환경 준비파이썬 3.7 이상이 설치되어 있는지 확인합니다.

- Xorbits 추론 설치::

pip install xorbits-inference - 구성 환경환경 변수 및 종속성: 필요에 따라 환경 변수와 종속성을 구성합니다.

사용 프로세스

- 모델 로드::

from xinference import InferenceEngine engine = InferenceEngine(model_name="gpt-3") - 추론 실행::

result = engine.infer("你好,世界!") print(result) - 배포 모델::

xinference deploy --model gpt-3 --host 0.0.0.0 --port 8080

세부 기능 작동

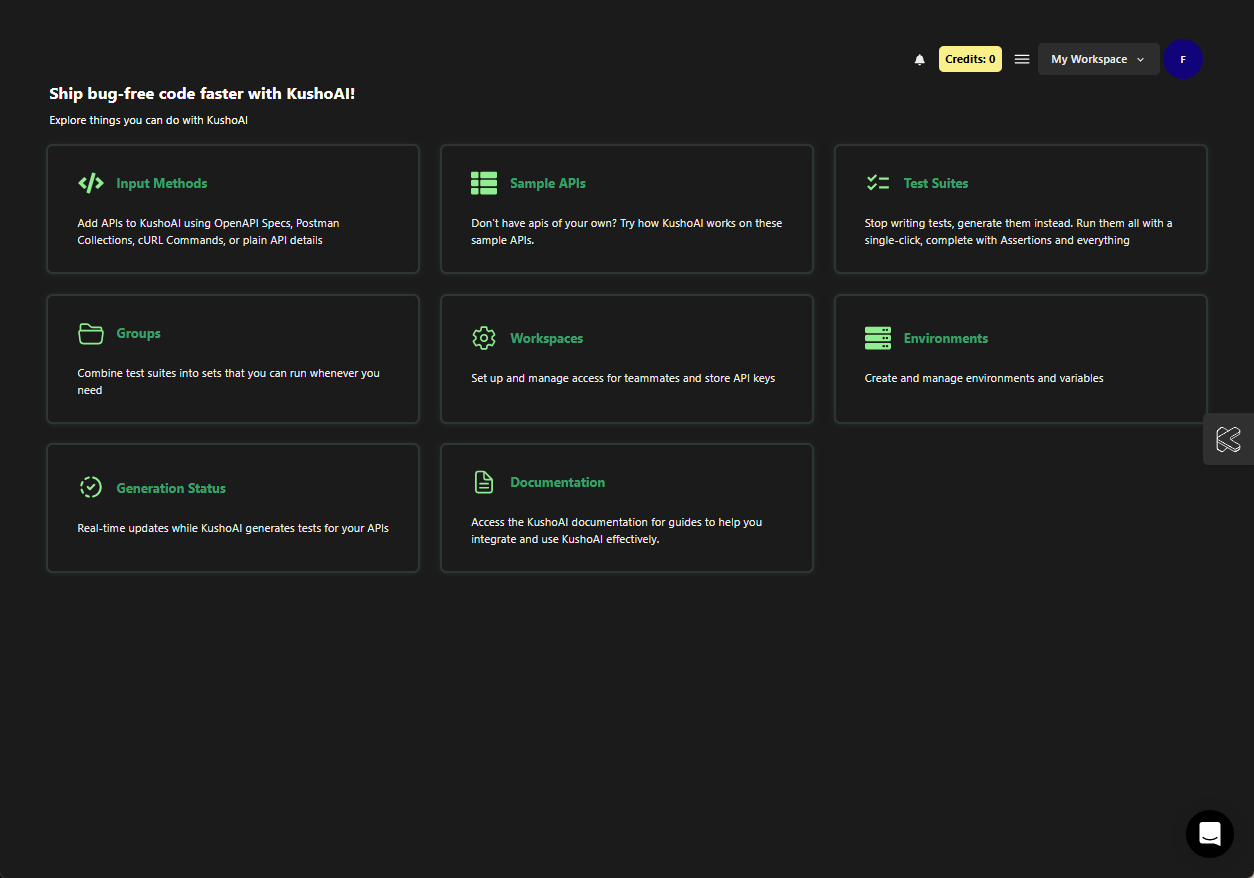

- 모델 선택사용자는 GPT-3, BERT 등과 같은 다양한 내장형 최첨단 오픈 소스 모델 중에서 선택하거나 추론을 위해 자체 모델을 업로드할 수 있습니다.

- 매개변수 구성모델을 배포할 때 필요에 따라 배치 크기, GPU 사용량 등 모델의 매개변수를 구성할 수 있습니다.

- 모니터링 및 관리제공되는 관리 인터페이스를 통해 사용자는 모델의 작동 상태와 성능 지표를 실시간으로 모니터링하여 최적화 및 조정을 용이하게 할 수 있습니다.

- 커뮤니티 지원다른 사용자들과 경험과 질문을 공유하고 적시에 도움과 지원을 받으려면 Xorbits Inference의 Slack 커뮤니티에 가입하세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...