스케일링 법칙이 속도를 늦추지 않았다면 2024년 AI에 어떤 놀라운 변화가 일어났을지 상상하기 어렵지만, 스케일링 법칙의 속도 저하로 인해 업계의 후발 주자들이 따라잡을 기회를 얻고 더 많은 일반인들이 이 기술 혁명에 동참할 수 있게 되어 다행이라고 생각하실 수도 있습니다.

AI의 변화가 꿈틀거리고 있습니다. 1년 전만 해도 AI 커뮤니티에서는 대부분의 모델이 오픈AI의 모델보다 반년 또는 1년 정도 뒤처져 있다고 생각했지만, 빅모델 사전 학습은 점차 비밀이 줄어들고 있으며 진입 장벽이 크게 낮아지고 있습니다. 딥서치와 큐엔으로 대표되는 오픈소스 빅 모델과 최고의 폐쇄형 빅 모델인 GPT 4o의 격차가 크게 좁혀져 국내외 기술 커뮤니티에 큰 충격을 안겨주었으며, 두 모델 모두 중국 AI 팀에서 개발한 것입니다. 한편, 빅 모델의 사전 학습 성능이 천장에 도달함에 따라 추론은 모델 능력의 지속적인 향상을 위한 '제2의 성장 곡선'으로 간주되며, AI 기술의 대중화가 더욱 가속화되어 사람들이 표준화된 API에 액세스하는 것만으로 생성형 AI 애플리케이션을 효율적으로 개발하거나 AI 기술의 혜택을 누릴 수 있게 되었습니다. 제품 익스플로러가 출시한 흥미로운 제품

2024년에도 OneFlow는 언제나처럼 80개의 양질의 기사를 발행하여 제너레이티브 AI 및 빅 모델 분야의 많은 변화를 기록하고 탐구했습니다. 연말에는 60개 이상의 기사를 선별하여 모든 독자가 빅 모델 구축 과정, 업계 현황 및 트렌드를 이해하는 데 도움이 되기를 바라며 900페이지 분량의 '연감'을 만들었습니다. 이 자료집은 총 8개의 섹션으로 구성되어 있습니다:개요, 빅 모델 기초, 빅 모델 훈련에는 비밀이 없다, 빅 모델 "두 번째 성장 곡선": 추론, AI 칩의 변화, 생성적 AI 제품 구축, 생성적 AI 산업 분석, AGI의 도전 과제와 미래.

이 심층적인 콘텐츠를 계속 작성할 수 있는 원동력인 AI 지식을 공개적으로 공유하고 여러분과 저에게 영감을 주신 모든 저자분들께 감사드립니다. 수많은 정보 속에서 읽을 만한 가치가 있는 내용을 찾아서 AI를 배우고 탐구하고자 하는 많은 사람들에게 널리 알리기를 바랍니다. AI를 진정으로 이해하고 싶다면 이 선물을 펼쳐서 읽어보는 것이 가장 빠른 지름길입니다. 2025년, AI의 새로운 놀라움을 기대하세요.

I. 개요

- AI 인벤토리 2024: 투자 급증, 인프라 재구성, 기술 채택 가속화 /4

- 900여 개의 오픈 소스 AI 도구 뒤에 숨어 있는 트렌드 /36

II. 대형 모델 기본 사항

- 중학교 수학으로 LLM의 작동 원리 이해하기 /49

- LLM의 자기 주의 메커니즘을 처음부터 이해하고 인코딩하기 /78

- LLM 샘플링 프로세스 공개 /112

- 혼합 전문가(MoE)의 대규모 모델을 시각화하고 이해하기 위한 50가지 다이어그램 /125

- 처음부터 비디오 생성을 위한 확산 모델 구축 /158

- 매일 바뀌는 10가지 빅 모델 히든 플레이 /174

셋째, 대규모 모델 훈련에는 비밀이 없습니다.

- LLaMA 3: 빅 모델 배틀의 새로운 프롤로그 /177

- LLM 트레이닝을 위한 GPU 메모리 요구 사항 추정 /190

- GPU에서 배치 전략 공개 /200

- GPU 활용의 성능 진실 /205

- LLM /211용 부동 소수점 할당

- 혼합 입력 행렬 곱셈의 성능 최적화 /219

- 10배 가속화된 LLM 계산 효율성: 소실 행렬 곱셈 /227

- 15조 토큰 /240을 생성하기 위해 오픈소스화된 최대 규모의 최상위 데이터 세트

- 70B 빅 모델 트레이닝 레시피 1: 데이터 세트 생성 및 평가 /244

- 베어 메탈에서 70B 대형 모델까지 ②: 인프라 설정 및 스크립팅 /270

- 70B 대규모 모델 훈련 레시피 III: 1000개의 하이퍼파라미터 최적화 실험에서 얻은 결과 /289

- ChatGPT 책임자 John Schulman: 대형 모델 업그레이드의 비결 /303

IV. 대규모 모델 "두 번째 성장 곡선": 추론

- 제너레이티브 AI의 새로운 전쟁터: 논리적 추론과 연역적 컴퓨팅 /318

- LLM 논리 추론 전략 선택: 추론 중 계산과 훈련 중 계산 /330

- LLM 추론의 처리량, 지연 시간 및 비용 공간 살펴보기 /345

- 제로 /363에서 익스트림 LLM 추론 달성하기

- LLM 추론 초보자 가이드 1: 텍스트 생성의 초기화 및 디코딩 단계 /402

- LLM 추론 초보자 가이드 ②: KV 캐시에 대한 심층 분석 /408

- LLM 추론 초보자 가이드(3): 프로파일링 모델 성능 /429

- LLM 추론 가속화 가이드 /442

- LLM 서버의 유효 처리량 극대화 /480

- 대규모 모델의 정량적 효과를 정확하고 해석 가능하게 평가하는 방법은 무엇인가요? /491

- LLM의 정량적 효과 평가: 50만 건의 실증 테스트 결과 /502

- Stable Diffusion XL 최적화를 위한 궁극의 가이드 /510

V. AI 칩의 변화

- 시간당 2달러에 H100 대여: GPU 거품이 꺼지기 전날 밤 /585

- 궁극의 GPU 인터커넥트 기술 탐구: 사라지는 메모리 벽 /600

- Cerebras: 세계에서 가장 빠른 AI 추론 칩의 '마법'에 도전하는 NVIDIA /614

- GPU보다 20배 빠른 d-Matrix 추론 가격/성능 분석 /624

- AI 반도체 기술, 시장 및 미래 /630

- AI 데이터 센터의 역사, 기술 및 주요 업체 /642

VI. 제너레이티브 AI 제품 구축

- 대형 모델 제품화의 첫 해: 전술, 운영 및 전략 /658

- OpenAI 단종, 자체 개발한 대형 모델을 무료로 사용할 수 있습니다! 개발자 토큰 무료 구현 /691

- LLM 긴 컨텍스트 RAG 성능 측정: gpt-o1 vs. 쌍둥이자리 /699

- 대규모 모델 비용 효율성 비교: DeepSeek 2.5 vs. Claude 3.5 소네트 대 GPT-4o /712

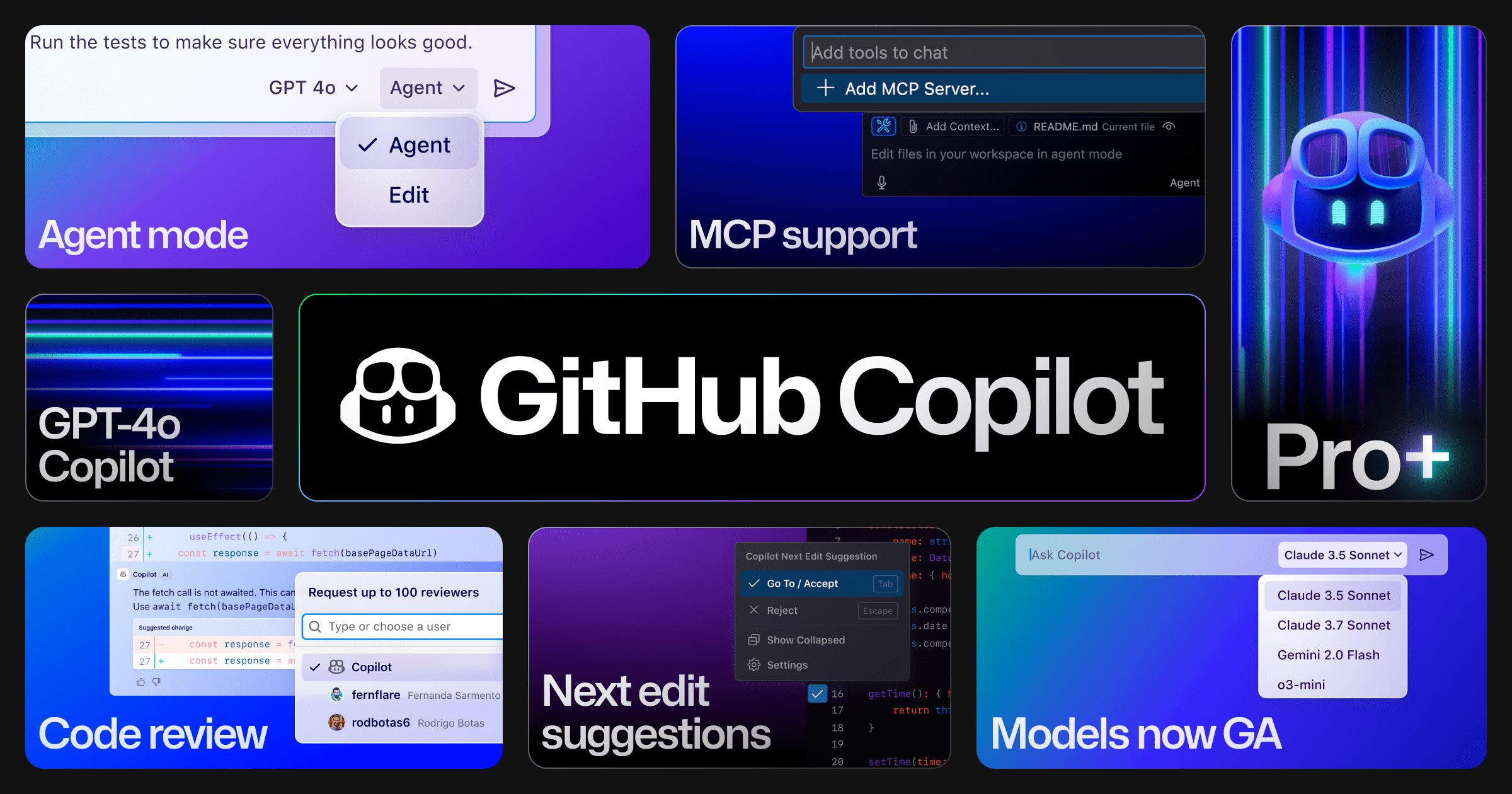

- 10배의 엔지니어를 위한 효율적인 코딩 도구: Cursor x SiliconCloud /718

- 비츠 미드저니-v6, GPU 없이 코타쿠 컬러 실행 /723

- 제품 구축에 대한 AI 검색 퍼플렉시티의 접근 방식 /728

- NotebookLM의 폭발적인 성장 비하인드 스토리: AI 네이티브 제품의 핵심 인사이트와 혁신 /739

- OpenAI의 조직 형태, 의사 결정 메커니즘 및 제품 구성 /750

- 제너레이티브 AI 플랫폼 살펴보기: 기본 구성 요소, 기능 및 구현 /761

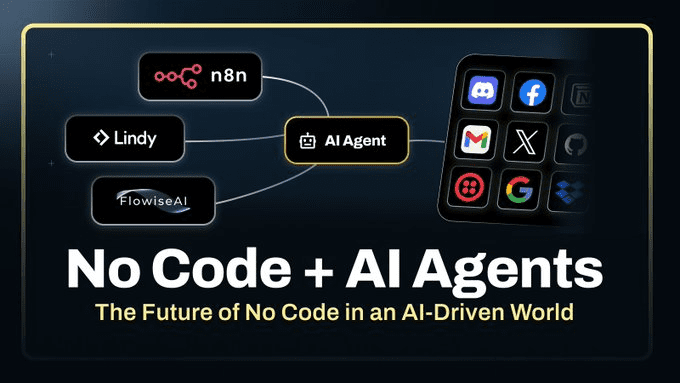

- 제너럴리스트에서 전문가로: AI 시스템의 진화에서 복합 AI로의 진화 /786

VII. 제너레이티브 AI 산업 분석

- 오픈 소스 AI의 비즈니스 코드 /792

- 인공지능 시장의 자본 미스터리와 흐름 /805

- 생성적 AI 산업 경제학: 가치 분배와 수익 구조 /819

- 엔터프라이즈 생성 AI에 대한 최신 설문조사: AI 지출 6배 급증, 멀티 모델 배포 보편화 /829

- 생성적 AI 추론 기술, 시장 및 미래 /842

- 생성적 AI 추론 비즈니스의 시장 기회, 경쟁 및 미래 /855

- AI는 또 다른 '인터넷 거품'이 아닙니다 /864

- 세쿼이아 캐피탈의 2025년 세 가지 AI 전망 /878

VIII. AGI의 도전과 미래

- AI 확장의 신화 /884

- 대형 모델의 스케일업은 지속 가능한가 /891

- GenAI의 "중요한 도약": 추론과 지식 /904

- LLM 논리적 추론의 족쇄와 이를 깨기 위한 전략 /924

- LLM 논리적 추론의 세 가지 오류 다시 살펴보기 /930

- 강화 학습의 아버지, 리처드 서튼: AGI 연구의 차세대 패러다임 /937

- 강화 학습의 아버지, 리처드 서튼: AGI /949의 또 다른 가능성

https://siliconflow.feishu.cn/file/OSZtbnfYQoa4nBxuQ7Kcwpjwnpf

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...