일반 소개

NSFW Detector는 주로 이미지, 동영상, PDF 파일 등에 불쾌감을 주는 콘텐츠가 포함되어 있는지 여부를 탐지하는 데 사용되는 AI 기반 불쾌감 콘텐츠 탐지 도구입니다. 이 도구는 팔콘사이/nsfw를 사용합니다.이미지탐지 모델을 사용하며, 구글의 vit-base-patch16-224-in21k 모델을 탐지에 사용합니다.NSFW Detector는 GPU 없이 CPU 동작을 지원하며 대부분의 서버에 적합합니다. 다른 애플리케이션과 쉽게 통합할 수 있도록 API를 통해 서비스를 제공하며, 분산 배포를 위해 Docker 배포를 지원합니다. 높은 정확도와 데이터 보안을 갖춘 이 도구는 로컬에서 실행하여 사용자 데이터를 보호할 수 있습니다.

기능 목록

- AI 탐지AI 모델을 기반으로 불편한 콘텐츠를 매우 정확하게 탐지합니다.

- 다중 파일 유형 지원이미지, 동영상, PDF 파일 및 압축된 패키지의 파일 검색을 지원합니다.

- CPU 작동GPU 지원 필요 없음, 대부분의 서버에 적합.

- API 서비스탐지 서비스는 다른 애플리케이션과 쉽게 통합할 수 있도록 API를 통해 제공됩니다.

- 도커 배포분산 배포를 위한 Docker 배포를 지원합니다.

- 로컬 운영사용자 데이터 보안을 보호하기 위해 탐지 프로세스는 로컬에서 수행됩니다.

도움말 사용

설치 및 배포

- 도커 배포::

- API 서버를 시작합니다:

bash

docker run -d -p 3333:3333 --name nsfw-detector vxlink/nsfw_detector:latest - 서버에 대한 로컬 경로를 가진 파일을 감지해야 하는 경우 해당 경로를 컨테이너에 마운트할 수 있습니다:

bash

docker run -d -p 3333:3333 -v /path/to/files:/path/to/files --name nsfw-detector vxlink/nsfw_detector:latest

- API 서버를 시작합니다:

콘텐츠 검사에 API 사용

- 이미지 파일 감지::

curl -X POST -F "file=@/path/to/image.jpg" http://localhost:3333/check

- 로컬 파일 경로 감지::

curl -X POST -F "path=/path/to/image.jpg" http://localhost:3333/check

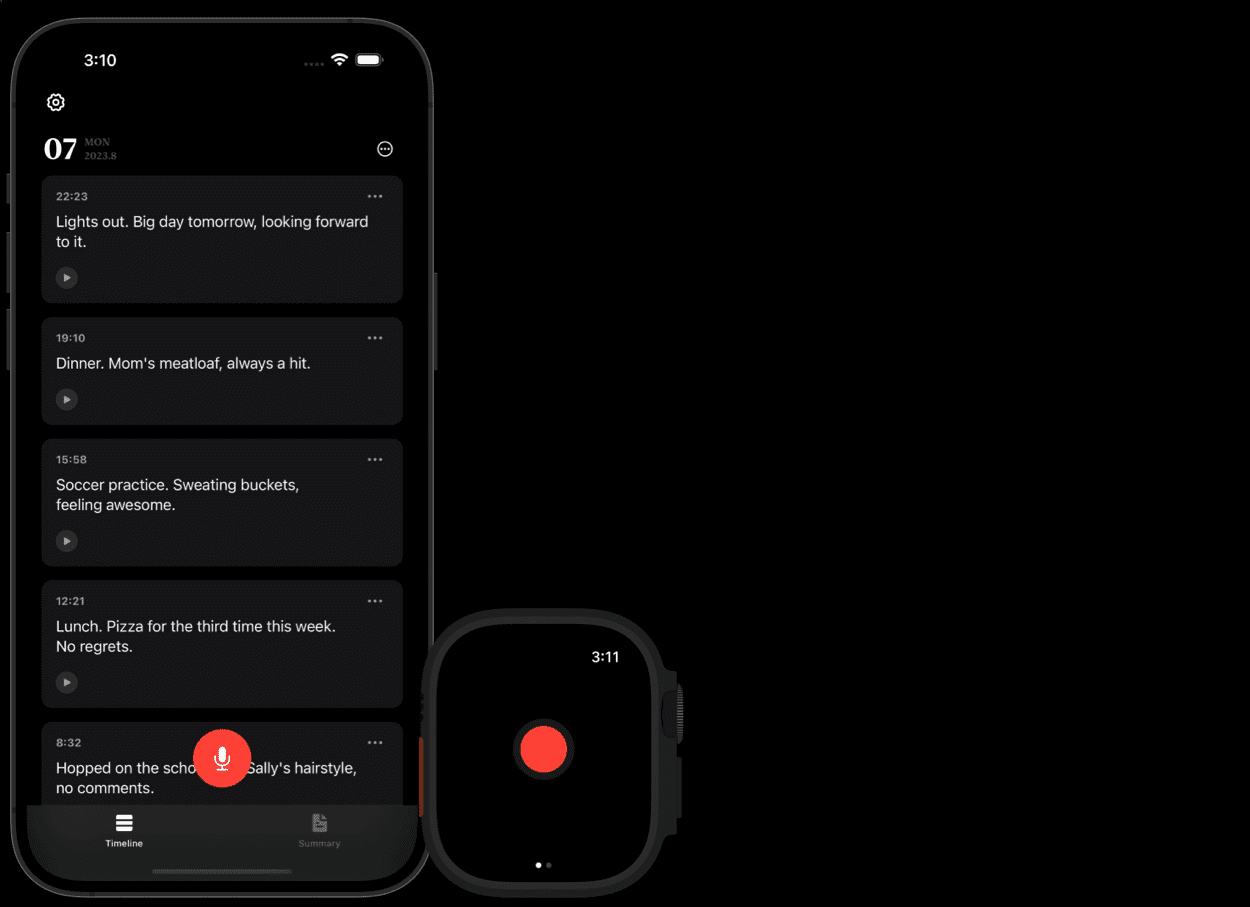

기본 제공 웹 인터페이스를 사용한 테스트

- 다음 주소를 방문하세요:

http://localhost:3333

구성 파일

- 구성 파일 편집::

- 존재

/tmp디렉토리에config파일을 열고 필요에 따라 감지기의 동작을 구성합니다. - 구성 예시:

bash

nsfw_threshold=0.5

ffmpeg_max_frames=100

ffmpeg_max_timeout=30

- 존재

성능 요구 사항

- 모델을 실행하려면 최대 2GB의 RAM이 필요합니다.

- 동시에 많은 수의 요청을 처리하는 경우 더 많은 메모리가 필요할 수 있습니다.

- 지원 아키텍처: x86_64, ARM64.

지원되는 파일 형식

- 이미지(지원)

- 비디오(지원)

- PDF 파일(지원)

- zip 패키지의 파일(지원)

공개 API

직접 배포하고 싶지 않다면 vx.link에서 제공하는 퍼블릭 API 서비스를 사용할 수 있습니다:

curl -X POST -F "file=@/path/to/image.jpg" https://vx.link/public/nsfw

퍼블릭 API에는 분당 30건의 요청 속도 제한이 있다는 점에 유의하세요.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...