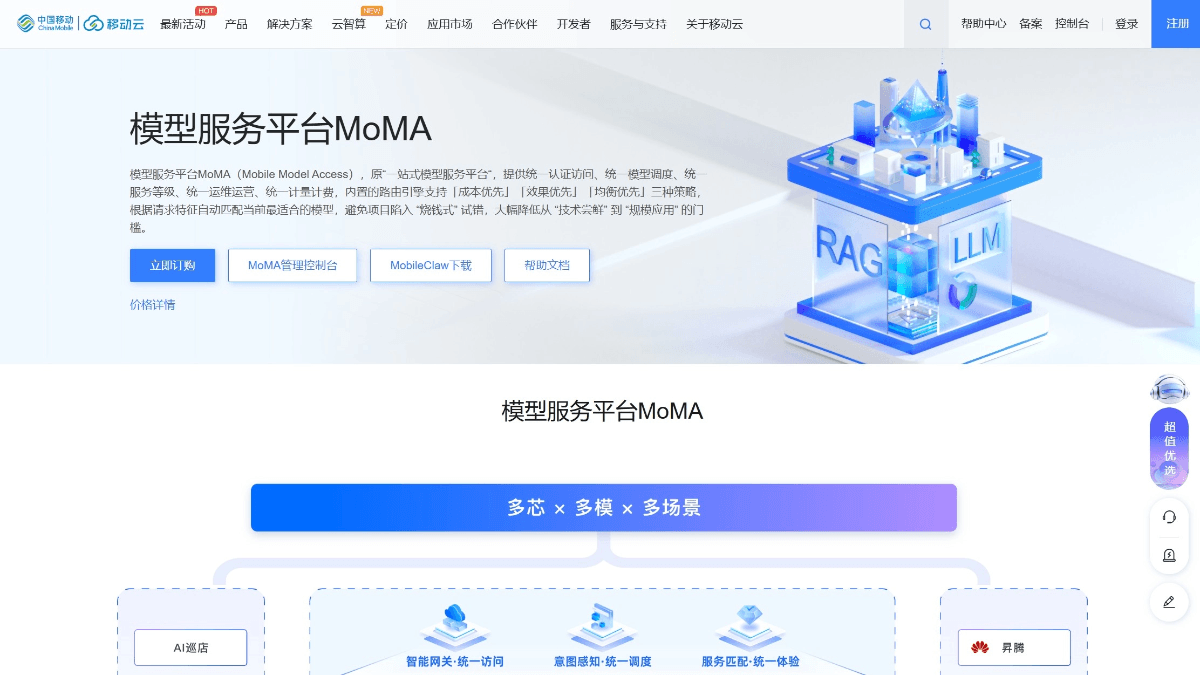

MoMA是什么

MoMA(Mobile Model Access) 是中国移动发布的一站式AI模型服务平台。平台接入超300款业界主流AI模型,包括自研"九天"基座大模型及DeepSeek、通义千问、豆包、Kimi、GLM等头部第三方模型,覆盖文本生成、语音处理、多模态理解等能力。MoMA首创Token集约化运营模式与智能路由引擎,支持"成本优先""效果优先""均衡优先"三种动态调度策略,实现单位Token成本压降约30%、资源占用率降低50%以上。

MoMA的功能特色

- 超300款模型聚合接入:汇聚中国移动自研"九天"大模型及DeepSeek、通义千问、豆包、Kimi、GLM、MiniMax等业界优质模型,模型丰富度行业领先。

- 统一API网关:用户仅需一次接入,即可调用平台全部模型资源,无需逐一对接各厂商接口。

- 首创智能路由引擎:自动分析用户请求的语义意图与业务目标,毫秒级动态匹配最优模型。

- 三档Token服务:提供普惠、精品、机密三档服务,满足不同安全等级与性能需求。

- 自研推理引擎:基于国产算力部署,通过深度调优算子、国产多芯适配、PD异构分离、KV缓存池化等技术优化推理效率。

- 机密模型服务:将模型部署在机密容器中,基于硬件隔离技术实现"可用不可见",覆盖芯片到应用全链路机密计算。

- 流式实时计费:Token计费端到端时延不超过1分钟,实现"即用即付",破解传统包月计费资源浪费问题。

- 全链路可观测:实时采集时延、吞吐量、Token消耗、GPU资源等关键指标,提供监控、预警、诊断一体化运营体系。

MoMA的核心优势

- 300+主流模型聚合接入:汇聚自研"九天"大模型及DeepSeek、通义千问、豆包、Kimi、GLM、MiniMax等业界优质模型,覆盖文本生成、语音处理、多模态理解等全栈能力,堪称中国版"OpenRouter".

- 首创智能路由引擎:自动分析用户请求的语义意图与业务目标,毫秒级动态匹配"成本优先""效果优先""均衡优先"三种策略,为用户在效果与成本间找最优平衡。

- 秒级故障无缝切换:当某个模型出现超时、限流或技术故障时,平台可在秒级自动切换至备用模型,确保业务连续不中断。

- Token成本显著优化:通过自研推理引擎、智能缓存、上下文复用、Token压缩等技术,实现单位Token成本压降约30%,资源占用率降低50%以上,吞吐量提升20%,时延降低40%。

- 国产算力自主可控:基于国产算力部署自研推理引擎,深度调优算子、国产多芯适配、PD异构分离、KV缓存池化,实现算子级性能优化。

- 机密模型安全保障:将模型部署在机密容器中,基于硬件隔离技术实现"可用不可见",覆盖芯片到应用全链路机密计算,满足政务、金融等高安全场景需求。

- 统一API一次接入:用户仅需一次接入即可调用平台全部模型资源,无需逐一对接各厂商接口,大幅降低开发门槛与集成成本。

- 流式实时透明计费:Token计费端到端时延不超过1分钟,实现"即用即付",有效破解传统包月计费的资源浪费问题。

- 全链路可观测运营:实时采集时延、吞吐量、Token消耗、GPU资源等关键指标,提供监控、预警、诊断一体化运营体系,AI投入产出一目了然。

- 中立开放生态:不绑定单一模型,以中立路由原则聚合多方优质模型资源,推动AI像水和电一样"随时可得、随处可用"。

MoMA官网是什么

- 공식 웹사이트 주소:https://ecloud.10086.cn/portal/product/MaaS

MoMA的操作步骤

- 注册接入:通过中国移动移动云平台注册账号,获取统一API网关接入权限。

- 选择服务档位:根据业务需求选择普惠/精品/机密三档Token服务。

- 一次接入调用:通过统一API网关接入,无需逐一对接各模型厂商。

- 配置调度策略:在智能路由引擎中设置"成本优先""效果优先"或"均衡优先"。

- 发起模型请求:平台自动分析需求并匹配最优模型,返回推理结果。

- 실시간 모니터링:通过全链路可观测面板查看Token消耗、时延、吞吐量等指标。

- 即用即付:按实际Token消耗实时计费,端到端账单时延不超过1分钟。

MoMA的适用人群

- 엔터프라이즈 개발자:需要快速接入多模型能力、降低AI应用开发门槛的技术团队。

- 중소기업:预算有限但希望获得高质量AI推理服务的商业用户。

- 政务机构:对数据安全要求极高,需要机密计算保障的场景。

- 金融行业:涉及敏感数据处理,需要全链路安全审计的金融机构。

- 工业制造企业:需要多模态理解、语音处理等能力赋能产线与质检。

- 医疗教育机构:需要文本生成、知识问答等能力辅助诊疗与教学。

MoMA的常见问题

Q:MoMA平台接入的300+模型是否需要单独付费?

A: 不需要单独对接各模型厂商。MoMA提供统一API网关,用户一次接入即可调用平台全部模型资源,平台根据实际Token消耗统一计费,实现"一次接入、全模型可用"。

Q:智能路由引擎的三种策略如何切换?

A: 平台首创智能路由引擎,可自动分析用户请求的语义意图与业务目标,灵活切换"成本优先""效果优先""均衡优先"三种策略,为用户动态匹配最适合的模型。当模型出现超时、限流或故障时,平台可自动实现秒级切换,确保业务连续不中断。

Q:Token成本降低30%是如何实现的?

A: MoMA基于国产算力部署自研推理引擎,通过深度调优算子、国产多芯适配、PD异构分离、KV缓存池化等技术,实现吞吐量提升20%、时延降低40%。同时结合智能路由对长尾模型资源调度,以及智能缓存、上下文复用、Token压缩等手段,实现单位Token成本压降约30%,资源占用率降低50%以上。

Q:机密模型服务如何保障数据安全?

A: MoMA推出"机密模型"服务,将模型部署在机密容器中,基于硬件隔离技术保障计算过程的数据安全,做到"可用不可见"。这一能力覆盖从芯片到应用的全链路机密计算,为政务、金融等数据安全要求较高的场景提供可靠支撑。

Q:计费模式是怎样的?是否支持实时查看?

A: 平台实施流式实时计费,用户使用Token计费端到端时延不超过1分钟,实现"即用即付",有效破解传统按包计费模式的资源浪费问题。同时平台提供全链路可观测能力,实时采集时延、吞吐量、Token消耗、GPU资源等关键指标,AI投入与产出一目了然。

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...