일반 소개

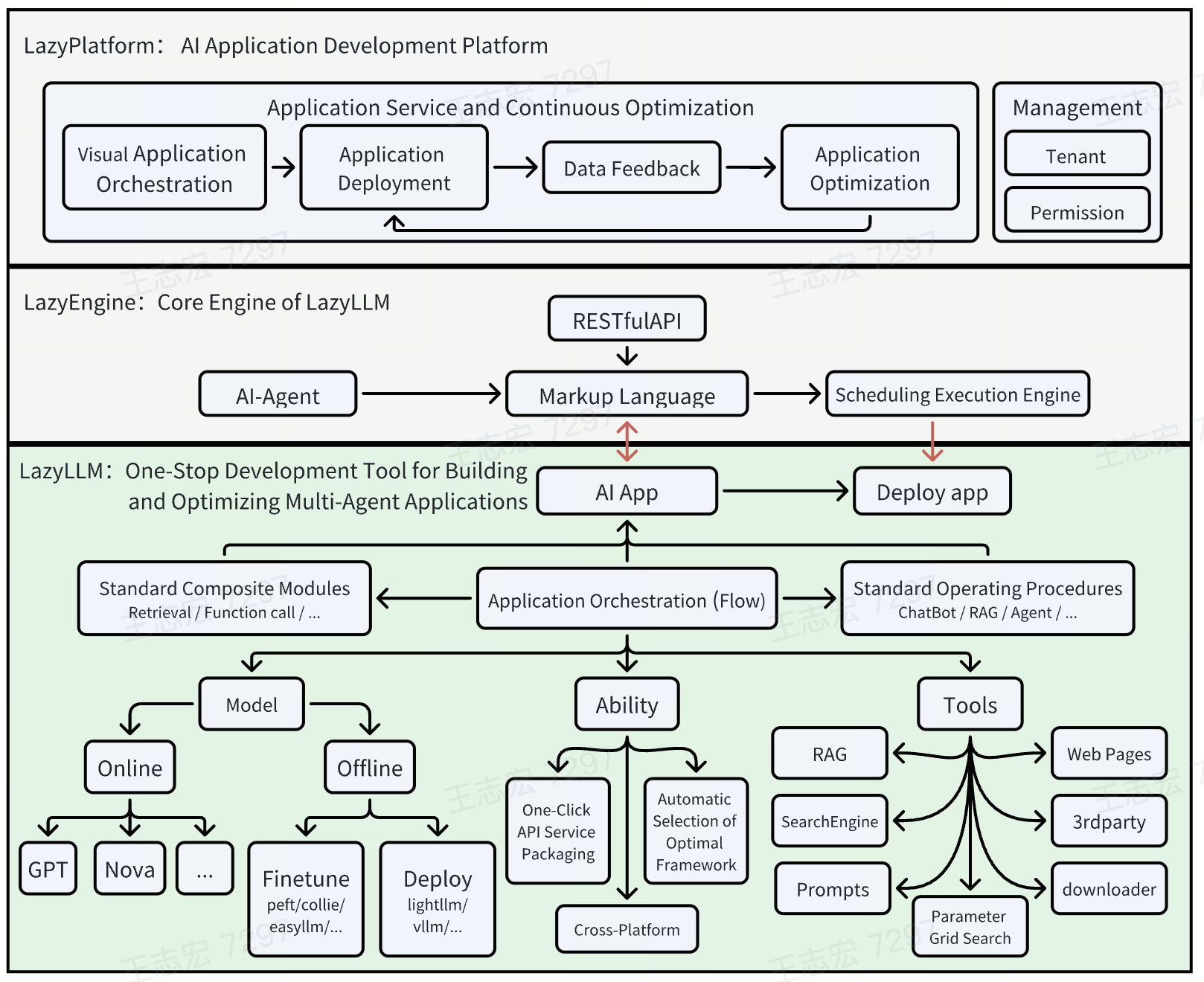

LazyLLM은 다중 지능 대규모 모델 애플리케이션의 개발 프로세스를 간소화하는 데 중점을 두고 LazyAGI 팀에서 개발한 오픈 소스 도구입니다. 개발자는 원클릭 배포와 가벼운 게이트웨이 메커니즘을 통해 복잡한 AI 애플리케이션을 빠르게 구축하고 지루한 엔지니어링 구성에 소요되는 시간을 절약할 수 있습니다. 초보자이든 숙련된 개발자이든 상관없이 LazyLLM은 초보자는 사전 구축된 모듈로 쉽게 시작할 수 있고, 전문가는 유연한 사용자 지정 기능으로 고급 개발을 달성할 수 있습니다. 이 도구는 효율성과 실용성을 강조하며 선호하는 구성 요소를 통합하여 가장 낮은 비용으로 프로덕션 준비된 애플리케이션을 구축할 수 있도록 합니다. GitHub에서 1100개 이상의 별과 활발한 커뮤니티를 보유하고 있으며, 업데이트가 계속 진행 중입니다.

기능 목록

- 클릭 한 번으로 복잡한 애플리케이션 배포서브모듈 서비스의 자동화된 구성을 통해 프로토타입 검증부터 프로덕션 릴리즈까지 전체 프로세스를 지원합니다.

- 플랫폼 간 호환성코드 변경 없이 베어메탈 서버, 개발 머신, Slurm 클러스터, 퍼블릭 클라우드에 적응할 수 있습니다.

- 데이터 흐름 관리(흐름)파이프라인 및 병렬과 같은 사전 정의된 프로세스를 제공하여 복잡한 애플리케이션 로직을 쉽게 구성할 수 있습니다.

- 모듈형 구성 요소사용자 지정 및 확장 기능, 사용자 알고리즘 또는 타사 도구 통합을 지원합니다.

- 경량 게이트웨이 메커니즘서비스 시작 및 URL 구성을 간소화하여 보다 효율적인 개발이 가능합니다.

- 다중 지능 개발 지원대규모 모델 작업에 적합한 여러 AI 에이전트가 포함된 애플리케이션을 빠르게 구축할 수 있습니다.

도움말 사용

설치 프로세스

LazyLLM은 파이썬 기반 오픈 소스 프로젝트이며 설치 과정은 간단하고 간단합니다. 자세한 단계는 다음과 같습니다:

환경 준비

- 시스템 요구 사항 확인기기에 Python 3.8 이상이 설치되어 있는지 확인하세요.

- Git 설치Git이 설치되어 있지 않은 경우 다음과 같은 명령줄 도구를 사용할 수 있습니다.

apt-get install git어쩌면brew install git) 설치. - 가상 환경 만들기(선택 사항이지만 권장)::

python -m venv lazyllm_env source lazyllm_env/bin/activate # Linux/Mac lazyllm_env\Scripts\activate # Windows

다운로드 및 설치

- GitHub 리포지토리 복제하기::

git clone https://github.com/LazyAGI/LazyLLM.git cd LazyLLM - 종속성 설치::

- 다음 명령을 실행하여 필요한 라이브러리를 설치합니다:

pip install -r requirements.txt - 종속성 충돌이 발생하면 pip를 업그레이드해 보세요:

pip install --upgrade pip

- 다음 명령을 실행하여 필요한 라이브러리를 설치합니다:

- 설치 확인::

- 샘플 코드를 실행하여 설치가 완료되었는지 확인합니다:

python -m lazyllm --version - 버전 번호가 반환되면(예: v0.5) 설치가 완료된 것입니다.

- 샘플 코드를 실행하여 설치가 완료되었는지 확인합니다:

선택 사항: Docker 배포

- LazyLLM은 Docker 원클릭 이미지 패키징을 지원합니다:

- Docker를 설치합니다(공식 웹사이트: https://docs.docker.com/get-docker/ 참조).

- 프로젝트 루트 디렉토리에서 실행합니다:

docker build -t lazyllm:latest . docker run -it lazyllm:latest

사용 방법

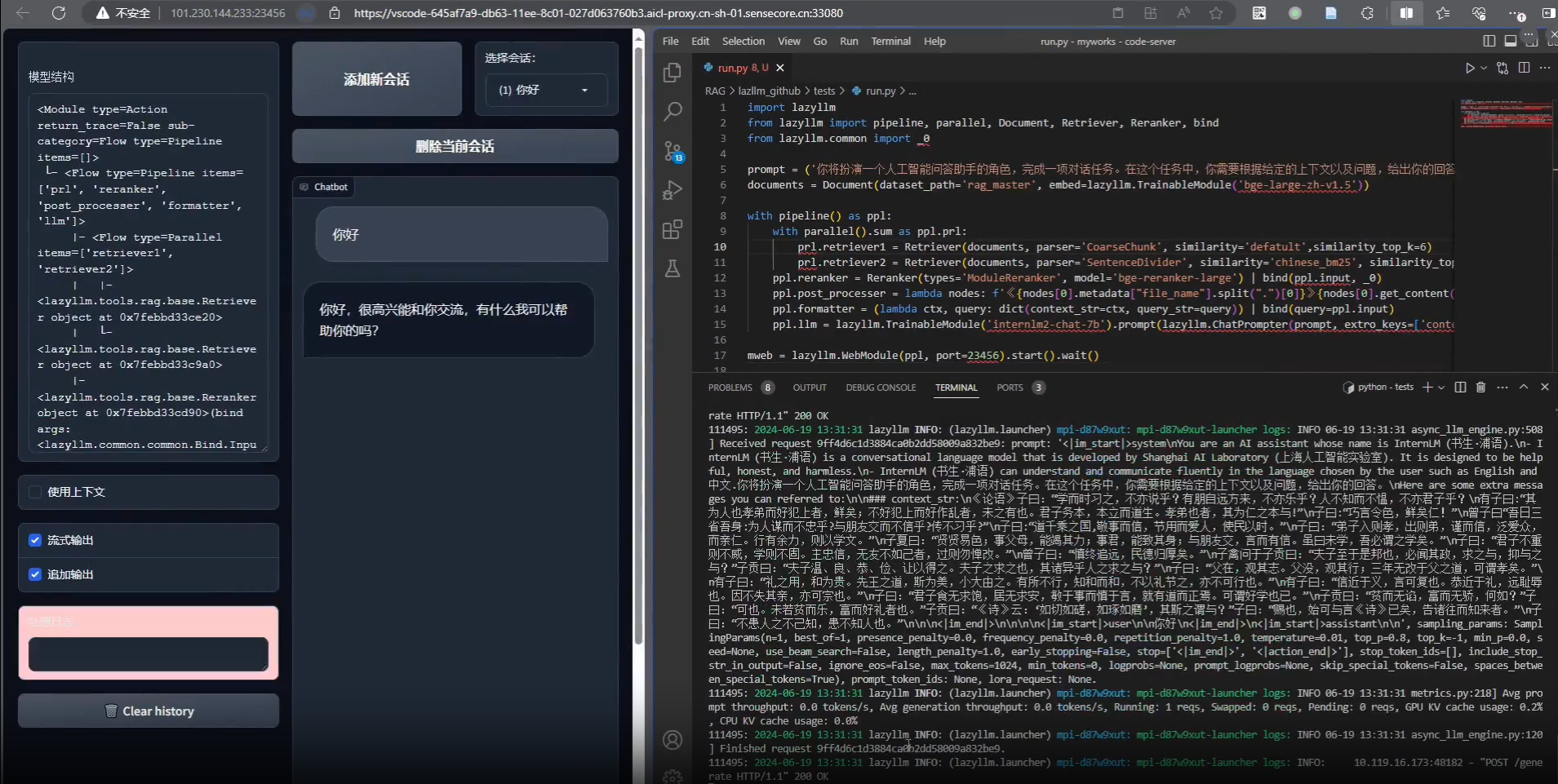

LazyLLM의 핵심은 모듈화와 데이터 흐름 관리를 통해 AI 애플리케이션을 빠르게 구축할 수 있는 기능입니다. 다음은 주요 기능에 대한 자세한 사용법 가이드입니다:

기능 1: 클릭 한 번으로 복잡한 애플리케이션 배포

- 절차::

- 애플리케이션 구성 파일 준비하기만들기

config.yaml를 사용하여 모듈과 서비스를 정의합니다. 예를 들어modules: - name: llm type: language_model url: http://localhost:8000 - name: embedding type: embedding_service url: http://localhost:8001 - 서비스 시작::

python -m lazyllm deploy - 상태 확인로그 출력에 액세스하여 모든 모듈이 올바르게 작동하는지 확인합니다.

- 애플리케이션 구성 파일 준비하기만들기

- 주요 설명이 기능은 경량 게이트웨이를 통해 하위 모듈을 자동으로 연결하므로 URL을 수동으로 구성할 필요가 없으며 신속한 프로토타입 제작에 이상적입니다.

기능 2: 플랫폼 간 호환성

- 절차::

- 지정 플랫폼예를 들어 명령줄에 매개변수를 추가합니다:

python -m lazyllm deploy --platform slurm - 환경 전환코드 변경 필요 없음, 교체만 하면 됩니다.

--platform매개변수(예cloud어쩌면bare_metal).

- 지정 플랫폼예를 들어 명령줄에 매개변수를 추가합니다:

- 애플리케이션 시나리오개발자는 로컬 테스트 후 클라우드로 원활하게 마이그레이션하여 적응에 드는 노력을 줄일 수 있습니다.

기능 3: 데이터 흐름 관리(흐름)

- 절차::

- 데이터 흐름 정의하기파이프라인 구축과 같이 파이썬 스크립트에서 미리 정의된 플로우를 호출합니다:

from lazyllm import pipeline flow = pipeline( step1=lambda x: x.upper(), step2=lambda x: f"Result: {x}" ) print(flow("hello")) # 输出 "Result: HELLO" - 복잡한 프로세스 실행병렬 또는 전환기와 함께 멀티태스킹:

from lazyllm import parallel par = parallel( task1=lambda x: x * 2, task2=lambda x: x + 3 ) print(par(5)) # 输出 [10, 8]

- 데이터 흐름 정의하기파이프라인 구축과 같이 파이썬 스크립트에서 미리 정의된 플로우를 호출합니다:

- 주요 설명Flow는 데이터 변환의 중복을 줄이고 모듈 간의 공동 개발을 지원하기 위해 표준화된 인터페이스를 제공합니다.

기능 4: 모듈식 컴포넌트 커스터마이징

- 절차::

- 사용자 지정 함수 등록::

from lazyllm import register @register def my_function(input_text): return f"Processed: {input_text}" - 애플리케이션에 통합흐름 또는 배포 구성에서 호출

my_function.

- 사용자 지정 함수 등록::

- 고급 사용법하이브리드 스크립트 개발을 위한 Bash 명령 등록을 지원합니다.

팁 및 유용한 정보

- 테스트 중 구성 요소 조정런타임 추가 사항

--verbose매개변수를 사용하여 자세한 로그를 볼 수 있습니다:python -m lazyllm deploy --verbose - 커뮤니티 지원GitHub 이슈에 대한 피드백을 제출하면 팀에서 적시에 답변해 드립니다.

- 업데이트: 정기적으로 최신 코드를 가져옵니다:

git pull origin main

이러한 단계를 통해 LazyLLM을 빠르게 시작하고 간단한 프로토타입부터 생산 수준의 대형 모델까지 다양한 애플리케이션을 구축할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...