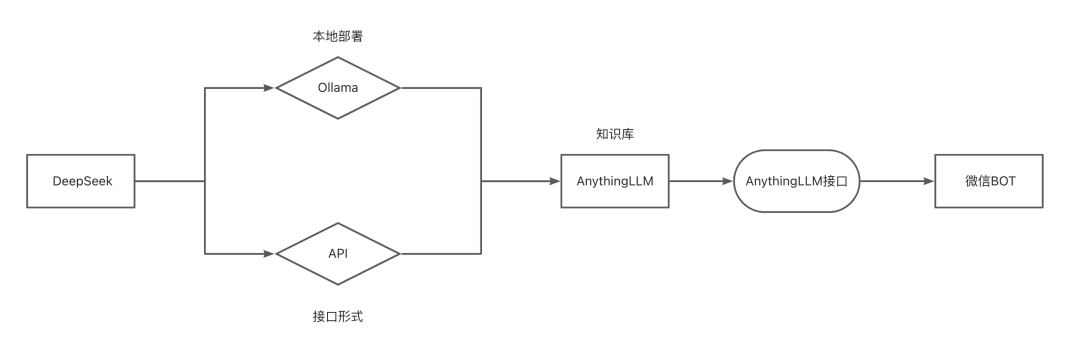

DeepSeek-R1을 기반으로 로컬/API 지식 베이스를 구현하고 WeChat BOT에 액세스하기

이전 글에서 "이전 글에서는로컬 배포 DeepSeek-R1 및 WeChat 봇 액세스 자습서"DeepSeek-R1"에서는 DeepSeek-R1을 로컬에 배포하고 WeChat 봇에 액세스하여 우리와 채팅했지만, 오늘은 좀 더 흥미로운 방법, 즉 AI 어시스턴트에게 건조한 정보를 제공하여 실제로 무엇을 하는지 아는 전문 컨설턴트로 변신하는 방법을 여러분과 공유하고자 합니다!

다음으로 환경 구성, 지식창고 배포, 정보 업로드, 튜닝 팁에 대한 세부 사항을 포함한 전체 지식창고 구축 프로세스를 직접 안내해 드리겠습니다. 마지막으로, 이 "지식으로 가득 찬" AI를 WeChat 로봇에 탑재하여 진정으로 여러분을 이해하고 업계의 지능형 비서를 만들 것입니다!

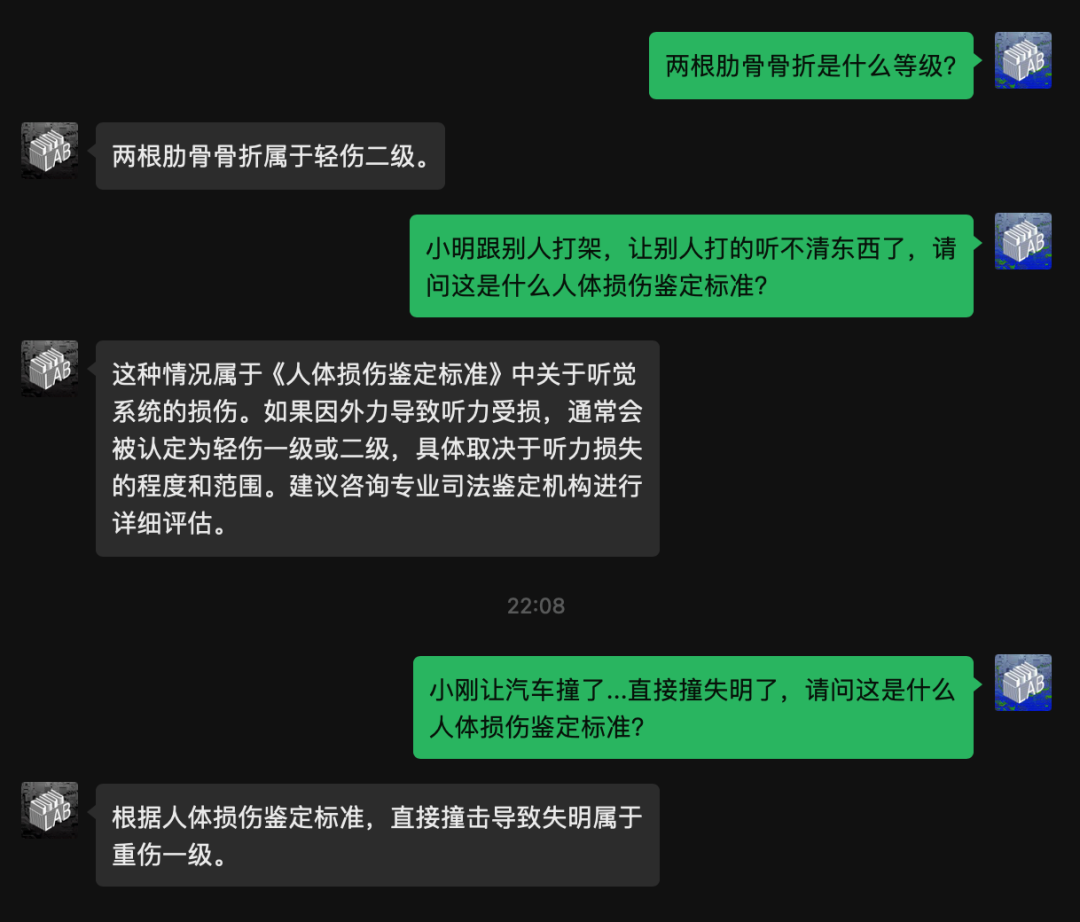

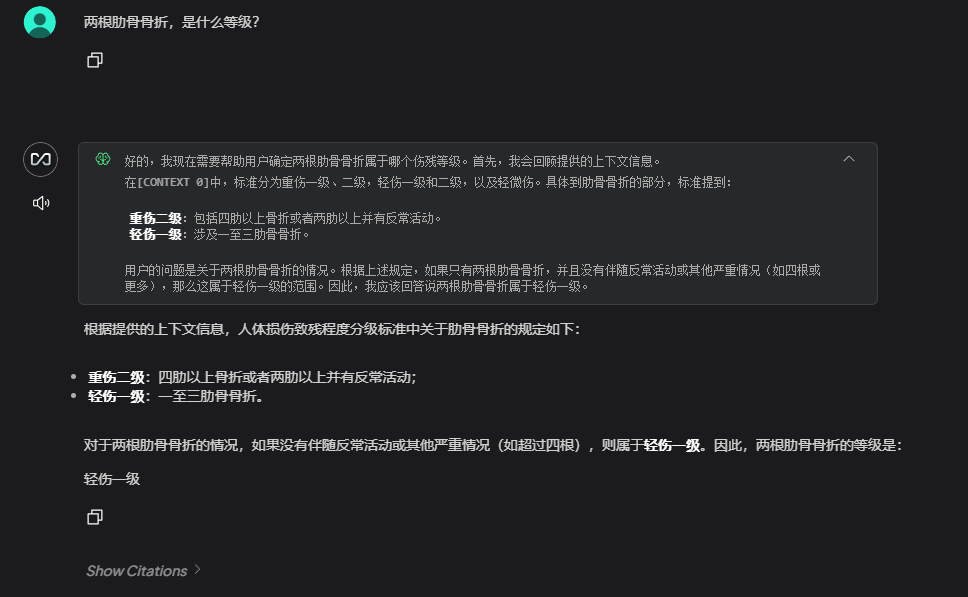

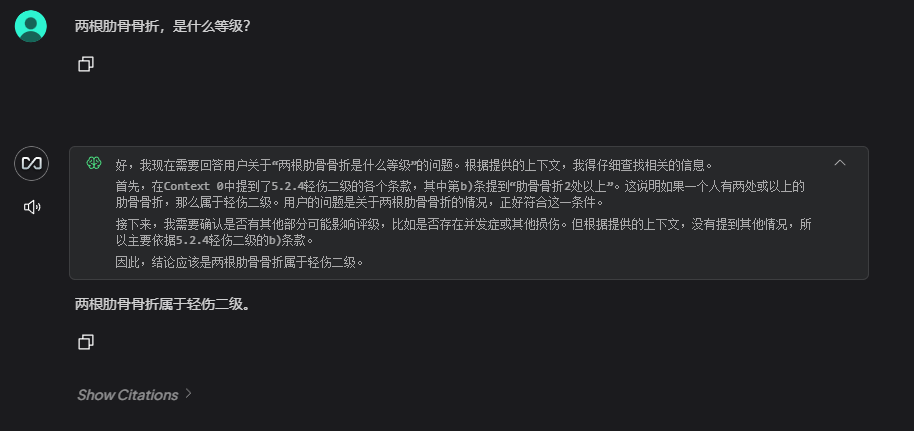

먼저 결과를 살펴보겠습니다. '인적 상해 장애 분류' 정보 조회를 업로드한 후의 결과입니다:

DeepSeek-R1 배포

DeepSeek 배포 방법에는 로컬 배포와 타사 API에 액세스하는 두 가지 방법이 있습니다.

두 가지 모두 장단점이 있습니다:

- 로컬 배포

장점: 완전한 프라이빗 데이터, 낮은 장기 비용, 빠른 응답 시간

단점: 로컬 산술 사용, 더 나은 구성의 머신이 필요함 - API 호출

✅ 장점: 빠른 액세스, 유지보수 필요 없음, 탄력적인 확장성

단점: 데이터를 제3자에게 전달해야 하며, 장기적인 비용을 통제할 수 없습니다.

로컬 딥서치

먼저 다음을 설치했는지 확인해야 합니다. ollama 그리고 올라마가 제대로 작동하고 있습니다.

DeepSeekAPI

사실 이 게시물은 로컬 배포 접근 방식에 대해서만 작성하려고 했습니다 ......

하지만 최근 DeepSeek의 웹 버전이 '파업 중'이어서 부득이하게 로컬 버전을 사용해 보았습니다. 채팅박스 R1의 완전한 버전을 경험하게 될 줄은 몰랐는데, 정말 굉장했습니다! 이 솔루션도 좋은 냄새가 나는 것 같아서 API 방식으로 작성해 보겠습니다.

여기에서는 원하는 플랫폼에 액세스할 수 있는 두 가지 플랫폼을 제공합니다.

먼저 API키를 얻은 다음 지식창고 구성을 API키로 채워야 합니다.

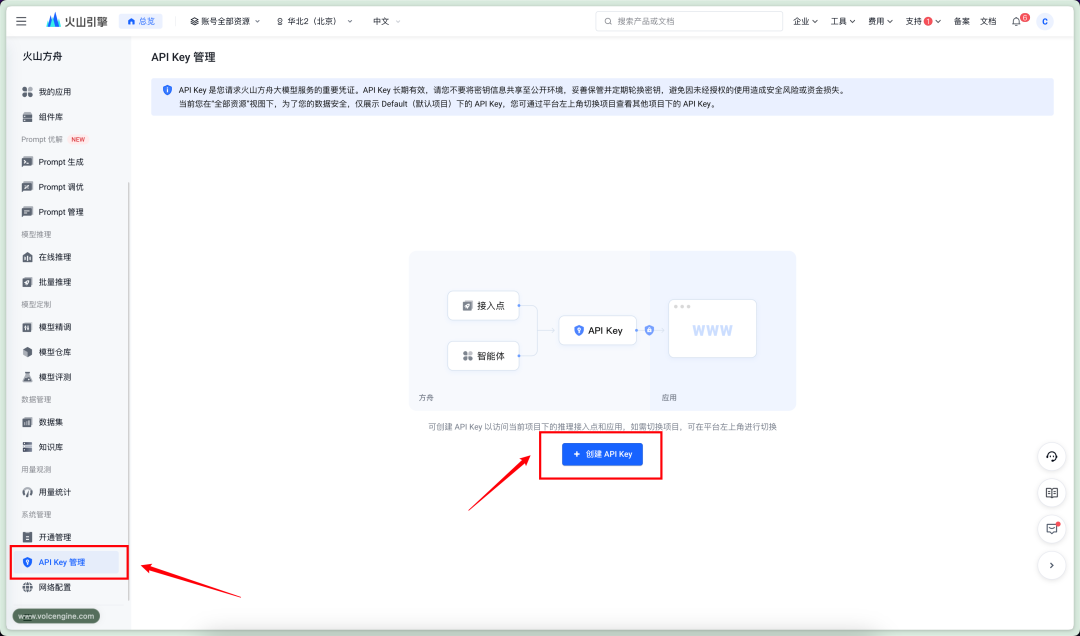

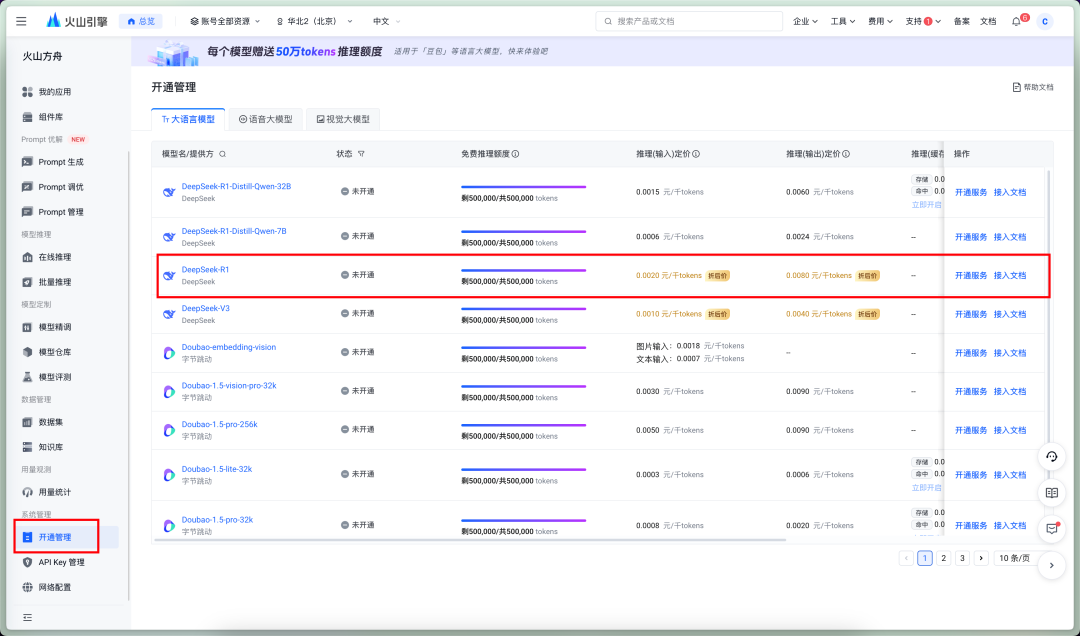

화산 방주

공식 웹사이트

https://console.volcengine.com/ark

가격

입력: ¥2/M 토큰

산출: ¥8/M 토큰

항목APIKey管理만들기APIkey

새 비밀 키, API키 복사

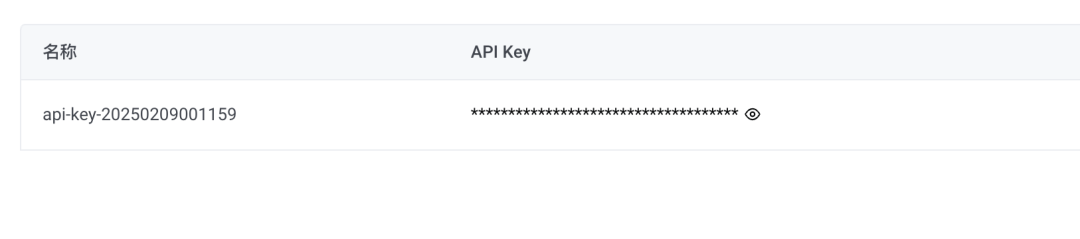

실리콘 기반 흐름

실리콘 기반 흐름 공식 웹사이트

https://cloud.siliconflow.cn/account/ak

가격

입력: ¥4/M 토큰

산출: ¥16/M 토큰

왼쪽으로 이동하여API秘钥클릭新建秘钥복사 후 비밀 키

저장소

지식창고 설치

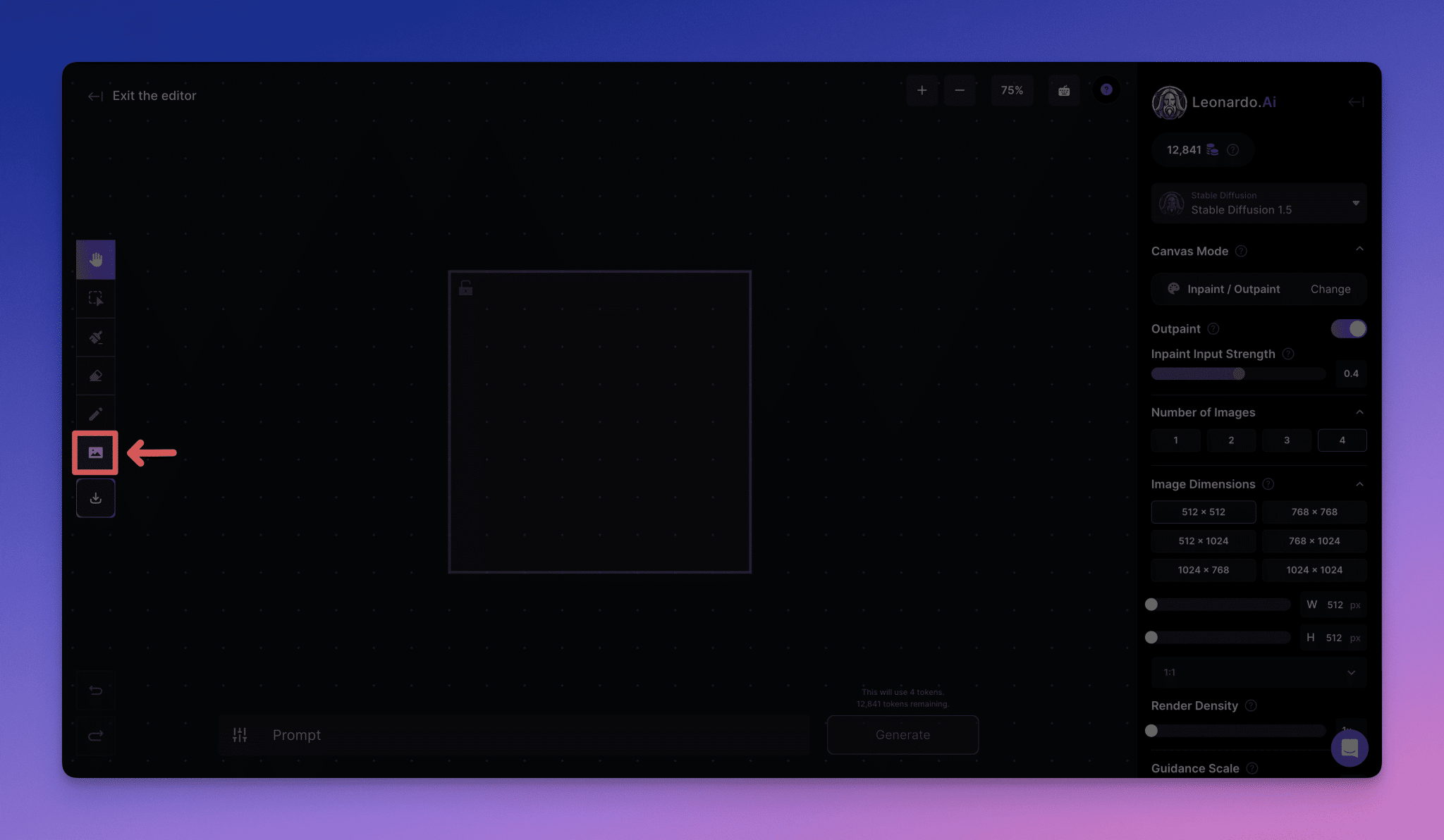

다음으로 지식창고에 액세스해야 하는데, 여기서는 다음을 사용합니다.AnythingLLM프로젝트.

AnythingLLM은 사용자가 개인 데이터를 기반으로 지능형 Q&A, 문서 분석 및 기타 애플리케이션을 쉽게 구축 및 배포할 수 있도록 설계된 오픈 소스 LLM(대규모 언어 모델) 애플리케이션 프레임워크입니다.

AnythingLLM 웹사이트로 이동하여 설치 프로그램을 다운로드합니다.

https://anythingllm.com/

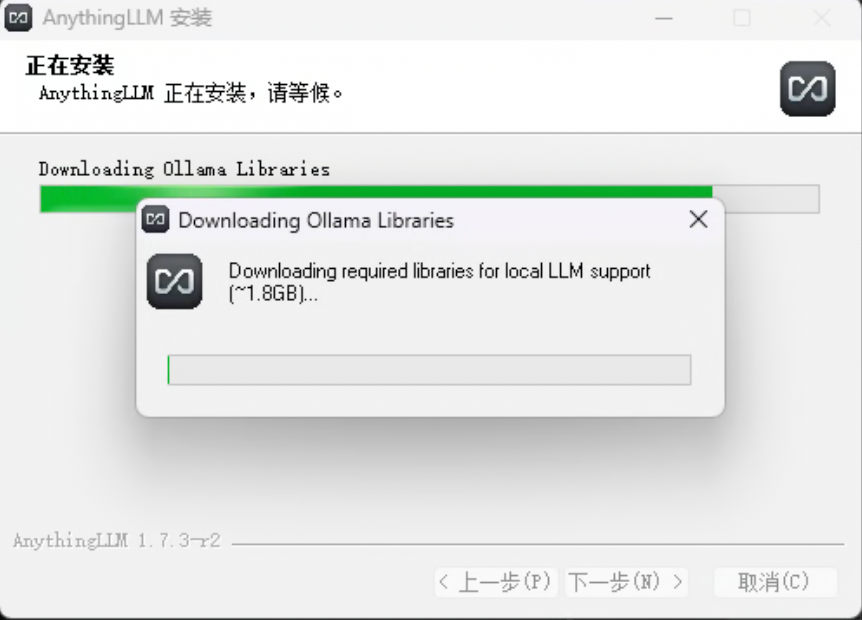

설치 프로그램을 실행하면 그 사이에 필요한 추가 종속성(GPU, NPG 지원)이 다운로드됩니다.

다운로드에 실패하거나 이 다운로드 창을 닫고 이 단계를 건너뛰어도 AnythingLLM은 성공적으로 설치됩니다.

지금은 걱정하지 마세요. 수동으로 설치할 수 있습니다.

웹 링크에는libZip.

압축을 풀고 압축을 푼 폴더를 다음 폴더에 넣습니다.你的安装目录AnythingLLMresourcesollama카탈로그 내부.

지식창고 구성

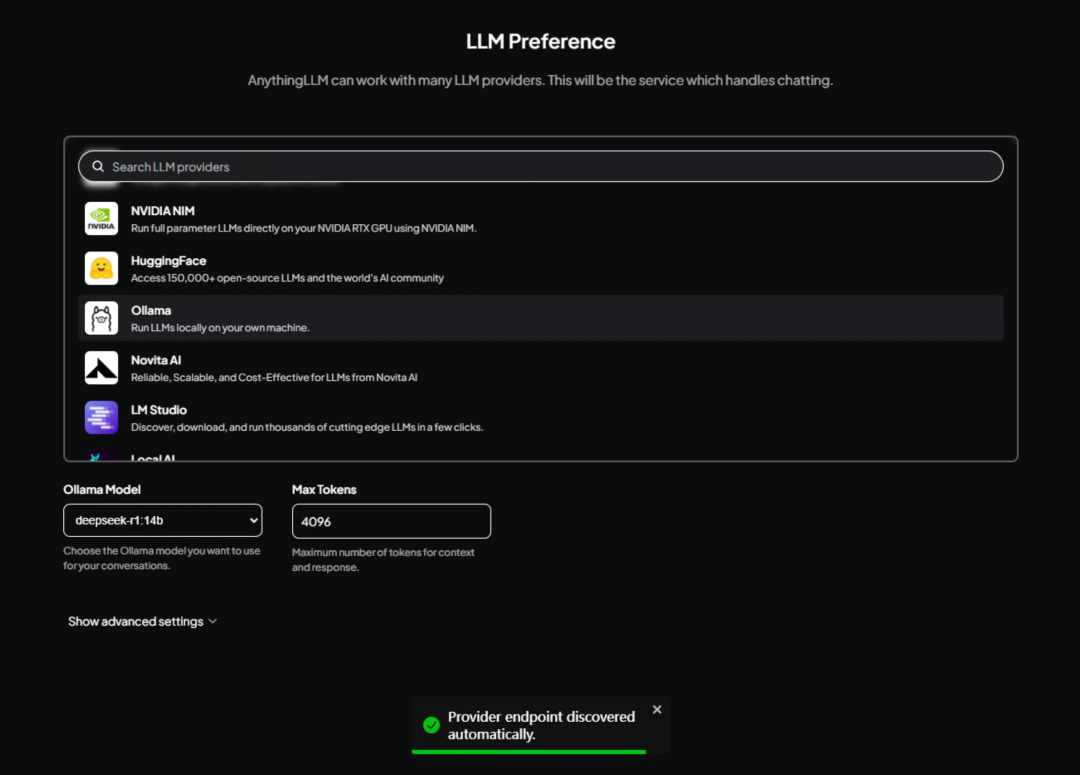

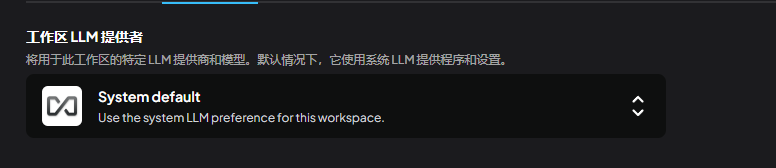

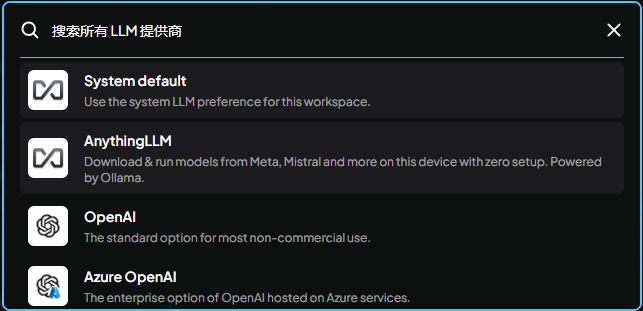

설치가 완료되면 AnythingLLM 인터페이스로 들어가서 기본 대형 모델을 선택해야 합니다.

로컬 구성

DeepSeek의 로컬 배포를 사용하는 경우 아래로 스크롤하여Ollama선택하기만 하면 됩니다.

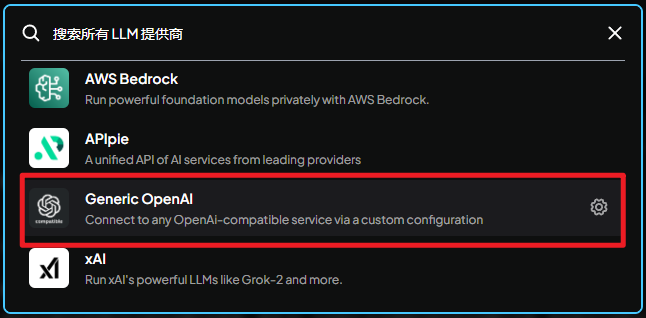

API 구성

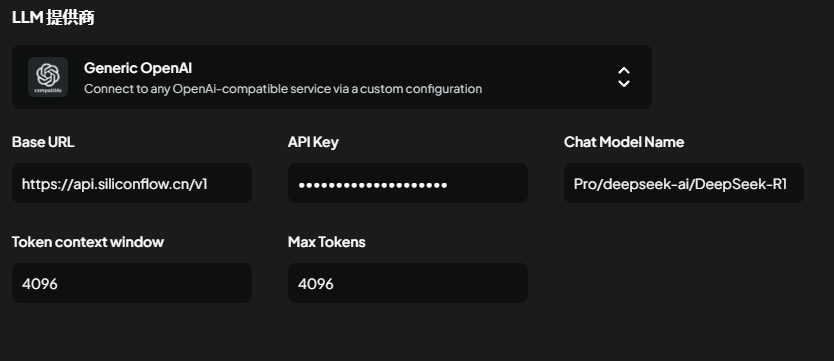

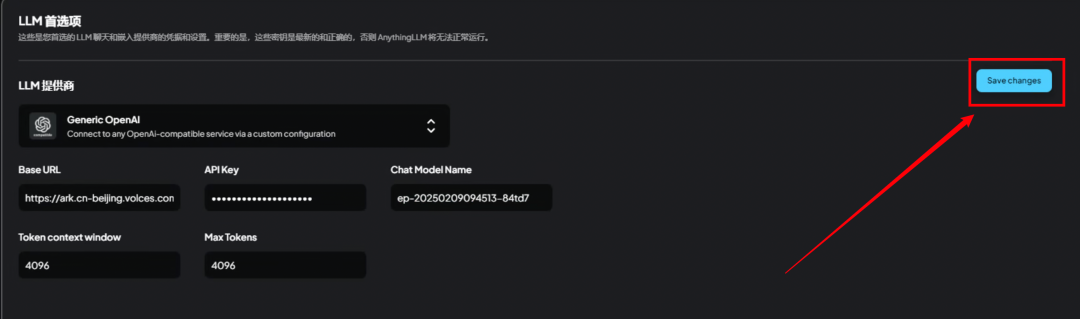

타사 API를 사용하는 경우 이 단계를 선택할 필요가 없습니다.ollama여기에서 찾아보세요.Generic OpenAI

일반 OpenAI:

사용자 지정 구성을 통해 OpenAI 인터페이스 형식과 호환되는 모든 서비스에 연결하세요.

여기에 입력해야 하는 매개 변수는 5가지입니다.

실리콘 기반 플로우 API를 사용합니다:

BaseURL요청 주소

https://api.siliconflow.cn/v1

APIkeyAPI 비밀 키에 방금 받은 키를 입력합니다.

ChatModelName모델 이름

Pro/deepseek-ai/DeepSeek-R1

Token context window(컨텍스트 창)

4096

Max Tokens(최대 토큰 수)

상황에 따라 4096 또는 8192로 전화하세요.

볼케이노 아크 API를 사용합니다:

BaseURL요청 주소

https://ark.cn-beijing.volces.com/api/v3

APIkeyAPI 비밀 키에 방금 받은 키를 입력합니다.

ChatModelName모델 이름

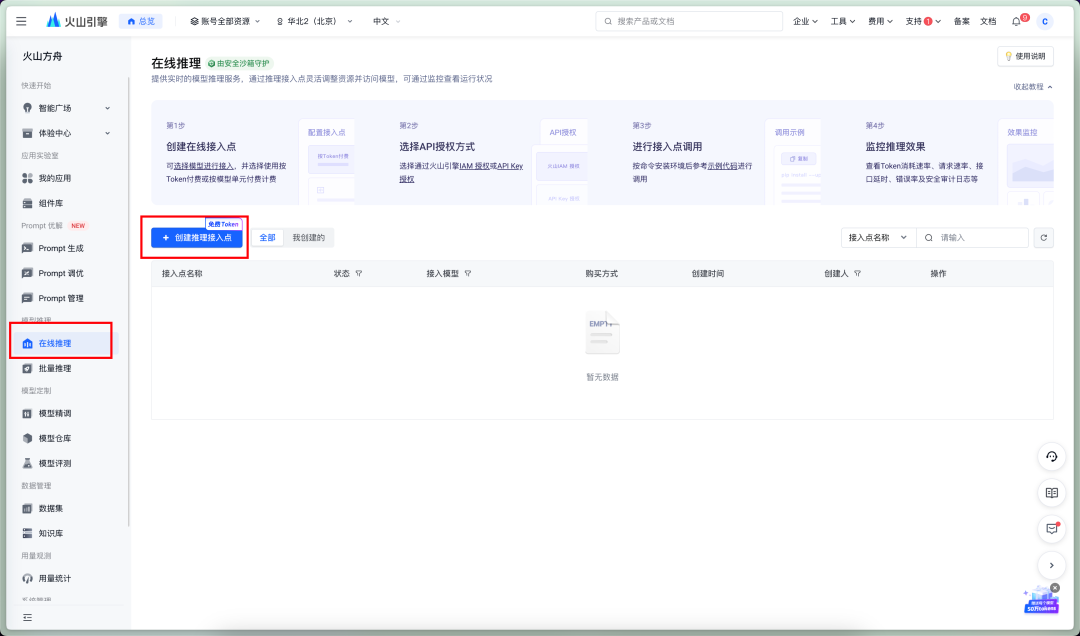

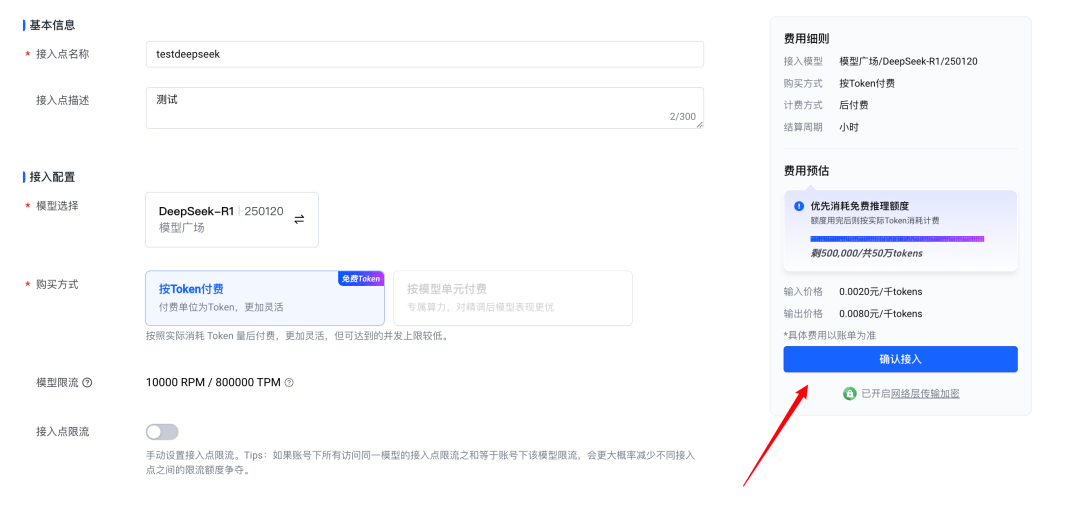

여기서는 특별한 점이 있는데, 볼케이노 아크 모델 이름에 액세스 포인트 ID를 입력해야 합니다. 액세스 포인트를 생성하려면 플랫폼으로 이동해야 합니다.

먼저 DeepSeekR1을 켜서 시작하세요!

온라인 추론으로 오세요 - 액세스 포인트 만들기

액세스 확인

이 ID는 액세스 포인트 ID이므로 이 값을 입력하기만 하면 됩니다.

Token context window(컨텍스트 창)

4096

Max Tokens(최대 토큰 수)

상황에 따라 4096 또는 8192로 전화하세요.

위의 설정이 완료되면 잊지 말고SaveChanage저장.

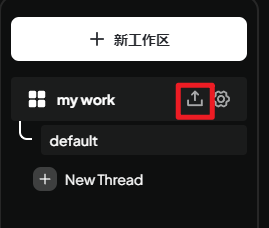

작업 공간 만들기

이 개인 정보 보호 인터페이스의 다음 단계는 데이터를 저장하는 방법, 해당 지침을 사용하는 방법, 어쨌든 모든 단어 집합이며 다음 단계를 직접 건너 뛸 수 있습니다.

이 단계는 시작 화면으로, 특별한 것은 없으니 그냥 건너뛰세요!

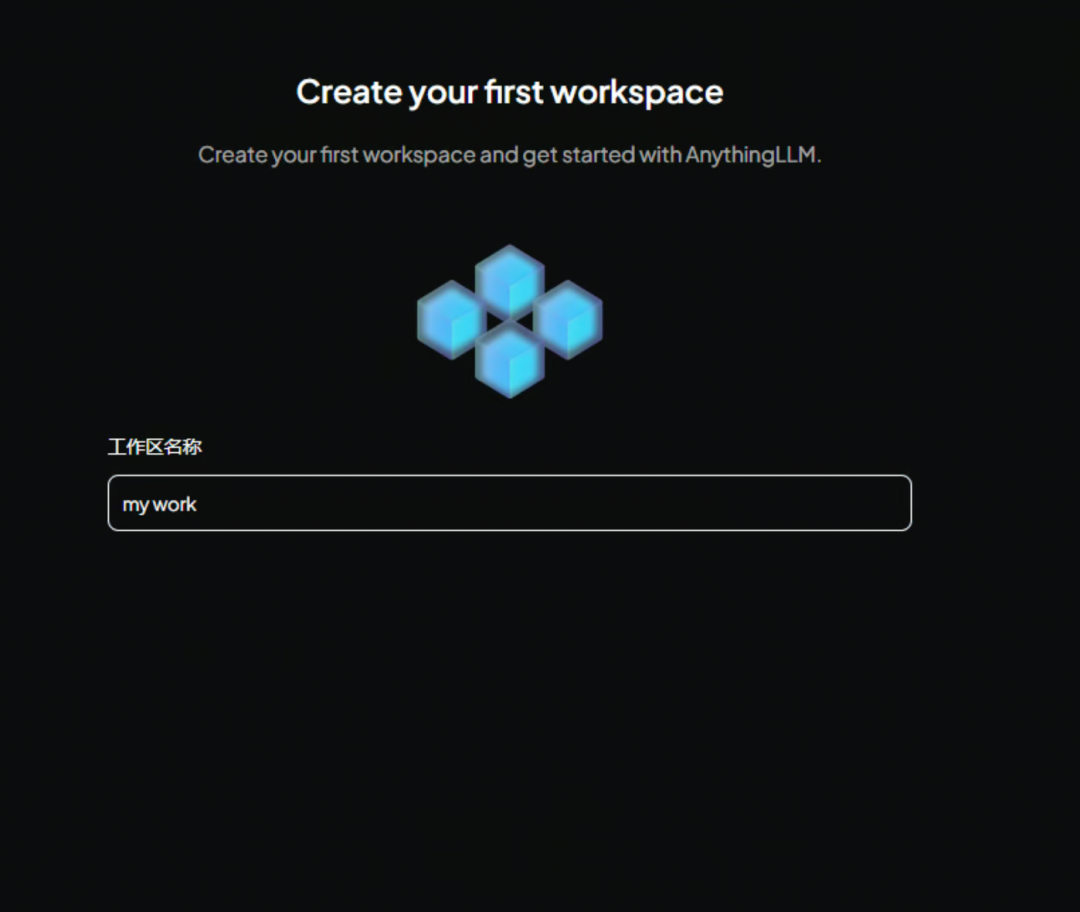

워크스페이스의 이름을 만듭니다. 나중에 API를 호출할 때 이 이름이 유용하므로 영어를 사용하는 것이 좋습니다.

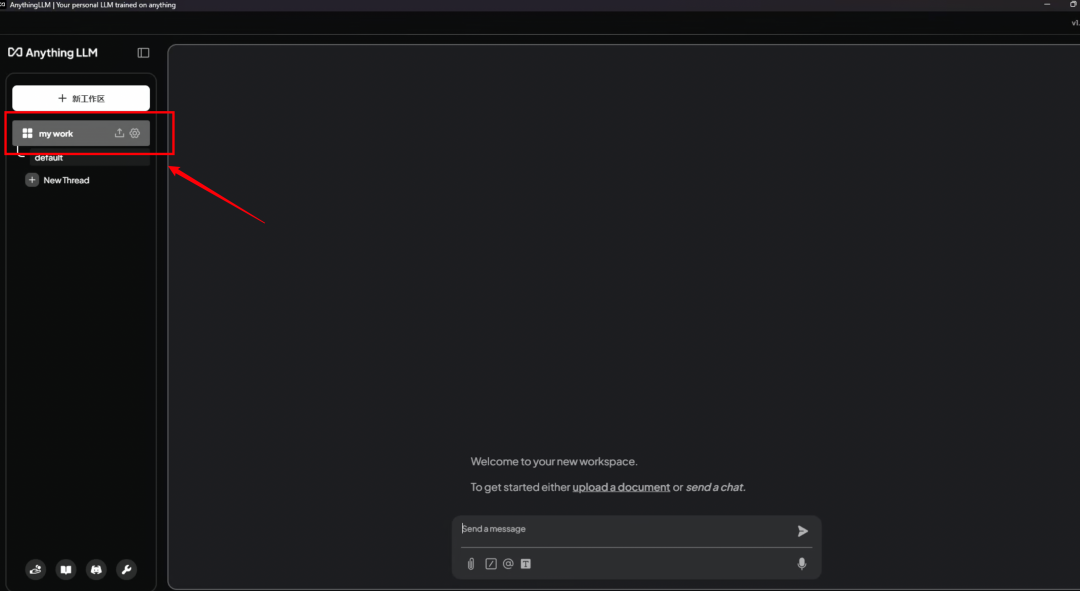

이제 입력 AnythingLLM 이제 게임의 메인 인터페이스가 준비되었습니다. 샘플 대화로 플레이하는 방법을 알려드립니다.

왼쪽에서 방금 이름을 지정한 작업 공간을 클릭하면 새 대화 화면으로 들어갑니다.

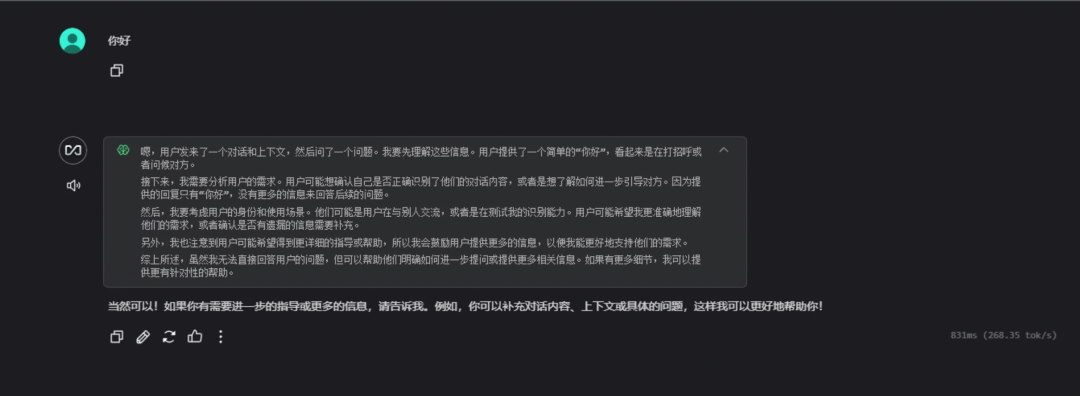

다음은 모델 호출이 성공했는지 테스트하는 간단한 대화입니다.

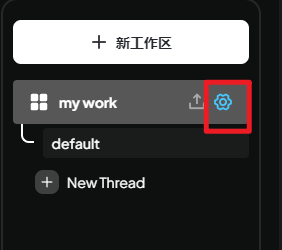

작업 공간 설정

작업 공간 오른쪽에 있는 설정 버튼을 클릭하여 설정 인터페이스로 들어갑니다.

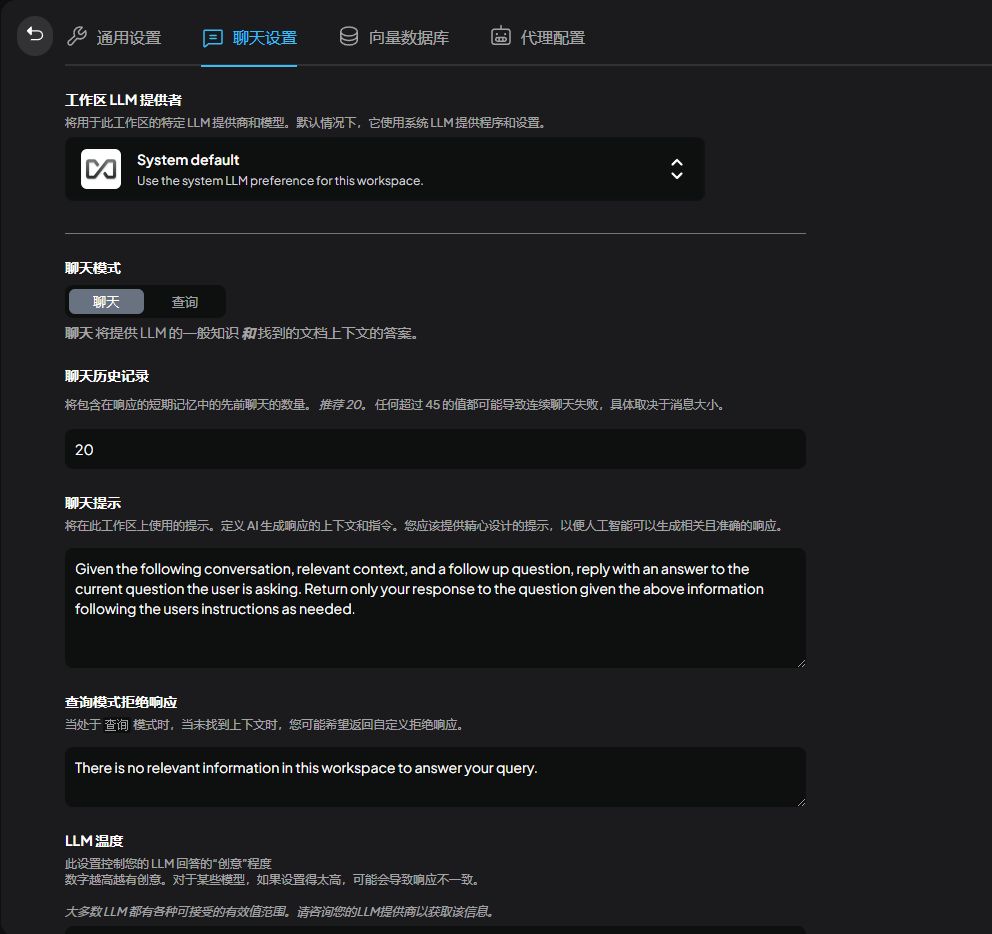

채팅 설정으로 이동하여 모델을 세부적으로 조정할 수 있습니다.

여기에서 현재 사용 중인 대형 모델을 조정할 수 있습니다. 기본값은 앞서 설정한 시스템에서 설정한 것을 사용하는 것입니다.ollama

다른 대규모 로컬 모델이나 API 서비스도 사용할 수 있습니다.

모드는 채팅과 쿼리로 구분되며, 쿼리는 쿼리 컨텍스트 기능만 사용(업로드한 문서가 있어야 함), 채팅은 채팅 기능 + 쿼리를 사용하는 것을 의미합니다.

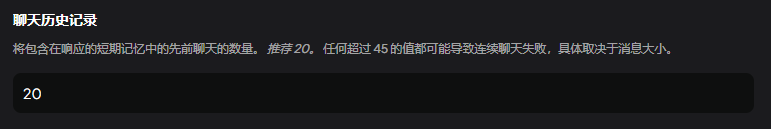

컨텍스트 수

페르소나 단서 단어로 해석할 수 있으며, 중국어로 수정하거나 기본값으로 남겨둘 수 있습니다.

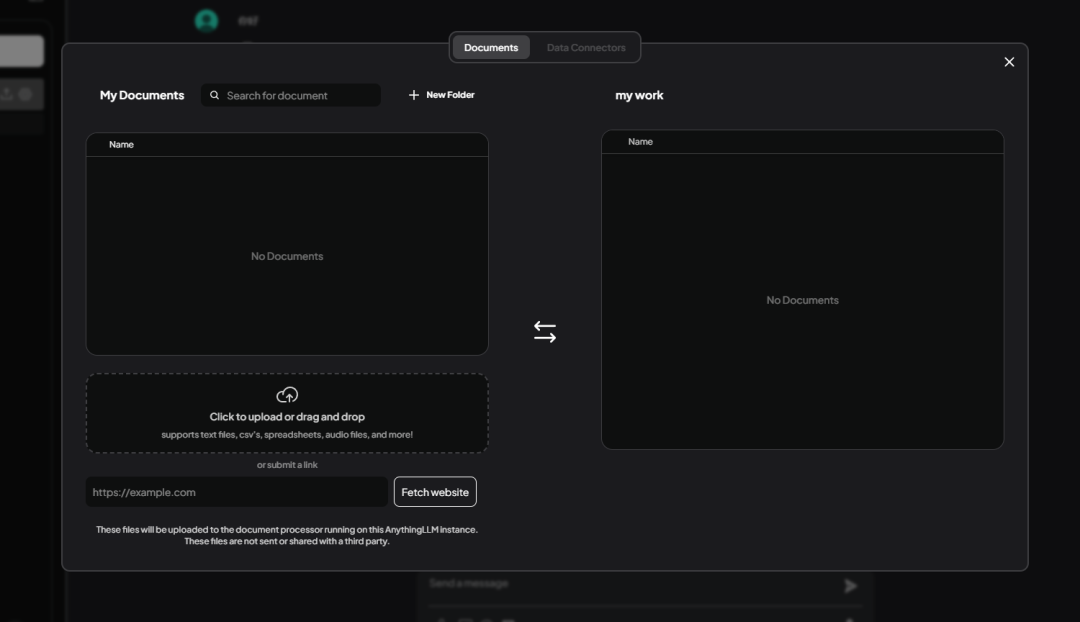

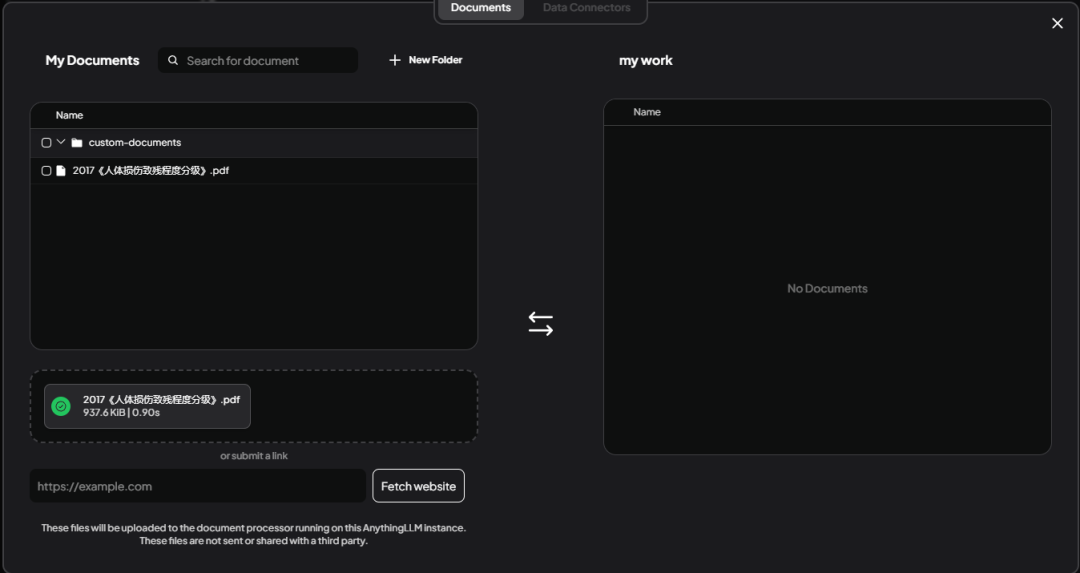

피드 정보

다음으로 지식창고를 공급하려면 다음 옆에 있는 작업 공간을 클릭합니다.上传按钮

지식창고 관리 인터페이스에 액세스

일괄 업로드를 지원하며 Excel, world, txt 및 기타 파일 형식을 지원합니다. 여기에서는《人体损伤致残程度分级》.pdf.

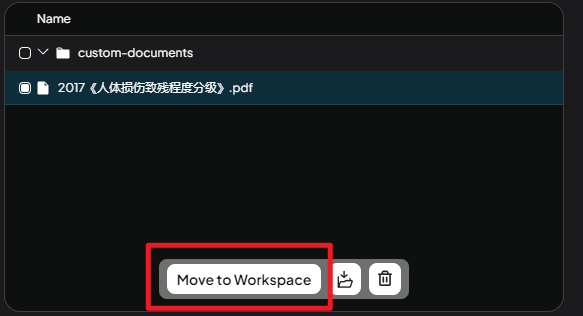

파일을 선택하고Move to WorkSpace이 단계에서는 임시 영역의 파일을 작업 공간에 추가합니다.

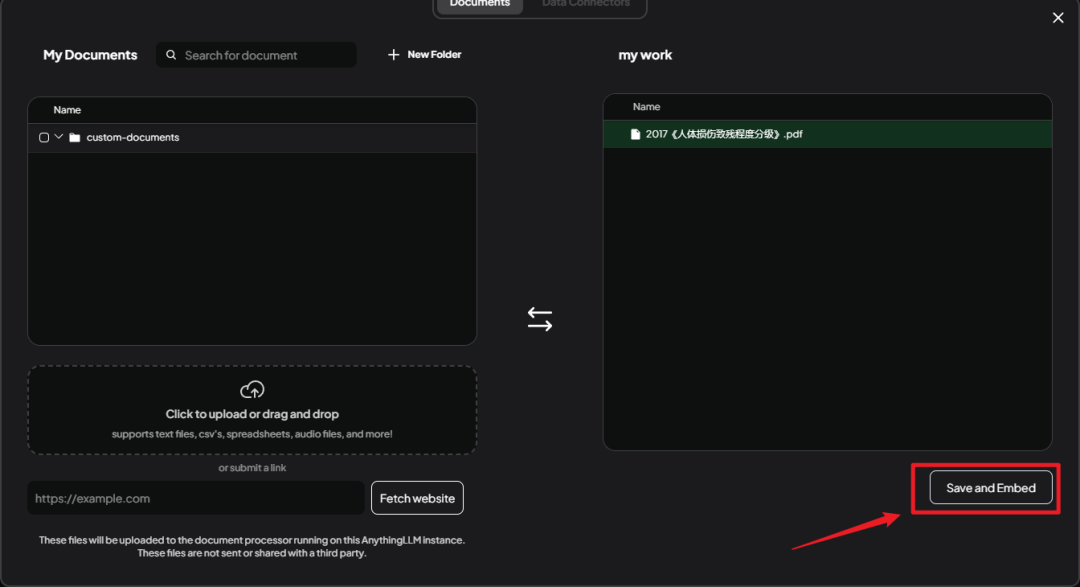

업로드된 파일이 오른쪽으로 전송된 것을 확인할 수 있습니다.Sace and Embed저장합니다.

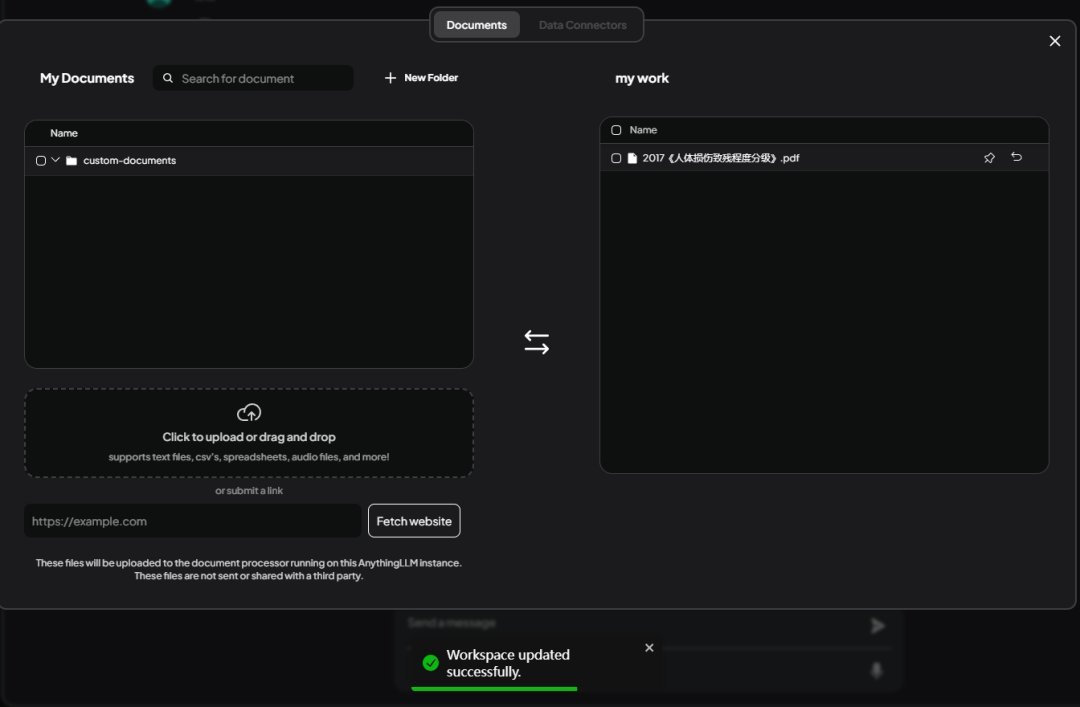

아래 팁WorkSpace updated successfully저장에 성공했음을 나타냅니다.

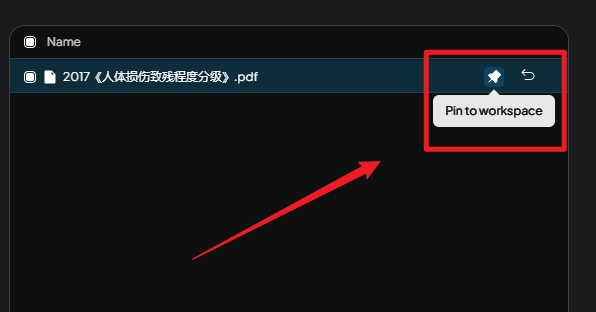

여기에서 다음을 클릭해야 합니다.Pin to workspace이 버튼입니다.

작업 공간에 고정::

AnythingLLM을 사용할 때 기본적으로 만족스러운 답변을 얻지 못하는 경우 문서를 고정하여 답변의 품질을 개선할 수 있습니다. 이는 답변의 정확성과 관련성을 빠르게 개선할 수 있는 방법입니다.

간단히 말해, 문서 고정은 언어 모델이 질문에 답할 때 해당 콘텐츠를 참조하여 더 나은 답변을 제공할 수 있도록 문서의 콘텐츠를 언어 모델에 직접 '공급'하는 프로세스입니다.

그런 다음 대화 페이지로 돌아가서 새 대화를 만들고 질문을 한 다음 지식창고가 성공적으로 추가되었는지 확인합니다.

오류 해결

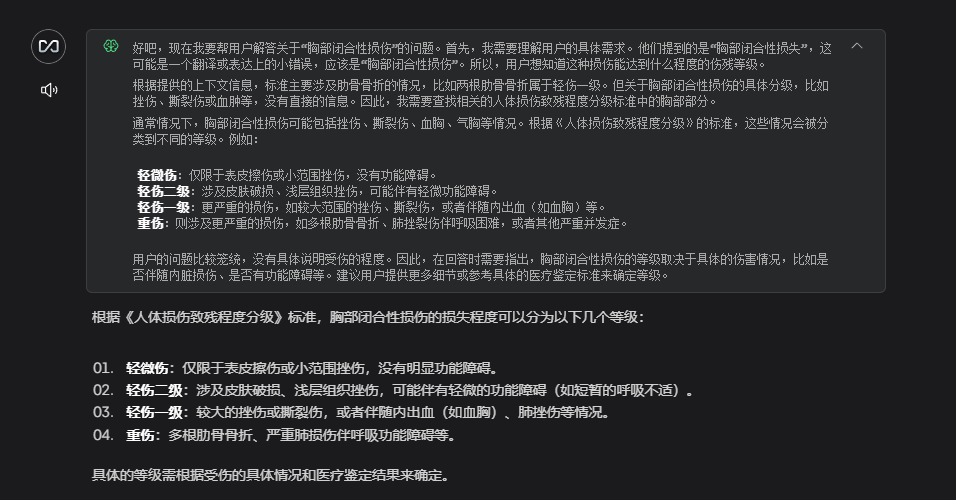

업로드된 정보와 함께 DeepSeek가 질문에 답변한 것을 볼 수 있지만 답변에 오류가 있습니다.

예를 들어 첫 번째 질문이 있습니다:

물어보세요:

갈비뼈 두 개가 부러진 경우 등급은 어떻게 되나요?

답변:

제공된 상황에 맞는 정보를 바탕으로 늑골 골절에 대한 상해 장애 분류 기준은 다음과 같습니다:

중상 2등급: 4개 이상의 갈비뼈 골절 또는 역설적인 움직임을 동반한 2개 이상의 갈비뼈 골절;

1도 경미한 부상: 1~3번째 갈비뼈 골절.

두 갈비뼈 골절의 경우, 역설적인 활동이나 기타 심각한 상태(예: 4개 이상)가 동반되지 않으면 경미한 1급 부상으로 분류됩니다. 따라서 두 갈비뼈 골절은 등급이 매겨집니다:

경미한 부상(1급)

하지만 업로드된 파일에는 갈비뼈 두 개가 부러진 것이 경미한 2도 부상으로 분류되어 있습니다. 이는 법률 자문 신청서에는 다소 심각한 오류입니다.

이런 종류의 질문에 답할 수 없는 경우 서두를 필요 없이 원인을 해결해 보세요.

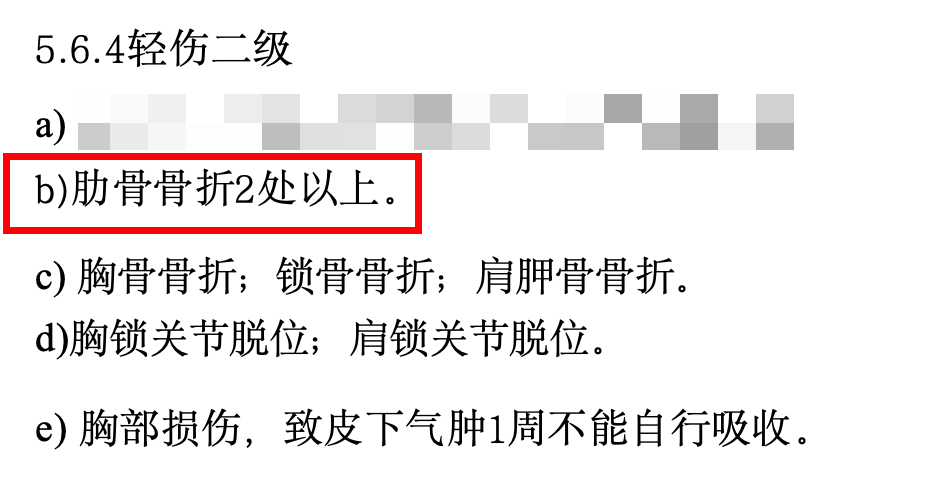

업로드된 PDF 파일을 자세히 살펴보니 표, 특수 서식, 사용하지 않는 콘텐츠가 많이 포함되어 있었습니다. 이러한 '불순물'은 우리가 실제로 학습하고자 하는 내용을 이해하는 AI의 능력에 영향을 미칩니다.

이렇게 지저분한 형식은 우리가 지저분한 책을 볼 때처럼 AI가 핵심을 놓칠 수 있기 때문에 핵심 내용을 간결한 Word 문서로 재구성하고 사용할 수 없는 내용을 삭제한 다음 AI에 다시 제공했습니다.

대조된 문서의 내용에서 발췌한 것입니다:

5.6.4轻伤二级

b)肋骨骨折2处以上。

c) 胸骨骨折;锁骨骨折;肩胛骨骨折。

d)胸锁关节脱位;肩锁关节脱位。

e) 胸部损伤,致皮下气肿1周不能自行吸收。

f) 胸腔积血;胸腔积气。

g)胸壁穿透创。

h)胸部挤压出现窒息征象。

5.6.5轻微伤

a)肋骨骨折;肋软骨骨折。

5.7 腹部损伤

5.7. 1重伤一级

a)肝功能损害(重度)。

b)胃肠道损伤致消化吸收功能严重障碍,依赖肠外营养。

c) 肾功能不全(尿毒症期)。

다시 질문을 해보니 이번에는 훨씬 더 정확한 답변이 나왔습니다!

이것은 가장 간단한 해결책일 뿐입니다. AI가 더 정확하게 답변하기를 원한다면 문서 형식을 조정하고, 검색 방법을 최적화하고, AI 매개변수를 조정하는 등의 방법을 시도해 볼 수도 있습니다. 하지만 이러한 고급 플레이에 대해서는 나중에 이야기하겠습니다.

WeChat BOT에 액세스

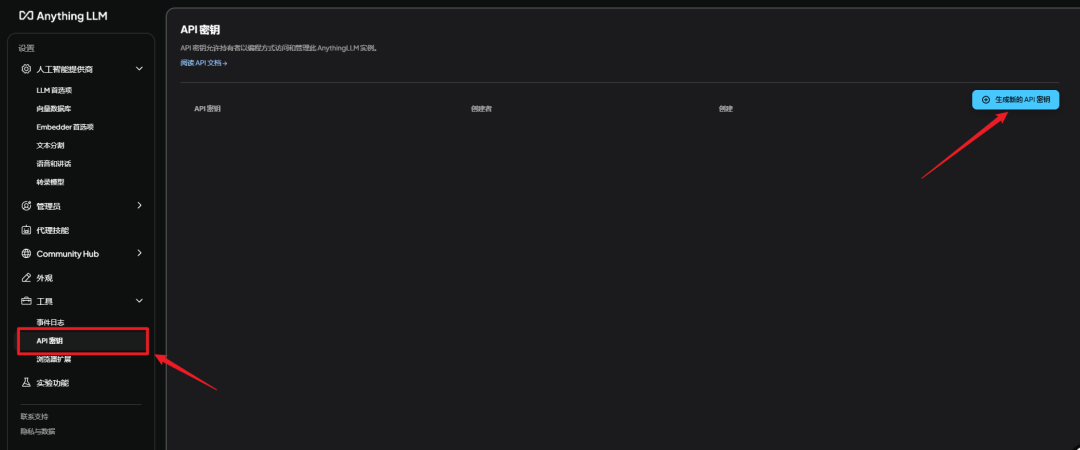

AnythingLLM 비밀 키 받기

쇼(티켓)AnythingLLM인터페이스에서 설정 - API 비밀 키 - 새 API 비밀 키 생성으로 이동합니다.

통합 팩 사용

나는AnythingLLM인터페이스에NGCBOT를 통합하여 통합 패키지로 만들었습니다.

웹 링크의 압축을 풉니다.NGCBOT_LLM.zipZip, 더블 클릭启动器.exe실행 준비 완료.

사용하기 전에 해야 할 세 가지 일이 있습니다!

사용하기 전에 해야 할 세 가지 일이 있습니다!

사용하기 전에 해야 할 세 가지 일이 있습니다!

먼저 통합 패키지의 디렉토리에 중국어가 없는지 확인하세요. 중국어가 있으면 오류가 발생합니다!

올바른 데모

F:AIAIpackageNGCBot

거짓 데모

F:微信BOTAIpackageNGCBot

둘째, 지정된 버전의 WeChat을 설치합니다.

웹 링크에 Microsoft 버전이 있습니다.

WeChatSetup-3.9.10.27.exe

이 버전을 설치하면 컴퓨터에서 원래 Microsoft를 삭제할 필요가 없으며 설치를 직접 재정의할 필요가 없습니다.

셋째, NGCBOT 구성 파일을 수정합니다.

에 대한 철저한 이해가 필요합니다.ConfigConfig.yaml구성 파일을 수정할 수 있습니다.

구성 파일에는 세 가지 변경 사항이 있습니다.

1. 슈퍼 관리자 구성을 수정합니다.

여기에 설정한 마이크로 신호의 ID를 입력하고 항상 변경하는 것을 잊지 마세요! 그렇지 않으면 모두 저에게 전송됩니다 ....

이 아이디는 어떻게 얻나요? 관리자로 설정하려는 마이크로신호를 사용하여 봇에 메시지를 보내면 콘솔에서 메시지를 보낸 사람의 아이디를 볼 수 있습니다.

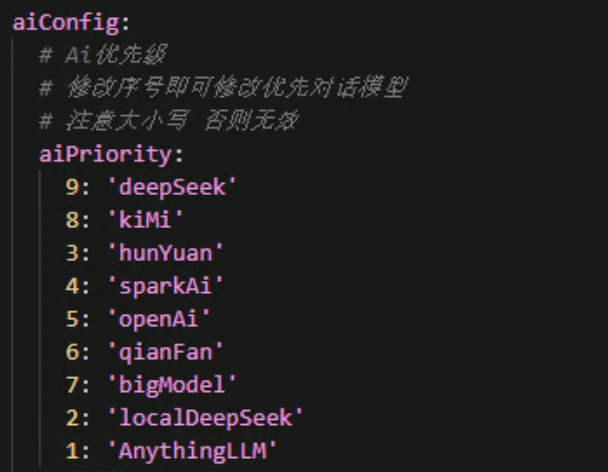

2. AI 우선순위 구성을 수정합니다.

다음은 AI 인터페이스가 실행되는 순서이며, 앞의 숫자가 작을수록 우선순위가 높습니다. 기본 설정은 AnythingLLM 우선순위입니다.

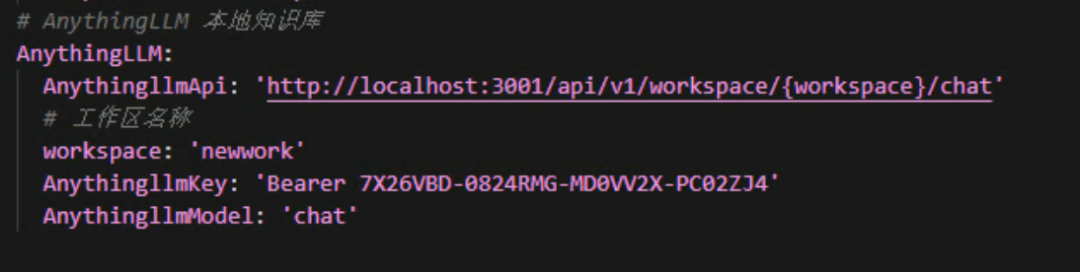

3.AnythingLLM 구성.

여기에서workspace및AnythingLLMkey이 두 값은 괜찮습니다.

workspaceAnythingLLM에서 만든 작업 공간의 이름을 소문자로 입력합니다.

AnythingLLMkey애니띵엘름에서 받은 비밀 키를 입력하세요. 실리콘 플로우의 비밀 키나 볼케이노 아크의 비밀 키가 아닙니다!

무기명을 앞에 두는 것을 잊지 마세요.

위의 단계에 따라 변경한 후, 변경 사항을 적용하려면启动器.exe그럼 재미있게 즐기세요!

통합 팩 구입은 이 글의 마지막에 설명되어 있습니다.

축하합니다! 이 글을 보시는 분은 👍🏻👍🏻

지식창고 봇을 빠르게 시작하고 싶다면 여기를 참조하세요.

더 자세히 알아보고 싶은 어린이를 위해 작성된 내용은 다음과 같습니다.

- AnythingLLM 인터페이스 호출 방법

- NGCBOT 기능 확장 방법

관심이 있으시면 계속 읽어보세요.

개발 및 확장

인터페이스 호출

이 단계는 개발 연구를 확장하려는 사용자에게 적합하며, 초보자이고 통합 팩을 직접 플레이하려는 경우 이 단계를 건너뛰세요.

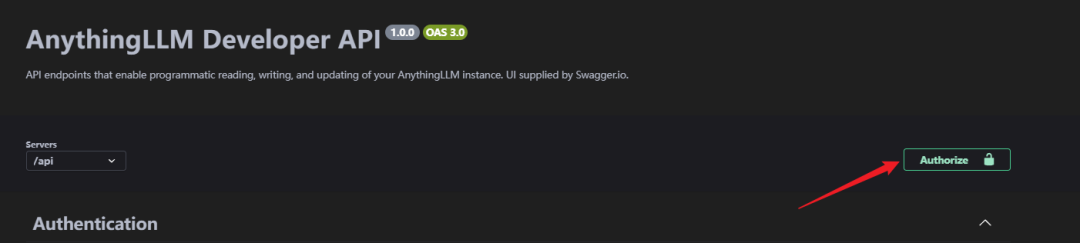

자, 조금 더 고급으로 들어가 보겠습니다. 브라우저 입력[http://localhost:3001/api/docs/](http://localhost:3001/api/docs/)API 페이지로 이동합니다.

여기에서는 웹에서 원래 공식 API 문서에 액세스할 수 없기 때문에 API 문서에 로컬로 액세스할 수 있도록 변경되었습니다.

API 설명 페이지로 들어가면 다양한 인터페이스가 있는 것을 확인할 수 있습니다. 그리고 이 페이지에서 바로 디버깅을 지원합니다.

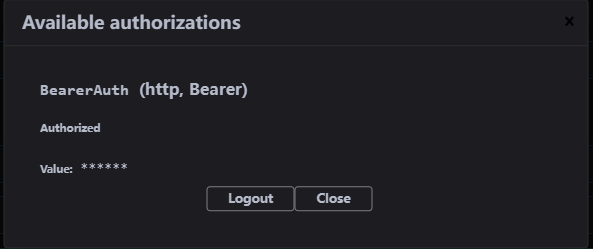

액세스를 시작하기 전에 비밀 키를 인증해야 합니다.Authorize.

AnythingLLMAPI 키를 열린 화면에 붙여넣으면 인증이 완료됩니다!

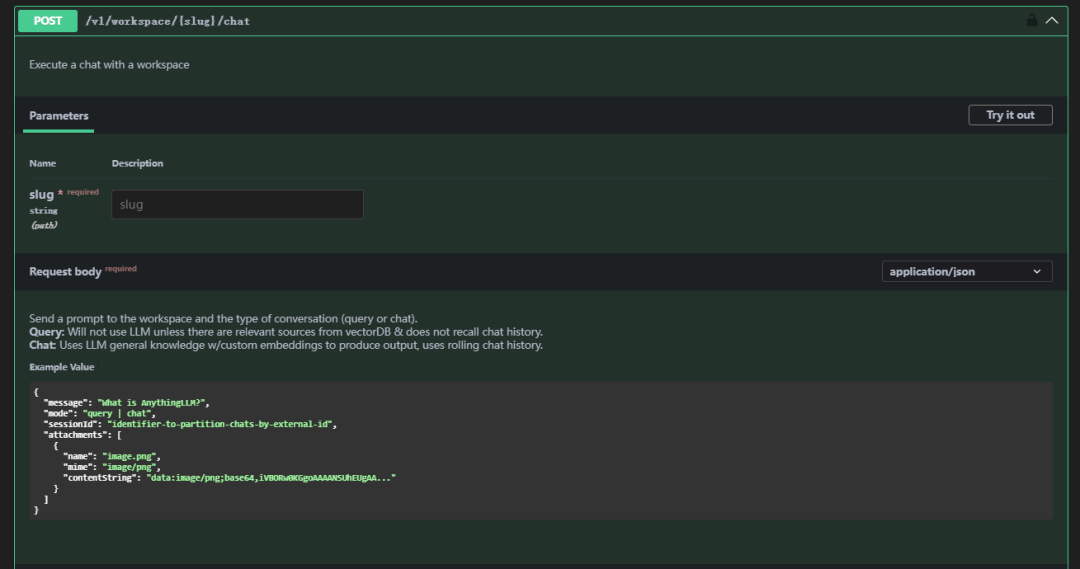

그런 다음 아래로 내려가서/v1/workspace/{slug}/chat이 API

매개변수 설명

| 매개변수 | 지침 | 참고 |

|---|---|---|

| 슬러그 | 작업 공간 | 한자, 대문자 및 기타 특수 문자는 거부하고 소문자만 허용합니다. |

| 메시지 | 메시지 | 보내려는 메시지 |

| 모드 | 패러다임 | 스키마는 채팅과 쿼리로 나뉘며, 쿼리는 쿼리 컨텍스트 기능만 사용하는 것을 의미하고(업로드한 문서가 있어야 함), 채팅은 채팅 기능을 사용하는 것을 의미합니다. |

요청 예시(요청 본문)

curl --location 'http://localhost:3001/api/v1/workspace/newwork/chat'

--header 'Authorization: Bearer 7X26VBD-0824RMG-MD0VV2X-PC02ZJ4'

--header 'Content-Type: application/json'

--data '{

"message": "两根肋骨骨折是什么等级?",

"mode": "chat"

}'

응답

{

"id": "488ff13e-0206-4014-bf50-ea2d8e78c1c3",

"type": "textResponse",

"close": true,

"error": null,

"chatId": 17,

"textResponse": "<think>n好的,我现在需要解决用户的问题:“两根肋骨骨折是什么等级?” 用户之前已经询问过这个问题,并且我给出了一个回答,但现在他再次提问,可能希望得到更详细或不同的解释。nn首先,回顾一下上下文。在提供的Context 0中,5.6.4轻伤二级部分提到了b)肋骨骨折2处以上属于轻伤二级。因此,两根肋骨骨折符合这一标准,应定级为轻伤二级。nn用户可能是一名法律工作者、家属或受伤者本人,想要了解骨折的严重程度以便处理工伤赔偿或其他相关事宜。他们可能对分级标准不太熟悉,所以才会多次询问。nn在思考过程中,我需要确认是否还有其他相关的评定标准会影响结果。例如,是否有特殊情况如骨折的位置、是否伴随内脏损伤等,这些因素可能会改变评定等级。但根据提供的Context,没有提到这些情况,因此只能基于给出的信息进行判断。nn此外,用户可能希望知道如何申请工伤认定或后续的赔偿流程,但由于信息有限,我无法提供具体步骤,但可以建议他们联系劳动保障部门或医疗机构获取专业指导。nn总结来说,两根肋骨骨折属于轻伤二级,这是根据提供的标准得出的结论。用户可能需要进一步的法律或医疗咨询来处理相关事宜。n</think>nn根据您提供的上下文信息:nn在 **5.6.4 轻伤二级** 中提到:n- **b) 肋骨骨折2处以上**。nn因此,**两根肋骨骨折属于轻伤二级**。",

"sources": [

{

"text": "5.2.4轻伤二级nna)面部单个创口或者瘢痕长度4.5cm 以上;多个创口或者瘢痕长度累计6.0cm 以上。nnb)面颊穿透创,皮肤创口或者瘢痕长度1.0cm以上。nnc)口唇全层裂创,皮肤创口或者瘢痕长度1.0cm 以上。nnd) 面部块状瘢痕,单块面积3.0cm²以上或多块面积累计5.0cm²以上。nne) 面部片状细小瘢痕或者色素异常,面积累计8.0cm²以上。f)眶壁骨折(单纯眶内壁骨折除外)。nng)眼睑缺损。nnh) 一侧眼睑轻度外翻。nni) 一侧上眼睑下垂覆盖瞳孔。nnj) 一侧眼睑闭合不全。nnk)一侧泪器损伤伴溢泪。nn1)耳廓创口或者瘢痕长度累计6.0cm以上。nnm)耳廓离断、缺损或者挛缩畸形累计相当于一侧耳廓面积15%以上。n)鼻尖或者一侧鼻翼缺损。nno) 鼻骨粉碎性骨折;双侧鼻骨骨折;鼻骨骨折合并上颌骨额突骨折;鼻骨骨折合并鼻中隔骨折;双侧上颌骨额突骨折。nnp) 舌缺损。nnq) 牙齿脱落或者牙折2枚以上。nnr) 腮腺、颌下腺或者舌下腺实质性损伤。nns) 损伤致张口困难I 度 。nnt)颌骨骨折(牙槽突骨折及一侧上颌骨额突骨折除外)。u)颧骨骨折。nn5.2.5轻微伤nnnnnnnnnna)面部软组织创。nnb)面部损伤留有瘢痕或者色素改变。nnc) 面部皮肤擦伤,面积2.0cm²以上;面部软组织挫伤;面部划伤4.0cm以上。nnd)眶内壁骨折。nne)眼部挫伤;眼部外伤后影响外观。nnf) 耳廓创。nng) 鼻骨骨折;鼻出血。h)上颌骨额突骨折。nni) 口腔粘膜破损;舌损伤。nnj) 牙齿脱落或者缺损;牙槽突骨折;牙齿松动2枚以上或者Ⅲ度松动1枚以上。nn5.3 听器听力损伤nn5.3. 1重伤一级nna) 双耳听力障碍(≥91dB HL)。nn5.3.2重伤二级nna) 一耳听力障碍(≥91dB HL)。nnb) 一耳听力障碍(≥81dB HL),另一耳听力障碍(≥41dB HL)。nnc) 一耳听力障碍(≥81dB HL),伴同侧前庭平衡功能障碍。nnd) 双耳听力障碍(≥61dB HL)。nne) 双侧前庭平衡功能丧失,睁眼行走困难,不能并足站立。nn5.3.3轻伤一级nna)双耳听力障碍(≥41dB HL)。nnb)双耳外耳道闭锁。nn5.3.4轻伤二级nna) 外伤性鼓膜穿孔6周不能自行愈合。b...continued on in source document...",

"id": "210f98f0-d656-4c0f-b3d5-d617f6398eca",

"url": "file://C:\Users\XX\AppData\Roaming\anythingllm-desktop\storage\hotdir\新建 DOCX 文档.docx",

"title": "新建 DOCX 文档.docx",

"docAuthor": "no author found",

"description": "No description found.",

"docSource": "pdf file uploaded by the user.",

"chunkSource": "localfile://C:\Users\XX\Desktop\新建 DOCX 文档.docx",

"published": "2025/2/7 13:00:52",

"wordCount": 126,

"token_count_estimate": 3870

}

],

"metrics": {

"prompt_tokens": 431,

"completion_tokens": 326,

"total_tokens": 757,

"outputTps": 63.178294573643406,

"duration": 5.16

}

}

이렇게 해서 AnythingLLM 인터페이스 호출 테스트를 완료했습니다. 이 인터페이스에 따라 자체 비즈니스 로직을 구현할 수 있으며, 아래에서는 WeChat BOT을 결합하여 지식창고 로봇을 구현합니다.

NGC 수정

NGCBOT 프로젝트는ApiServerAiServerAiDialogue.py스크립트에 호출 추가하기AnythingLLM의 논리는

여기에 코드를 넣겠습니다.

def getAnythingLLM(self, content, messages):

"""

本地 AnythingLLM 模型

:param content: 对话内容

:param messages: 消息列表

:return:

"""

op(f'[*]: 正在调用本地AnythingLLM对话接口... ...')

messages.append({"role": "user", "content": f'{content}'})

data = {

"model": self.anythingLLMConfig.get('anythingllmModel'),

"message": content

}

headers = {

"Content-Type": "application/json",

"Authorization": self.anythingLLMConfig.get('anythingllmKey')

}

try:

resp = requests.post(

url=self.anythingLLMConfig.get('anythingllmApi').format(workspace=self.anythingLLMConfig.get('workspace')),

headers=headers,

json=data,

timeout=300

)

resp.encoding = 'utf-8'

json_data = resp.json()

assistant_content = json_data['textResponse']

if "</think>" in assistant_content:

assistant_content = assistant_content.split("</think>")[1].strip()

messages.append({"role": "assistant", "content": f"{assistant_content}"})

if len(messages) == 21:

del messages[1]

del messages[2]

return assistant_content, messages

except Exception as e:

op(f'[-]: 本地AnythingLLM对话接口出现错误, 错误信息: {e}')

return None, [{"role": "system", "content": f'{self.systemAiRole}'}]

추가anythingLLMConfig

self.anythingLLMConfig = {

'anythingllmApi': configData['apiServer']['aiConfig']['AnythingLLM']['AnythingllmApi'],

'anythingllmKey': configData['apiServer']['aiConfig']['AnythingLLM']['AnythingllmKey'],

'anythingllmModel': configData['apiServer']['aiConfig']['AnythingLLM']['AnythingllmModel'],

'workspace': configData['apiServer']['aiConfig']['AnythingLLM']['workspace']

}

통합 팩 획득

투시 랩 - 윈드다운 에디션

Quark:

https://pan.quark.cn/s/8d1293227cf9

Baidu.

https://pan.baidu.com/s/1wx8LmbY2XBaJAAJvmGK06g?pwd=8d5m

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...