일반 소개

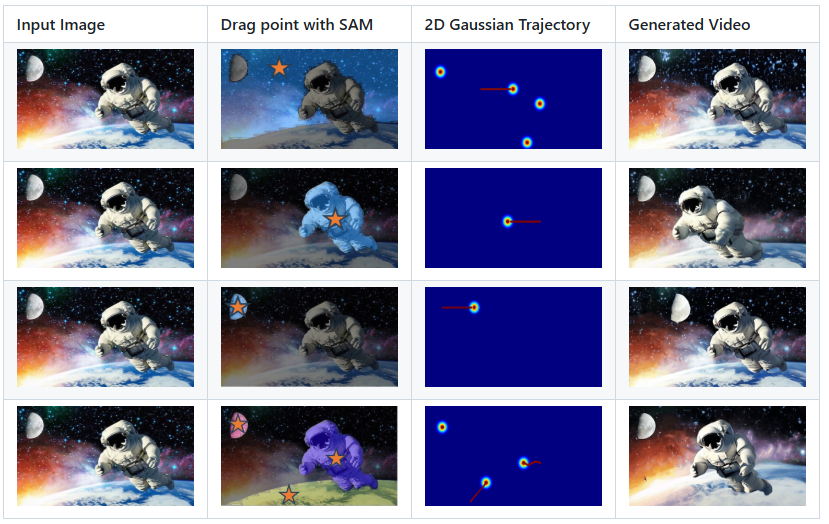

DragAnything은 엔티티 표현을 통해 임의의 물체를 모션 제어하는 것을 목표로 하는 오픈 소스 프로젝트입니다. 쇼랩 팀이 개발하여 ECCV 2024에서 승인한 DragAnything은 궤적을 그리는 것만으로 사물의 움직임을 제어할 수 있는 사용자 친화적인 인터랙션 방식을 제공합니다. 이 프로젝트는 전경, 배경, 카메라 모션 등 여러 오브젝트의 동시 모션 제어를 지원하며, 특히 오브젝트 모션 제어의 경우 여러 지표에서 기존의 최첨단 방식보다 뛰어난 성능을 발휘합니다.

기능 목록

- 엔티티 표현: 오픈 필드 임베딩을 사용하여 모든 개체를 표현할 수 있습니다.

- 궤적 제어: 객체 모션 제어는 궤적선을 그려서 이루어집니다.

- 다중 객체 제어: 전경, 배경, 카메라의 동시 모션 제어를 지원합니다.

- 대화형 데모: Gradio를 사용하여 대화형 데모를 지원합니다.

- 데이터 세트 지원: VIPSeg 및 Youtube-VOS 데이터 세트를 지원합니다.

- 고성능: FVD, FID 및 사용자 연구에서 탁월합니다.

도움말 사용

설치 프로세스

- 프로젝트 코드를 복제합니다:

git clone https://github.com/showlab/DragAnything.git

cd DragAnything

- Conda 환경을 만들고 활성화합니다:

conda create -n DragAnything python=3.8

conda activate DragAnything

- 종속성을 설치합니다:

pip install -r requirements.txt

- 데이터 집합을 준비합니다:

- VIPSeg 및 Youtube-VOS 데이터 세트를 다운로드하려면 다음을 수행하세요.

./data카탈로그.

- VIPSeg 및 Youtube-VOS 데이터 세트를 다운로드하려면 다음을 수행하세요.

사용법

- 대화형 데모를 실행합니다:

python gradio_run.py

브라우저를 열고 제공된 로컬 주소를 방문하여 대화형 데모를 시작하세요.

- 오브젝트 모션을 제어합니다:

- 입력 이미지에 궤적선을 그리고 제어하려는 개체를 선택합니다.

- 스크립트를 실행하여 동영상을 생성합니다:

python demo.py --input_image <path_to_image> --trajectory <path_to_trajectory>- 생성된 동영상은 지정된 디렉토리에 저장됩니다.

- 모션 궤적을 사용자 지정합니다:

- 코트랙 도구를 사용하여 나만의 모션 트랙 주석 파일을 처리할 수 있습니다.

- 처리된 파일을 지정된 디렉토리에 배치하고 스크립트를 실행하여 동영상을 생성합니다.

주요 기능

- 물리적 표현사용자가 직접 주석을 달 필요 없이 오픈 필드 임베딩을 통해 모든 객체를 표현합니다.

- 궤적 제어: 사용자가 입력 이미지에 궤적선을 그리는 것만으로 물체의 움직임을 제어할 수 있습니다.

- 다중 개체 제어전경, 배경, 카메라 등 여러 개체의 움직임을 동시에 제어할 수 있습니다.

- 대화형 프레젠테이션Gradio에서 제공하는 대화형 인터페이스를 통해 사용자는 모션 제어의 효과를 실시간으로 확인할 수 있습니다.

- 고성능FVD, FID 및 사용자 연구, 특히 객체 모션 제어에서 탁월한 성능을 발휘합니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...