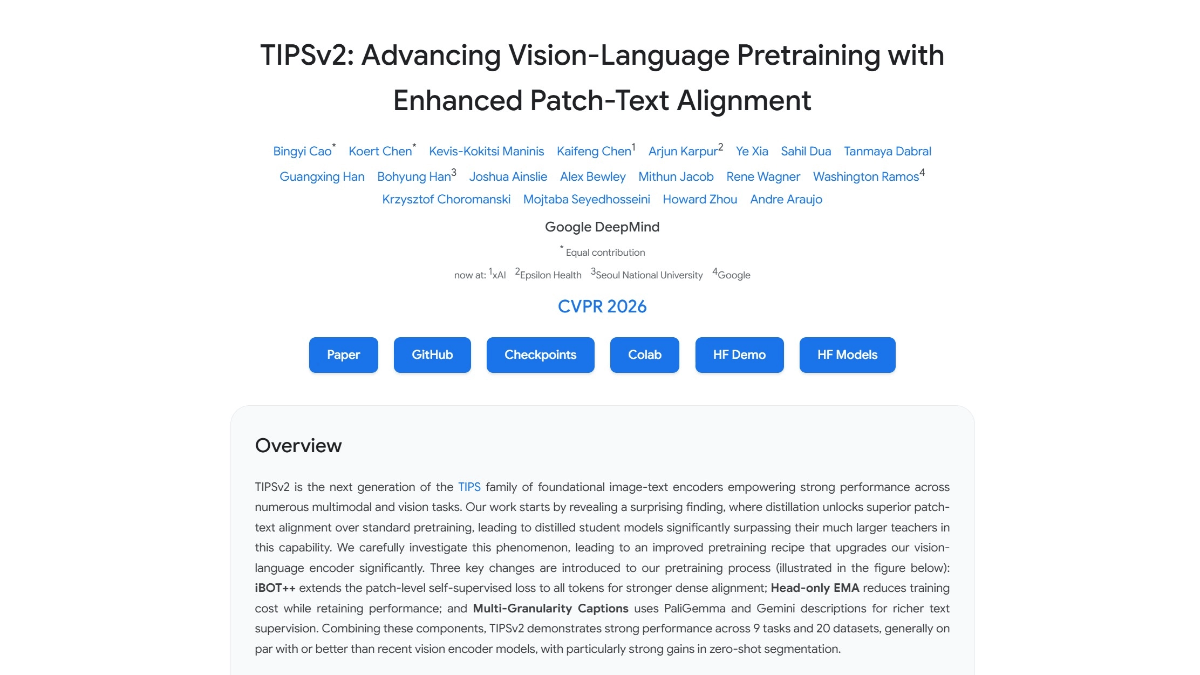

TIPSv2 - Google DeepMind 开源的多模态视觉-语言基础模型

TIPSv2是什么

TIPSv2(Text-Image Pretraining with Spatial awareness v2)是 Google DeepMind 推出的开源多模态视觉-语言基础模型,相关论文已被 CVPR 2026 接收。模型核心解决视觉语言模型在"全局理解强、局部定位弱"的痛点,通过 iBOT++、Head-only EMA 和多粒度文本描述三大技术创新,实现了图像 Patch 与文本嵌入的精准密集对齐。

TIPSv2的功能特色

- 图像 Patch 与文本嵌入的密集对齐:作为多模态视觉-语言基础模型,核心解决"全局理解强、局部定位弱"的痛点,实现像素级语义与文本描述的精准对应。

- iBOT++ 自监督对齐机制:将监督信号扩展至所有图像 Token(含可见 Patch),强制模型在所有局部区域保持细粒度表征一致性,大幅提升零样本分割性能。

- Head-only EMA 高效训练:仅对顶层投影头执行指数移动平均,冻结主干网络,减少约 42% 可训练参数量,显著降低十亿参数级模型的显存开销。

- 多粒度文本描述训练:随机交替使用网页 Alt-text、PaliGemma 局部密集字幕与 ジェミニ Flash 全局深度描述,防止模型走捷径并吸收丰富细节语义。

- 零样本语义分割:无需人工标注,直接通过文本指令对图像进行像素级语义分割,在 ADE20K、Pascal VOC 等权威基准上刷新业界最优。

- 开放词汇目标检测与定位:支持"图中那只熊猫的左后腿在哪里"等细粒度语言查询,精准定位到图像具体局部区域。

- 图文跨模态检索:支持从图搜文、从文搜图,在长文本描述匹配(DOCCI)等任务上表现突出。

- 深度估计与表面法线预测:通过开源 DPT 预测头,直接部署高精度的几何理解任务(如 NYU Depth V2 深度估计)。

- 全规格模型家族:提供 ViT-B/14(86M)、ViT-L/14(303M)、SO400m/14(412M)、ViT-g/14(1.1B)四种参数规模,覆盖边缘端至云端部署需求。

- 双框架原生支持:同时提供 PyTorch 与 Jax(Scenic)适配版本,降低不同技术栈团队的接入门槛。

- Apache 2.0 开源协议:代码、模型权重及 DPT 预测头全面开源,学术研究与商业落地均可自由使用。

TIPSv2的核心优势

- iBOT++ —— 全局 Patch 自监督对齐:传统 iBOT 仅对被掩码(Masked)的图像块计算损失,可见 Patch 缺乏直接监督。iBOT++ 将监督扩展至所有 Token(含可见 Patch),强制模型在所有局部区域保持细粒度表征一致性。仅此一项改动,ADE150 零样本分割 mIoU 从 3.5 飙升至 17.6,提升 +14.1 .

- Head-only EMA —— 高效显存策略:传统自监督学习需对整个模型做指数移动平均(EMA),十亿参数级训练显存开销巨大。TIPSv2 发现图文对比损失(CLIP 损失)已能为视觉骨干提供稳定信号,因此仅对顶层投影头执行 EMA,冻结主干网络。该策略减少约 42% 可训练参数量,显存占用显著降低且性能几乎无损 。

- 多粒度文本描述(Multi-Granularity Captions):训练数据不局限于网页 Alt-text,而是随机交替使用 PaliGemma 生成的局部密集字幕与 Gemini Flash 生成的全局深度描述。这种"难易交替"机制防止模型因描述过于独特而走捷径,同时吸收丰富细节语义,提升复杂密集对齐与全局检索的鲁棒性 。

- 极致的参数效率:TIPSv2-g(1.1B 参数)在 3/5 共享评估体系中击败了参数量多 56%、训练数据多 47 倍的 PE-core G/14;在与 DINOv3 的公平对决中(ViT-L 规格),TIPSv2 在 6 项共享任务中赢下 4 项 。

- 反直觉的蒸馏现象:研究发现,通过 Patch 级蒸馏得到的学生模型,在零样本分割等密集对齐任务上竟大幅反超教师模型。原因在于蒸馏过程移除了掩码机制,对所有可见 Patch 施加了显式对齐约束,弥补了预训练大模型的局部对齐短板 。

TIPSv2官网是什么

- プロジェクトのウェブサイト:https://gdm-tipsv2.github.io/

- GitHubリポジトリ:https://github.com/google-deepmind/tips

- HuggingFaceモデルライブラリ:https://huggingface.co/collections/google/tipsv2

- arXivテクニカルペーパー:https://arxiv.org/pdf/2604.12012

使用TIPSv2的操作步骤

- 在线零门槛体验:直接访问 HuggingFace 官方 Demo 空间,无需本地配置即可上传图片并测试图文对齐、零样本分割等能力。

- 本地模型下载与加载:从 HuggingFace 或 GitHub 仓库下载对应规格的预训练权重(ViT-B/14、ViT-L/14、SO400m/14 或 ViT-g/14),使用 PyTorch 或 Jax(Scenic)框架加载模型进行推理。

- 零样本语义分割调用:输入图像与文本描述(如"天空"、"道路"),模型自动将文本语义精准映射到图像像素级区域,无需任何标注数据或微调训练。

- 细粒度视觉定位查询:通过自然语言指令定位图像局部元素(如"图中那只熊猫的左后腿"),获取 Patch 级别的空间坐标与语义掩码。

- 图文跨模态检索应用:将图像编码为视觉嵌入、文本编码为语言嵌入,计算相似度实现以文搜图或以图搜文,适用于长文本描述匹配场景。

- 几何理解任务部署:下载官方开源的 DPT 预测头(基于 SO400m/14),直接接入深度估计(NYU Depth V2)、表面法线预测或语义分割(ADE20K)管线。

- 模型蒸馏与二次开发:利用 TIPSv2 作为教师模型进行 Patch 级蒸馏,训练更轻量的学生模型;学生模型在密集对齐任务上可能反超教师,适合资源受限的边缘端部署。

- 选择适配的硬件规格:86M 参数的 ViT-B/14 适合边缘端与实时应用;1.1B 参数的 ViT-g/14 适合云端高精度任务;根据显存与延迟需求灵活选型。

TIPSv2的适用人群

- 计算机视觉研究员:需要探索细粒度视觉-语言对齐、零样本分割、自监督学习前沿的学术机构与实验室。

- マルチモーダル・アプリケーション開発者:从事开放词汇目标检测、精细图像检索、视觉问答(VQA)等需要 Patch 级语义理解的产品团队。

- 医疗影像与工业检测团队:对高精度局部图像理解有强需求,需将语言描述精准对应到病灶或缺陷区域的垂直领域从业者。

- 自动驾驶感知工程师:需要模型对道路元素进行密集语义分割与空间关系理解的场景。

- AI 基础设施与模型训练工程师:关注十亿参数级模型高效训练策略(如 Head-only EMA)的底层系统优化人员。

TIPSv2的常见问题

Q:为什么 TIPSv2 蒸馏出的小模型在某些任务上比大模型更强?

A: 核心原因在于蒸馏过程的两个关键设置:第一,学生模型从随机初始化开始,不受大模型训练惯性束缚;第二,蒸馏时对所有可见 Patch 直接施加对齐损失,相当于给每个图像块上了"精细辅导课"。而大模型预训练时仅监督被遮挡部分,可见 Patch 缺乏直接约束,导致局部对齐能力不足。

A: 核心原因在于蒸馏过程的两个关键设置:第一,学生模型从随机初始化开始,不受大模型训练惯性束缚;第二,蒸馏时对所有可见 Patch 直接施加对齐损失,相当于给每个图像块上了"精细辅导课"。而大模型预训练时仅监督被遮挡部分,可见 Patch 缺乏直接约束,导致局部对齐能力不足。

Q:多粒度字幕策略为何随机交替,而不是全部使用最详细的 Gemini 描述?

A: 若每张图都使用过于详尽的描述,描述内容的独特性会让模型无需真正理解语义就能区分不同图像,导致对比学习难度下降、训练效果打折。随机交替使用简洁(PaliGemma)与详细(Gemini)字幕,既保证适度挑战,又吸收细节语义,整体性能更优。

A: 若每张图都使用过于详尽的描述,描述内容的独特性会让模型无需真正理解语义就能区分不同图像,导致对比学习难度下降、训练效果打折。随机交替使用简洁(PaliGemma)与详细(Gemini)字幕,既保证适度挑战,又吸收细节语义,整体性能更优。

Q:TIPSv2 与 DINOv3 相比如何?

A: 在双方共有的最大公共规格 ViT-L 下公平对比,DINOv3 教师模型参数量是 TIPSv2 的 6 倍,训练图像数据量是 15 倍。结果 TIPSv2 在 6 项共享评估任务中赢下 4 项(含零样本分割核心任务),证明图文双模态联合约束优于单一纯视觉预训练。

A: 在双方共有的最大公共规格 ViT-L 下公平对比,DINOv3 教师模型参数量是 TIPSv2 的 6 倍,训练图像数据量是 15 倍。结果 TIPSv2 在 6 项共享评估任务中赢下 4 项(含零样本分割核心任务),证明图文双模态联合约束优于单一纯视觉预训练。

Q:模型是否支持商用?

A: 是的。TIPSv2 的代码、模型权重及 DPT 预测头均遵循 Apache 2.0 开源协议,学术研究与商业落地均可自由使用。

A: 是的。TIPSv2 的代码、模型权重及 DPT 预测头均遵循 Apache 2.0 开源协议,学术研究与商业落地均可自由使用。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません