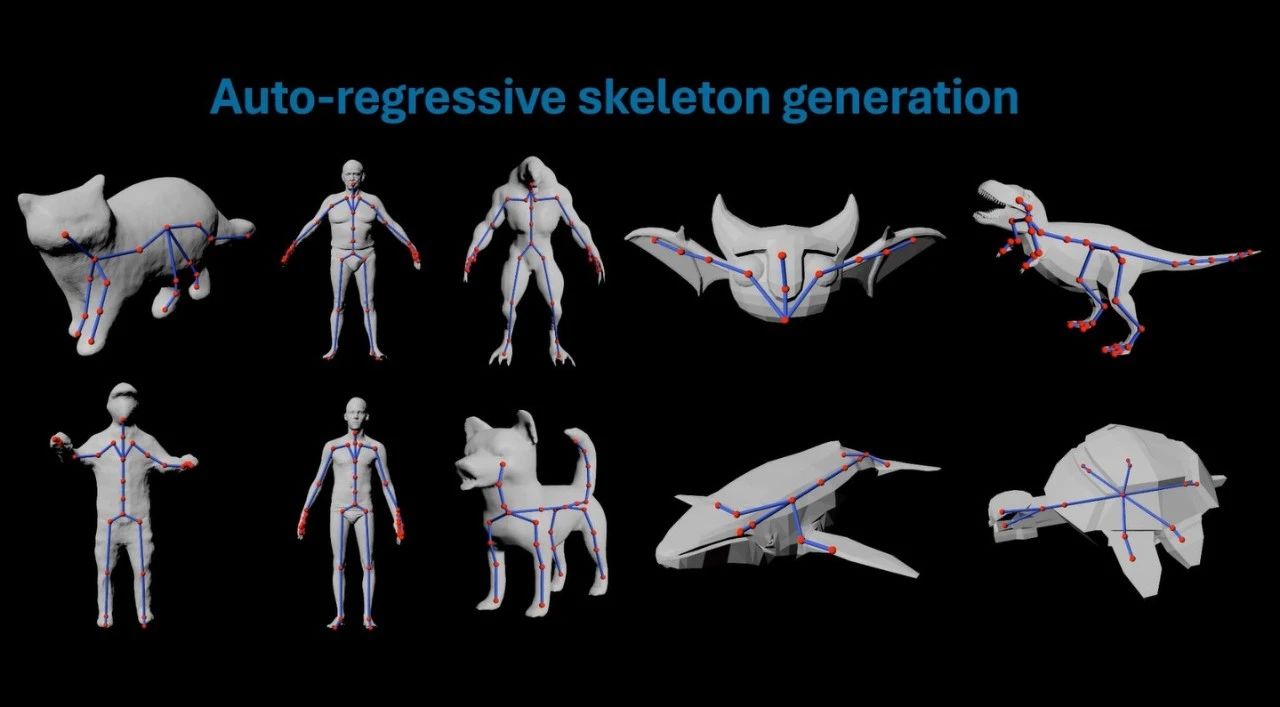

MagicArticulate:静的な3Dモデルから骨格構造のアニメーション資産を生成する

はじめに

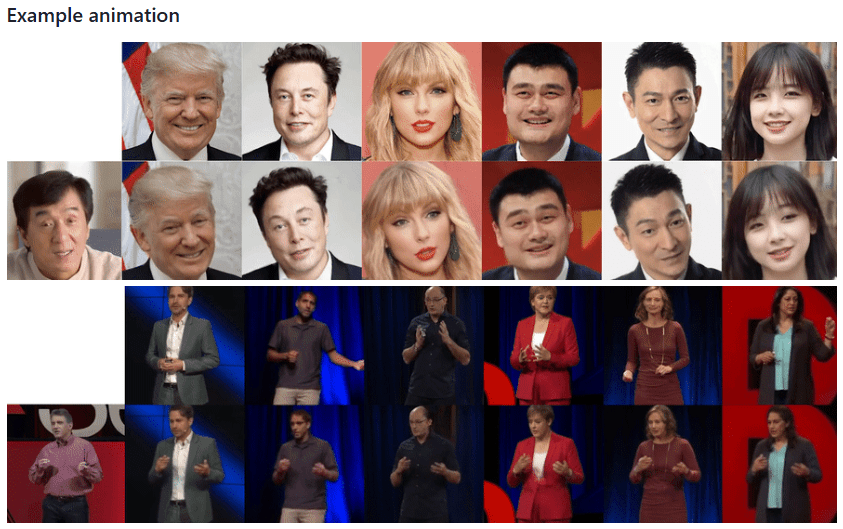

MagicArticulateは、ByteDanceが南洋理工大学(NTU)と共同で開発したAIフレームワークで、静的な3Dモデルをアニメーション可能なデジタル資産に迅速に変換することに焦点を当てています。高度な自己回帰トランスフォーマー(Autoregressive Transformer)と機能拡散モデル(Functional diffusion models)を通して、モデルの骨格構造とスキニングウェイト(Skinning Weights)を自動生成することで、従来の3Dアニメーション制作の複雑なプロセスを大幅に簡素化します。ゲーム開発者であれ、VR/ARデザイナーであれ、映画アニメーターであれ、このツールはユーザーの時間を節約し、効率を向上させるのに役立ちます。ウェブサイトでは、大規模なデータセットArticulation-XLやオープンソースコードなど、その中核となる技術的成果を紹介しています。

機能一覧

- 大規模データセットのサポート関節アノテーションを含む33,000以上の3Dモデルを含むArticulation-XLデータセットを提供します。

- 骨の自動生成自己回帰変換器を用いた静的モデルの柔軟な骨格構造の生成

- 皮膚重量予測機能的拡散モデルに基づく自然な変形に対する皮膚の重みの自動生成。

- 多範疇モデル処理ヒューマノイド、動物、機械など、さまざまな3Dオブジェクトのアニメーション生成に対応。

- オープンソース・コードとモデリングGitHubへのリンクは、ユーザーがコードをダウンロードし、モデルを事前にトレーニングできるように用意されている。

ヘルプの使用

MagicArticulateは、3Dモデルのアニメーションを簡単かつ効率的に行うために設計された技術主導のツールです。以下は、ウェブサイトの訪問から実際の作業まで、その機能を完全に把握するのに役立つ詳細なユーザーガイドです。

アクセスおよびインストール手順

MagicArticulateのウェブサイトはインストールなしで見ることができますが、フレームワークを実行し、機能を体験するには、ローカルで環境を設定する必要があります。手順は以下の通りです:

- ウェブサイトへのアクセス

ブラウザに入力https://chaoyuesong.github.io/MagicArticulate/このページには、プロジェクトの簡単な説明と技術ハイライト、ダウンロードへのリンクが含まれています。このページには、プロジェクトの概要、技術ハイライト、ダウンロードリンクが含まれています。 - ソースコードのダウンロード

- GitHubのリンクは、サイトの一番下かサイドバー(通常は

https://github.com/ChaoyueSong/MagicArticulate). - Code "ボタンをクリックし、"Download ZIP "を選択してZIPファイルをダウンロードするか、Gitコマンドを使用する:

git clone https://github.com/ChaoyueSong/MagicArticulate.git - ファイルをローカル・ディレクトリに展開する。

MagicArticulate/.

- GitHubのリンクは、サイトの一番下かサイドバー(通常は

- ランタイム環境の設定

- Pythonバージョンの確認Python 3.8+がインストールされていることを確認してください:

python --version. - 仮想環境の構築(推奨):

python -m venv magic_env source magic_env/bin/activate # Linux/Mac magic_env\Scripts\activate # Windows - 依存関係のインストールプロジェクト・ディレクトリに移動して実行する:

pip install -r requirements.txtコンダがサポートしていれば利用可能:

conda env create -f environment.yml conda activate magicarticulate - 従属READMEによっては、パフォーマンスを向上させるために、GPUを確実にサポートするためにPyTorchやその他のライブラリをインストールする必要があるかもしれません。

- Pythonバージョンの確認Python 3.8+がインストールされていることを確認してください:

- ローンチ・フレームワーク

設定が完了したら、サンプルスクリプトを実行する(具体的なコマンドはGitHubのドキュメントを参照):

python main.py --input [3D模型路径] --output [输出路径]

主な機能

以下は、MagicArticulateのコア機能と詳細な説明です:

1.Articulation-XLデータセットの使用

- 機能説明33,000以上の関節アノテーション付き3Dモデルが、トレーニングやテストに利用できます。

- 手続き::

- ウェブサイトまたはGitHubでデータセットのダウンロードリンクを見つける(許可を得る必要があるかもしれない)。

- ローカルにダウンロードして解凍する。

data/articulation_xl/. - コンフィギュレーション・ファイルまたはコマンド・ラインを修正し、パスを指定する:

python process.py --dataset_path data/articulation_xl/

- 実行後、データセットをロードしてアノテーション結果を表示し、検証やモデル入力に使用することができます。

2.骨格構造の自動生成

- 機能説明静的3Dモデルのボーンを自動生成し、多様な関節要件をサポートします。

- 手続き::

- 静的3Dモデル(OBJ、FBXなどの形式をサポート)を用意し、入力ディレクトリ(例えば

input/). - ボーン生成コマンドを実行します:

python generate_skeleton.py --input input/model.obj --output output/

- 出力ディレクトリをチェックする(

output/)を使って、ボーンを含むモデルファイルを生成します。 - BlenderかMayaで開き、ボーンがアニメーションの要件を満たしているかどうかテストしてください。

3.皮膚重量の予測

- 機能説明ボーンを含むモデルに対して、自然に変形したスキンの重みを生成します。

- 手続き::

- 前のステップで生成したモデルファイルを使用する。

- 体重予測スクリプトを実行する:

python predict_weights.py --input output/model_with_skeleton.obj --output output/

- アニメーションのバインディングに直接使用できるウェイトを含むモデルファイルを出力します。

- 3Dソフトウェアで読み込み、アニメーション効果(歩行、回転など)をテストする。

アプリケーション・シナリオと操作例

ラピッドプロトタイピング

- 取るゲームデザイナーはキャラクターのアニメーションを素早く検証する必要があります。

- リグキャラクターモデル(OBJフォーマット)をアップロードし、ボーン生成とウェイト予測を実行し、歩行アニメーションのプロトタイプを5分で生成し、Unityにインポートしてテストします。

VR/ARアニメーション生成

- 取るバーチャルロボットのインタラクションアクションの生成

- リグロボットモデルの入力、ボーンとウェイトの生成、VR開発ツール(Unreal Engineなど)へのエクスポート、ユーザーインタラクションコマンドのバインド。

映画・ビデオ・アニメーション用エイド

- 取るファンタジークリーチャーの初期アニメーションを生成します。

- リグクリーチャーモデルをアップロードし、フレームワークを実行してボーンとウェイトを生成し、Mayaにインポートしてキーフレームを微調整し、プレビューアニメーションを生成します。

ヒントとコツ

- モデルの準備複雑な複数のコンポーネントが結果に影響するのを避けるため、入力モデルは単一のオブジェクトであることを確認してください。

- パフォーマンス最適化GPUで実行すると大幅に速くなり、CPUで実行すると遅くなる可能性があります。

- 結果の調整ボーンやウェイトが理想的でない場合は、ドキュメントに記載されているように、パラメータ(関節の数など)を変更することができます。

- 質問のフィードバックGitHub Issuesで問題を提出するか、開発者のChaoyue Songに連絡してください。

これらの手順により、MagicArticulateは、初心者からプロのデザイナーまで、あらゆるタイプのユーザーに対して、静的な3Dモデルをアニメーション資産に素早く変換することができます。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません