综合介绍

FitDiT是一个基于扩散变换器(Diffusion Transformers)的高保真虚拟试衣系统。该项目由腾讯AI Lab开发,旨在解决传统虚拟试衣系统在展示服装细节时的局限性。FitDiT创新性地提出了一种新的算法架构,能够更好地保留衣物的authentic细节,让虚拟试衣效果更加逼真。项目完全开源,提供了在线demo、预训练模型以及完整的代码实现,支持研究人员和开发者进行学术研究与商业预研。该项目于2024年11月发布论文,并在2024年12月陆续开放了在线演示、数据集和模型权重,获得了学术界和工业界的广泛关注。

在线演示:https://huggingface.co/spaces/BoyuanJiang/FitDiT

功能列表

- 全自动虚拟试衣生成功能

- 智能试衣区域遮罩生成

- 手动遮罩调整与编辑工具

- 多分辨率试衣效果支持

- 服装细节保真度优化

- 在线演示平台支持(Gradio界面)

- 本地部署支持(支持多种性能配置)

- Complex Virtual Dressing Dataset (CVDD)数据集

- 完整的模型训练和推理代码

- Hugging Face模型托管集成

使用帮助

1. 在线使用方法

FitDiT提供了两种在线使用方式:

- Hugging Face Space在线演示:访问 https://huggingface.co/spaces/BoyuanJiang/FitDiT

- 官方在线演示平台:访问 http://demo.fitdit.byjiang.com/

使用步骤:

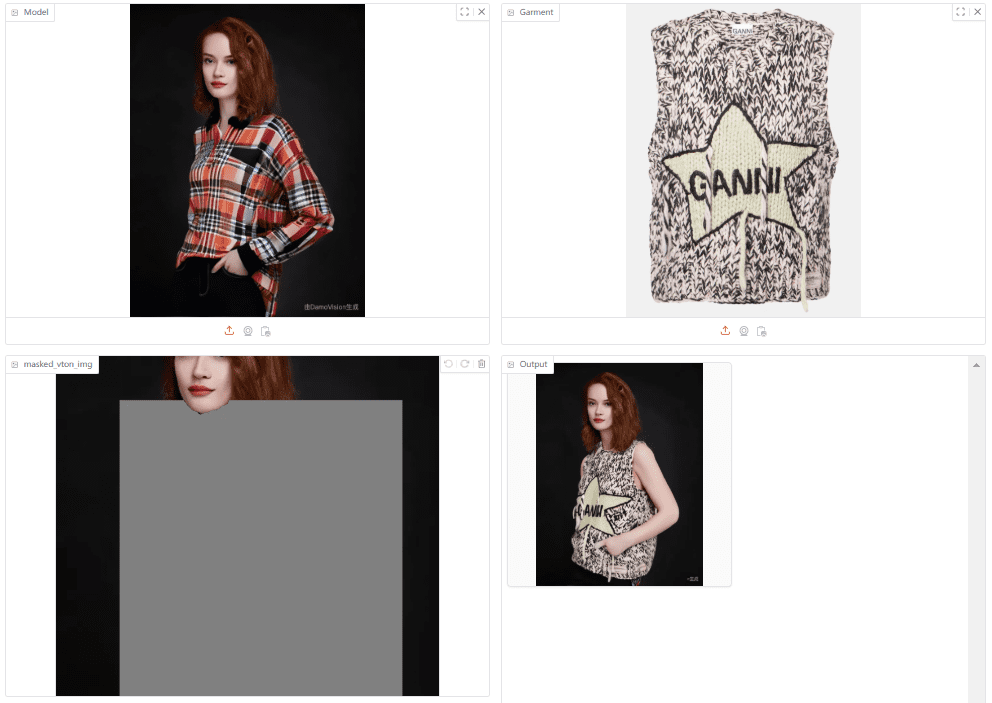

第一步:生成试衣区域遮罩

- 上传您想要更换衣服的人物图片

- 上传想要试穿的目标服装图片

- 点击"Step1: Run Mask"按钮生成初始遮罩

- 如果需要调整遮罩范围,可以:

- 使用滑块调整遮罩范围:

- mask offset top:调整上边界

- mask offset bottom:调整下边界

- mask offset left:调整左边界

- mask offset right:调整右边界

- 使用笔刷工具手动修改遮罩区域

- 使用橡皮擦工具细化遮罩边缘

- 使用滑块调整遮罩范围:

第二步:生成试衣效果

- 选择期望的试衣分辨率

- 点击"Step2: Run Try-on"开始生成

- 等待模型处理完成即可看到试衣效果

2. 本地部署方法

环境要求:

torch==2.3.0

torchvision==0.18.0

diffusers==0.31.0

transformers==4.39.3

gradio==5.8.0

onnxruntime-gpu==1.20.1

部署步骤:

- 申请访问FitDiT模型权重:

- 访问 https://huggingface.co/BoyuanJiang/FitDiT

- 获得访问权限后下载模型到本地目录

- 运行本地Gradio服务:

提供四种运行模式,根据您的硬件配置选择:# 最快速模式(需要较大显存): python gradio_sd3.py --model_path local_model_dir # FP16精度模式: python gradio_sd3.py --model_path local_model_dir --fp16 # CPU辅助模式(中等速度,适中显存): python gradio_sd3.py --model_path local_model_dir --fp16 --offload # 激进CPU负载模式(速度最慢,显存占用最少): python gradio_sd3.py --model_path local_model_dir --fp16 --aggressive_offload

3. 开发者使用说明

- 项目遵循CC BY-NC-SA-4.0许可证

- 仅供非商业用途使用

- 如需商业授权,请联系:byronjiang@tencent.com

- 完整的模型训练代码和数据集已开源

- 支持通过Hugging Face使用预训练模型

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...