Grok-1, la xAI de código abierto de Elon Musk

Resumen: Elon Musk y xAI acaban de publicar los pesos y la arquitectura de su enorme modelo de lenguaje paramétrico Grok-1 de 314B bajo la licencia Apache 2.0 de código abierto.

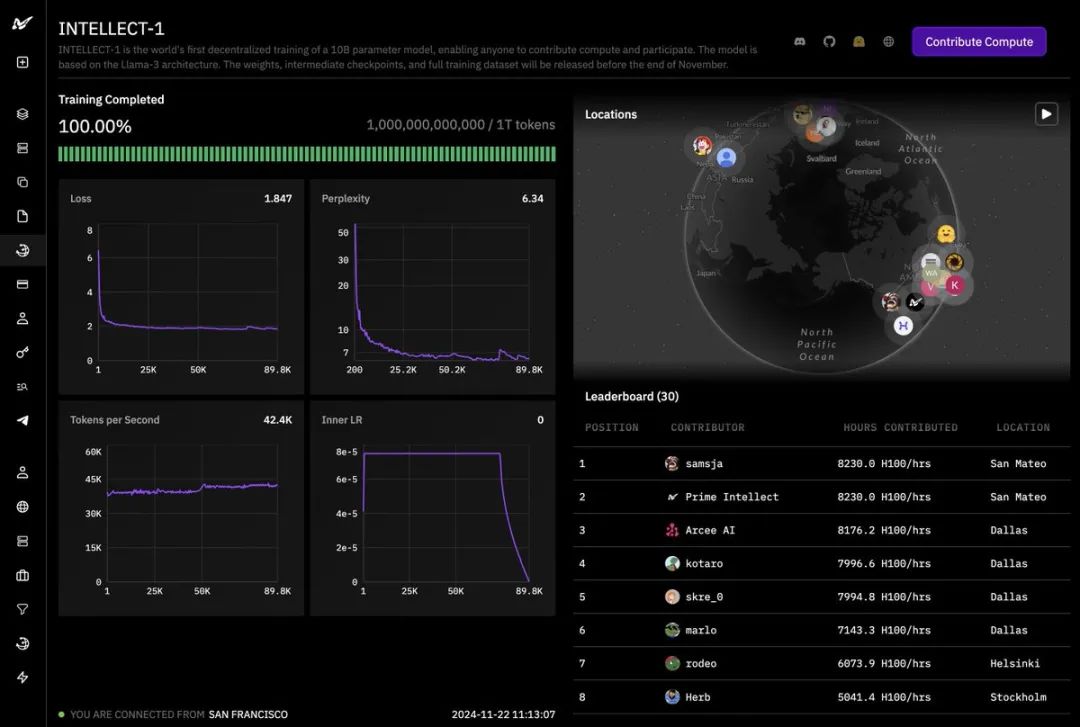

Hemos publicado los pesos y la arquitectura de nuestro modelo Grok-1 de mezcla de expertos con 314.000 millones de parámetros. Este es el punto de control del modelo base original para Grok-1 en la fase de preentrenamiento de octubre de 2023, y no está ajustado para una aplicación específica. El modelo se entrenó con grandes cantidades de datos de texto, utilizando pilas de entrenamiento personalizadas en JAX y Rust. Los pesos y la arquitectura se publican bajo la licencia Apache 2.0. Para utilizar el modelo, puede encontrarlo en el directorio github.com/xai-org/grok Ver instrucciones sobre.

Detalles.

Grok-1 es un modelo experto híbrido en el que sólo 25% pesos están activos para cualquier token de entrada dado para un cálculo más eficiente.

Los modelos publicados son puntos de control no entrenados a partir de octubre de 2023 y no han sido ajustados para ninguna tarea en particular.

xAI ofrece una guía para que los desarrolladores se inicien en su repositorio de GitHub y ha publicado el modelo en Hugging Face.

Importancia: al abrir en código abierto uno de los mayores LLM del mundo, xAI se adelanta a lo que Musk considera una batalla moral contra el modelo cerrado de OpenAI. Aunque las funciones de Grok aún no han roto ninguna barrera nueva, la medida es otra gran victoria para el desarrollo colaborativo y transparente de la IA.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...