¡Mantenga la línea de fondo AI, "niño enterrado foto" que participan en el caso de la persona fue detenida! Estos trucos le enseñan a identificar la autenticidad de las fotos

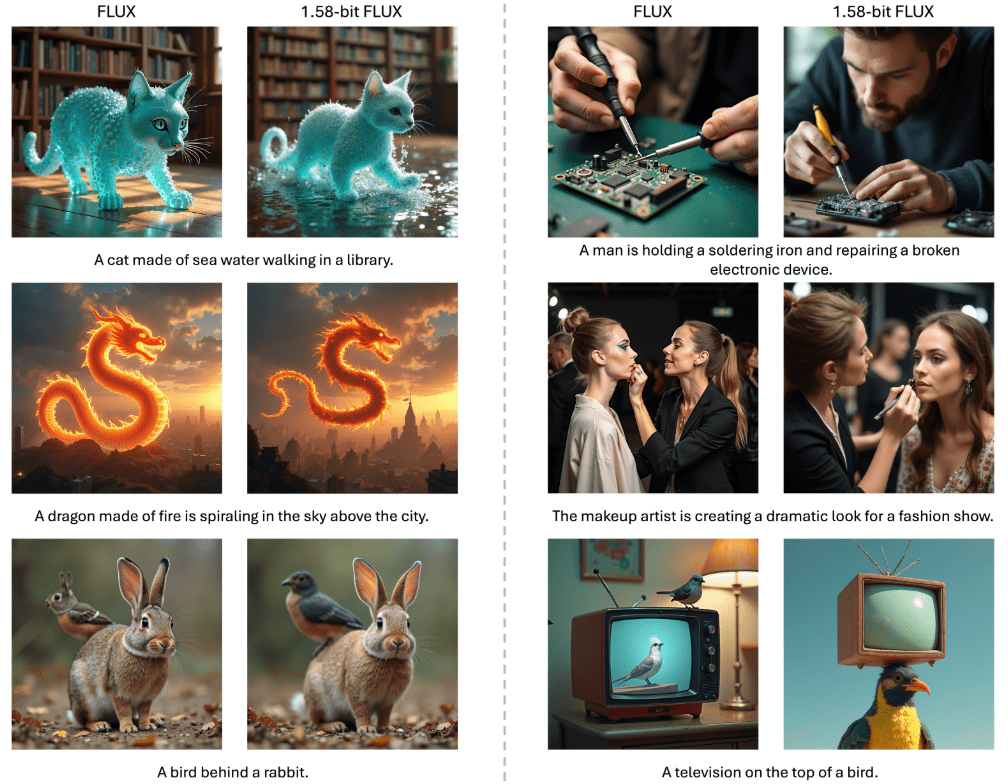

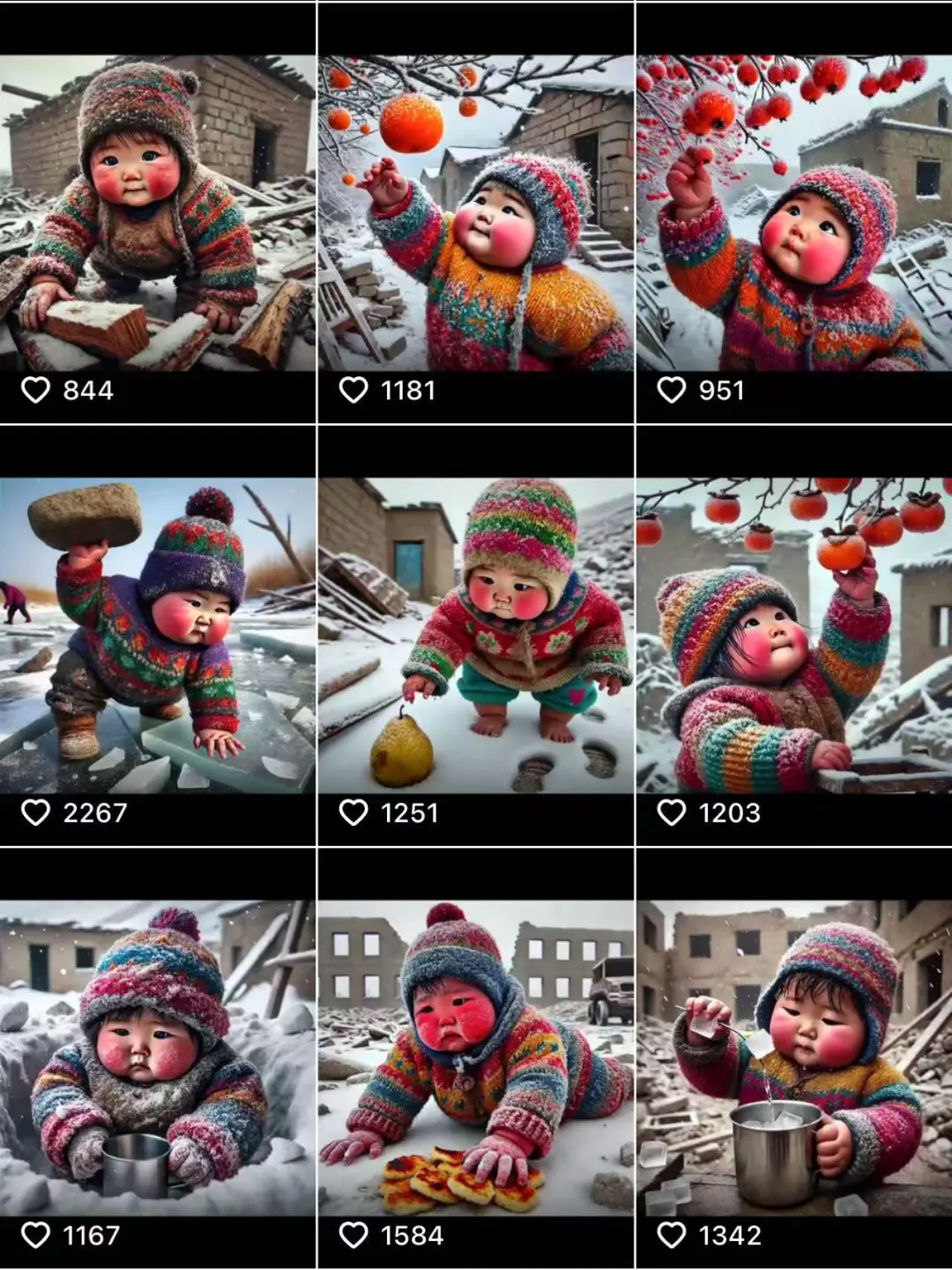

El 7 de enero, un terremoto de magnitud 6,8 sacudió el condado tibetano de Tingri, y muchas personas están preocupadas por el progreso de las labores de rescate y rezan por la seguridad de las zonas afectadas. Mientras tanto, en medio de toda la buena voluntad y preocupación, una foto de un "niño pequeño enterrado bajo los escombros" se hizo rápidamente popular en Internet.

Esta imagen, acompañada de las palabras "Terremoto de Rikaze", puso los pelos de punta a innumerables personas, y también provocó decenas de miles de likes y retweets. La mayoría de la gente no se dio cuenta de que no era más que una imagen falsa generada por IA.

La verdad sale a la luz: el contenido de AI ha sido robado

Observando detenidamente esta fotografía, un niño con sombrero enterrado entre los escombros parece encontrarse en una situación crítica y desgarradora, y sí parece la imagen de una escena de catástrofe.

Sin embargo, los internautas atentos descubrieron que el niño de la foto tenía un dedo de más. La policía comprobó más tarde que la imagen había sido generada por inteligencia artificial y no tenía nada que ver con el terremoto.

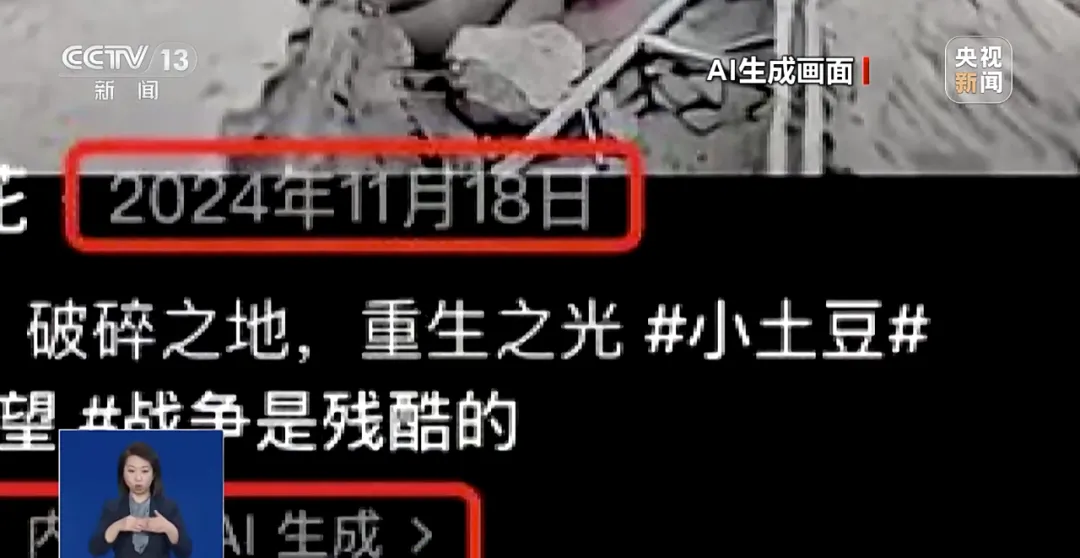

La imagen es de un creador de IA, el Sr. He, y originalmente era un breve vídeo publicado en noviembre del año pasado. Su intención original era llamar la atención sobre los niños en la guerra a través de contenidos de IA, pero no se dio cuenta de que el material había sido robado maliciosamente y juntado con el terremoto.

Los difusores de rumores no pueden eludir su responsabilidad

El pirata es un internauta de Qinghai. Para ganar tráfico, combinó esta imagen generada por IA con la catástrofe del terremoto, e incluso la etiquetó con palabras clave como "terremoto de Rikaze" en un intento de llamar la atención.

Este tipo de comportamiento no sólo perturba la audiencia pública, sino también el rescate real en la zona del desastre añadido confusión innecesaria, con el tiempo, el internauta fue detenido por la policía de acuerdo con la ley.

Según las disposiciones pertinentes de la Ley de Castigo de la Administración de Seguridad Pública y la Ley Penal, quienes difundan información falsa sobre catástrofes pueden enfrentarse a penas de detención o incluso a castigos penales más severos. Esta farsa de rumores también ha vuelto a advertir a todo el mundo de que Internet no es un lugar al margen de la ley.

¿La tecnología de IA se convierte en un hervidero de rumores?

Lo que mucha gente no piensa es lo barato que puede resultar producir un rumor. Con una simple palabra clave, se puede generar en menos de 30 segundos un vídeo de catástrofe lo bastante falso como para ser real, e incluso viene con narración.

Aunque el Estado ha promulgado la normativa pertinente, que exige que los contenidos generados por IA estén claramente etiquetados, la aplicación real del efecto no ha cumplido las expectativas. En este incidente, la imagen tenía originalmente una marca de agua "generada por IA", pero los creadores de rumores la eliminaron fácilmente.

¿Cómo puede el ciudadano de a pie reconocer las "imágenes falsas de la IA"?

Debemos estar atentos a los contenidos generados por IA. Aquí tienes algunos trucos que te ayudarán a comprobar rápidamente su autenticidad:

1. Detalles de la observación

Las imágenes generadas por IA pueden tener problemas con algunos detalles, especialmente elementos complejos o poco convencionales:

- Mano o dedo: Los detalles de la mano generados por la IA suelen ser anormales, como dedos múltiples, dedos que faltan, formas distorsionadas o proporciones incorrectas.

- Ojos y rasgos faciales: Los rostros generados por IA pueden tener ojos asimétricos, bordes borrosos o rasgos inconexos.

- Palabras y símbolos: El texto generado por la IA suele tener caracteres confusos, irregulares o ilegibles.

- Antecedentes: Puede haber objetos confusos e inconexos en el fondo, o elementos que no se ajustan a las leyes de la física (por ejemplo, sombras suspendidas).

2. Comprobar la textura y la coherencia lógica

Las imágenes generadas por IA a veces carecen de texturas y detalles habituales en el mundo real, y a veces ignoran las reglas de la lógica:

- Excesivamente lisa: Superficie de la piel o de un objeto que es excesivamente lisa.

- Repetición de detalles: por ejemplo, patrones similares en zonas localizadas, como hojas, ladrillos, etc.

- Luces y sombras: La dirección de la fuente de luz no coincide con la posición de las sombras.

- problema de reflexión: Los reflejos en los espejos o en el agua no corresponden a objetos reales.

- Proporción y disposición de los objetos: A menudo se producen arreglos extraños de tamaño o colocación, como muebles flotantes o desproporcionados.

3. Analizar la resolución y la calidad de las imágenes

- Resolución incoherente: Las imágenes generadas por IA pueden aparecer borrosas en algunas zonas y demasiado nítidas en otras.

- distribución de coloresLas imágenes de IA pueden estar sobresaturadas o tener un color uniforme y carecer de las sutiles transiciones de una escena real.

- artefactos de píxeles: Las imágenes generadas por la IA pueden tener texturas de píxeles irregulares al ampliarlas.

- Procesamiento de bordes: Los bordes de los objetos pueden ser demasiado nítidos o borrosos para mezclarse de forma natural con el fondo.

4. Atención a las leyes físicas y a los detalles del movimiento

Si la imagen incluye movimiento o elementos dinámicos:

- efecto de desenfoque: El desenfoque de movimiento generado por la IA puede no corresponder a patrones de movimiento reales.

- trayectoria: Los objetos que se mueven rápidamente pueden no tener una pista de movimiento real o una imagen superpuesta.

- leyes de la físicaLa dinámica física natural de las fotos reales (por ejemplo, el viento soplando las hojas) puede ser difícil de reproducir perfectamente por la IA.

5. Comprender las características estilísticas de las herramientas gráficas de la IA

Las distintas herramientas de IA generan imágenes con sus propios estilos distintivos:

- A mitad de viaje: Las imágenes tienden a ser muy artísticas y les gusta añadir efectos de desenfoque o sobreenfoque.

- Difusión estable: A veces hay distorsión en bordes y objetos pequeños.

- DALL-E: Pueden producirse errores lógicos o de detalle al generar escenas complejas.

La tecnología es sólo una herramienta, su mejor uso depende del corazón y la mente de las personas

El incidente del "niño enterrado" es un espejo. Refleja las dos caras de la tecnología de IA: puede ayudarnos a crear nuevas posibilidades o, cuando se utiliza de forma inadecuada, puede convertirse en promotora de rumores.

Pero eso no significa que debamos "alejarnos" de la tecnología de IA. Al contrario, necesitamos regulación legal, mejoras tecnológicas y sentido de la responsabilidad en el corazón de todos. En la era de Internet, la línea que separa la verdad de la falsedad es a veces muy difusa, pero tu calma y racionalidad pueden hacer que esas mentiras cuidadosamente tejidas pierdan suelo.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...