综合介绍

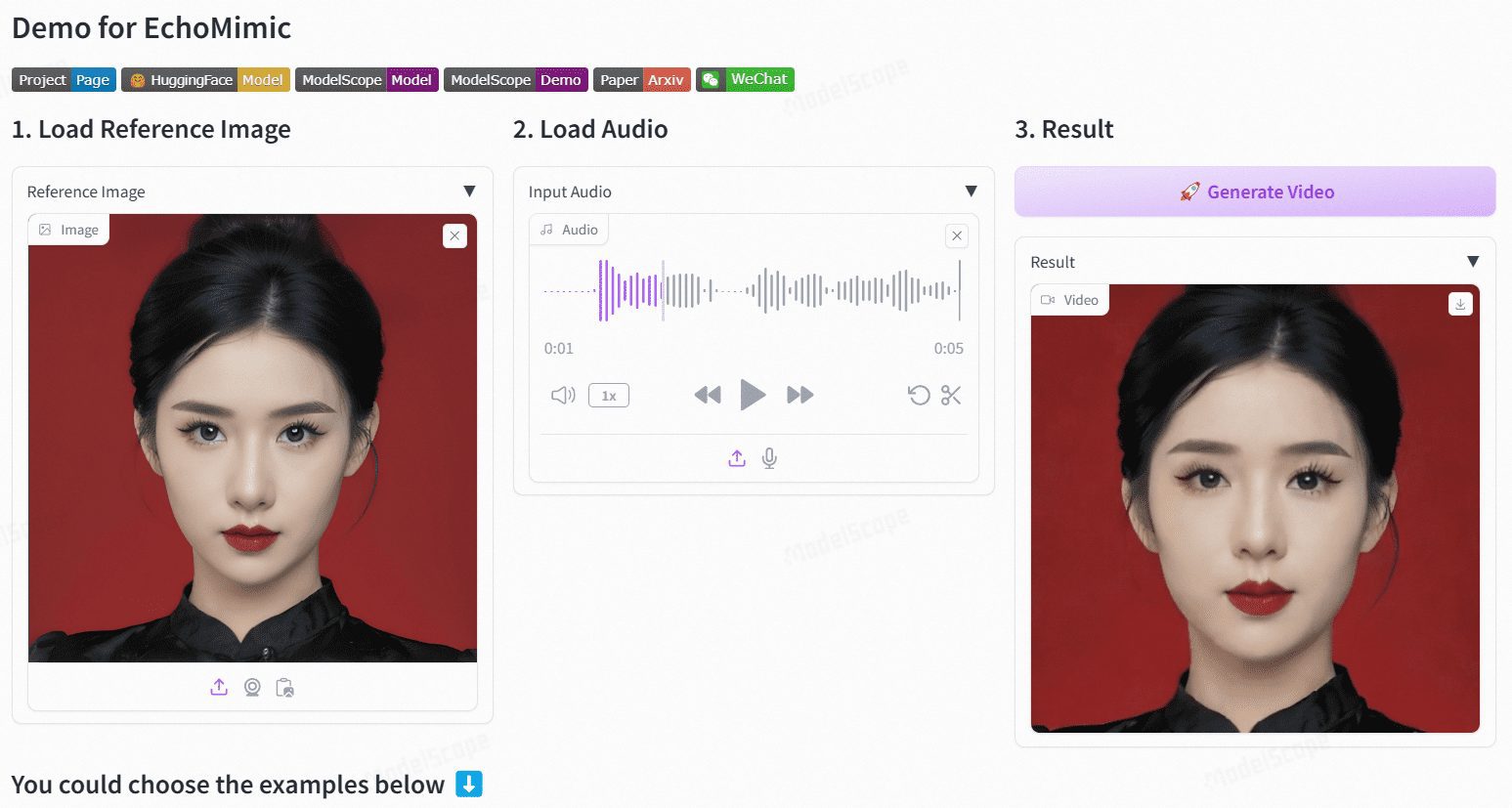

EchoMimic 是一个开源项目,旨在通过音频驱动生成逼真的肖像动画。该项目由蚂蚁集团的终端技术部门开发,利用可编辑的标志点条件,结合音频和面部标志点生成动态的肖像视频。EchoMimic 在多个公共数据集和自有数据集上进行了全面比较,展示了其在定量和定性评估中的优越性能。

EchoMimicV2版本优化推理速度,加入手势动作,推荐。

演示地址:https://www.modelscope.cn/studios/BadToBest/BadToBest V2:https://huggingface.co/spaces/fffiloni/echomimic-v2

功能列表

- 音频驱动动画:通过音频输入生成逼真的肖像动画。

- 标志点驱动动画:利用面部标志点生成稳定的肖像动画。

- 音频+标志点驱动:结合音频和选定的面部标志点生成更自然的肖像动画。

- 多语言支持:支持中文、英文等多种语言的音频输入。

- 高效推理:优化后的模型和管道显著提高了推理速度。

使用帮助

安装流程

- 下载代码:

git clone https://github.com/BadToBest/EchoMimic cd EchoMimic - 设置Python环境:

- 推荐使用conda创建虚拟环境:

conda create -n echomimic python=3.8 conda activate echomimic - 安装依赖包:

pip install -r requirements.txt

- 推荐使用conda创建虚拟环境:

- 下载并解压ffmpeg-static:

- 下载ffmpeg-static并解压,然后设置环境变量:

export FFMPEG_PATH=/path/to/ffmpeg-4.4-amd64-static

- 下载ffmpeg-static并解压,然后设置环境变量:

- 下载预训练权重:

- 根据项目说明下载相应的预训练模型权重。

使用流程

- 运行Web界面:

- 启动Web界面:

python webgui.py - 访问本地服务器查看界面并上传音频文件进行动画生成。

- 启动Web界面:

- 命令行推理:

- 使用以下命令进行音频驱动的肖像动画生成:

python infer_audio2vid.py --audio_path /path/to/audio --output_path /path/to/output - 结合标志点进行推理:

python infer_audio2vid_pose.py --audio_path /path/to/audio --landmark_path /path/to/landmark --output_path /path/to/output

- 使用以下命令进行音频驱动的肖像动画生成:

- 模型优化:

- 使用优化后的模型和管道可以显著提高推理速度,例如在V100 GPU上从7分钟/240帧提高到50秒/240帧。

注意事项

- 确保使用的Python版本和CUDA版本与项目要求一致。

- 在使用过程中,如遇到问题,可以参考项目的README文件或在GitHub上提交issue寻求帮助。

Windows 一键安装包

链接:https://pan.quark.cn/s/cc973b142d41

提取码:5T57

EchoMimicV2加速版下载

夸克:https://pan.quark.cn/s/12acd147a758

百度:https://pan.baidu.com/s/1z8tiuGtN29luQ7Cg2zHJ8Q?pwd=9e8x

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...