综合介绍

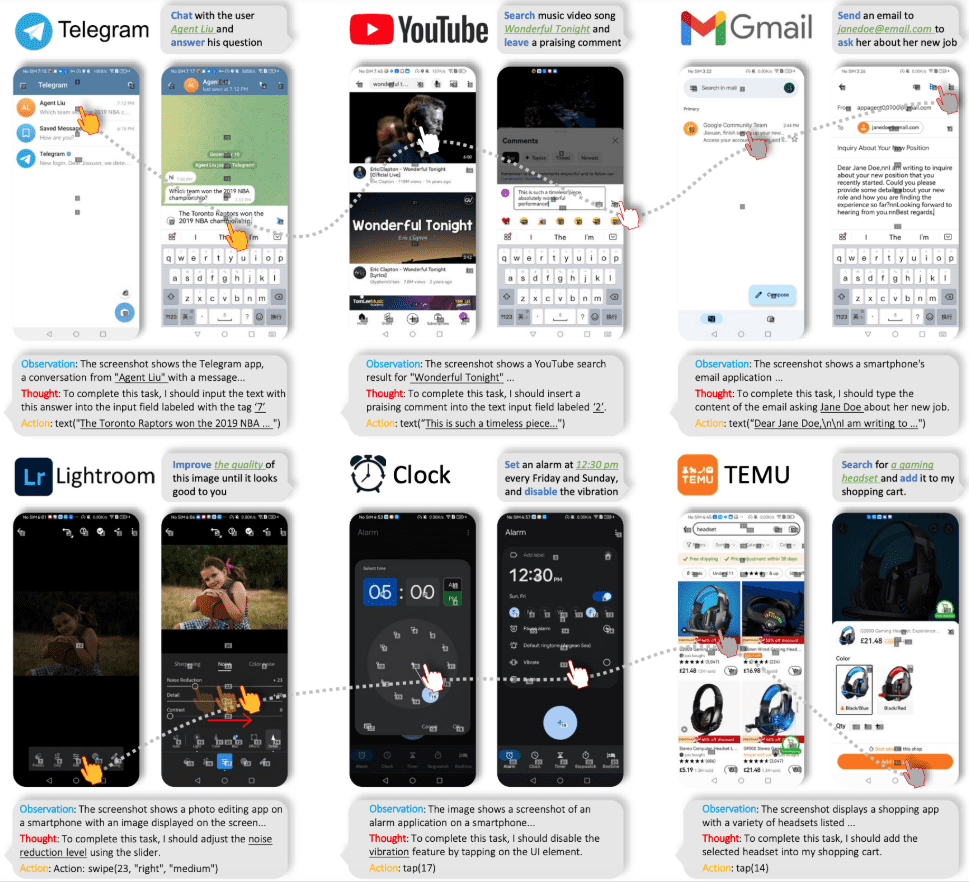

AppAgent 是一个基于大语言模型(LLM)的多模态代理框架,旨在操作智能手机应用程序。该框架通过简化的操作空间,模仿人类的交互方式,如点击和滑动,从而无需系统后端访问,扩大了其在不同应用程序中的适用性。AppAgent 通过自主探索或观察人类演示来学习使用新应用,并生成知识库以执行复杂任务。

腾讯推出的 AppAgent,是一个多模态智能体,通过识别当前手机的界面和用户指令直接操作手机界面,能像真实用户一样操作手机!比如它可以操作图片编辑软件编辑图片、打开地图应用导航,购物等等操作

项目首页:https://appagent-official.github.io

论文链接:https://arxiv.org/abs/2312.13771

论文摘要

随着大语言模型(LLMs)的最新进展,人们创造出了能执行复杂任务的智能智能体。本文介绍了一个全新的、基于大语言模型的多模态智能体框架,专为操作智能手机应用而设计。我们的框架让智能体可以通过一个简化的操作空间来操控智能手机应用,这种方式仿佛是人类在进行点击和滑动操作。这种创新的方法避开了对系统后端的直接访问需求,使其能够适用于多种不同的应用程序。我们智能体功能的核心在于它的创新学习方式。智能体通过自我探索或者观察人类的示范来学习如何导航和使用新的应用程序。在这个过程中,它会构建起一个知识库,并依靠这个知识库来执行不同应用中的复杂任务。为了展示我们智能体的实用性,我们对它在 10 个不同应用中的 50 个任务进行了全面测试,这些应用包括社交媒体、电子邮件、地图、购物以及复杂的图像编辑工具。测试结果证明了我们的智能体在处理各种高级任务方面的高效能力。

功能列表

- 自主探索:代理可以自主探索应用程序,记录交互元素并生成文档。

- 人类演示学习:代理通过观察人类演示来学习任务,并生成相应的文档。

- 任务执行:在部署阶段,代理根据生成的文档执行复杂任务。

- 多模态输入:支持文本和视觉输入,使用 GPT-4V 或 Qwen-VL-Max 模型。

- CAPTCHA 处理:能够通过 CAPTCHA 验证。

- UI 元素识别:使用网格覆盖定位未标记的 UI 元素。

使用帮助

安装与配置

- 下载和安装:从 GitHub 页面下载项目文件,并安装必要的依赖项。

- 配置文件:修改根目录下的

config.yaml文件,配置 GPT-4V 或 Qwen-VL-Max 模型的 API 密钥。 - 连接设备:使用 USB 连接 Android 设备,并启用开发者选项中的 USB 调试。

自主探索模式

- 启动探索:运行

learn.py文件,选择自主探索模式,输入应用名称和任务描述。 - 记录交互:代理将自动探索应用,记录交互元素并生成文档。

人类演示模式

- 启动演示:运行

learn.py文件,选择人类演示模式,输入应用名称和任务描述。 - 执行演示:按照提示进行操作,代理将记录所有交互并生成文档。

任务执行

- 启动任务:运行

run.py文件,输入应用名称和任务描述,选择相应的文档库。 - 执行任务:代理将根据文档执行任务,完成复杂操作。

详细操作流程

- 下载项目:访问 GitHub 页面,下载项目文件并解压。

- 安装依赖:在终端中运行

pip install -r requirements.txt安装所有依赖项。 - 配置模型:根据需要修改

config.yaml文件,配置 GPT-4V 或 Qwen-VL-Max 模型的 API 密钥。 - 连接设备:使用 USB 连接 Android 设备,并在设备上启用 USB 调试模式。

- 启动探索或演示:运行

learn.py文件,选择自主探索或人类演示模式,输入应用名称和任务描述。 - 生成文档:代理将记录所有交互并生成文档,供后续任务执行使用。

- 执行任务:运行

run.py文件,输入应用名称和任务描述,选择相应的文档库,代理将根据文档执行任务。

© 版权声明

文章版权归 AI分享圈 所有,未经允许请勿转载。

相关文章

暂无评论...